基于互信息分解表示学习的多模态情感分析

涉及到完全不懂的理论部分,全部创新都在损失函数

整体通过信息论工具显式分离多模态信息,突破传统融合方法的信息混杂问题

Q

哪里看得出来互补信息分离?

A

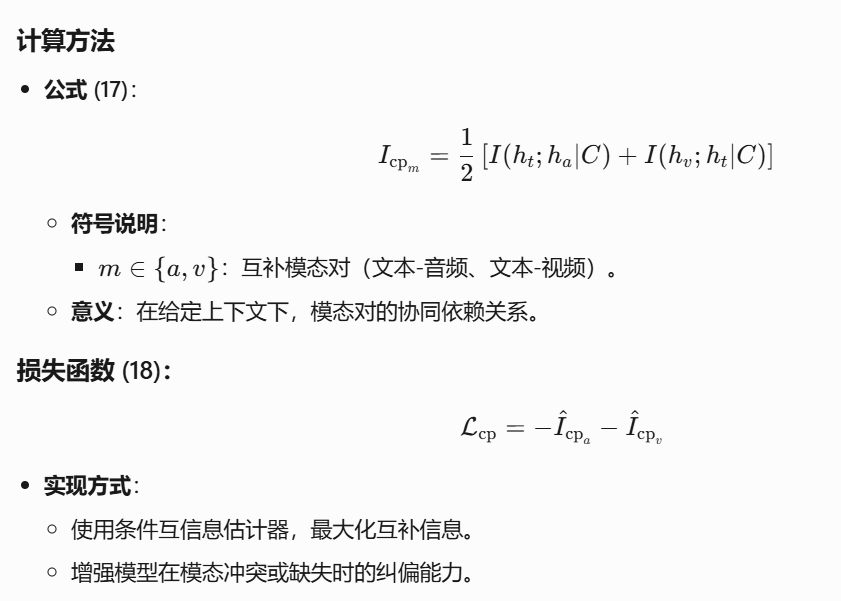

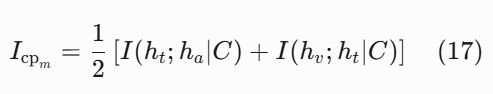

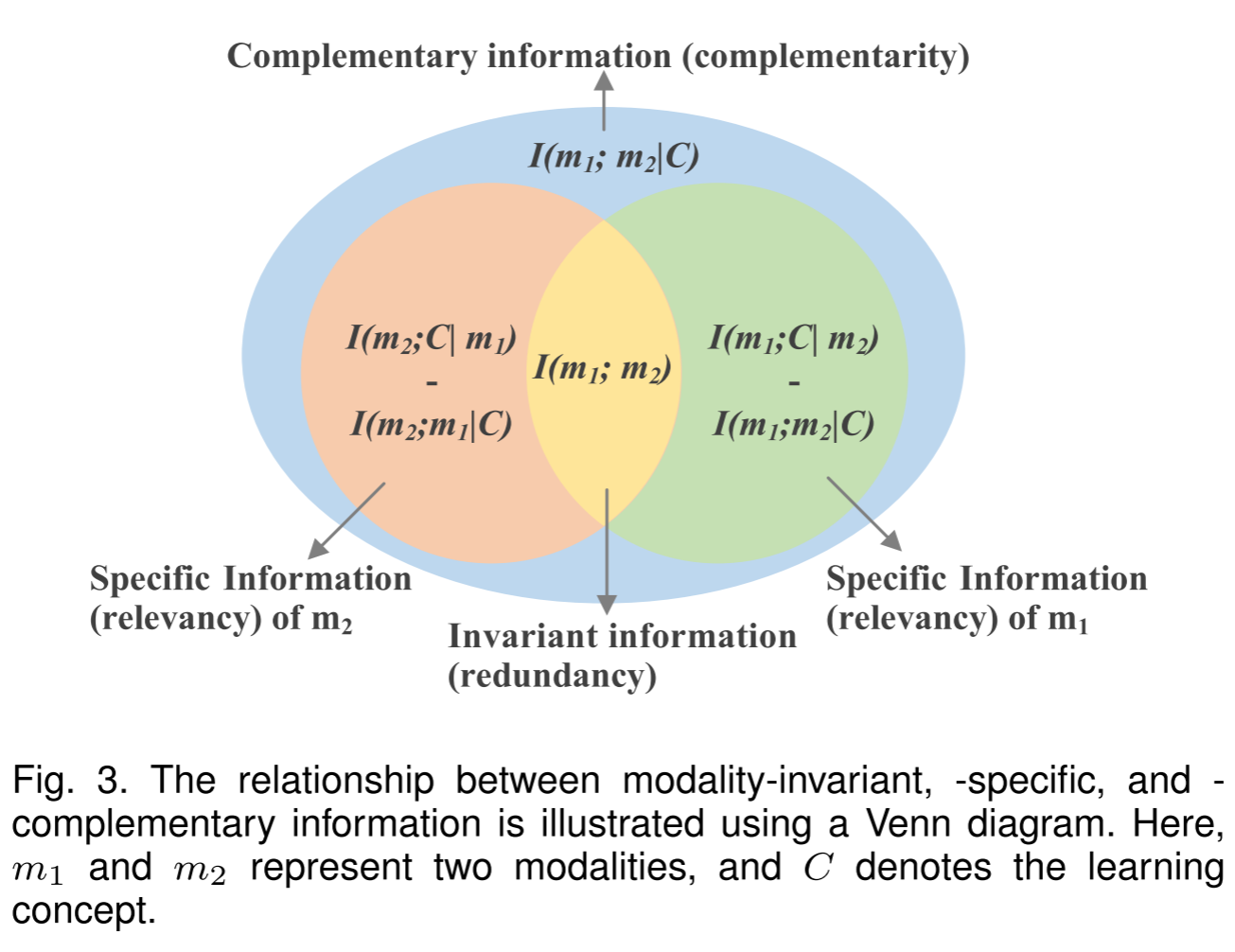

互补信息被定义为 两对模态的条件互信息(CMI)之和的平均

- 条件互信息(CMI):

表示在给定上下文概念 C(如情感类别)的条件下,两个模态间的依赖关系。

- 例如,I(ht;ha∣C) 表示文本和音频在已知情感类别时的协同信息。

- 互补性:这种依赖关系是其他模态无法单独提供的(如音频修正文本与视频的矛盾)。

通过 最大化互补信息 来构建损失函数

- 负号的意义:

损失函数通常被最小化,因此负号表示需要 最大化互补信息(最小化负互信息等价于最大化正互信息)。- 优化目标:

迫使模型学习模态间的动态协同关系,例如:

- 当文本与视频矛盾时,模型通过音频的互补信息修正预测

abstract

多模态情感分析试图利用各种类型的信号来识别潜在的情感和情感。

该领域的一个关键挑战在于多模态表征学习,其目的是开发有效的方法将多模态特征整合到内聚表征中。最新的研究成果包括两个方面:一个是将多模态特征分解为模态不变性和模态特异性特征,另一个是利用互信息来增强模态融合。这两项战略都显示出有效性,并取得了显著的成果。

为此,本文提出了一种新的学习框架,该框架结合了这两种学习方法的优点,称为基于互信息的解纠缠多模态表示学习。

我们的方法包括在特征提取和融合阶段估计不同类型的信息。

具体地说,我们在特征提取过程中定量地评估和调整模态不变、模态特定和模态互补信息的比例。随后,在融合过程中,我们评估融合表示中每种模态保留的信息量。我们采用互信息或条件互信息来估计每种类型的信息量。通过协调这些不同类型信息的比例,我们的方法在流行的情绪分析基准测试(包括CMU-MOSI和CMU-MOSEI)上实现了最先进的性能。

intro

近年来,随着社交媒体的快速发展,用户生成的多媒体内容(如推文和视频)的数量显著增长。一般来说,这些多媒体数据通常包括三种形式:视觉(图像)、听觉(语音)和转录文本。大多数都隐含着关于说话人的丰富的情感信息。如何对隐含情感进行自动分析是一个值得欢迎的挑战,并可应用于投票、商品分析等领域。

多模态情感分析(MSA)的一个关键挑战是如何有效、均衡地表示所涉及的模态。在这一点上,许多研究人员已经集中精力设计有效的融合模型,以整合不同模态的语义。例如,注意机制[1]、[2]、[3]、[4]用于跨模态交换信息,而Transformer [5]用于执行模态交互[6]、[7]、[8]。最近,两种又融合了(如图1所示)。

在特征提取阶段,有两个问题引起了我们的极大兴趣:

(i)现有的方法大多数都是针对每个模态提取模态不变量和模态特定信息,而很少涉及模态互补信息。

(ii) 先前的工作[9]、[10]明确地将多模态特征分解为不同的部分。但相应的信息量还没有得到定量的估计和分析。然而,在融合阶段,尽管提出了一些方法来改善融合效果,但是确定在不同场景(例如,不同任务和数据源)下,哪些模态在融合表示中占主导地位是有帮助的。

为此,将多模态解耦方法与基于互信息的方法相结合,设计了一个基于互信息的去纠缠多模态表示学习框架.

首先,针对特征提取阶段存在的问题,提出了三种类型的有用信息分布在相关模态中(本文中称为模态信息):(1)模态不变信息,其在相关模态之间是共享的,并且指向共同的语义;(2)模态特定信息,其对于每个模态是特定的,但是仍然与最终预测相关,因为它们从不同的方面描述语义;(3)模态互补信息,是只有当两个或多个模态联合组合时才出现的预测信息。

在每个模态包含不完整或部分信号的意义上,它是分散的,这些信号单独地不足以进行预测,直到将分散的部分组合起来[14],[15]。这三部分信息从不同的角度描述了多模态问题,它们都是多模态表征学习的关键。与以往的方法[9]、[10]不同,本文通过MI和条件互信息(CMI)估计模态信息。通过定量分析和协调,研究了它们的最佳协调比,发现在多模态学习中,不同的数据或任务对它们的侧重点不同。其次,为了解决融合阶段中的问题,我们还采用MI来促进多模融合,如[12]、[13](在此称为融合信息)所述。然而,我们更进一步,定量分析了每个模态对融合表示的贡献。在这两个阶段中,通过这些细粒度的方法,我们可以评估和改进当前最新技术(SOTA)方法的融合效果。

总之,我们的贡献有三个方面。

·我们提出了一个框架,利用互信息来探索不同类型的模态信息(不变、特定和互补)的影响。据我们所知,这是第一个桥接多模态解耦和互信息的研究。

·在多模态特征融合过程中,我们定量地估计每个模态的贡献。通过这种方式,我们可以直观地分析出融合过程中各个模态的重要性。

·在4个公共数据集上进行了大量的实验,实验结果表明,本文提出的框架能够达到SOTA的性能。

related work

multimodal sentiment analysis

多模态情感分析是多模态机器学习的一个新的研究方向。任务是通过利用多种模态来预测情感倾向,包括语言学(t)、视觉(v)和声学(a)。大多数方法集中在进行预测之前设计不同的融合方案[16],[17]。Mohammed等人。[18]是第一个通过连接三种表示来解决三模态情感分析任务的人。Cambria等人。[19]提出了感知混合,Zadeh等人。[20]然后提出了张量融合网络(TFN)来混合相关模态的特征。之后,引入注意力机制来平衡不同模态的重要性。例如,Gu等人[3]设计了一种分层注意策略来分析语言层面的情感。考虑到语境对人们情感的影响,Zadeh等人[2]和Chauhan等人[4]先后提出了情境感知的交互式注意和多注意递归网络。在此之后,一些研究人员发现了Transformer [5]在多模态学习中的潜力[7],[21]。Transformer的优势在于能够捕获长范围的依赖关系,从而允许它在预测之前考虑更全面的语义。最近,Hao等人。[22]发现纯多层感知器结构(MLP)也可以达到相当高的性能。

多模态解耦方法

一些研究者已经指出,在每个模态中都有一个模态不变部分和一个模态特定部分[23],[24],[25]。

模态不变部分在所涉及的模态之间共享,而模态特定信息对于每个模态是私有的。

一般而言,现有的方法将多模态特征显式地映射到模态不变和模态特定的子空间中。例如,Hazarika等人[9]采用中心矩差异度量[26]在分布水平上将不变部分推得更近,同时使特定部分在几何上正交。Yang等人[10]试图通过希尔伯特-施密特独立性准则[27]使不变部分数值相似,并提示特定部分独立。

然而,这些方法都是定性的,并且需要显式的特征分解,这使得它们难以推广。目前,还没有一种方法可以定量地分析各模态的信息组成对融合效果的影响。

基于互信息的方法

最近,一些作品提出了查看多模态融合的互信息的角度来看。例如,Han等人[12]首先将MI引入MSA以提高融合性能。从技术上讲,MI描述了两个变量共有多少信息:

其中X和Y是两个高维特征。han等人通过最大化每个模态(hₘ)与融合表示(h_f)之间的互信息:I(hₘ; h_f),其中m ∈ {t, a, v}(分别代表文本、音频、视觉模态)。与此同时,Colombo等人[13]提出了一套基于互信息的新目标,旨在最大化模态间的依赖性,这种方法不仅基于互信息理论,还能使学习到的表征对模态缺失具有更强的鲁棒性。

这些方法[12]、[13]给了我们很大的启发,但它们只是定性地分析了互信息对融合过程的驱动作用,忽略了各种模态信息在特征提取过程中的作用。相比之下,我们不仅在融合过程中定量计算每种模态的影响,而且在特征提取过程中估计不同模态信息的比例(不变,特定和互补)。

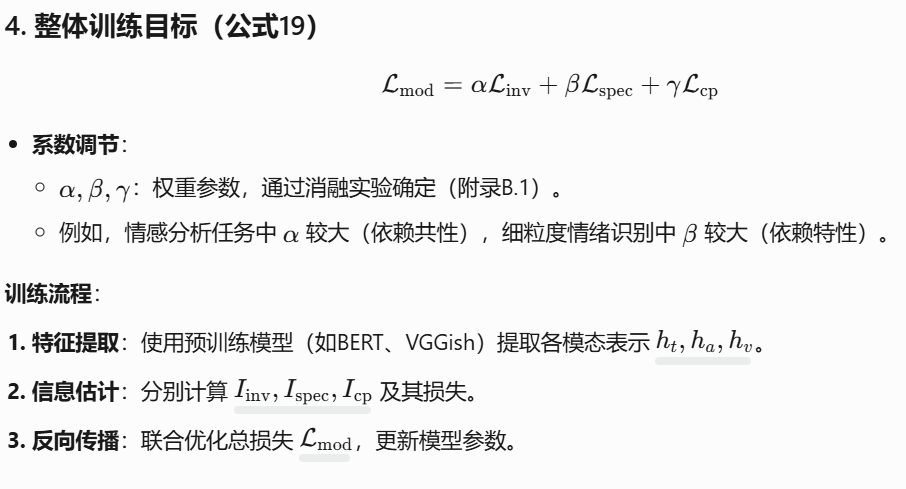

method

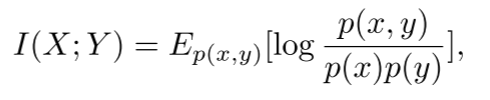

在多模态情感分析(MSA)和抑郁检测(MDD)等人类心理状态估计中,模型的输入通常是人类的话语。每个话语都是一个视频剪辑,包括三种模态:文本(t)、声学(a)和视觉(v)。我们的目标是基于模态来预测情绪或抑郁倾向y。图2显示了我们建议的框架的流水线。来自不同模态的特征首先由相应的提取器提取。

每个模态(hm,m ∈ {t,a,v})的所生成的表示然后由特定的融合编码器F融合成表示hf。整个过程分为两个阶段:特征提取和融合。

在特征提取阶段,我们评估和协调相应表示hm中的模态信息,包括模态不变信息、模态特定信息和模态互补信息。

在融合阶段,我们按照Han等人[12]的方法,最大化融合表示hf和hm之间的互信息,称为融合信息。

最后将最大化的信息转换为训练损失,与任务损失沿着用于反向传播,以改善表示学习。

在训练过程中,通过调整损失系数来控制不同信息的比例,从而揭示不同学习模型和任务的侧重点。

多模态表示生成与融合

文本用bert,视觉和音频用lstm提取

然后用cubemlp得到融合特征表示

模态信息最大化(特征提取阶段)

在前人的工作中[9]、[12],模态不变信息和模态特定信息得到了广泛的研究,特别是模态不变信息。但是受到一些基于信息论的工作的启发[14],[15],我们提出模态表征包含三种有用的信息:模态不变信息,特定信息和互补信息。

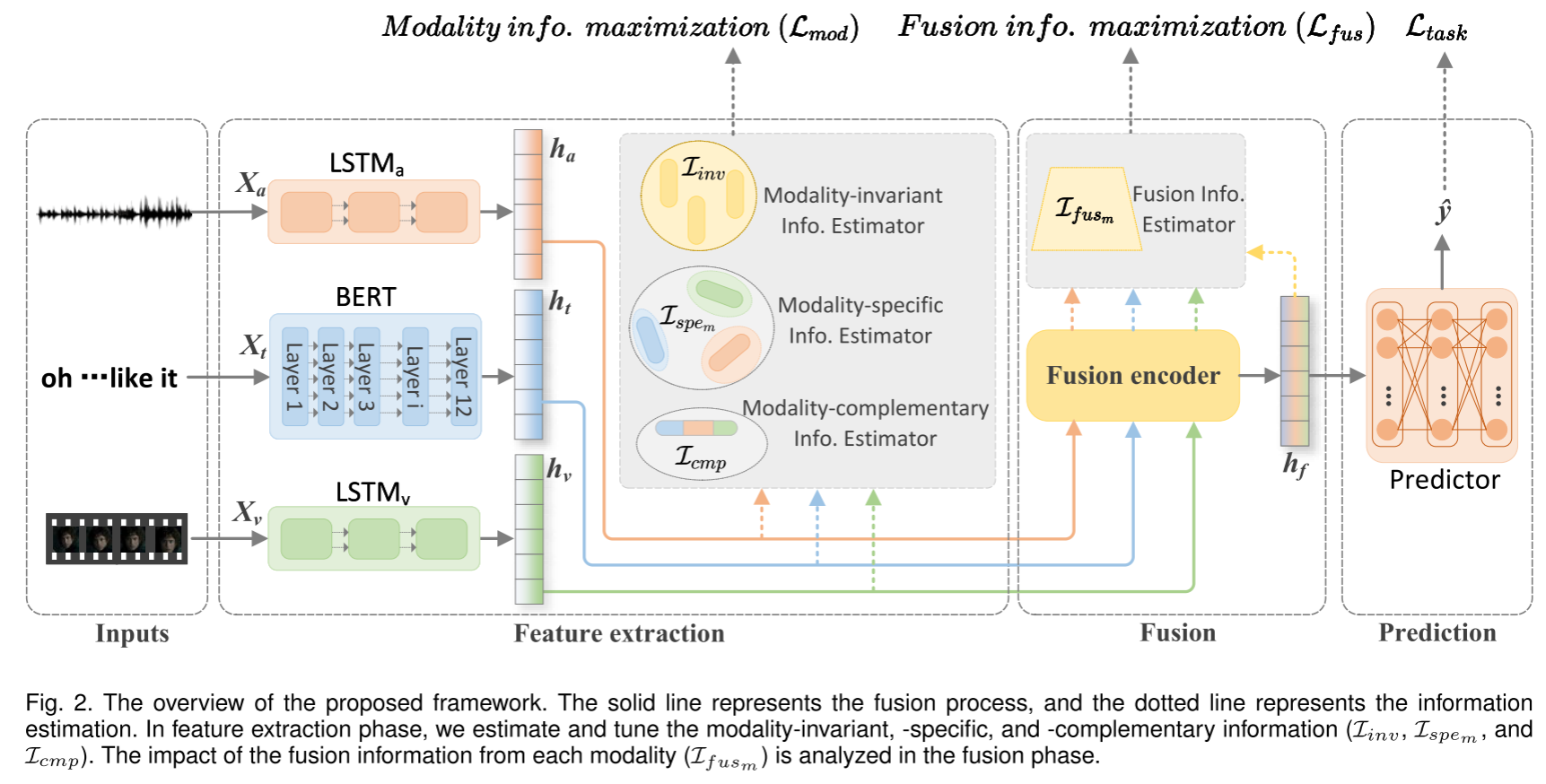

模态不变的,特定的,和互补的信息之间的关系,说明使用维恩图。这里,m1和m2表示两个模态,C表示学习概念。

为此,我们利用MI和CMI在融合之前测量hm(m ∈ {t,a,v})上的上述模态信息。以两个集合(m1和m2)为例,互补性,冗余性和相关性在维恩图中显示(图3)[14],[31],[32]。

在多模态处理的情况下,我们认为冗余作为modalityinvariant信息,相关性作为modality-specific信息,和互补性作为modality-complementary信息。

学习概念是指目标之间的模式或隐含关系(例如,情感倾向)和多模态输入数据(诸如文本、音频和视觉特征)。

它表示模型的特定于任务的映射函数,将原始多模态输入转换为有意义的输出。在进行模态信息的估计之前,我们需要首先估计MI和CMI。

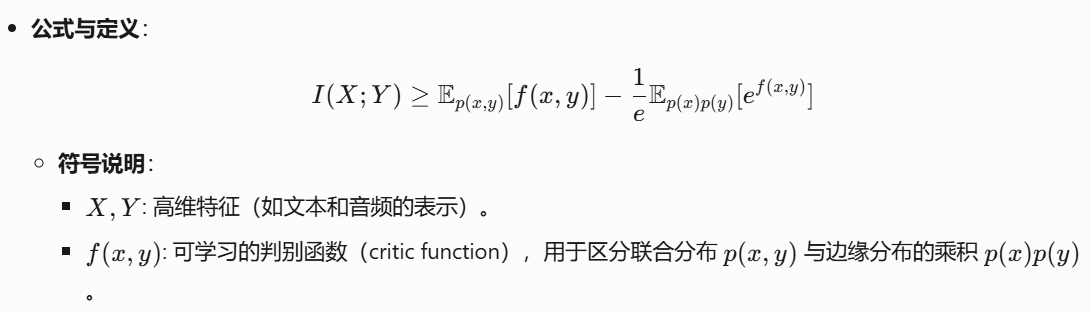

估计MI和CMI

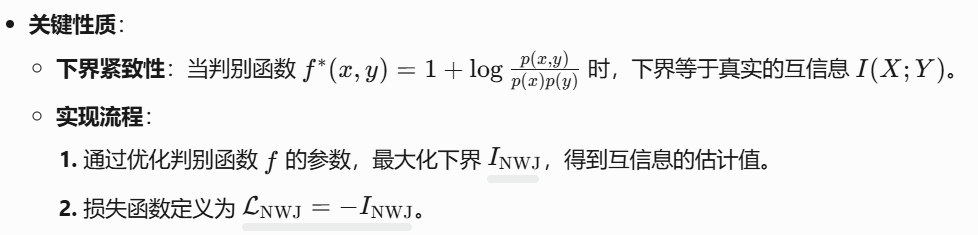

1. 互信息(MI)的估计

目标:量化两个高维特征(如文本和音频模态)之间的依赖关系。

方法:使用 NWJ变分下界(Nguyen-Wainwright-Jordan bound)。

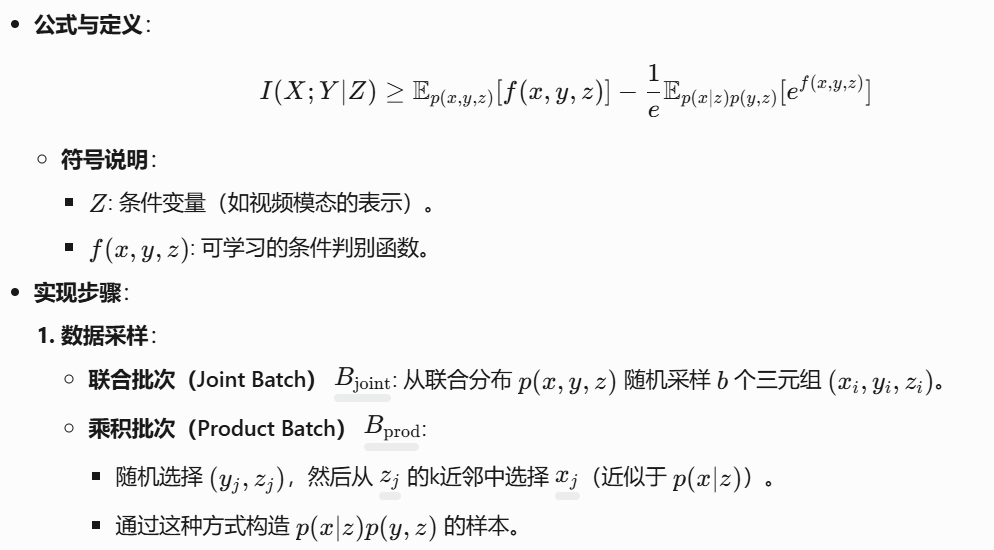

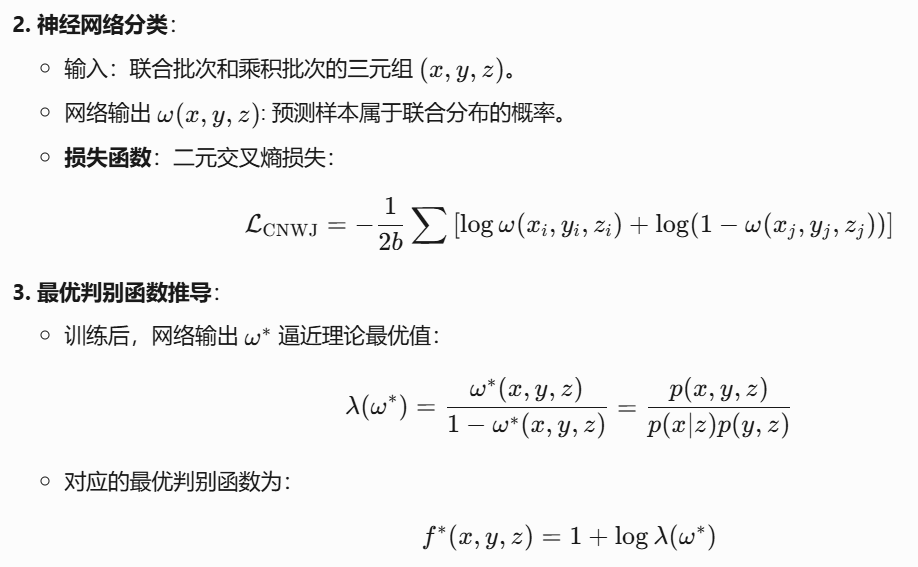

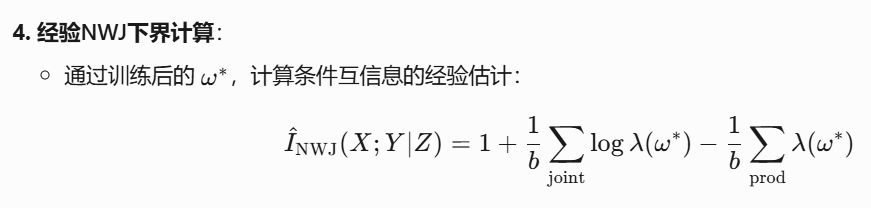

2. 条件互信息(CMI)的估计

目标:在给定第三个变量 Z 的条件下,估计 X 与 Y 的依赖关系(例如,在已知视频模态 Z 时,文本 X 与音频 Y 的关系)。

方法:采用 CMINE方法(Conditional Mutual Information Neural Estimator)。

Q:

实现步骤是如何?

A:

- 特征提取:使用预训练模型(如BERT、VGGish)提取各模态的高维表示。

- 构建联合/乘积批次:

- 联合批次:从完整多模态数据中采样。

- 乘积批次:通过条件采样(如k近邻)构造近似分布。

- 训练判别网络:优化NWJ或CMINE目标函数,估计MI/CMI。

- 融合策略:根据MI/CMI值动态调整模态权重(如注意力机制)。

MI和CMI本身不设计为模型中的独立层或模块(如注意力机制、融合层)。它们的值通过损失函数间接影响模型参数更新,但不会在推理阶段显式参与计算。

Estimating Modality Information

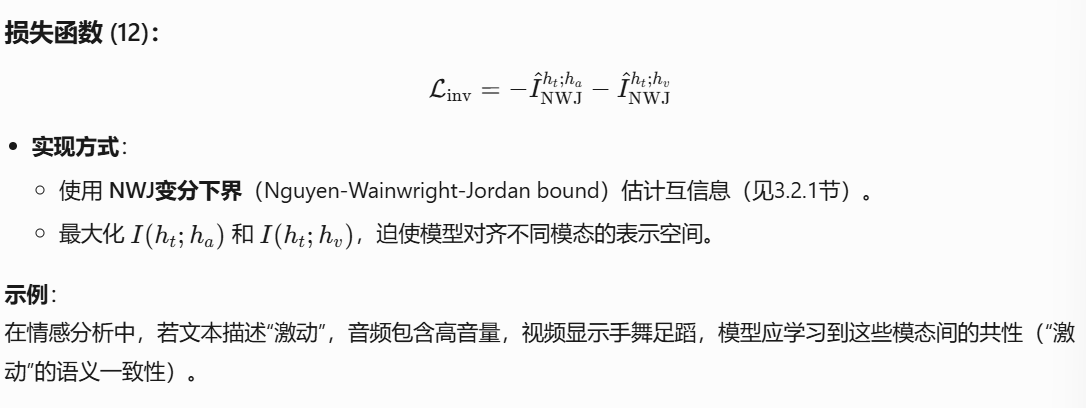

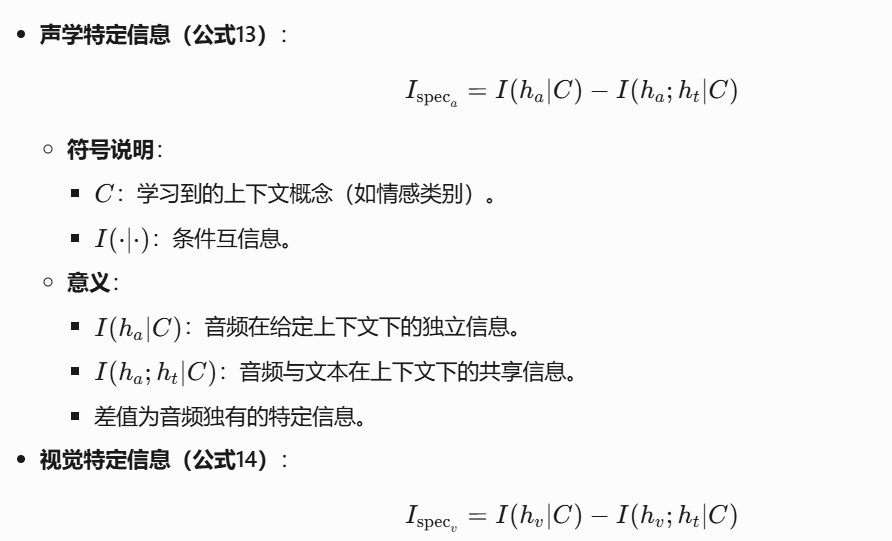

本节核心目标是通过定义和优化 模态不变信息(Modality-Invariant)、模态特定信息(Modality-Specific) 和 模态互补信息(Modality-Complementary),在多模态学习中分离不同信息类型,从而提升模型对模态依赖关系的理解。以下是分步解释:

1. 模态不变信息:

2. 模态特定信息

目标:保留单一模态独有的细粒度特征(例如,音频的频谱细节、视频的微表情)。

3. 模态互补信息

目标:建模模态间的动态协同关系(例如,文本与视频矛盾时,依赖音频修正预测)。