神经网络发展的时间线——积跬步至千里

| 神经网络类型 | 层 | 创新 | 问题 | 备注 |

|---|---|---|---|---|

| 感知器 | 单层 | 误差反馈学习 | 阈值函数不可导,构造学习规则 | 与感知器准则等价 |

| 线性神经元 | 单层 | 梯度下降法训练参数 | 线性函数,多层仍是线性变换 | 本质上是最小二乘准则 |

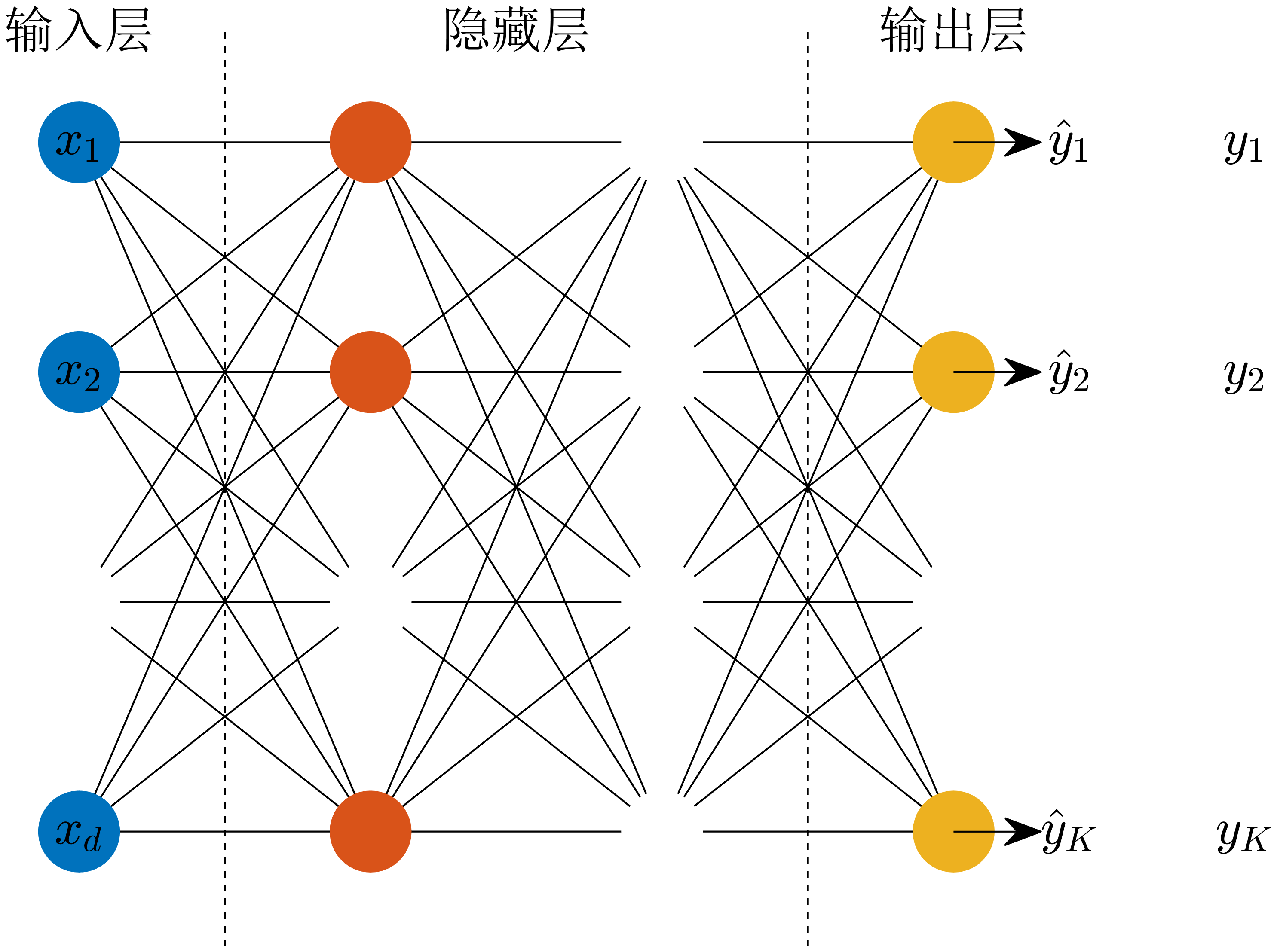

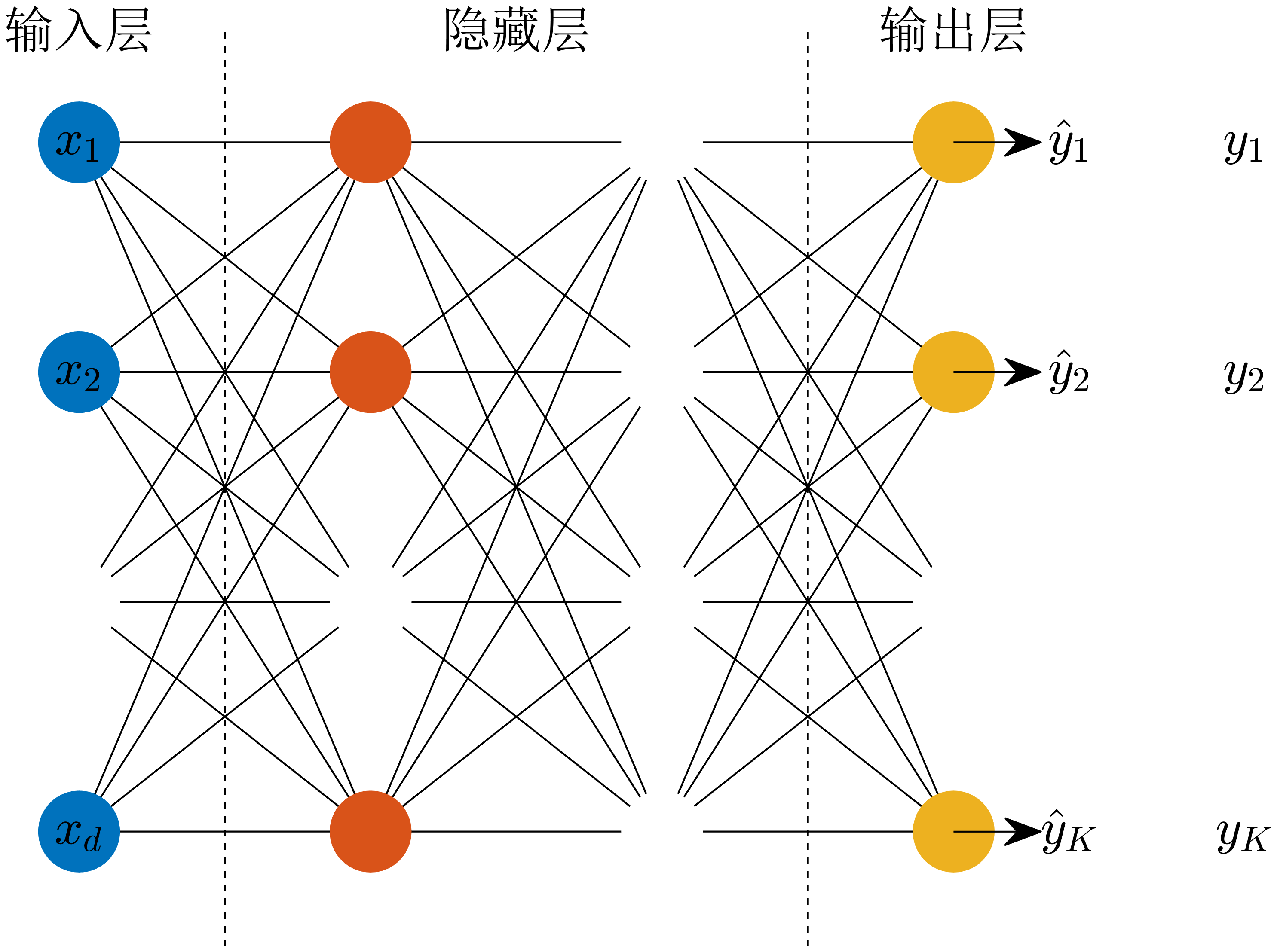

| 浅层神经网络(早期) | 多层 | Sigmoid、非线性、BP算法 | 一般单个隐含层、多层梯度消失 | 多元复合函数求导的链式法则 |

| 深层神经网络(现代) | 多层 | ReLU、学习算法、参数初始化 | —— | —— |

| 神经网络类型 | 层 | 创新 | 问题 | 备注 |

|---|---|---|---|---|

| 感知器 | 单层 | 误差反馈学习 | 阈值函数不可导,构造学习规则 | 与感知器准则等价 |

| 线性神经元 | 单层 | 梯度下降法训练参数 | 线性函数,多层仍是线性变换 | 本质上是最小二乘准则 |

| 浅层神经网络(早期) | 多层 | Sigmoid、非线性、BP算法 | 一般单个隐含层、多层梯度消失 | 多元复合函数求导的链式法则 |

| 深层神经网络(现代) | 多层 | ReLU、学习算法、参数初始化 | —— | —— |