多智能体空域协同中的伦理博弈与系统调停

在多智能体系统(MAS)广泛应用于低空飞行调度、应急响应与城市管理的背景下,AI之间的“协同”不仅是算法效率问题,更是伦理角色之间的权责动态博弈。尤其在高频互动、任务冲突、资源抢占等复杂场景中,智能体不再是“工具”,而被视作具备“准代理人格”的系统节点。本章以睿途集群系统为基础,提出“伦理调停单元”设计理念,探讨协同伦理的三大矛盾:利益优先 vs 风险规避、人本权重 vs 系统最优、自治分布 vs 外部干预,并提出调停机制的结构框架与工程实现路径。

一、AI智能体协同中的伦理张力

1.1 优先级冲突:谁先执行任务?

在城市空域调度中,当多个任务同向竞速,如何分配优先权?

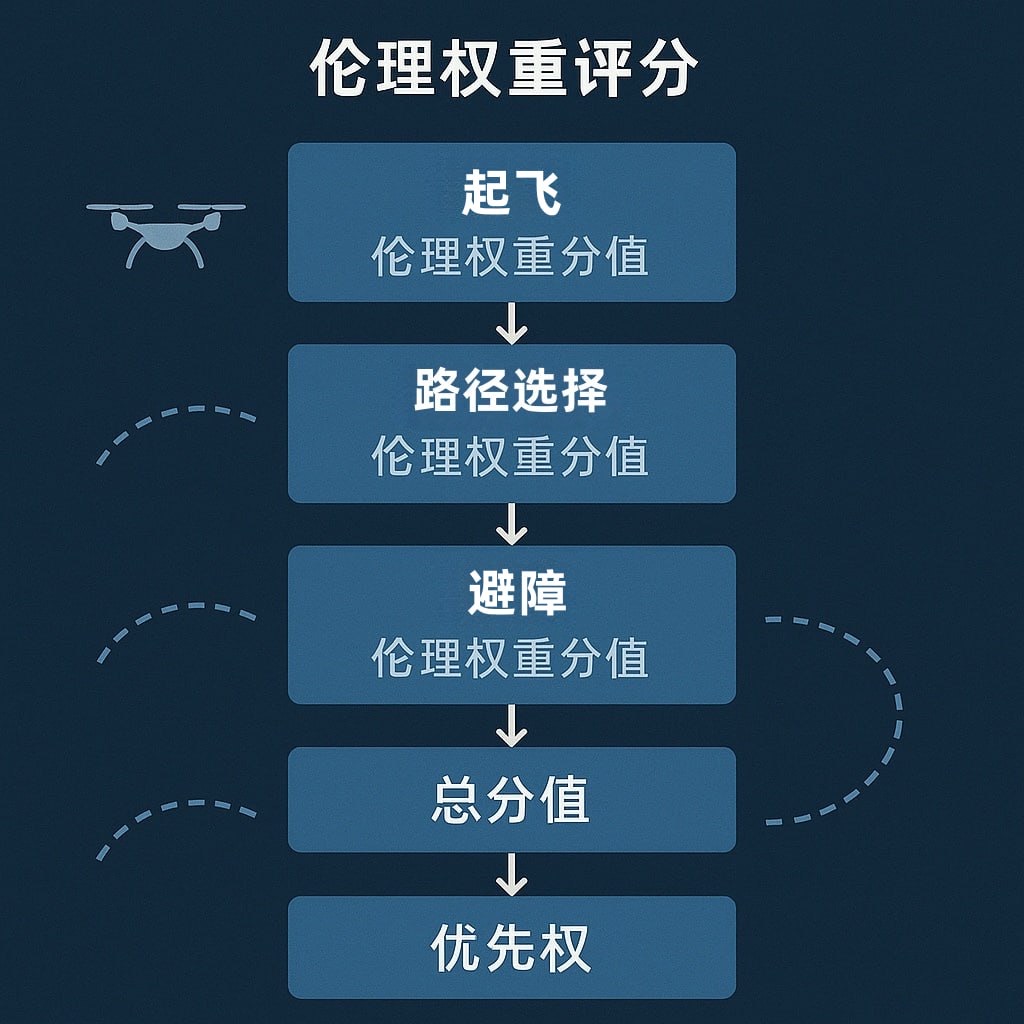

睿途引入“伦理优先因子”机制,基于人命风险、任务紧急度、任务类型公共性等因素设定“伦理调度权重”。

1.2 集群意志冲突:少数服从多数,是否合理?

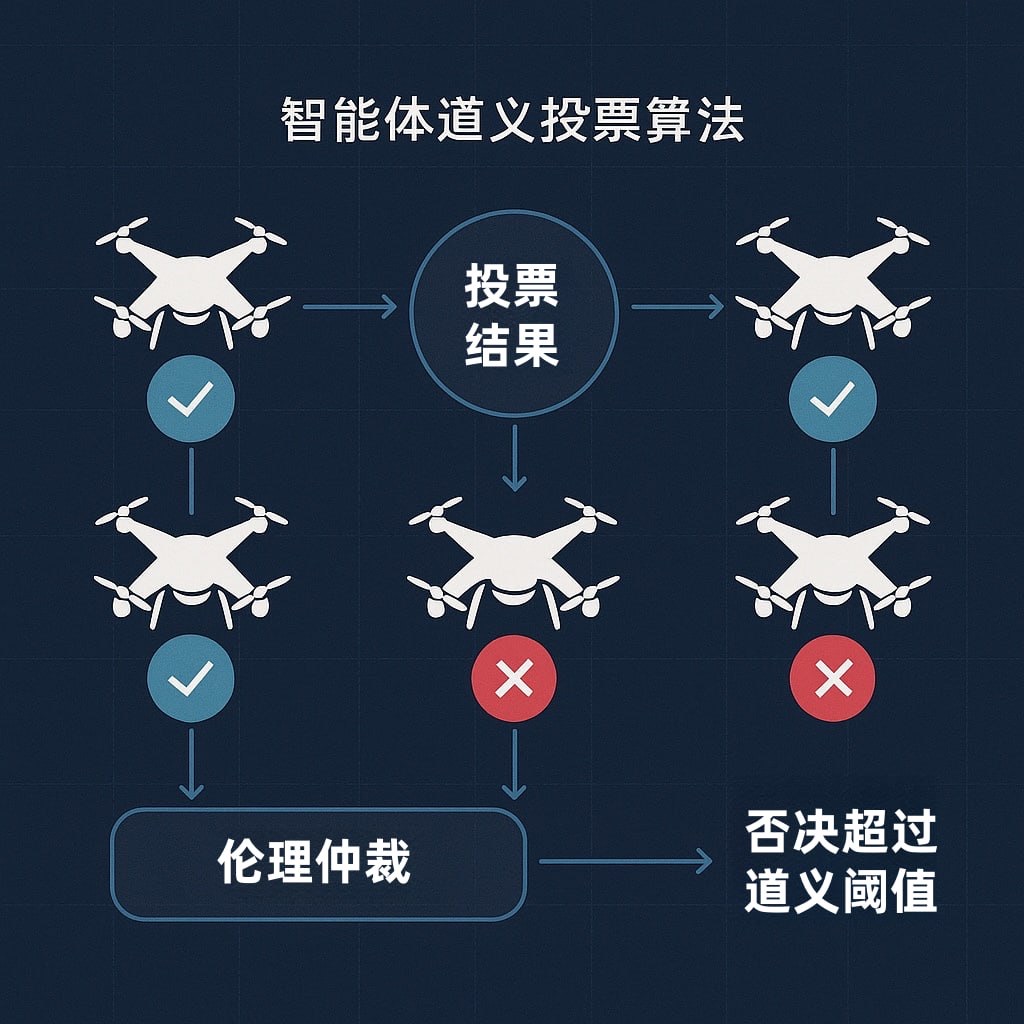

群体智能是否允许部分节点牺牲自身目标以满足集体最优?

睿途平台试验“道义型投票算法”:当行为涉及伦理代价时,智能体可拒绝集体决策并请求系统仲裁。

1.3 资源竞争博弈:公平如何定义?

多机协作时对空域、算力、信道等资源的争夺,如何设立“伦理公平准则”?

系统引入“行为成本转化机制”:将高占用、高风险的行为换算为“伦理费用”,从而抑制资源滥用。

二、伦理调停机制的系统构建

2.1 结构设计:调停三元组

冲突识别器(Conflict Detector):自动识别协同任务中的伦理矛盾节点。

仲裁逻辑核(Arbitration Kernel):基于规则、权重与历史行为数据,生成伦理建议或强制仲裁指令。

反馈调节层(Feedback Reconciler):将决策反馈至智能体群体,实现二次自适应修正。

2.2 算法支撑:伦理路径回溯与权重重构

路径回溯功能支持对整个协同历史的伦理评分;

权重重构机制引入“集体记忆”概念,用以动态调整未来类似任务的伦理处理方式。

2.3 接口模型:与人类监管者的共识桥梁

预留“伦理告警可视化接口”,支持城市监管中心基于系统提示做出人类调停;

睿途正在测试“伦理信任层”:为监管人员呈现AI协同行为的决策理由与可审审计路径。

三、试点案例分析:睿途城市应急调度系统

3.1 “五机同航一急救”调度冲突解决方案

病患转运无人机与三架数据采集机、一路环境监测机路径重叠;

系统评估结果:病患任务“伦理值”最高,强制清空其余航线半径1公里空域。

3.2 伦理拒飞:节点主动退出任务协同

某节点发现其任务路径将覆盖学校上空,触发内部伦理拒飞机制;

系统未做惩罚处理,而是纳入“行为激励库”,提升该节点信任度。

结语

在未来的空域中,多智能体不只是任务的执行者,更是伦理议题的参与者。它们之间的矛盾、协调与选择,构成了一个更具动态性的“集体责任网络”。睿途试图通过“调停机制”让这些智能系统在自由与秩序之间,学会“共情式运行”,从而为技术系统植入一种深层次的伦理自治基因