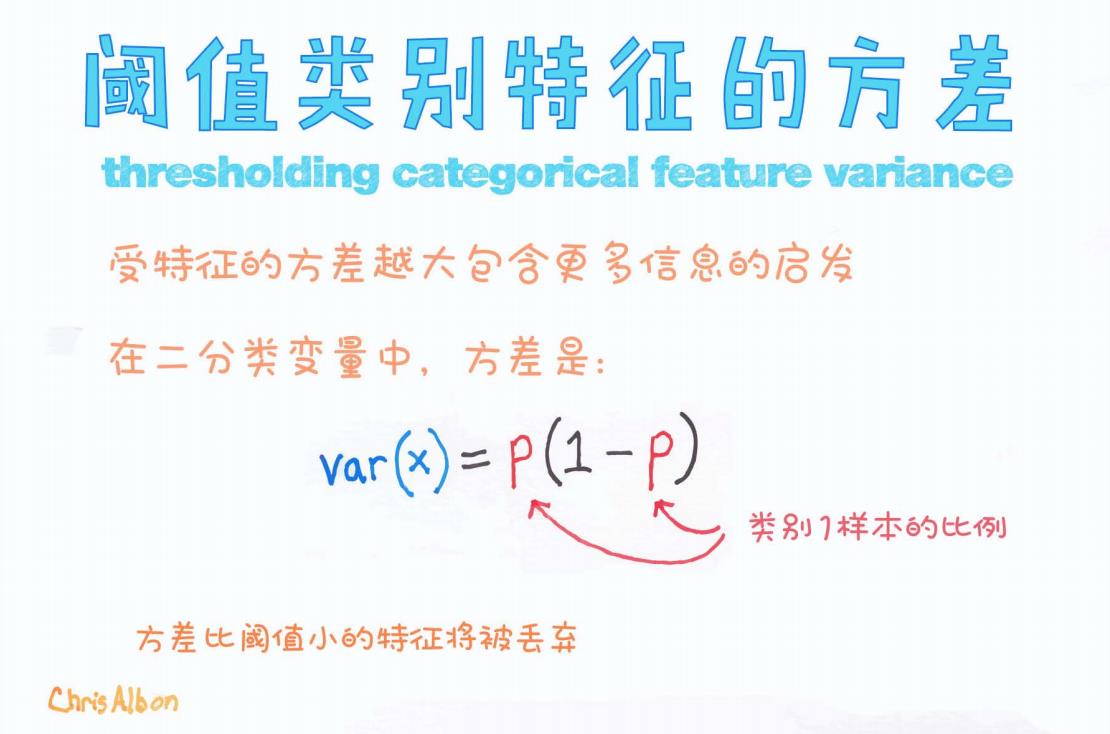

【漫话机器学习系列】234.阈值类特征的方差分析(Thresholding Categorical Feature Variance)

用“方差”筛选分类特征:阈值类特征的方差分析

在特征工程的世界里,有效地筛选特征对提升模型性能至关重要。特别是处理类别特征(categorical features)时,如何判断某个特征是否含有足够的信息?今天我们介绍一个非常直观又有效的方法:通过计算类别特征的方差(variance)进行筛选。

本文以二分类变量为例,讲解如何使用方差来评估类别特征的重要性,并通过一个简单公式展示其计算方式。

一句话总结核心思想

“类别特征的方差越大,说明其携带的信息越丰富。”

这与我们在统计学中的认知是一致的:方差越大,代表数据分布越分散、不集中,信息熵更高;相反,如果某个变量几乎都集中在一个取值上,它几乎对模型没有什么帮助。

分类变量的方差公式

对于一个二分类变量(比如是否购买、是否点击等),我们将类别取值(通常是 0 和 1)视为一个 Bernoulli 分布。在这种情况下,方差的公式非常简单直观:

其中:

-

p:是类别为 1 的样本在特征中的比例(也称为“正例比例”)。

-

1 - p:自然是类别为 0 的比例。

-

x:代表某个类别特征。

说明:

-

当 p = 0 或 p = 1 时,方差为 0,说明这个特征几乎无变化(即所有样本都属于一个类别),对模型贡献极小。

-

当 p = 0.5 时,方差最大,为 0.25,说明这个特征在样本中最分散,包含的信息最多。

为什么使用方差作为筛选标准?

当我们处理成百上千个类别特征时,有些特征可能极为稀疏或者在大多数样本中都只有一个值(例如:某电商平台上极少用户用某个罕见支付方式)。这些低方差特征通常对模型没什么帮助,反而会增加噪声、延长训练时间。

通过设定一个方差阈值(threshold),我们可以剔除这些“无用特征”。

示例阈值筛选规则:

if var(x) < 0.01:特征 x 将被丢弃

这种方式称为“方差筛选法(variance thresholding)”。

实战应用场景

-

文本分类中的词袋模型(Bag-of-Words):很多词在整个语料库中出现频率极低,或几乎只出现于一个标签中,这种时候就可以通过方差筛选去掉无信息词。

-

特征选择预处理:在进行模型训练前先进行一次低方差特征筛除,可减少过拟合风险。

-

对类别特征进行 One-Hot 编码后,每个编码列可视为一个二分类变量,适用于方差分析。

小结

我们可以用一个流程图来总结方差筛选的步骤:

-

对类别特征进行 One-Hot 编码

-

对每一个二值特征计算其方差

-

设定方差阈值(例如 0.01)

-

丢弃方差小于阈值的特征

补充说明

-

方差筛选法是一种无监督特征选择方法,不考虑目标变量(标签);

-

它适合作为初步特征选择步骤,后续可以结合 Lasso、树模型等进行更复杂的特征筛选;

-

对于多分类变量,可以先进行独热编码(One-Hot),再对每列使用上述方差公式。

寄语

方差筛选虽然简单,却是提高模型泛化能力和训练效率的一大利器。尤其在初步数据探索阶段,帮助你快速砍掉一批“无用”变量。

如图所示(来源:Chris Albon),理解这个公式的几何含义和实际意义,是我们在特征工程中迈出的重要一步。

你是否在实际项目中用过类似方法?欢迎评论区一起交流~😊