RTDETR融合[CVPR2025]DnLUT中的MuLUTUnit模块

RT-DETR使用教程: RT-DETR使用教程

RT-DETR改进汇总贴:RT-DETR更新汇总贴

《DnLUT: Ultra-Efficient Color Image Denoising via Channel-Aware Lookup Tables》

一、 模块介绍

论文链接:https://arxiv.org/pdf/2503.15931

代码链接:https://github.com/Stephen0808/DnLUT/

论文速览:

虽然深度神经网络彻底改变了图像降噪功能,但由于大量的计算和内存要求,它们在边缘设备上的部署仍然具有挑战性。为此,我们提出了 DnLUT,这是一种基于查找表的超高效框架,能够以最少的资源消耗实现高质量的彩色图像去噪。我们的关键创新在于两个互补的组件:有效并行捕获通道间相关性和空间依赖性的成对通道混频器 (PCM),以及新颖的 L 形卷积设计,可最大限度地提高感受野覆盖率,同时最大限度地减少存储开销。通过在训练后将这些组件转换为优化的查找表,DnLUT 实现了卓越的效率 - 与 CNN 竞争对手 DnCNN 相比,只需要 500KB 的存储空间和 0.1% 的能耗,同时推理速度提高了 20×。大量实验表明,DnLUT 在 PSNR 方面比所有现有的基于 LUT 的方法高出 1dB 以上。

总结:本文更新DnLUT中的LUT模块。

⭐⭐本文二创模块仅更新于付费群中,往期免费教程可看下方链接⭐⭐

RT-DETR更新汇总贴(含免费教程)文章浏览阅读264次。RT-DETR使用教程:缝合教程: RT-DETR中的yaml文件详解:labelimg使用教程:_rt-deterhttps://xy2668825911.blog.csdn.net/article/details/143696113

二、二创融合模块

2.1 相关二创模块及所需参数

该模块可如图加入到HGBlock、RepNCSPELAN4、RepC3与自研等模块中,代码见群文件,所需参数如下。

HGBlock-变式模块 所需参数:(c1, cm, c2, k, n, lightconv, shortcut, act)

RepNCSPELAN4-变式模块 所需参数:(c1, c2, c3, c4, n)

RepC3-变式模块 所需参数:(c1, c2, n, e)

CCRI及变式模块 所需参数:(c1, c2, k, n, lightconv, shortcut, scale, e, act)

RepC4及变式模块 所需参数:(c1, c2, n, e)

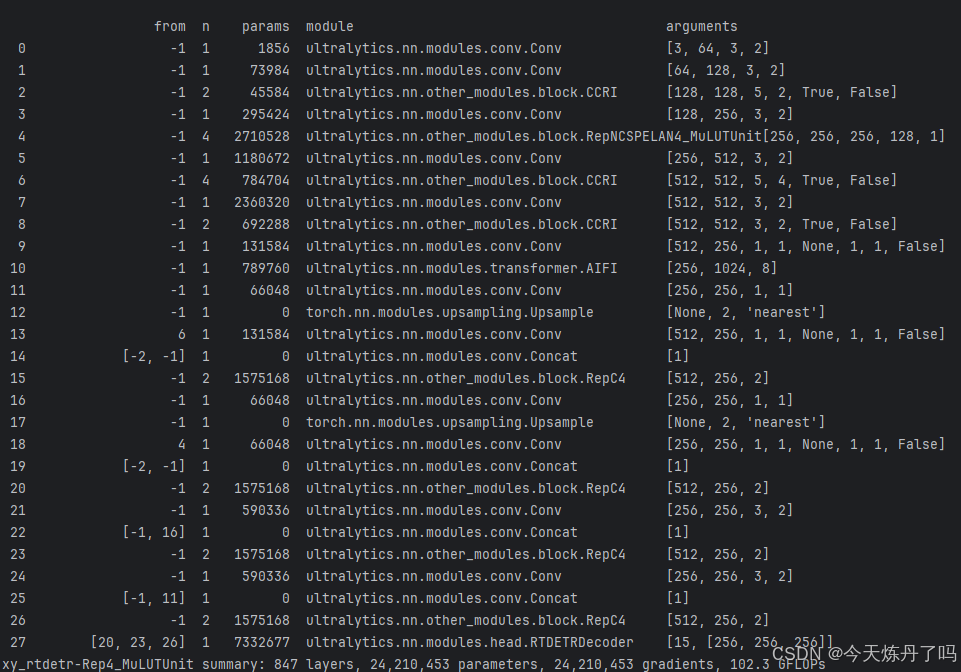

2.2 更改yaml文件 (以自研模型加入为例)

yam文件解读:YOLO系列 “.yaml“文件解读_yolo yaml文件-CSDN博客

打开更改ultralytics/cfg/models/rt-detr路径下的rtdetr-l.yaml文件,替换原有模块。

# Ultralytics YOLO 🚀, AGPL-3.0 license

# RT-DETR-l object detection model with P3-P5 outputs. For details see https://docs.ultralytics.com/models/rtdetr

# ⭐⭐Powered by https://blog.csdn.net/StopAndGoyyy, 技术指导QQ:2668825911⭐⭐

# Parameters

nc: 80 # number of classes

scales: # model compound scaling constants, i.e. 'model=yolov8n-cls.yaml' will call yolov8-cls.yaml with scale 'n'

# [depth, width, max_channels]

l: [1.00, 1.00, 512]

# n: [ 0.33, 0.25, 1024 ]

# s: [ 0.33, 0.50, 1024 ]

# m: [ 0.67, 0.75, 768 ]

# l: [ 1.00, 1.00, 512 ]

# x: [ 1.00, 1.25, 512 ]

# ⭐⭐Powered by https://blog.csdn.net/StopAndGoyyy, 技术指导QQ:2668825911⭐⭐

backbone:

# [from, repeats, module, args]

- [-1, 1, Conv, [64, 3, 2]] # 0-P1/2

- [-1, 1, Conv, [128, 3, 2]] # 1-P2/4

- [-1, 2, CCRI, [128, 5, True, False]]

- [-1, 1, Conv, [256, 3, 2]] # 3-P3/8

- [-1, 4, RepNCSPELAN4_MuLUTUnit, [256, 256, 128, 1]]

- [-1, 1, Conv, [512, 3, 2]] # 5-P4/16

- [-1, 4, CCRI, [512, 5, True, False]]

- [-1, 1, Conv, [1024, 3, 2]] # 7-P5/32

- [-1, 2, CCRI, [1024, 3, True, False]]

head:

- [-1, 1, Conv, [256, 1, 1, None, 1, 1, False]] # 9 input_proj.2

- [-1, 1, AIFI, [1024, 8]]

- [-1, 1, Conv, [256, 1, 1]] # 11, Y5, lateral_convs.0

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [6, 1, Conv, [256, 1, 1, None, 1, 1, False]] # 13 input_proj.1

- [[-2, -1], 1, Concat, [1]]

- [-1, 2, RepC4, [256]] # 15, fpn_blocks.0

- [-1, 1, Conv, [256, 1, 1]] # 16, Y4, lateral_convs.1

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [4, 1, Conv, [256, 1, 1, None, 1, 1, False]] # 18 input_proj.0

- [[-2, -1], 1, Concat, [1]] # cat backbone P4

- [-1, 2, RepC4, [256]] # X3 (20), fpn_blocks.1

- [-1, 1, Conv, [256, 3, 2]] # 22, downsample_convs.0

- [[-1, 16], 1, Concat, [1]] # cat Y4

- [-1, 2, RepC4, [256]] # F4 (23), pan_blocks.0

- [-1, 1, Conv, [256, 3, 2]] # 24, downsample_convs.1

- [[-1, 11], 1, Concat, [1]] # cat Y5

- [-1, 2, RepC4, [256]] # F5 (26), pan_blocks.1

- [[20, 23, 26], 1, RTDETRDecoder, [nc]] # Detect(P3, P4, P5)

# ⭐⭐Powered by https://blog.csdn.net/StopAndGoyyy, 技术指导QQ:2668825911⭐⭐

2.2 修改train.py文件

创建Train_RT脚本用于训练。

from ultralytics.models import RTDETR

import os

os.environ['KMP_DUPLICATE_LIB_OK'] = 'True'

if __name__ == '__main__':

model = RTDETR(model='ultralytics/cfg/models/rt-detr/rtdetr-l.yaml')

# model.load('yolov8n.pt')

model.train(data='./data.yaml', epochs=2, batch=1, device='0', imgsz=640, workers=2, cache=False,

amp=True, mosaic=False, project='runs/train', name='exp')

在train.py脚本中填入修改好的yaml路径,运行即可训。