CUDA与cuDNN 的介绍

GPU 与 CUDA

CPU是什么大家都知道,简单的比喻CPU相当于人的大脑可以用来运算, 比如 1+1 =2。其实在电脑里还有一个部件可以用来运算,就是GPU。

GPU, 全写是Graphics Processing Unit, 图形处理器,俗称显卡,其主要用来运算屏幕上点的显示, 但其也可以用来进行其他的数学运算。

特别是在区块链中的哈希运算以及人工智能中的运算, GPU表现出比CPU更好的性能,于是电脑发展逐步从CPU中央处理发展到CPU与GPU协同处理。

于是乎, 显卡的知名厂商之一 NVIDA(英伟达)发明了CUDA编程模型。

CUDA 是什么

1. 定义

CUDA(Compute Unified Device Architecture)是NVIDIA推出的并行计算平台和编程模型,允许开发者利用GPU的强大计算能力进行通用计算。

2. 核心概念

- 线程(Thread):CUDA程序的基本执行单元。

- 线程块(Block):一组线程,共享内存并同步执行。

- 网格(Grid):多个线程块的集合。

- 内核(Kernel):在GPU上执行的函数。

- 流处理器(Streaming Multiprocessor, SM):GPU的核心计算单元。

3. 编程模型

- 主机(Host):CPU及其内存。

- 设备(Device):GPU及其内存。

- 内存管理:包括主机与设备之间的数据传输和设备内存的分配与释放。

4. 优势

- 高性能:适用于大规模并行计算。

- 灵活性:支持C/C++扩展,易于集成。

- 广泛应用:涵盖科学计算、机器学习、图形处理等领域。

5. 应用场景

- 深度学习:加速神经网络训练与推理。

- 科学计算:如流体动力学、分子动力学模拟。

- 图形渲染:实时渲染与物理模拟。

cuDNN 又是什么

1. 定义

cuDNN(CUDA Deep Neural Network library)是NVIDIA专为深度学习优化的GPU加速库,提供高效实现常见深度学习操作的接口。

2. 核心功能

- 卷积:支持多种卷积操作。

- 池化:包括最大池化和平均池化。

- 激活函数:如ReLU、tanh、sigmoid。

- 归一化:如批量归一化。

- Softmax:用于分类任务。

3. 优势

- 高性能:针对NVIDIA GPU优化。

- 易用性:提供简单API,易于集成。

- 兼容性:支持主流深度学习框架。

4. 应用场景

- 卷积神经网络(CNN):如图像分类、目标检测。

- 循环神经网络(RNN):如自然语言处理、时间序列预测。

- 生成对抗网络(GAN):如图像生成、风格迁移。

5. 与CUDA的关系

cuDNN基于CUDA构建,依赖CUDA提供的基础计算能力,专注于深度学习操作的高效实现。

CUDA VS cuDNN

- CUDA 是通用并行计算平台,适用于多种高性能计算任务。

- cuDNN 是深度学习专用库,基于CUDA,提供高效深度学习操作实现。

两者结合,显著提升了深度学习模型的训练和推理效率。

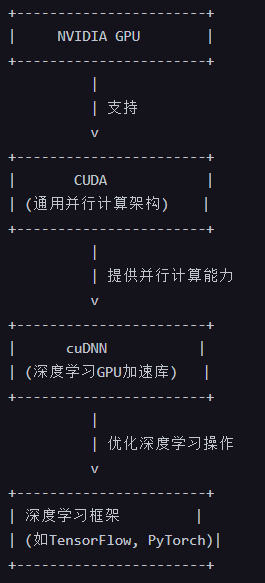

整体的关系如下图:

下载地址

- CUDA 下载地址

https://developer.nvidia.com/cuda-10.0-download-archive?target_os=Windows&target_arch=x86_64&target_version=10&target_type=exelocal - cuDNN 下载地址

https://developer.nvidia.com/rdp/cudnn-archive