【大模型知识点】RMSNorm(Root Mean Square Normalization)均方根归一化

介绍: RMSNorm(Root Mean Square Layer Normalization)是一种归一化技术,主要用于深度学习中的神经网络模型,它是 LayerNorm(LN,层归一化)的一种变体。

应用: LLaMA系列的LLaMA 1和LLaMA 2均采用RMSNorm作为默认归一化方法,显著提升了训练效率和模型性能。DeepSeek V3等开源模型也广泛采用RMSNorm,进一步验证了其有效性。

背景: 参考【AI知识】归一化、批量归一化 、 层归一化 和 实例归一化

LayerNorm(LN)是深度学习中广泛应用的归一化方法,能够稳定训练并加速收敛。然而,LN 计算均值和方差,并对整个特征维度进行归一化,这带来了两个问题:

- 计算开销较大:LN 需要计算均值和方差,在训练时额外增加计算成本。

- 均值归一化可能不是必须的:研究发现,仅仅对方差进行归一化(即均方归一化)仍然可以保持模型稳定性,并且可以减少计算量。

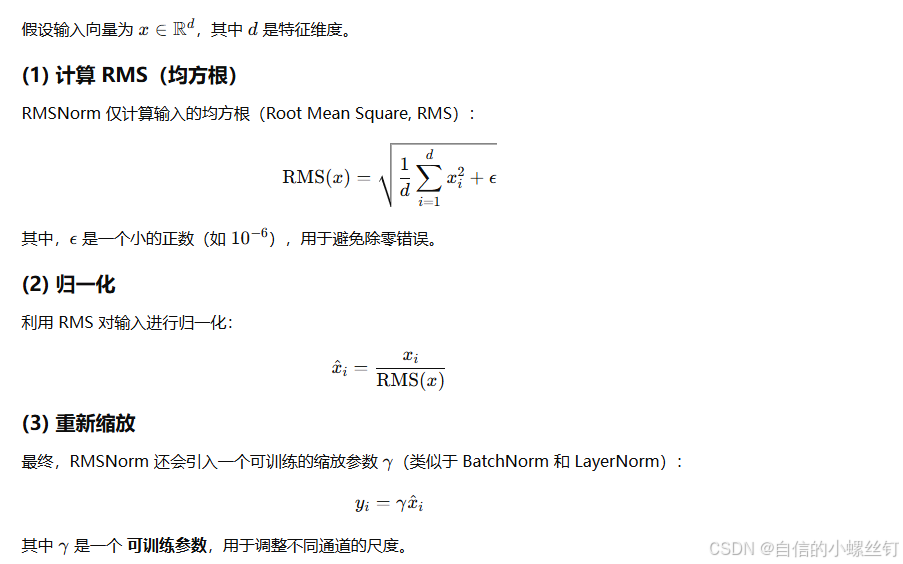

RMSNorm原理:

优点:

✅计算高效: 只计算均方根(RMS),提高了计算效率,在大规模模型中,RMSNorm 可以减少计算开销。

✅ 效果稳定: 在一些应用中,LayerNorm 会因为均值的计算不稳定(例如,存在大的偏差或噪声)导致训练不稳定。RMSNorm不用减去均值,减少了数值波动,使得它对输入数据的极端分布(如极端大或极端小的值)或梯度爆炸的敏感度较低,这种特性在超大规模模型的训练中尤为重要,因为深层网络容易积累数值波动,而RMSNorm能够有效缓解这一问题