【AI学习-comfyUI学习-图生图反推关键词工作流-各个部分学习-第五节】

【AI学习-comfyUI学习-图生图反推关键词工作流-各个部分学习-第五节】

- 1,前言

- 2,说明

-

- 1,流程说明

- 2,想要什么

- 3,流程

-

-

- (1)调用模块

-

- 1)整个模块部分

- 2)整个模块部分

- (2)输出 提示词

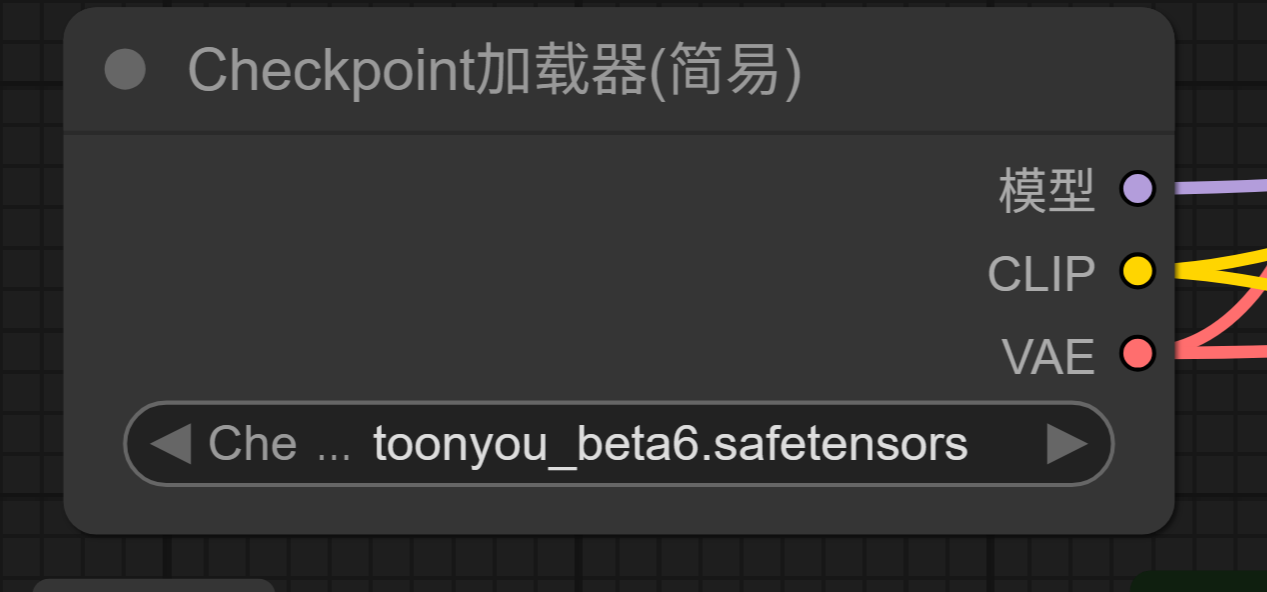

- (3)模型加载

- (4)生成图片

-

- 4,模块介绍

-

- 🎯 一、K采样器(KSampler)是什么?

- 🧠 二、采样器的选择影响风格

- ⚙️ 三、CFG(提示词引导强度)的作用

- 🧩 四、步数(Steps)

- 🖋 五、参数组合推荐(针对漫画风)

- 🧩 六、与提示词/模型的关系

- 5,细节部分

-

- (1)clip input is invalid: None

- 🧩 一、问题原因(通俗解释)

- ⚙️ 二、解决方法(两种方案)

-

- ✅ 方案一:为 Flux 模型添加独立 CLIP 模型节点

-

- 步骤:

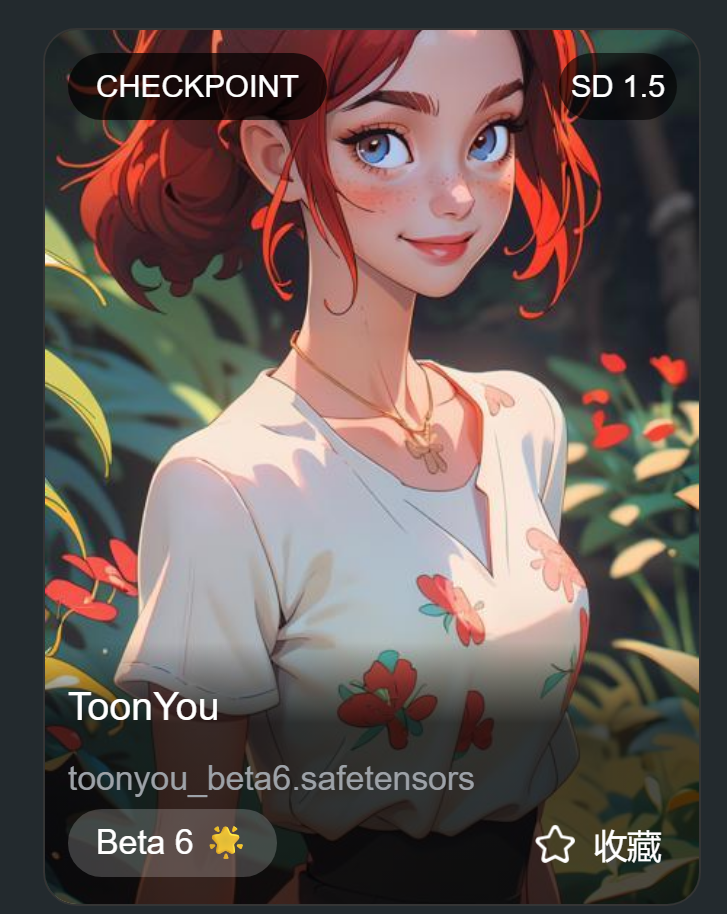

- ✅ 方案二:换成自带CLIP的Checkpoint模型

- (2)单独的图反推文字模块

-

- (1)单独的图反推文字模块部分

- (2)推出来的描述词

- (3)使用AI生成图片

- (4)WD14 反推提示词 (WD14 Tagger)

- 6,使用的工作流

- 7,总结

1,前言

最近,学习comfyUI,这也是AI的一部分,想将相关学习到的东西尽可能记录下来。

2,说明

1,流程说明

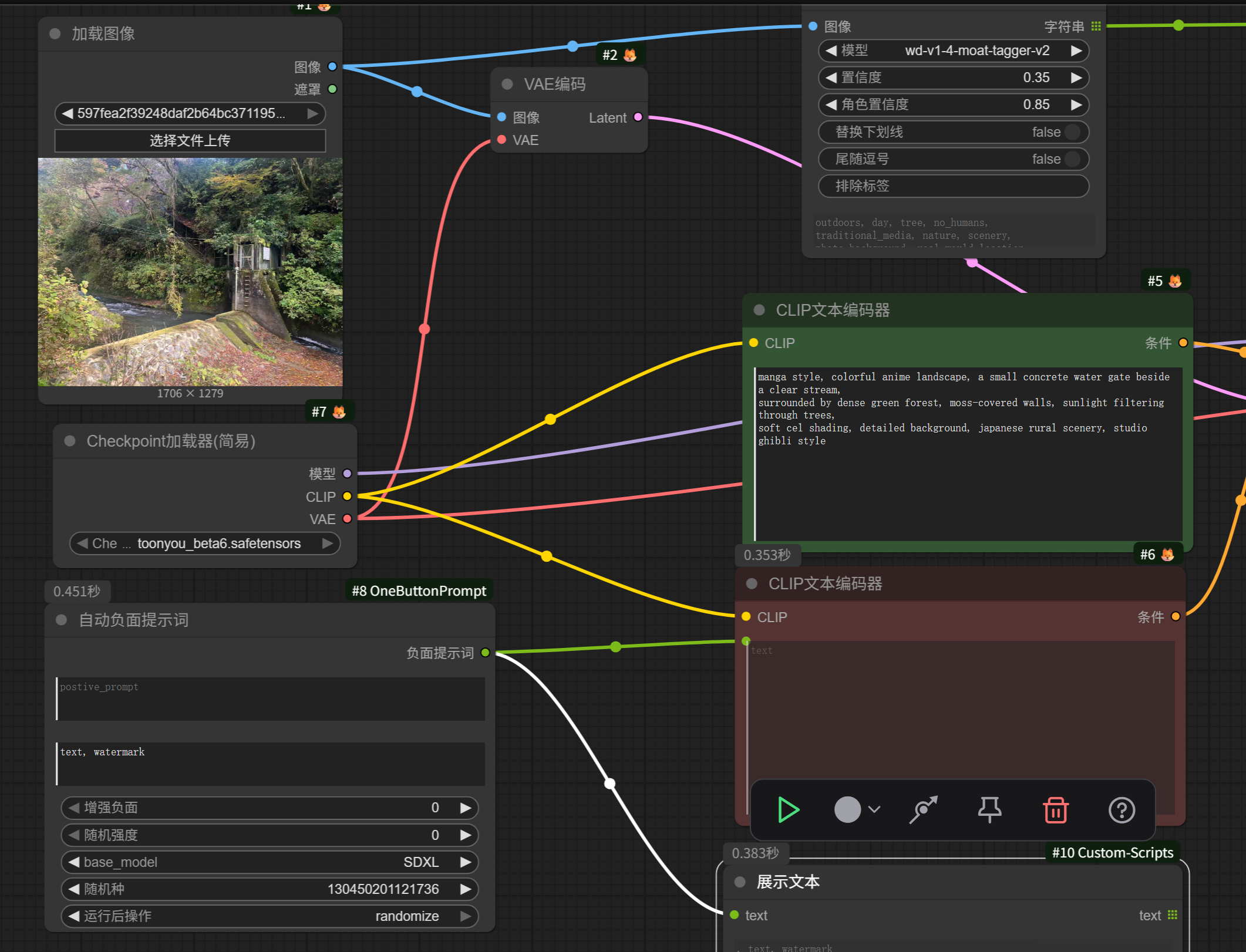

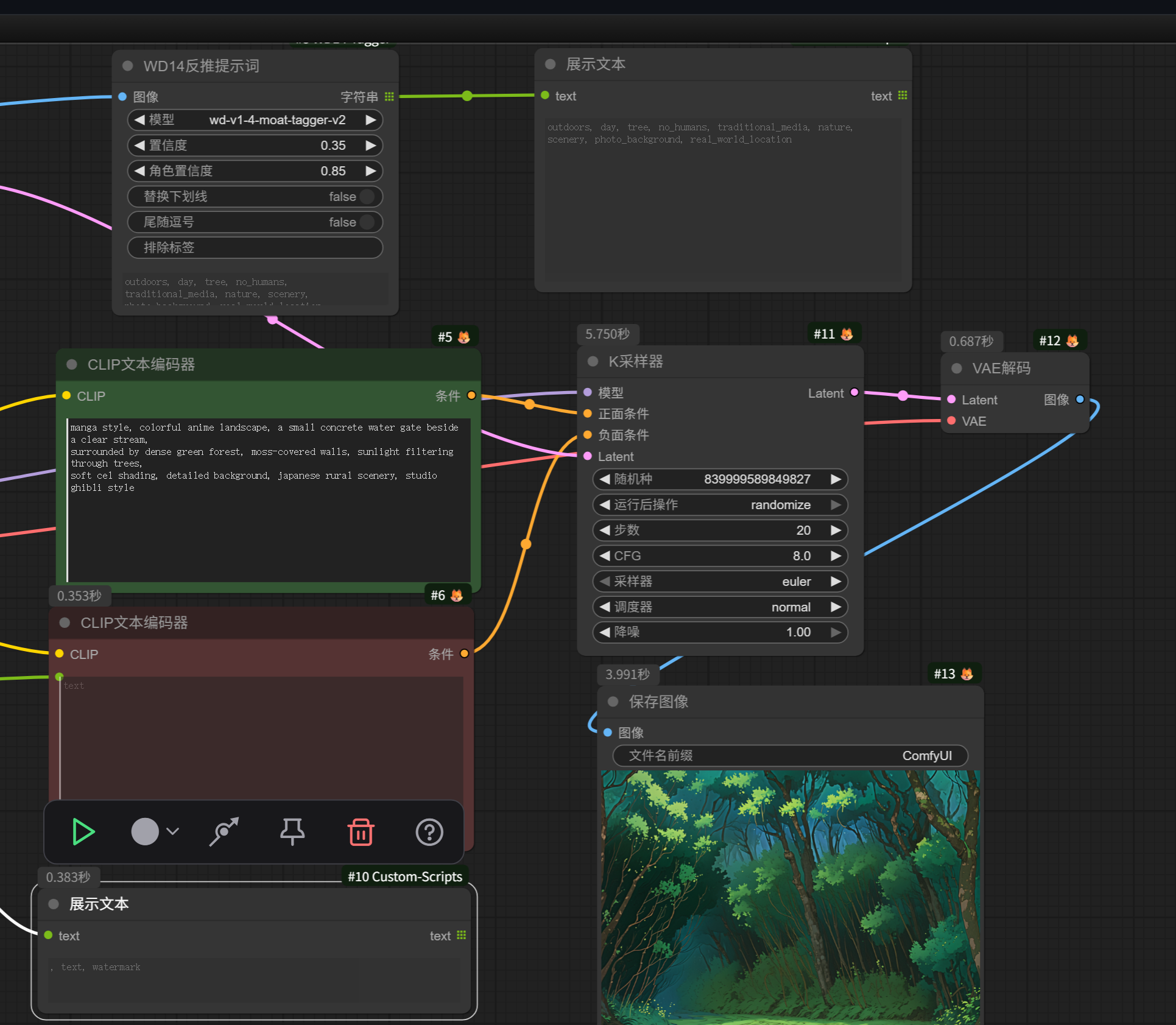

整个工作流分为 三大部分:输入 → 关键词反推 → 重生成输出。

加载原图 → VAE编码 → WD14反推关键词↓手动或自动编辑 prompt↓CLIP编码 → K采样生成↓VAE解码 → 保存图像

2,想要什么

在测试过程中有很多次其实,生成都是不是想要的图,所以多多测试。

3,流程

(1)调用模块

1)整个模块部分

这回整个模块都可以截截图下了

2)整个模块部分

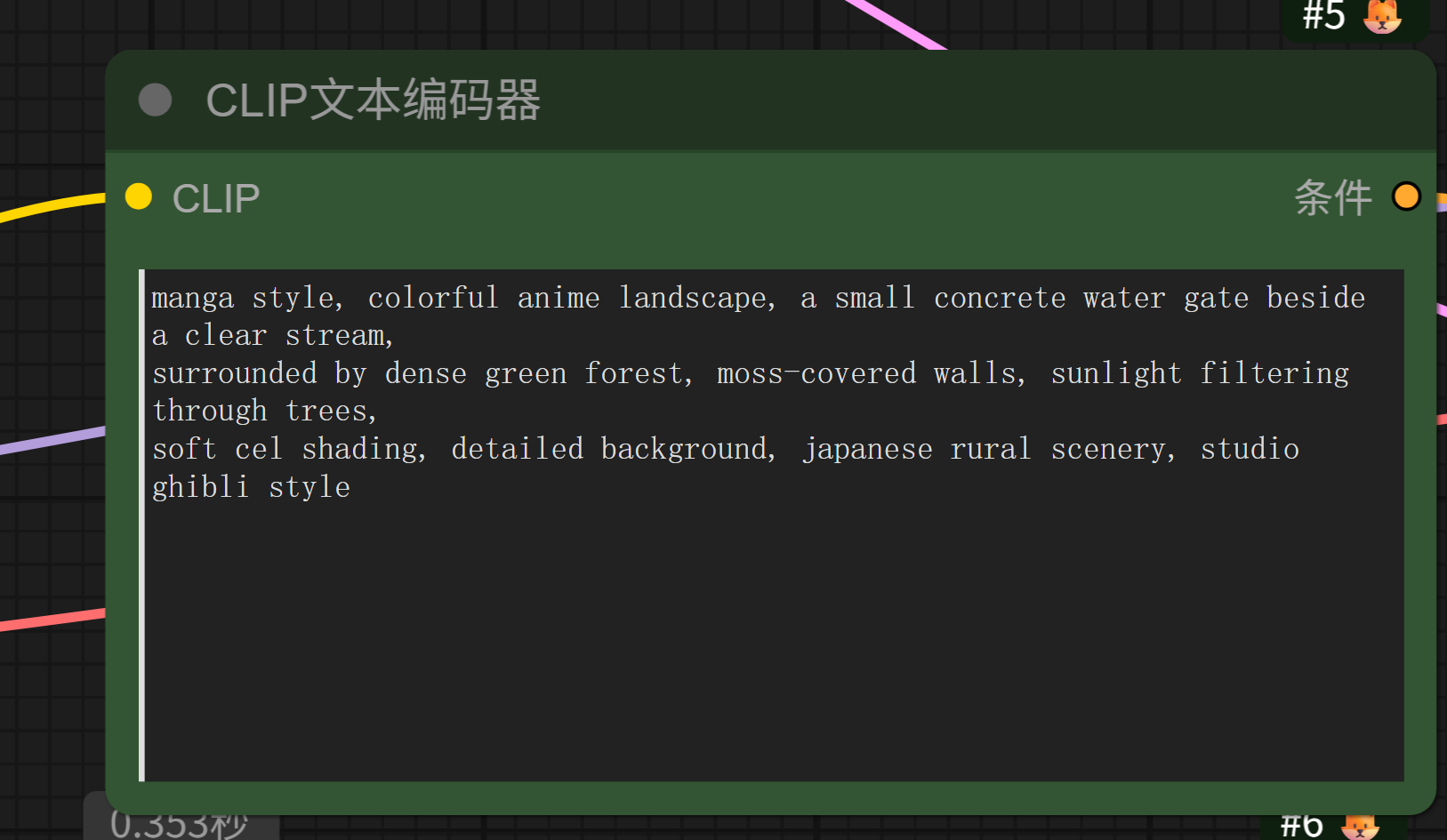

(2)输出 提示词

如下是输入提示词

manga style, colorful anime landscape, a small concrete water gate beside a clear stream,

surrounded by dense green forest, moss-covered walls, sunlight filtering through trees,

soft cel shading, detailed background, japanese rural scenery, studio ghibli style(3)模型加载

(4)生成图片

4,模块介绍

🎯 一、K采样器(KSampler)是什么?

KSampler 是 生成图像的核心节点,可以理解成「图像生成的引擎」,负责:

- 根据模型(UNet)、VAE、提示词(CLIP编码)共同计算“图像的逐步生成过程”;

- 通过不同算法(采样器)控制风格、细节、对比度、平滑度;

- CFG(Classifier-Free Guidance)系数控制“提示词的影响力”。

你现在的采样器参数如下:

采样方法:euler

步骤(Steps):20

CFG:8.0

调度器:normal

随机种子:839999589484827

这套参数偏向“写实或柔和”风格,不够强调漫画的线条与对比。

🧠 二、采样器的选择影响风格

| 采样方法 | 特性 | 适合的风格 |

|---|---|---|

| Euler |