如何使用一个模型完成多种交通任务?请看此文

本文介绍了一项关于城市交通领域的前沿研究成果《TransLLM: A Unified Multi-Task Foundation Framework for Urban Transportation via Learnable Prompting》。该论文发布于arXiv平台,合作单位包括中国科学技术大学、中国科学院计算机网络信息中心、科大讯飞等。城市交通系统往往面临处理多任务的需求,例如交通预测、电动汽车充电需求预测、出租车调度等典型任务。传统的方法往往针对特定的任务使用专门的数据训练专属模型,这一模式费时费力。如果使用现有通用大语言模型,则会出现对结构化时空数据处理能力弱及存在数值推理偏差等挑战。针对上述问题,该研究提出了一种创新型框架TransLLM。该框架融合了轻量级时空编码器与大语言模型,通过可学习提示组合实现二者无缝衔接,其中轻量级时空编码器借助扩张时间卷积和双邻接图注意力网络捕捉复杂时空依赖,基于强化学习的实例级提示路由机制能根据输入特征动态生成个性化提示,再结合多任务输出层避免离散文本生成导致的精度损失,大幅提升了交通相关任务的预测准确性与跨任务适应性,缓解了传统方法在多场景交通建模中泛化能力弱、任务适配性差的瓶颈。

推文作者为邱雪,审校为邓镝和韩煦。

论文下载链接:https://arxiv.org/abs/2508.14782

论文代码链接:https://github.com/BiYunying/TransLLM

一、研究内容与难点

1、研究内容

城市交通系统需应对交通流量预测、电动汽车充电需求预测、出租车调度等多类核心任务,现有技术方案却存在显著局限:一方面,传统小规模深度学习模型多为专属任务设计,且高度依赖大规模标注数据,在跨场景迁移时泛化能力薄弱;另一方面,通用大语言模型虽能通过自然语言接口整合外部信息,却难以有效处理结构化时空数据,在数值推理中易出现偏差或违反物理约束,无法满足交通领域精准建模需求。因此,迫切需要一种能融合时空建模能力与大语言模型优势、支持多交通任务的统一基础框架。

2、研究难点

(1)多任务时空输入异质性:交通多任务场景涉及交通流量、出行需求、地理邻接等多种结构化输入,这类数据难以用自然语言有效表征,给统一建模带来挑战。

(2)单任务内实例动态差异:即便在同一任务中,不同输入实例的时空动态特征也存在差异,例如不同区域、不同时段的交通数据规律不同,现有固定任务级提示策略无法适配这种实例级变化,难以处理样本差异带来的建模难题。

(3)多任务目标与输出多样性:同一交通模型需同时应对不同类型的任务,例如交通流量预测、充电需求预测、出租车调度等。不同任务的输出格式、评价指标差异大,且任务间可能存在干扰,对模型的泛化能力和稳定性构成严峻挑战。

(4)数据依赖与精度损失之间的平衡:小规模深度学习模型需大量标注数据支撑训练,在新城市或缺乏标注数据的场景下“水土不服”;通用大语言模型处理连续时空数值时,需先将其离散化为文本token,易造成精度损失,无法捕捉细粒度交通动态。

二、研究方法

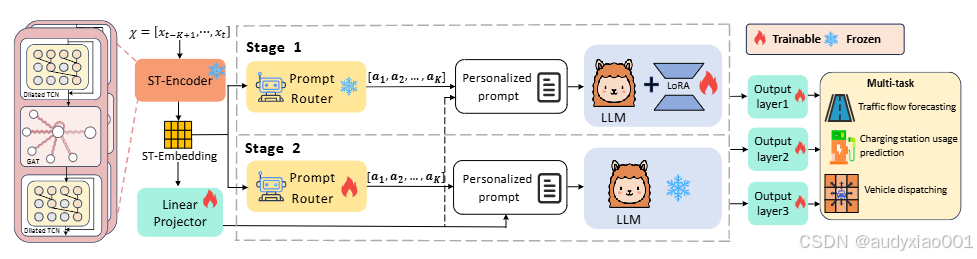

图1 TransLLM的整体架构

为解决城市交通多任务建模中时空数据处理难、模型泛化性弱、任务适配性差等挑战,研究提出了统一多任务基础框架TransLLM,该框架创新性地整合了轻量级时空编码器(ST-Encoder)、基于强化学习(RL)的提示个性化模块与多任务输出层,核心模块如下:

1.轻量级时空编码器(ST-Encoder)

如图1所示,时空编码器是由多个时空块堆叠构成,每个时空块采用“扩张时间卷积(TCN)+图注意力网络(GAT)”的结构,其中扩张TCN捕捉局部时序模式,GAT通过邻接矩阵学习空间关联,同时融入时段、星期等时间编码以捕捉周期性特征。此外,编码器引入两种邻接矩阵——基于物理道路连接或地理邻近性的空间邻接矩阵、基于动态时间规整构建的语义邻接矩阵,分别通过两组时空块生成时空表征,最终拼接为用于下游任务的完整表征,实现对空间相邻区域及具有相似时序行为的远距离区域信息的有效聚合。

2.基于强化学习的提示个性化模块

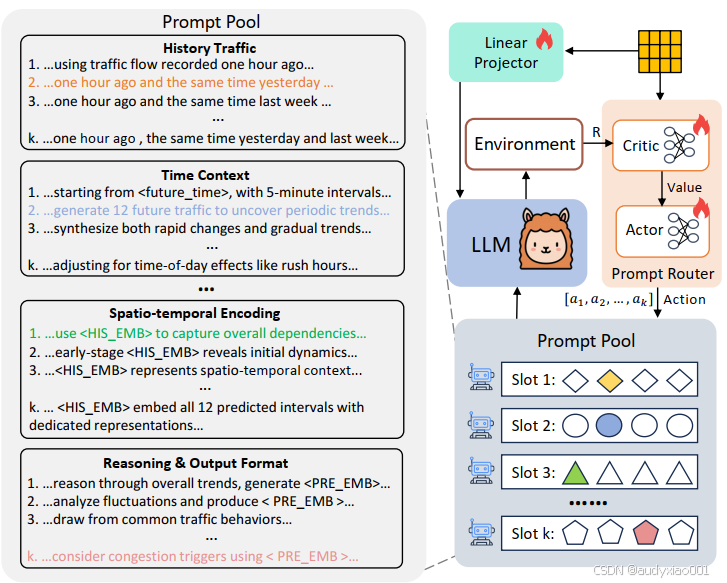

如图2所示,该模块包含提示路由机制与提示池,旨在为不同输入实例动态生成个性化提示:

(1)提示池将基础提示模板划分为历史时空信息、时间上下文、时空编码、推理与输出格式4个功能槽,每个槽内包含多个表述不同但意图相关的候选句子;

(2)提示路由机制基于Actor-Critic强化学习框架,以时空编码器的输出作为输入,Actor网络为每个槽生成候选句子的概率分布并采样动作(选择句子),Critic网络计算期望奖励以指导Actor训练,最终将各槽所选句子拼接为适配当前实例的个性化提示,突破固定任务级提示模板的局限性。

图2 实例级提示词生成

3.多任务输出层

为避免大语言模型(LLM)直接生成离散文本导致的精度损失,TransLLM针对不同任务设计专属输出层:

(1)对于交通流量预测、充电需求预测等时空预测任务,将LLM输出的隐藏状态与时空编码器的输出分别通过线性层处理后拼接,再经线性层生成最终连续数值预测结果;

(2)对于出租车调度优化任务,将LLM输出的隐藏状态通过线性层投影后,经过Softmax函数生成调度概率分布,表示从中心区域向周边区域调配空驶出租车的比例,确保输出与任务目标、评价指标精准匹配。

三、实验设计

1.数据集

采用7个真实数据集,覆盖三大任务:交通流量预测用LargeST-SD、PEMS08;充电需求预测用ST-EVCDP、UrbanEV;出租车调度用Taxi-SH;零样本评估用未训练的PEMS03、PEMS04。

2.模型配置

时空编码器含2个时空块,输出维度64;提示路由设4槽,每槽4候选句;学习率1×10⁻⁴,用LoRA微调LLM;复合损失权重λₜ=1.0,调度任务λ_w=0.01、λ_e=0.008,β=2.0、γ=0.05;基于Vicuna、LLaMA3构建TransLLM变体。

3.评估指标

预测任务用MAE、RMSE;调度任务用MMR、MDD、W-Dist。

四、结果与分析

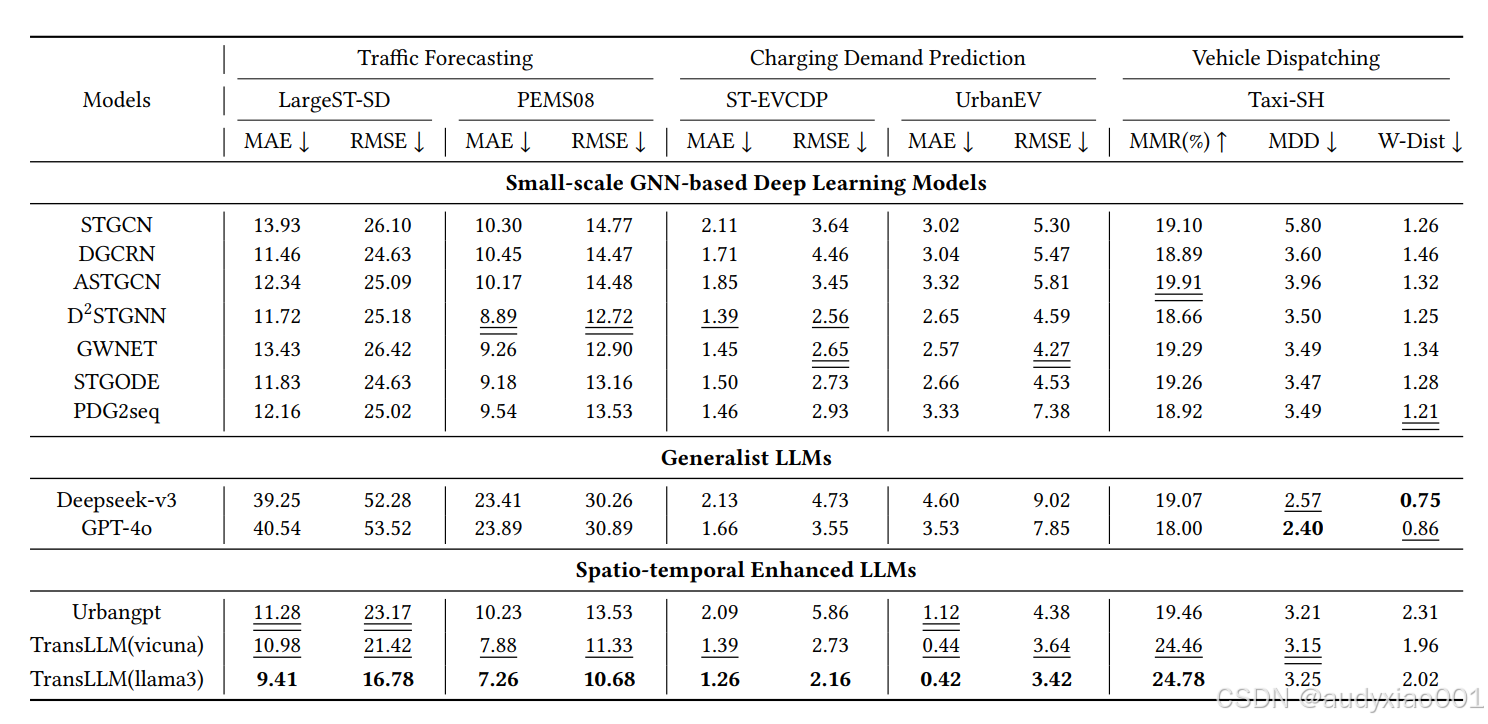

表1从交通流量预测、充电需求预测、车辆调度三大任务维度,对比了不同模型的性能表现。

1、在交通流量预测的LargeST-SD和PEMS08数据集上,小规模GNN类深度学习模型在MAE和RMSE指标上显著优于通用大语言模型;而时空增强型大语言模型TransLLM表现更优,其中TransLLM(llama3)在LargeST-SD数据集上MAE低至9.41、RMSE低至16.78,在PEMS08数据集上MAE低至7.26、RMSE低至10.68。

2、在充电需求预测的ST-EVCDP和UrbanEV数据集上,TransLLM系列模型同样领先,如TransLLM(llama3)在ST-EVCDP的MAE为1.26、RMSE为2.16,在UrbanEV的MAE为0.42、RMSE为3.42。

3、在车辆调度的Taxi-SH数据集上,TransLLM系列模型在MMR上表现突出,TransLLM(llama3)达24.78%,同时MDD和W-Dist指标也处于较优水平,整体展现出TransLLM在多交通任务中融合时空建模与大语言模型优势的良好性能。

表1 不同类型模型的性能对比。加粗:最佳,下划线:次佳,双下划线:第三佳

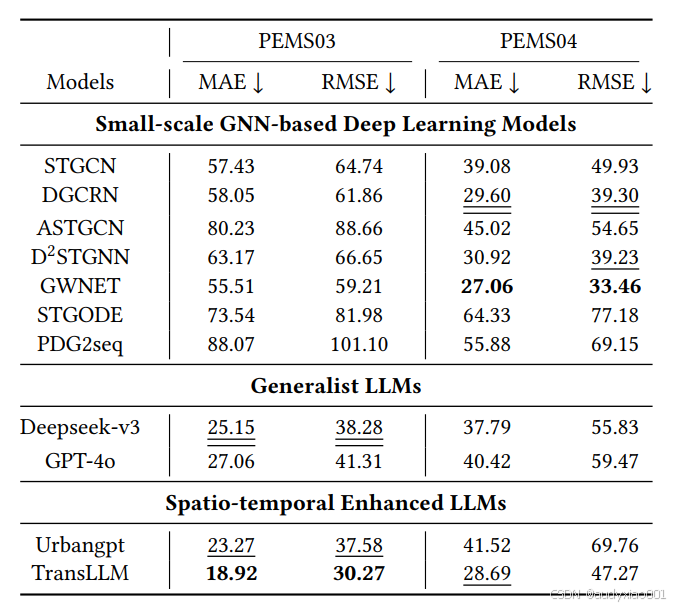

表2对比了不同类型模型在PEMS03和PEMS04数据集上的交通流量预测性能。(1)小规模GNN类深度学习模型中,GWNET在PEMS04的MAE和RMSE最优,DGCRN在PEMS04的MAE和RMSE分别位列第二、第三;

(2)通用大语言模型里,Deepseek-v3在PEMS03的MAE和RMSE均为第二优;

(3)时空增强型大语言模型中,TransLLM在PEMS03的MAE和RMSE最优,在PEMS04的MAE位列第二,整体展现出TransLLM在零样本交通流量预测任务中的显著优势。

表2 PEMS03和PEMS04上的零样本性能

在图3中,通过对比不同模型变体在LargeST-SD和ST-EVCDP数据集上的MAE、RMSE指标,验证了TransLLM各模块的有效性:在LargeST-SD的MAE和RMSE上,w/o PR&LLM表现最差,w/o PR次之,w/o STE优于前两者,而完整的TransLLM表现最优;在ST-EVCDP的MAE和RMSE上,同样呈现w/o PR&LLM最差、w/o PR次之、w/o STE较好、TransLLM最优的规律,充分说明PR、LLM及STE模块协同作用,使TransLLM在多交通任务中实现了精度提升。

图3 在LargeST-SD和ST-EVCDP数据集上的消融实验结果

五、总结

该研究针对城市交通多任务建模的核心挑战,包括多任务时空输入异质性、单任务实例动态差异、多任务目标多样性及数据与模型适配矛盾、小规模模型泛化弱、通用大语言模型难处理结构化时空数据等,提出了一种可以同时处理多种交通任务的新框架TransLLM。该框架融合轻量级时空编码器、RL提示个性化模块与多任务输出层,构建统一的建模方案。在7个真实数据集的三大交通任务中,TransLLM表现优异,为城市交通多任务建模提供可行方案。