语义与认知中的循环解释悖论及其对人工智能自然语言处理深层语义分析的影响与启示

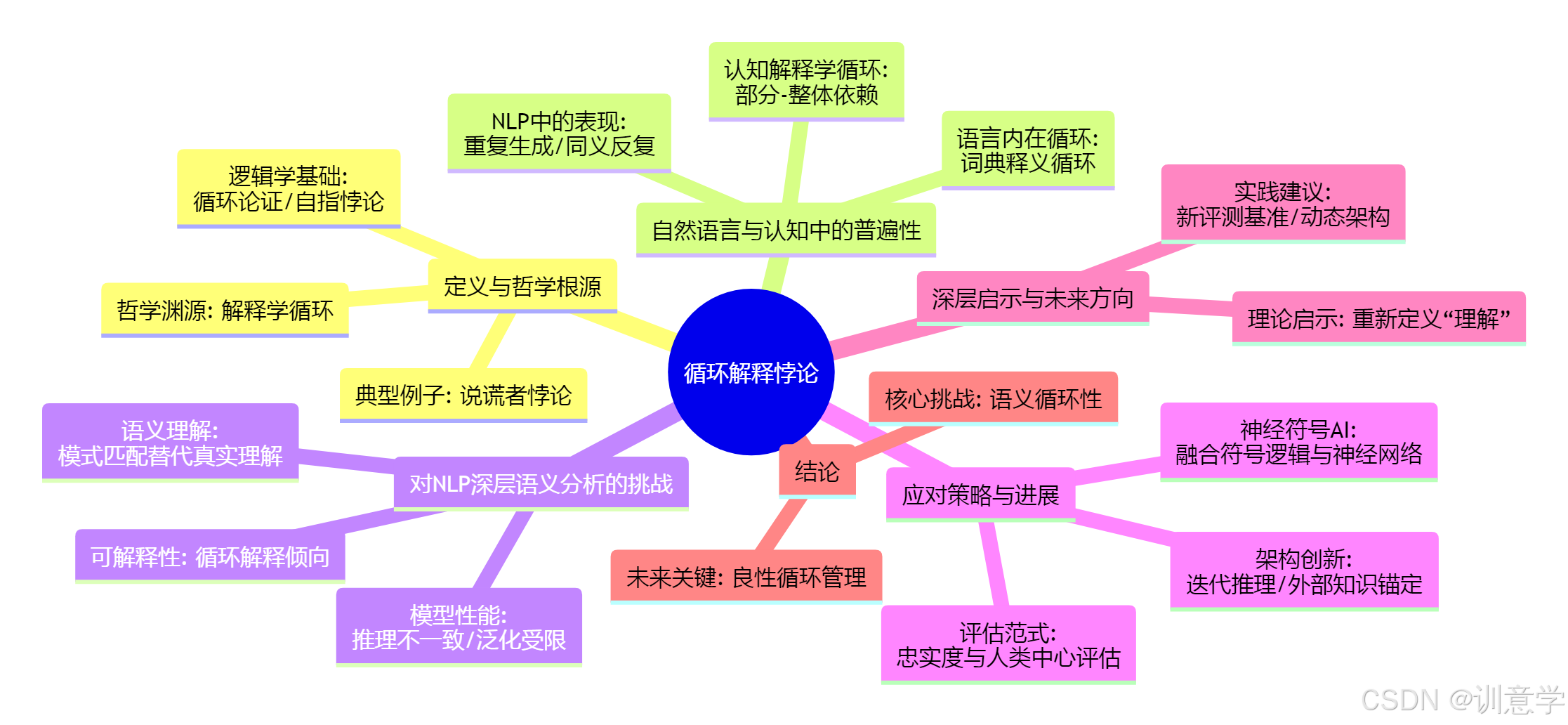

1. 引言:循环解释悖论的定义与哲学根源

语义与认知中的循环解释悖论(Circular Explanation Paradox)是一个深植于哲学、语言学和逻辑学中的根本性问题。根据搜索结果,悖论通常被定义为 “一组看似合理但整体上不一致的命题” 或 “看上去没有什么问题,但实际上包藏着矛盾的一种状态” 。循环解释悖论特指在语义解释和认知理解过程中,解释项(explanans)与被解释项(explanandum)之间存在直接或间接的相互依赖关系,形成一个自我指涉的闭环,从而导致解释在逻辑上失效或陷入无限递归。

其哲学基础可追溯至解释学循环(Hermeneutic Circle),即理解整体需要理解部分,而理解部分又需要理解整体 。在形式语义学和认知语言学中,这种循环性表现为定义性循环(如词典释义中A词用B词解释,B词又用A词解释)以及语义悖论(如著名的“说谎者悖论”),这些悖论 “挑战我们对真理、虚假和引用概念的推理方式” 。有研究指出,语义和集合论悖论在本质上通常是循环的 ,尽管也有观点(如Yablo)认为语义悖论不一定需要循环性即可产生 。循环性并非总是“恶性的”(vicious),它也可以是“创造性地赋予新意义的来源” ,是自然语言丰富性和递归性的必然产物。

2. 循环解释在自然语言与认知中的普遍性与表现

循环解释在人类语言和认知中并非边缘现象,而是普遍存在的核心特征。

- 语言学中的必然循环: 自然语言的内在结构就蕴含着循环性。最典型的例子是词典释义中的循环定义 。研究表明,词典释义中存在三种形式的循环,这是由于用于释义的元语言系统本身并非自足的这一根本限制所导致的 。此外,语言的递归性(Recursiveness)是生成无限句子的基础,但同时也构成了循环解释的土壤,例如“递归否定”就是一种产生悖论的语言结构 。

- 认知过程中的解释学循环: 人类的认知和理解过程本质上是循环的。“解释学循环” 表明,我们的理解是一个通过部分与整体之间不断迭代、相互修正而逐步深化的过程 。这是一种开放的、发展的认知循环,而非简单的逻辑谬误。认知科学认为,认知和认知体验本身是 “本质上循环的” 。

因此,循环性并非一个可以简单“消除”的缺陷,而是语言与认知的一个基本属性。这为人工智能,尤其是自然语言处理(NLP)领域,在处理语义时带来了根本性的挑战与机遇。

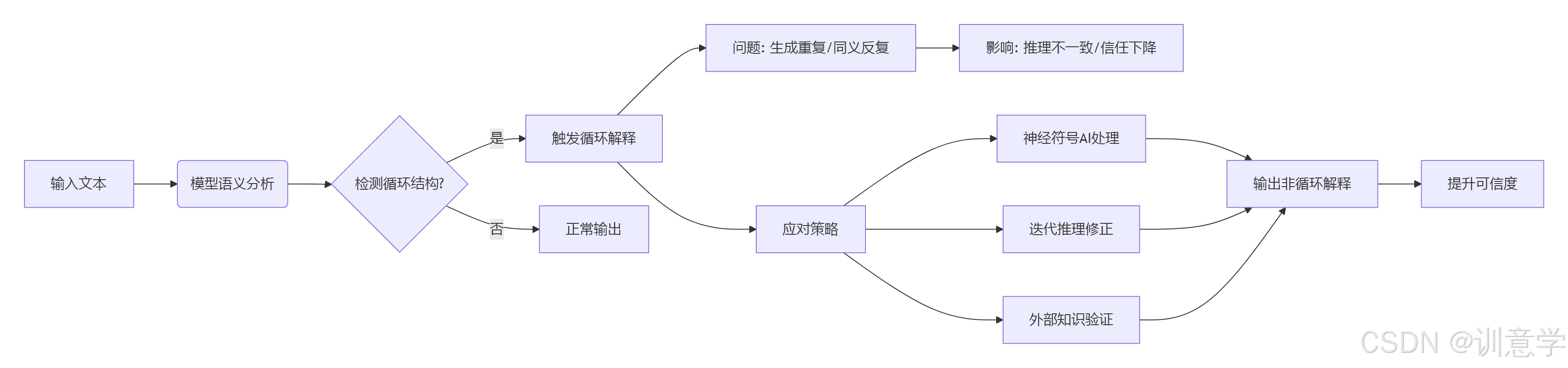

3. 循环解释悖论对NLP深层语义分析的具体挑战与影响

尽管搜索结果中未提供直接量化循环解释悖论对模型性能影响的数据,但通过分析模型在处理复杂语义时暴露出的局限性,可以清晰地推断出其深远影响。深层语义分析旨在超越表层语法,把握语言单元的真实含义、意图和上下文关联,循环解释悖论对此构成了多重挑战。

3.1 模型性能与鲁棒性的潜在威胁

- 推理不一致与信心下降: 当模型遭遇潜在的循环定义或自指结构时,其内部表示可能无法形成稳定的锚点,导致预测信心下降和不一致的预测结果 。例如,在自然语言推理(NLI)任务中,模型可能需要处理蕴含循环概念的命题,其组合语义知识的局限性便会暴露。

- 泛化能力受限: 深度学习模型(即使是高度有效的NLI模型)已被证明无法完全捕捉量词的单调性等逻辑属性 。循环结构对逻辑一致性的要求极高,模型若无法理解其深层机制,则难以将在训练中学到的模式泛化到新的、复杂的循环表述中。

- 错误传播与累积: 在语义解析等管道式任务中,初始的循环理解错误可能会在后续模块中被放大和传播,导致最终输出完全偏离正确语义 。例如,一个基于循环定义的错误实体链接可能会引发一连串的错误关系抽取。

3.2 语义表示与理解的本质困难

- 缺乏真正的理解,沦为模式匹配: 模型可能学会统计上的相关性而非因果性。当面对“勇气就是勇敢的行为”这类循环释义时,模型可能仅学到“勇气”和“勇敢”的高共现概率,而无法深入理解其背后的抽象概念,从而在需要应用该概念的推理任务中失败。这体现了 “空洞解释”(explication vaine) 的风险 。

- 处理递归与自指结构的困境: 尽管Transformer等架构擅长处理长程依赖,但真正的递归语义结构(如“这句话是假的”)要求模型能够对自身的判断进行迭代和修正,这对当前基于前向传播的模型而言是巨大挑战。模型可能陷入逻辑死循环或产生无意义的输出。

- 上下文敏感性的两难: 深层语义分析高度依赖上下文。然而,循环解释意味着上下文本身可能就需要被解释的概念来定义。模型如何在不陷入循环的情况下,动态地构建和理解这种自我指涉的上下文,是一个未解决的难题。

3.3 可解释性与信任危机

- 生成循环解释的倾向: AI解释系统(XAI)本身就可能陷入 “循环论证”(Circular Reasoning) 的谬误,即其生成的解释过度依赖模型内部逻辑而缺乏外部证据验证, merely “将结论重新包装为前提” 。例如,当用户追问模型为何做出某个决策时,模型可能用一套自我证明的内部特征来回答,无法提供令人信服的外部理由,从而损害可信度。

- 解释悖论(Explanation Paradox): 搜索结果显示,AI解释领域本身存在信任悖论 。过于复杂的解释用户看不懂,过于简单的解释又可能掩盖了模型的真实逻辑(如循环决策)。如何为可能包含循环性的语义判断生成清晰、忠实的解释,是一个严峻挑战。

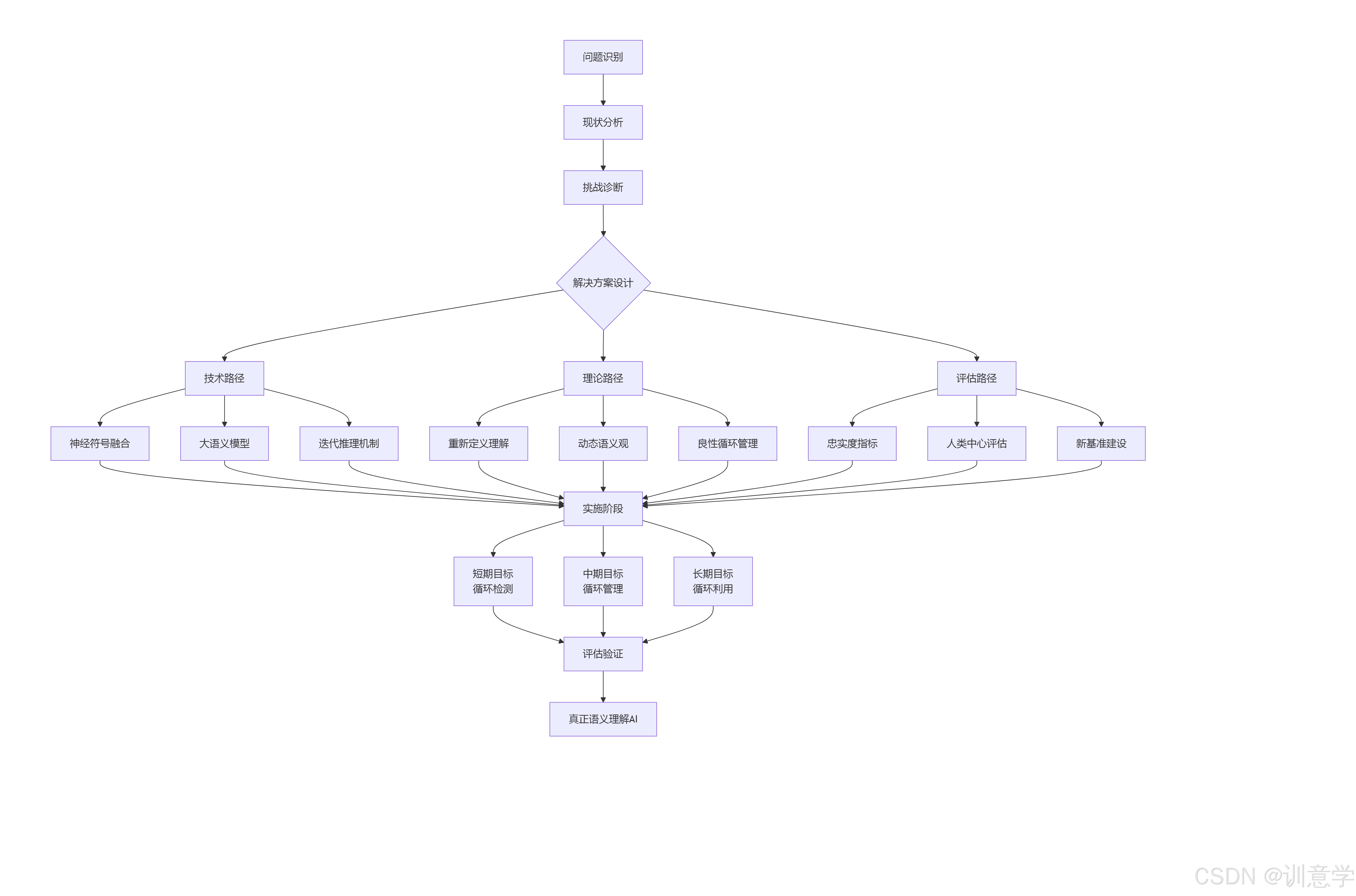

4. 人工智能领域的应对策略与最新进展

面对循环解释的挑战,学术界和工业界并未退缩,而是从不同路径探索解决方案。搜索结果揭示了当前的主要研究方向。

4.1 神经符号人工智能(Neuro-Symbolic AI)的崛起

这是最有前景的方向之一,旨在融合神经网络的数据驱动学习能力和符号系统的清晰逻辑与推理能力。

- 核心思想: 神经符号AI旨在将神经网络和符号逻辑相结合,以创造更强大、可解释、可信赖和通用的AI系统 。其目标包括增强推理能力、可解释性、泛化能力和安全性。

- 应对循环性: 符号逻辑系统拥有处理循环和递归的成熟工具,如 固定点语义(Fixed-Point Semantics)、传递闭包(Transitive Closure) 和约束逻辑编程 。例如,可以通过引入角色定义中的联合、组合和传递闭包来替代术语循环,以避免大型知识表示中的循环问题 。神经符号系统可以利用这些工具来检测和规约循环结构,同时用神经网络处理感知和模糊语义。

- 神经符号循环(Neuro-Symbolic Cycle): 这是一个关键架构,描述了神经网络和符号系统之间知识的交互和迭代过程 。神经网络从数据中提取潜在模式并将其传递给符号系统进行逻辑推理;符号系统的推理结果(如检测到的循环)又可作为反馈来引导神经网络的学习和注意力,从而实现更有效的知识处理和推理,逐步逼近一个稳定、一致的理解。

4.2 架构与算法创新

- 大语义模型(Large Semiosis Models, LSMs): 这是一个非常契合该问题的实践案例。LSMs的架构明确实现了皮尔斯(Peircean)语义循环,包含解释、行动选择、执行和反馈的迭代过程 。这种将语义视为一个动态循环过程而非静态符号的建模方式,为处理解释学循环提供了新颖的计算框架。

- 改进的预训练与推理策略:

- 对抗性训练: 通过生成不一致的自然语言解释(Adversarial Generation of Inconsistent Natural Language Explanations)来训练模型,可以提高模型对逻辑不一致(包括循环)的识别能力和鲁棒性 。

- 迭代式推理: 让模型进行多步推理,并在每一步检查一致性。研究发现,当出现矛盾时,需要 “额外迭代来重新建立一致性” ,这模拟了人类理解中的反复斟酌过程。

- 外部知识锚定: 减少对内部潜在表示的过度依赖,引入外部知识库(如常识知识图)作为验证点,以打破循环论证,为解释提供外部证据 。

4.3 评估范式的转变

- 强调忠实度(Faithfulness): 评估重点从解释的“合理性”转向其“忠实度”,即解释是否真实反映了模型的实际决策过程。研究如NILE架构旨在确保自然语言解释的忠实性 ,这对于识别模型内部的循环逻辑至关重要。

- 人类中心评估(Human-Centric Evaluation): 认识到循环性有时是良性的,最终评估应结合人类的认知判断 。一个解释是否有效,不仅在于其逻辑形式,还在于它能否帮助人类用户达成理解。

5. 深层启示与未来方向

循环解释悖论对NLP的深层语义分析研究提供了超越具体技术方案的哲学性启示。

5.1 理论启示

- 重新审视“理解”的定义: 人工智能的目标不应是创建一个完全无循环的“完美”语义系统,因为这违背了语言和认知的本质。真正的突破可能在于构建能够管理、利用和跳出循环的模型,即实现一种 “良性循环” 。成功的AI系统应能识别恶性循环(导致逻辑悖论)和良性循环(如解释学循环),并与之共处。

- 语义的动态性与过程性: 意义不是一种静态的、可被完全定义的实体,而是一个动态的、在循环解释过程中不断生成和演化的过程 。这要求NLP模型从静态的表征学习转向对语义过程的建模。

- 拥抱符号与 subsymbolic 的融合: 循环解释悖论凸显了纯粹统计学习的局限性。未来,神经符号融合不再是可选项,而是实现真正深度语义理解的必由之路。符号系统提供逻辑骨架,神经网络处理感知和模糊性,两者协同才能破解循环之困。

5.2 实践建议

- 构建新的评测基准: 当前评测数据集(如SQuAD, GLUE)未能充分涵盖循环解释的挑战。亟需开发包含循环定义、自指语句、语义悖论等内容的专门数据集,以推动研究发展。

- 设计新型模型架构: 鼓励受认知科学和哲学启发的新型架构,如明确建模解释学循环的LSMs 。投资于能够进行迭代、反思式推理的模型,而不是单纯的前向预测模型。

- 发展针对性的可解释性技术: XAI工具需要进化,不仅要解释模型“做了什么”,还要能揭示其推理过程中潜在的循环依赖和逻辑漏洞。开发能够可视化模型“困惑”点(如遭遇循环时)的技术。

6. 结论

语义与认知中的循环解释悖论远非一个抽象的哲学游戏,它是横亘在人工智能通向真正语言理解道路上的一道核心难题。它深刻地揭示了当前深度学习方法在深层语义分析方面的本质局限性:过于依赖相关性的统计而缺乏因果逻辑的坚实根基,从而在面临语言固有的循环性和自指性时显得脆弱不堪。

然而,挑战与机遇并存。这一悖论正迫使研究社区从更根本的层面重新思考如何构建智能系统。从神经符号人工智能的兴起到大语义模型等创新架构的提出,我们看到了破解这一难题的曙光。未来的道路不在于消除循环,而在于教会机器如何像人类一样,驾驭、利用并最终超越循环,在一个没有绝对起点的意义世界中,通过动态、迭代的过程构建起稳定而深刻的理解。这不仅是技术上的突破,更是一次对我们自身智能本质的更深层次模仿与探索。最终,对循环解释悖论的克服将成为衡量人工智能是否真正迈向“理解”而不仅仅是“处理”语言的关键标尺。