面部情绪识别数据集的介绍和下载

1. 数据集总结

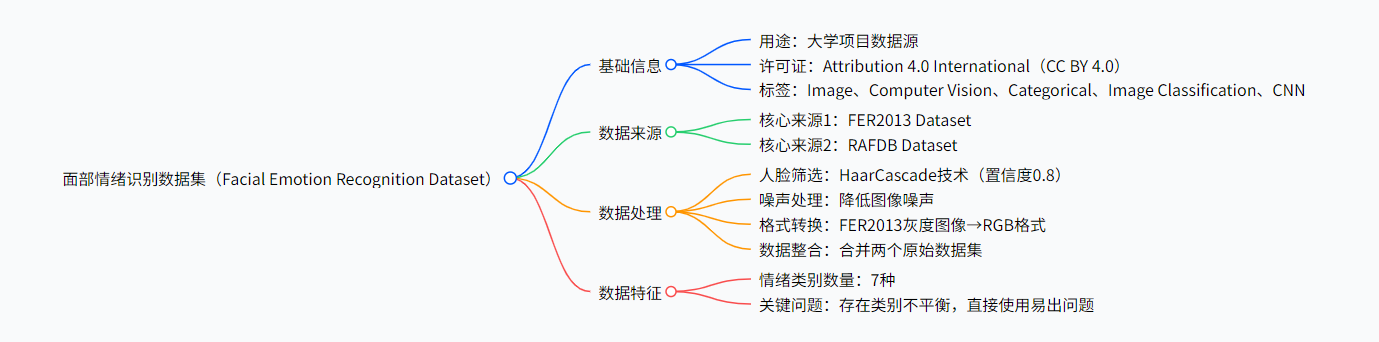

Facial Emotion Recognition Dataset(面部情绪识别数据集)是用于大学项目的数据源,由FER2013数据集和RAFDB数据集处理合并而成;处理过程采用HaarCascade技术(置信度0.8)筛选含人脸图像以降低噪声,并将FER2013的灰度图像转换为RGB格式,包含7种情绪的图像;需注意该数据集存在类别不平衡问题,直接使用会引发问题,其许可证为Attribution 4.0 International(CC BY 4.0),标签涵盖图像、计算机视觉、分类变量、图像分类、CNN等领域。

源网页:https://www.kaggle.com/datasets/fahadullaha/facial-emotion-recognition-dataset

数据集文件:「FacialEmotionRecognition.zip」,链接:https://pan.quark.cn/s/e1a6182491c6

2. 思维导图(mindmap)

3. 详细总结

一、数据集基本概况

- 数据集名称:Facial Emotion Recognition Dataset(面部情绪识别数据集)

- 核心用途:作为大学项目的数据源,用于面部情绪识别相关研究或应用开发

- 许可证类型:Attribution 4.0 International(CC BY 4.0),允许在遵循署名要求的前提下使用、分享和修改数据

- 所属领域标签:涵盖5个核心标签,具体如下表所示:

| 标签类别 | 标签内容 |

|---|---|

| 数据类型 | Image(图像) |

| 技术领域 | Computer Vision(计算机视觉) |

| 数据属性 | Categorical(分类变量) |

| 任务类型 | Image Classification(图像分类) |

| 常用模型 | CNN(卷积神经网络) |

二、数据集来源与处理

- 原始数据来源:由两个公开数据集合并而成

- 来源1:FER2013 Dataset(经典面部情绪识别数据集)

- 来源2:RAFDB Dataset(实时情感分析数据库,含丰富场景下的面部图像)

- 数据处理流程:通过多步技术处理优化数据质量

- 人脸筛选:采用HaarCascade技术,以0.8的置信度分数筛选包含清晰人脸的图像,排除无脸或人脸模糊的无效数据

- 噪声降低:通过技术手段减少图像噪声,提升图像清晰度,为后续模型训练提供高质量输入

- 格式转换:将FER2013数据集中的灰度图像统一转换为RGB格式,确保两个来源数据的格式一致性

- 数据合并:将处理后的FER2013和RAFDB数据整合为一个数据集,形成更丰富的样本库

三、数据集核心特征与注意事项

- 核心特征:包含7种情绪对应的图像样本,可用于多类别面部情绪(如开心、悲伤、愤怒等)的识别任务

- 关键问题:存在类别不平衡问题——不同情绪类别的样本数量差异较大,若直接使用该数据集进行模型训练,可能导致模型偏向样本量多的类别,降低对样本量少的类别的识别准确率,需在使用前进行数据平衡处理(如过采样、欠采样等)