AR眼镜在巡检业务中的软件架构设计|阿法龙XR云平台

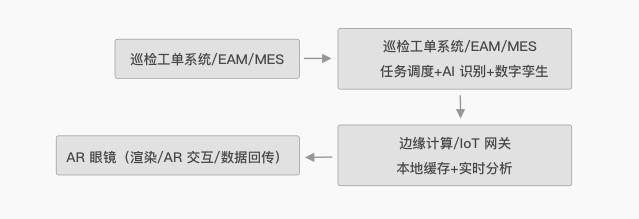

在工业、电力、能源日常巡检运维工作中引入 AR 眼镜,不是简单换个终端,而是需要一套端(AR 眼镜)+边(本地服务器/网关)+云(企业系统/AI) 的软件方案:

软件功能模块如下:

1. 工单与任务流转

功能:把企业现有的工单系统(EAM、MES)任务流转到 AR 眼镜。

实现:

- 提供 API/SDK 对接企业系统。

- 工单下发到眼镜 → 转换为 步骤化、可视化 AR 任务卡片。

- 巡检人员执行时,支持语音播报 / 手势切换 / 语音记录。

2. AR 可视化引擎

功能:在眼镜画面中叠加虚拟信息。

实现:

- SLAM/Marker 定位:通过二维码、设备编号、CAD 模型识别设备位置。

- IoT 数据绑定:将实时传感器数据(温度/振动/压力)叠加到设备表面。

- 三维数字孪生:调用云端或边缘的 3D 模型(glTF、Unity Asset),渲染在眼镜里。

- 告警可视化:异常点高亮闪烁、热力图显示。

3. 人机交互

- 语音指令识别:调用语音 SDK(如科大讯飞、微软 Azure Speech)。

- 手势识别:通过眼镜自带摄像头 + CV 模型(MediaPipe、OpenCV)。

- 眼动/头动交互(高端眼镜支持):光标跟随凝视,点选确认。

4. AI 识别与智能助手

- OCR/表计识别:对准压力表、电表,AI 自动读数。

- 异常检测:基于摄像头画面,AI 检测裂纹、泄漏、冒烟。

- 知识库助手:接入企业文档(SOP/维修手册),自然语言问答。

5. 实时协作

- 视频回传:现场画面传给后台专家。

- AR 标注:专家可在远程界面对画面打标,眼镜端实时显示箭头/圈选。

- 语音对讲:保证巡检人员和后台随时沟通。

- 可用 WebRTC/RTSP 协议,需做低延迟优化。

6. 数据回传与报告生成

- 语音转文字:巡检员口述巡检结论 → 自动生成文本记录。

- 自动报告:任务完成后,眼镜上传照片、视频、传感器数据 → 系统自动生成 PDF/巡检报告。

- 闭环追踪:报告直接写回 EAM/MES 系统。

AR眼镜引入AI识别,对设备、仪表仪器状态进行自动判断并录入系统,能够大大提升巡检效率,下面是实现的具体方案:

AI 识别是核心能力之一,主要包括 OCR 表计读数识别、设备异常检测、物体定位识别 三类场景。实现方案一般采用边缘 AI + 云端协同模式。边缘侧负责实时、低延迟的识别,例如读数、阀门状态检测;云端侧负责大模型推理、知识问答和复杂图像分析。

1. OCR 表计识别

可基于 PaddleOCR、Tesseract 或自训练的 OCR 模型。通过眼镜摄像头采集表计图像,在边缘侧快速识别数字读数。为了提高精度,需要先做 图像预处理(灰度化、去噪、透视校正),再送入 OCR 引擎。

import cv2

from paddleocr import PaddleOCR

ocr = PaddleOCR(use_angle_cls=True, lang='ch')

img = cv2.imread("meter.jpg")

result = ocr.ocr(img, cls=True)

for line in result[0]:

print("检测结果:", line[1][0])

2. 设备异常检测

常用目标检测模型(如 YOLOv8、Detectron2),在边缘侧部署 TensorRT/ONNX Runtime 加速。典型应用是识别 油污泄漏、锈蚀、裂纹。

3. 物体定位与数字孪生绑定

通过训练好的分类模型或特征点匹配(SIFT/ORB),快速识别设备编号或二维码,然后在 AR 渲染中将 IoT 实时数据叠加在对应设备位置。

在架构上,AR 眼镜通过 SDK 调用边缘 AI 模型推理接口,返回识别结果后实时叠加在画面中。同时,云端可对存储的巡检影像做离线大模型分析,用于趋势预测和知识库更新。这样既保证了实时性,又兼顾了复杂任务的智能化。