超越RGB:移动设备多光谱成像的真实世界数据集

摘要

多光谱(MS)成像系统在计算机视觉和计算摄影任务中拥有广泛的应用,但由于其高昂的成本,尚未得到广泛采用。近年来,光子超材料的设计和制造技术的进步,使得开发适合集成到消费级移动设备中的多光谱传感器成为可能。用更丰富的光谱信息增强现有的RGB相机及其处理算法,有望在图像处理流程的多个环节中得到应用,但适用于此类研究的多样化真实世界数据集却并非免费可得。我们推出了 Beyond RGB¹,一个真实世界数据集,包含数千张在多样化的真实世界和实验室条件下拍摄的多光谱和RGB图像,该数据集适用于开发和评估利用多光谱与RGB数据的算法。我们数据集中的所有场景均包含一个比色参考和场景照明光源的光谱测量值。此外,我们通过引入一种新颖的光源光谱估计(ISE)算法,展示了我们数据集的实用价值。我们的算法在现有基准上将当前最先进(SoTA)水平提升了高达58.6%,并在我们自己的数据集上设立了基线性能。

¹数据集地址:https://github.com/shirawerman/Beyond-RGB

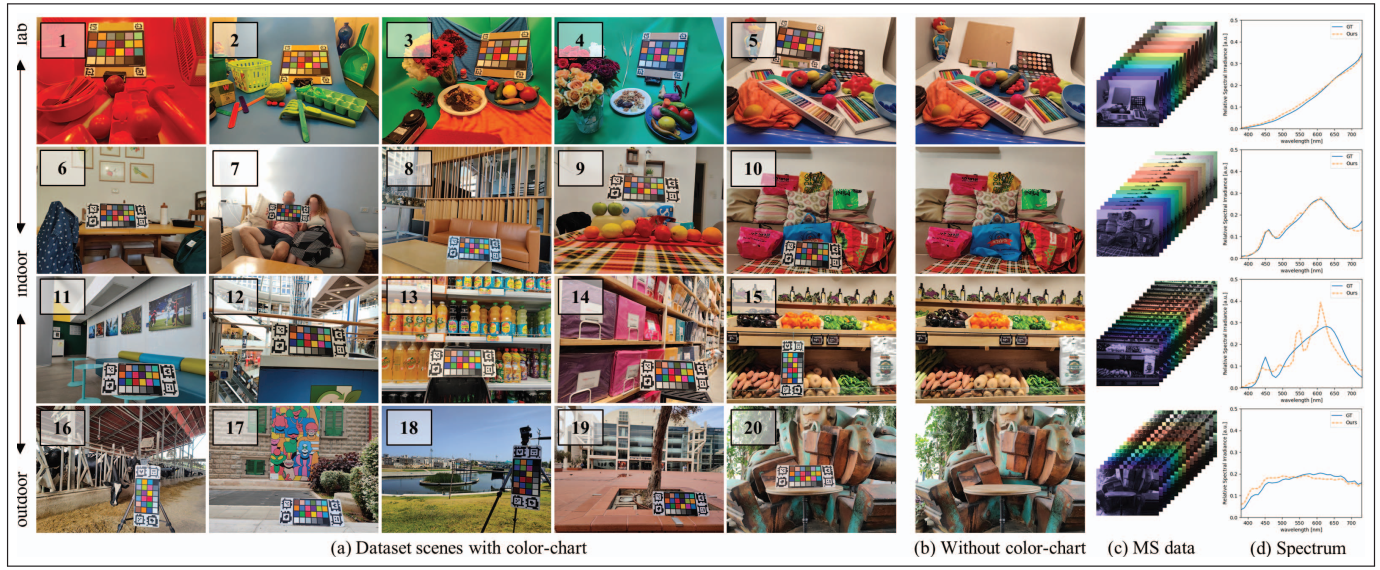

图1. 我们数据集中的示例图示:(a) 1-5号样本场景在观察箱中捕获,6-15号样本场景在室内现场位置捕获,16-20号样本场景在室外现场位置捕获;(b) 5、10、15和20号场景在不包含色卡的情况下捕获的对应样本;(c) 5、10、15和20号场景的多光谱图像立方体;(d) 5、10、15和20号场景的真实光照光谱测量值,以及由我们算法执行的估计结果。

1. 引言

相机需要彩色滤光片阵列(CFAs)[43]来区分不同波长的光,从而允许渲染彩色图像。1976年引入的 ubiquitous Bayer 阵列 [8] 使用三种宽带滤光片(红、绿、蓝)来模拟人眼的颜色感知 [28]。尽管应用广泛,使用宽带滤光片的一个固有缺点是会丢失原始光学信号中的光谱信息,而这些信息在广泛的计算机视觉应用中蕴含着巨大潜力。这些应用包括但不限于颜色与材质分析、农业检测、食品质量控制和医疗保健 [1,33,42,54]。

传统的高光谱(HS)和多光谱(MS)成像系统,如推扫式、线扫描或可调滤光片相机,能够捕获具有高光谱分辨率的图像 [3, 11, 45]。然而,传统HS和MS系统由于其高昂的成本、庞大的体积、较长的图像采集时间以及需要大量的操作员专业知识,难以得到广泛采用。纳米光子元件设计的最新进展,通过在一个消费级CMOS图像传感器上制造具有多个光谱通道的CFA [38,59],促进了以紧凑且低成本的形态因子创建适用于移动设备的MS成像传感器。

娱乐摄影是当今成像系统最常见的用例,因此很自然地需要探索配备MS传感器的移动设备如何从额外的光谱信息中受益。先前的工作表明,MS数据可用于改进光源估计 [64],提取全局场景光源的光谱估计 [62, 71] 或多个局部光源的光谱估计 [40, 57]。此外,文献[17]表明,通过使用精心选择的外部滤光片,可以使RGB相机更具比色性,从而使整个系统的响应更接近遵守卢瑟条件(Luther condition)[25,30,49]。这些结果表明,利用增加的光谱信息来改进自动白平衡(AWB) 和色彩空间转换处理步骤具有潜力,这两个步骤对于渲染色彩度量准确且视觉愉悦的图像至关重要 [15,31]。

开发同时利用MS和RGB图像的算法,需要一个多样化、大规模的数据集,该数据集需由MS和RGB相机在真实世界采集,并附有合适的真实标注信息(ground truth)。尽管已有许多HS和光谱反射率(SR) 数据集 [4, 10, 18, 20, 40, 50–52, 60, 65, 70],但它们通常在规模和内容多样性上有限,这限制了它们对于算法开发的效用。为了弥补数据空白,我们引入了 Beyond RGB 数据集,它包含在实验室和现场采集的1680个多样化场景,其样本如图1所示。我们将在第2节讨论数据集之间的比较差异。

为了展示 Beyond RGB 的效用,我们引入了对著名的卷积颜色恒常性(CCC)[5] 算法的一个适配版本,我们对其进行了修改以执行光源光谱估计(ISE)任务。我们的算法在之前的ISE基准上实现了SoTA性能,并在我们自己的数据集上提供了一个基线性能水平。

我们的主要贡献可总结如下:

(1) 一个多样化、大规模的来自移动设备的RGB和MS图像数据集,附带比色和光源光谱的真实标注,适用于ISE、颜色恒常性和颜色准确性任务。

(2) 对CCC算法在ISE任务上的一个适配版本,将现有SoTA性能提升了高达58.6%。

(3) 我们展示了我们的数据集和ISE算法可以轻松地适用于不同设备间的MS和RGB数据融合。

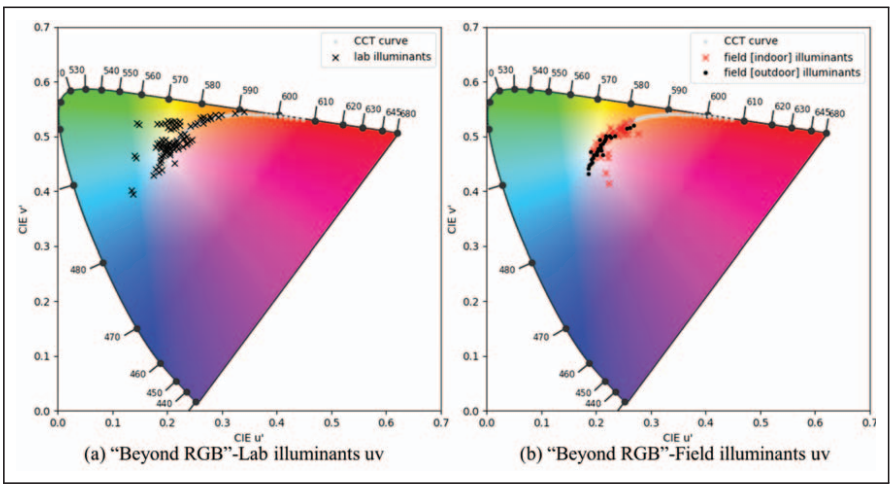

图2. Beyond RGB数据集中光源的CIE-1976-Luv uv色度坐标:(a) 在实验室场景中捕获的光源;(b) 在现场捕获的光源。该数据集分别在实验室、室内和室外场景中包含93种、43种和29种不同的光源。

2. 相关工作

2.1. 相关数据集

多年来,人们已经开发了许多高光谱(HS)和光谱反射率(SR)数据集 [4,10,18,20,40,50–52,60,70](表1)。多光谱(MS)和高光谱(HS)领域之间的区别并不明确,这些术语的使用在文献中也各不相同。然而,我们观察到,通常当每个通道的光谱带宽小于10nm,或者等效地,仪器在可见光区域拥有超过30个通道时,它就被认为是HS。高光谱图像数据集便于研究,因为高分辨率的光谱立方体可以进行后处理,根据目标应用的需求包含原始通道的一个子集。正是出于这个原因,通常收集的都是HS数据集(如表1所示),因为它们比包含较少光谱信息的MS数据集允许进行更多样化的后处理。

如果场景光源是已知的(通常通过在场景中包含一个中性参考靶标来实现),HS数据集可以进行后处理,将场景光源从HS图像中移除,留下SR图像。SR数据集的实用性在于能够在后处理中用任何所需的光源对场景进行重打光。光源光谱估计(ISE)算法所需运行的名义域是由所有可能场景的空间乘以所有可能光源的空间来定义的。因此,对SR数据进行重打光减少了许多不同光照条件下捕获大量场景的需求。然而,正如文献[23]中指出的,通过将SR图像与光源光谱相乘来简单模拟光照效果,并不会产生真实世界中的效应,如相互反射、镜面反射、阴影或场景中的强度变化。此外,存在一大类图像区域无法很好地用SR图来建模。这些情况的重要例子包括镜面高光和蓝天,后者也作为一种记忆色[56],因此对其正确渲染尤为重要。

我们的数据集包含真实世界的图像,包括SR数据集中经常避开的区域,并且由于Beyond RGB中的光照分布不是通过后处理合成的,因此保证了物理上的准确性。我们在补充材料的S2.2节中实证证明了重打光的SR数据集与我们自己的数据集之间存在域差异。

HS和SR数据集的第二个局限性是图像采集所需的长曝光时间,这是由于HS成像仪通常使用的机械扫描机制和窄带宽滤光片造成的。这种复杂性使得拍摄移动的物体(人、动物等)变得困难,并且耗时,导致数据集规模较小(如表1所示),其中大多数数据集偏向于室外图像,只有[4,40]包含超过几十张图像。需要进一步强调的是,我们注意到,除了[60, 70]中的少数图像外,表1中调查的所有HS和SR数据集都不包含任何人物图像;而我们自己数据集中11%的野外场景包含人物或动物。正是由于这些局限性,Gijsenij等人建议同时利用SR数据集和真实世界数据集来评估颜色恒常性算法[23]。事实上,颜色恒常性研究中最常用的两个数据集是真实世界的Color-Checker [22]和NUS-8 [13]数据集,我们自己的数据集结构也参照了这些。

在可用的HS和SR数据集中,与我们自己的数据集最相似的两个是Arad 1K [4]和KAUST [40]数据集,它们拥有相似数量的场景。虽然Arad 1K拥有大量多样化的野外场景,但它几乎完全在室外捕获,并且不包含比色参考,也未测量光源光谱,这使得它不适合我们感兴趣的任务。KAUST数据集在规模上与我们自己的相似,然而由于上述局限性,其捕获的主题多样性有限。

2.2. 光源光谱估计

对于一个具有N个通道的相机,导致ISE问题的图像形成模型是:

Ik(x, y) = ∫Λ R(x, y; λ)L(λ)fk(λ)dλ k ∈ [0..N) (1)

其中 (x, y) 是给定像素的空间坐标,k 是通道索引,fk(λ) 是第k个通道的系统响应函数,Ik 是观测图像的第k个通道,λ 是指示观测光波长的参数。R 和 L 分别是未知的场景反射率和未知的场景光源。Λ 是相机具有不可忽略响应的波长积分域。公式1的模型是一个常见的简化模型,它假设空间均匀的光源和可忽略的镜面高光。

我们的目标是仅给定观测图像 I(x, y) 来估计 L(λ),众所周知这是一项本质上是欠定的任务。克服问题的欠定性是ISE中的核心挑战,先前的工作通过光源和反射率的子空间建模[12,24],以及通过优化问题及其启发式方法的精心构建[16, 29]来解决它。另一种常见方法是利用自然反射光谱的低维特性[44,55],并将问题表述为低秩矩阵分解问题[71]。其他策略包括选择可能为中性色的像素[9,37,62,66],从而无需修改即可反射所需的光谱。最后,最近的方法利用深度学习技术,通过使用CNN执行像素级ISE[58],并通过将矩阵分解显式建模到展开网络(unrolling network)中来实现[40]。然而,基于学习的方法的数量迄今为止受到缺乏合适数据的限制,这在Li等人发布KAUST数据集[40]之前是无法获得的。

颜色恒常性(Color constancy),即估计场景光源颜色的任务,是一个被广泛研究的课题[2,5,7,9,26,27,37,39,41,61,66,68,69],因为它在图像中渲染正确颜色方面起着核心作用。它与ISE任务密切相关,解决相同的基本公式1,但不寻求显式恢复完整光谱。在CCC [5, 7]中,Barron等人提出了对数色度直方图特征,该特征在后续工作中产生了广泛影响[35, 69],并将颜色恒常性问题表述为一个判别性学习任务。最近,基于深度学习的方法通过应用对比学习、深度度量学习和Transformer架构[39,41,69],在颜色恒常性任务上取得了巨大的性能提升。

借鉴已被证明对颜色恒常性问题有效的技术进展,并借助我们自己的等合适数据集的可用性,我们展示了[5]的核心思想可以迁移到ISE任务中,与先前的方法相比能带来显著的性能提升。我们希望学术界能利用Beyond RGB来进一步推进这一研究途径。

3. Beyond RGB数据集

场景(Scenes): Beyond RGB包含1680个场景,其中472个在现场采集,1208个使用自动化观察箱采集。在实验室采集的场景由13个不同的场景组成,其样本可见于图1的顶行。我们设计了这些场景,使一些包含广色域颜色(例如图1.a.5),而另一些则只有几种主要主导色(例如图1.a.1)。自动化实验室设置是一个定制构建的观察箱,具有12个不同的光源,可以通过控制器打开和关闭。观察箱中的照明是空间均匀的,控制光源的能力使我们能够生成许多不同的混合光。实际上,我们生成了93种不同的照明,它们在CIE1976色度图上的位置如图2.a所示。实验室光源很好地覆盖了普朗克轨迹(Planckian locus),相关色温(CCT)[47]从1801K到14132K,并且还包括轨迹外的一些严重偏色光源。

现场场景使我们能够捕获真实世界的情况,包括235个室内环境场景和237个室外环境场景。它们在不同地点、一天中的不同时间采集,包含多样化的主题,如人物、动物、建筑物和植被。正如自然光所预期的那样,现场场景中出现的光源主要位于普朗克轨迹上(图2.b)。现场光源也很好地覆盖了普朗克轨迹,室内场景的CCT范围从2642K到7278K,室外场景的CCT范围从4021K到11753K。

MS传感器(MS Sensor): 对于MS图像,我们使用一个原型相机,其具有16个不同的滤光片,以4x4 CFA排列(如图S1所示),原生分辨率为2584x1936像素,这对应于每个光谱通道的分辨率为646x484像素。法布里-珀罗型带通滤光片被制造并放置在CMOS图像传感器(CIS)的像素上方。我们以HDF5 [34]文件格式提供原生分辨率的MS数据,仅进行了最少的后处理,包括去除黑电平、按饱和电平归一化、通过相同通道最近邻的线性插值校正坏点、镜头阴影校正以及使用保边双边滤波进行降噪[48]。

RGB相机(RGB Cameras): 作为参考的RGB相机,我们使用了两种广泛可用的旗舰安卓手机。一部是三星Galaxy S21 Plus SM-G996B,原生分辨率为4032x3024像素;另一部是Oppo Find X5 Pro CPH2305,原生分辨率为4096x3072像素。我们提供原始的RAW图像数据作为HDF5文件以及相应的元数据,仅根据需要进行了修改以确保隐私。RGB图像与MS图像同时捕获,以确保两个图像中看到的是同一场景。

相机内参和外参(Camera Intrinsics and Extrinsics): 对于RGB和MS相机,我们都以相机投影矩阵和畸变参数的形式提供相机内参。为了允许对场景进行校正,我们还在包含色卡的场景中提供了RGB和MS相机之间的相对位姿(外参)。更多信息见补充材料的S3.2节。

分光光度计(Spectrophotometer): 我们使用X-Rite i1Pro 3 Plus在环境模式下获取光谱测量值,该模式使用校准过的余弦校正漫射元件来收集半半球入射照明。该分光光度计在380-730nm范围内以10nm的分辨率收集光谱。每个光谱都在颜色校准靶标附近测量,传感器探头背对靶标。

颜色校准(Color Calibration): 为了表征颜色准确性,我们在每个场景中都包含了一个X-Rite ColorChecker Classic校准板。我们用AprilTag基准标记[53, 67]框住ColorChecker,以便在所有场景中准确检测,并在所有图像中提供色卡色块的边界轮廓。为了避免在数据集用于算法训练时需要遮盖或裁剪掉色卡,我们对数据集中的每个场景拍摄两次:一次呈现色卡,然后再次移除色卡后拍摄。

隐私(Privacy): 根据[36]中建立的隐私协议,我们对数据集中出现的人脸和车牌进行模糊处理。一个H/3 x H/3的平均模糊窗口分别应用于RGB或MS图像的每个通道,其中H是模糊区域的高度,从而保持了该区域原有的平均信号水平。模糊区域边缘包含用于平均计算的外边界像素。我们提供已模糊区域的坐标。

4. 光源光谱估计方法

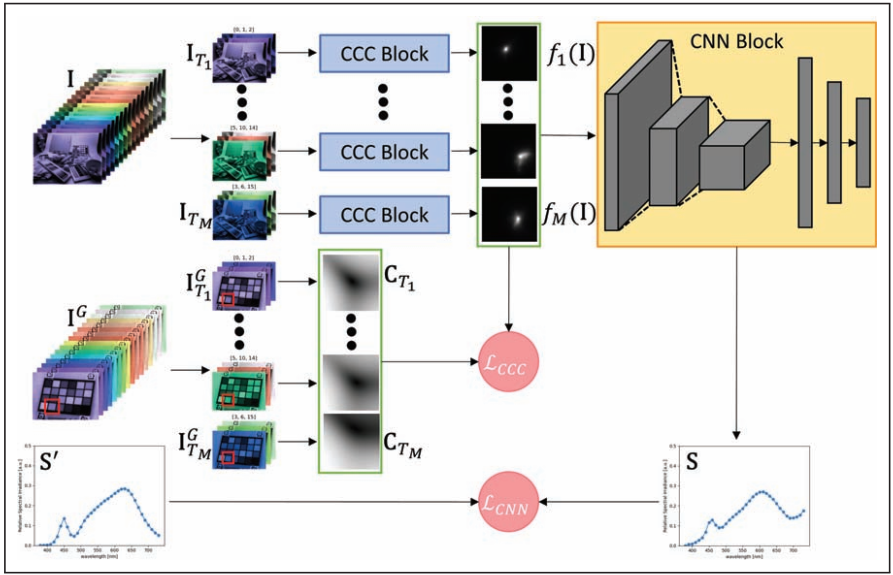

我们的算法包含三个主要阶段:(1) 将输入的多光谱(MS)图像划分为三元组(triplets),(2) 通过一个CCC模块处理每个三元组,以及 (3) 使用一个CNN将CCC模块的输出转换为光谱估计。我们方法的概述如图3所示。实现细节可在补充材料的S1节中找到。

4.1. 多光谱三元组

给定一个形状为 H × W 的原始MS图像 Iraw(其模式根据图S1中的CFA排列),我们将其重新排列成一个形状为 16× H/4 × W/4的MS立方体,我们将其表示为 I。从这16个通道中,我们选择M个不同的三元组 Ti:

Ti = [c1_i, c2_i, c3_i] (2)

其中 ck_i 是 {0, ..., 15} 中的通道索引。

图3. 方法描述: 顶部:输入MS立方体 I的通道被划分为M个三元组,每个三元组被转换为对数色度直方图并由一个CCC模块处理。CCC模块输出得分图 fi(I),这些图随后被拼接并由一个CNN处理,该CNN输出估计的光谱 S。底部:在训练期间,我们使用 IG中的比色参考来提取GT(真实标注)三元组比率并生成M个成本图 CTi,用于计算 LCCC。LCNN 使用测量到的GT光谱 S′ 计算。

对于每个三元组 Ti,我们从MS立方体 I中创建相关通道的堆栈:

ITi = [Ic1_i, Ic2_i, Ic3_i] (3)

具体来说,我们使用 M = 21,并选择14个连续MS通道的三元组和7个来自光谱重叠很少的通道的额外三元组。

图3. 方法描述: 顶部:输入的多光谱(MS)立方体 I 的通道被划分为 M 个三元组,每个三元组被转换为对数色度(log-chroma)直方图并由一个卷积颜色恒常性(CCC)模块处理。CCC模块输出得分图 fi(I),这些图随后被拼接并由一个卷积神经网络(CNN)处理,该网络输出估计的光谱 S。底部:在训练期间,我们使用图像 IG 中的比色参考来提取真实标注(GT)三元组比率并生成 M 个成本图 CTi,这些成本图用于计算损失函数 LCCC。损失函数 LCNN 使用测量得到的真实标注光谱 S′ 进行计算。

图3. 方法描述: 顶部:输入的多光谱(MS)立方体 I 的通道被划分为 M 个三元组,每个三元组被转换为对数色度(log-chroma)直方图并由一个卷积颜色恒常性(CCC)模块处理。CCC模块输出得分图 fi(I),这些图随后被拼接并由一个卷积神经网络(CNN)处理,该网络输出估计的光谱 S。底部:在训练期间,我们使用图像 IG 中的比色参考来提取真实标注(GT)三元组比率并生成 M 个成本图 CTi,这些成本图用于计算损失函数 LCCC。损失函数 LCNN 使用测量得到的真实标注光谱 S′ 进行计算。

4.2. 单个CCC模块

我们方法中使用的CCC模块和损失函数完全按照[5]中的定义实现。为清晰解释我们的方法,我们重复部分定义,但请读者参阅原始论文以获取完整讨论。

对于每个通道三元组 Ti,我们构建相应的归一化2D对数色度直方图 Ni(u, v)。使用“金字塔上下文”(pyramid context)技术[6]将对数色度直方图与一个学习到的滤波器进行卷积,该技术通过从直方图构建一个金字塔,用一个小型学习滤波器卷积金字塔的每个尺度,然后折叠(collapsing)滤波后的直方图。为简化 notation,让我们将卷积金字塔表示为三元组 Ti 的单个卷积滤波器 Fi:

fi(I) = softmax(Ni ∗ Fi) (4)

滤波器 Fi 使用CCC中定义的损失函数进行学习。首先,我们为三元组 Ti 定义一个成本图 C:

CTi(u, v) = AE( [e^(-u′i), 1, e^(-v′i)]^T, [e^(-u), 1, e^(-v)]^T ) (5)

其中 u, v 和 u′i, v′i 分别是三元组 Ti 的观测到的和真实标注(ground truth)的色度值,指数用于抵消uv定义中的对数,两个向量之间的角误差(Angular Error)定义为:

AE(v1, v2) = arccos( 〈v1, v2〉 / (||v1|| ||v2||) ) (6)

最终的CCC损失函数是uv得分图 fi(I)[(u, v)] 与使用对数色度GT计算出的uv成本图之间的乘法:

Li_CCC = Σ_(u,v) [ fi(I)(u, v) · CTi(u, v) ] (7)

4.3. 多个CCC模块

我们为每个三元组 Ti 单独学习一个CCC模块。在每个模块中,我们使用一个由5x5卷积核组成的7层金字塔,并在上采样和下采样过程中使用双线性插值。

给定场景中中性区域的光谱信息与场景光源光谱相关。为了计算每个三元组的GT色度值,需要每个MS通道的光源值。为了获得每个通道最精确的光源值,我们使用数据集中可用的比色参考。我们使用 IG(呈现色卡的MS图像)中一个灰色色块的中值(median),如图3所示,并计算:

u′_i = log( med(IG_c2_i) / med(IG_c1_i) )

v′_i = log( med(IG_c2_i) / med(IG_c3_i) ) (8)

然后使用 u′i, v′i 为每个三元组计算公式5中定义的成本图 CTi,随后用于计算公式7中定义的损失分量。每个CCC模块的输出实际上是对数色度直方图bin的得分图,因此我们期望在接近每个相关三元组的真实uv的uv bin上获得更高的分数。

4.4. CNN模块

得分图的 (u, v) 空间分布包含我们想要用于估计场景光源的信息。我们将所有得分图拼接起来,并输入到一个CNN模块中,该模块被训练来预测相对功率谱密度 S。

CNN的损失是在预测光谱 S 和测量的GT光谱 S′ 之间计算的,

LCNN = AE(S′, S) (9)

对于Beyond RGB数据集,S′ 是一个36通道的向量,表示在380nm至730nm范围内以10nm为间隔的相对功率谱密度,使用第3节中描述的分光光度计测量。

使用的完整训练损失是:

L = w1 · Σ_(i∈[0,M]) Li_CCC + w2 · LCNN + w3 · Lwd (10)

其中 Lwd 是一个权重衰减正则化分量,w1,2,3 是用于平衡损失贡献的标量权重。来自 LCNN 的梯度仅传播到CNN模块,而不反向传播到CCC模块。

5. 实验与结果

我们在两个已建立的光谱反射率(SR)数据集KAUST和CAVE [40,70](我们使用[46]中的59种标准光源对其进行重打光)以及我们自己的Beyond RGB数据集上评估所提出的方法。

我们报告常用的公式6的角误差(angular error)指标,单位为度。然而,由于一些被比较的方法输出的结果并不等同于全光谱估计,我们报告三种类型的角误差:

ΔAHS = AE(S′, S)

ΔAMS = AE(MCAL * S′, SMS)

ΔAXYZ = AE(MCMF * S′, SXYZ) (11)

其中 S′ 是GT(真实标注)光谱测量值,S 是算法的全光谱估计值。SMS 是那些在MS通道空间中输出其光源估计值的算法的输出估计值,类似地,SXYZ 表示在CIE-1931 XYZ空间中的输出。MCAL 是校准矩阵,将 S′ 转换为从MS传感器滤光片响应(图S1)推导出的预期16通道MS信号,MCMF 是标准的CIE-1931 CMF(颜色匹配函数)[14],它将 S′ 转换为XYZ空间。

5.1. 光谱反射率数据集

我们使用形状为31x512x512的KAUST和CAVE SR图像,这些图像表示每个像素在400nm至700nm波长范围内以10nm为间隔的反射率。KAUST数据集的光谱反射率信息可达730nm,但我们截断了最后几个通道以使数据与CAVE等效。我们通过将每个像素的反射率向量乘以一个包含所需光源光谱的对角矩阵来对场景进行重打光,得到一个31通道的HS图像 I31。为了模拟我们自己的16通道MS传感器,我们还使用从图S1的MS通道响应推导出的校准矩阵 MCAL 将 I31 转换为16通道MS测量值,最终输出大小为16x512x512的 I16。对于这两个数据集,我们在训练和测试时屏蔽(mask)白色参考板。

我们使用完整的HS I31输入和较低维度的MS I16输入来训练我们提出的方法,以与其他利用完整HS数据的方法进行公平比较。当使用完整HS输入训练时,我们选择29个连续的三元组作为输入。在这两种情况下,训练都是在图像的随机256x256裁剪块上进行的。我们遵循[40]的方案,在KAUST的HS图像的随机80%划分(包含80%的光源)上进行训练,并在剩余的20%图像和光源上报告评估结果。

我们将我们提出的方法与六种现有的光源光谱估计方法进行了比较,包括GrayEdge [32,66]、LRMF [71]、ISNL [63]、PWIR [57]和DUN [40],使用了后者报告的结果。如表2所示,我们提出的使用完整31个HS通道输入的方法在两个数据集上都取得了最佳结果,在CAVE和KAUST上分别比DUN高出58.6%和20.3%。仅使用16通道MS输入会降低结果,但仍然比之前使用完整HS输入的方法高出41%和2%。在未包含在训练中的CAVE数据集上,所提出的方法比比较的方法泛化能力显著更好。

5.2. Beyond RGB数据集

Beyond RGB数据集的评估是在随机选择的80%/10%/10% 训练/验证/测试划分上进行的,该划分在实验室场景和现场场景之间单独进行,以避免实验室场景在10%的划分中过度代表。

模型在不包含比色参考的场景的随机256x256裁剪块上进行训练。我们评估了所提出方法在Beyond RGB数据上的性能,并与GrayWorld (GW) [9,32]、GrayEdge (GE)、LRMF和PWIR进行了比较。我们无法在Beyond RGB数据集上评估DUN,因为它需要反射率数据进行训练。

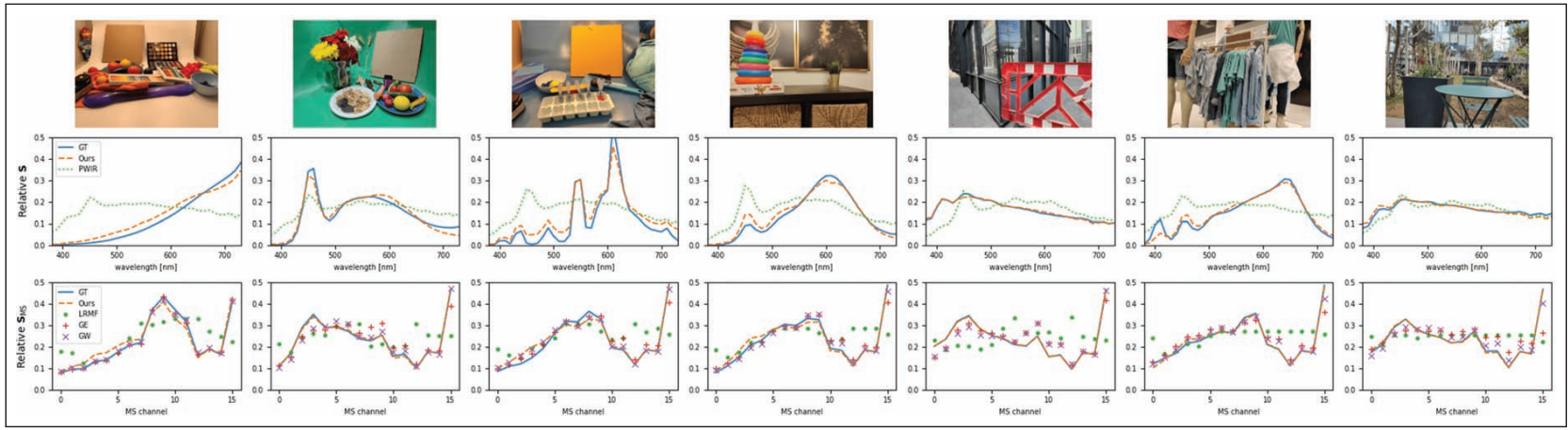

表3显示了Beyond RGB实验室和现场场景上ΔAHS和ΔAMS的统计数据,样本结果如图4所示。GrayWorld、GrayEdge和LRMF仅使用ΔAMS进行评估,因为它们在Beyond RGB上的自然输出是MS传感器原始空间中的一个16通道向量,并且由于我们真实世界滤光片的光谱响应(图S1)不如HS数据中通常发现的响应那样干净和窄,直接从SMS转换到S会导致较大误差。

我们观察到,所提出方法在Beyond RGB上的ΔAHS量级与在KAUST和CAVE数据集上评估时(表2)所达到的量级相似,尽管它使用的是适用于移动设备的真实世界MS传感器。这一结果,加上即使在减少通道数的情况下仍在SR数据集上实现的SoTA性能,强调了在移动设备上使用MS传感器解决ISE问题的潜力。我们注意到PWIR在实验室图像上的表现比在现场图像上更差,这可能表明它难以泛化到远离普朗克轨迹的光源。

5.3. MS与RGB融合

利用Beyond RGB中的RGB数据,我们展示了所提出方法的一个简单扩展,以包含来自不同设备的RGB和MS数据。我们使用三种不同的输入模式训练我们的方法:(1) 仅MS数据,如第4节和第5.2节所述。(2) 仅RGB数据,通过将RGB图像作为单个三元组输入输入到我们的方法中。以及 (3) MS和RGB数据的融合,通过使用来自RGB图像的附加三元组扩展我们的标准MS算法。对于RGB数据,我们使用Oppo Find X5 Pro CPH2305或Samsung Galaxy S21 Plus SM-G996B设备捕获的原始RGB图像作为输入。所有评估均使用相同的80%/10%/10%训练/验证/测试划分进行。MS版本和融合版本的输出是我们的标准 S,而RGB版本则被训练为输出 SXYZ。

表4显示了使用所提出方法的不同版本在Beyond RGB数据集上的ΔAHS和ΔAXYZ统计数据。ΔAXYZ结果清楚地显示了使用MS数据相比RGB的好处。此外,MS和RGB融合的结果略微但持续地优于MS版本,这显示了基于MS和RGB融合的ISE解决方案的潜力。

图4. Beyond RGB测试集的样本结果: 顶部:场景的RGB图像。中部:我们的方法和PWIR方法的光谱估计结果与真实值(GT)的对比。底部:我们的方法、LRMF、GE和GW方法的MS通道估计结果与真实值(GT)的对比。

图4. Beyond RGB测试集的样本结果: 顶部:场景的RGB图像。中部:我们的方法和PWIR方法的光谱估计结果与真实值(GT)的对比。底部:我们的方法、LRMF、GE和GW方法的MS通道估计结果与真实值(GT)的对比。

6. 总结

局限性(Limitations): 与高光谱(HS)和光谱反射率(SR)数据集相比,Beyond RGB 受限于一组特定的光谱响应滤光片。因此,使用Beyond RGB来测试最佳滤光片或为数据收集时所用滤光片之外的其他光谱响应校准算法是不切实际的。此外,所使用的相机未经过光度校准,因此Beyond RGB不能用于提取绝对光谱。

未来工作(Future Work): 我们期望未来的工作可以探索利用MS数据来提高RGB相机的颜色准确性,并改进其白平衡算法,因为白平衡的全局光照估计步骤与ISE密切相关。进一步的工作还可以探索应用那些在颜色恒常性算法中已被证明有效的技术和计算框架,并利用数据集中存在多个相机的特点来评估跨相机的MS/RGB算法。理解重打光的SR数据与像Beyond RGB这样直接捕获的MS数据之间域差异的来源也将是有益的。

结论(Conclusion): 我们提出了 Beyond RGB,这是一个多样化、大规模的数据集,包含了使用移动MS和RGB相机捕获的各种光源和场景,并附带一个新颖的最先进(SoTA)ISE算法作为我们数据集的一个使用示例。我们在先前基准测试上的SoTA结果表明,借鉴颜色恒常性算法丰富研究中获得的经验可以显著改善ISE任务的性能,并且既然合适的数据已经可用,这条研究途径还存在许多未被开发的潜力。此外,我们通过融合来自不同传感器的RGB和MS数据,展示了我们数据集的用途。我们希望Beyond RGB能够推动未来在MS与RGB数据融合、移动设备的比色准确性、MS增强的颜色恒常性以及ISE的实际应用等方面的研究。