Guli Mall 25/08/12(高级上部分)

一、ElasticSearch-全文检索

1、基本概念

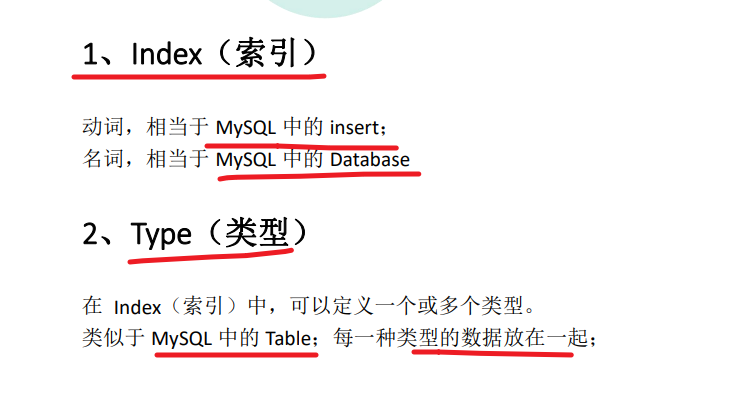

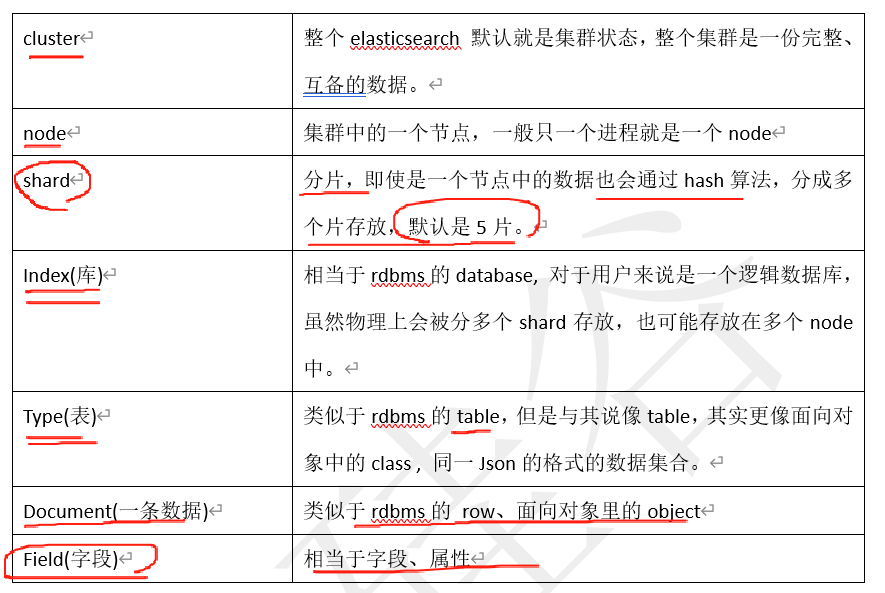

(1)、Index(索引)

相当于mysql中的Database数据库

(2)、Type(类型)

相当于mysql中的Table表,存放数据的

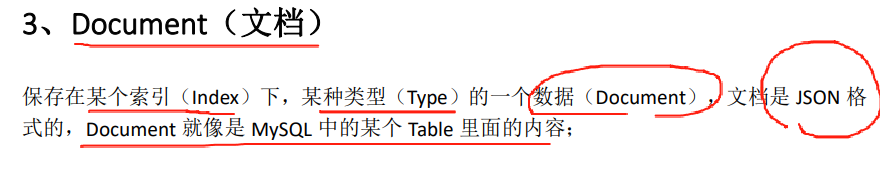

(3)、Document(文档)

ES存放的数据都是以json的格式进行保存,相当于mysql中的表数据

(4)、倒排索引机制

全文搜索引擎目前主流的索引技术就是倒排索引的方式。

传统的保存数据的方式都是 记录→单词

而倒排索引的保存数据的方式是 单词→记录

例如:搜索“红海行动”

基于分词技术构建倒排索引:

首先每个记录保存数据时,都不会直接存入数据库。系统先会对数据进行分词,然后以倒排索引结构保存。

然后等到用户搜索的时候,会把搜索的关键词也进行分词,会把“红海行动”分词分成:红海和行动两个词。

这样的话,先用红海进行匹配,得到id=1和id=2的记录编号,再用行动匹配可以迅速定位id为1,3的记录。

那么全文索引通常,还会根据匹配程度进行打分,显然1号记录能匹配的次数更多。所以显示的时候以评分进行排序的话,1号记录会排到最前面。而2、3号记录也可以匹配到(根据评分排序)。

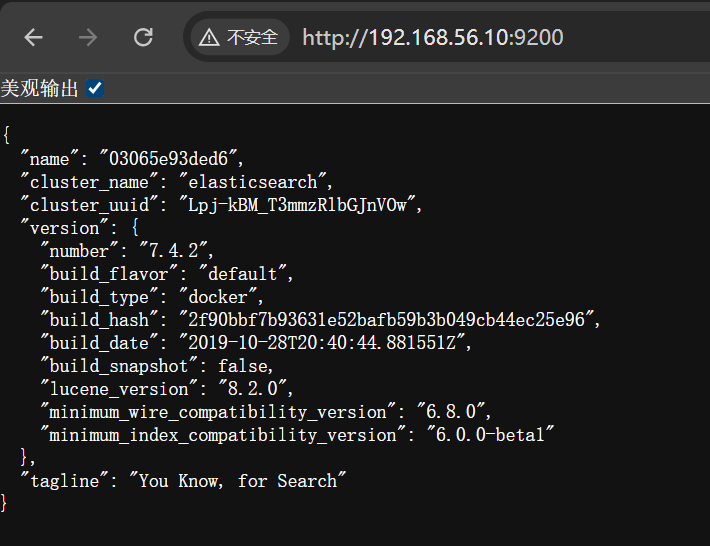

2、安装elastic search

dokcer中安装elastic search

(1)、下载ealastic search和kibana

docker pull elasticsearch:7.4.2 存储和检索数据

docker pull kibana:7.4.2 可视化检索数据free -h 查看服务器可用内存(2)、配置文件挂载

mkdir -p /mydata/elasticsearch/config 创建配置目录echo "http.host: 0.0.0.0" >> /mydata/elasticsearch/config/elasticsearch.ymlmkdir -p /mydata/elasticsearch/data 创建数据目录mkdir -p /mydata/elasticsearch/plugins 创建插件目录//将mydata/elasticsearch/文件夹中文件都可读可写

chmod -R 777 /mydata/elasticsearch/(3)、启动Elastic search

docker run --name elasticsearch -p 9200:9200 -p 9300:9300 \

-e "discovery.type=single-node" \

-e ES_JAVA_OPTS="-Xms64m -Xmx512m" \

-v /mydata/elasticsearch/config/elasticsearch.yml:/usr/share/elasticsearch/config/elasticsearch.yml \

-v /mydata/elasticsearch/data:/usr/share/elasticsearch/data \

-v /mydata/elasticsearch/plugins:/usr/share/elasticsearch/plugins \

-d elasticsearch:7.4.2 设置开机启动 elastic search

docker update elasticsearch --restart=always(4)、启动 kibana

docker run --name kibana -e ELASTICSEARCH_HOSTS=http://192.168.56.10:9200 -p 5601:5601 -d kibana:7.4.2设置开机启动kibana

docker update kibana --restart=always

3、ES 初步检索

(1)、_CAT

查看所有节点 _cat/nodes

查看es健康状况 _cat/health

查看主节点信息 _cat/master

查看所有索引 _cat/indices?v

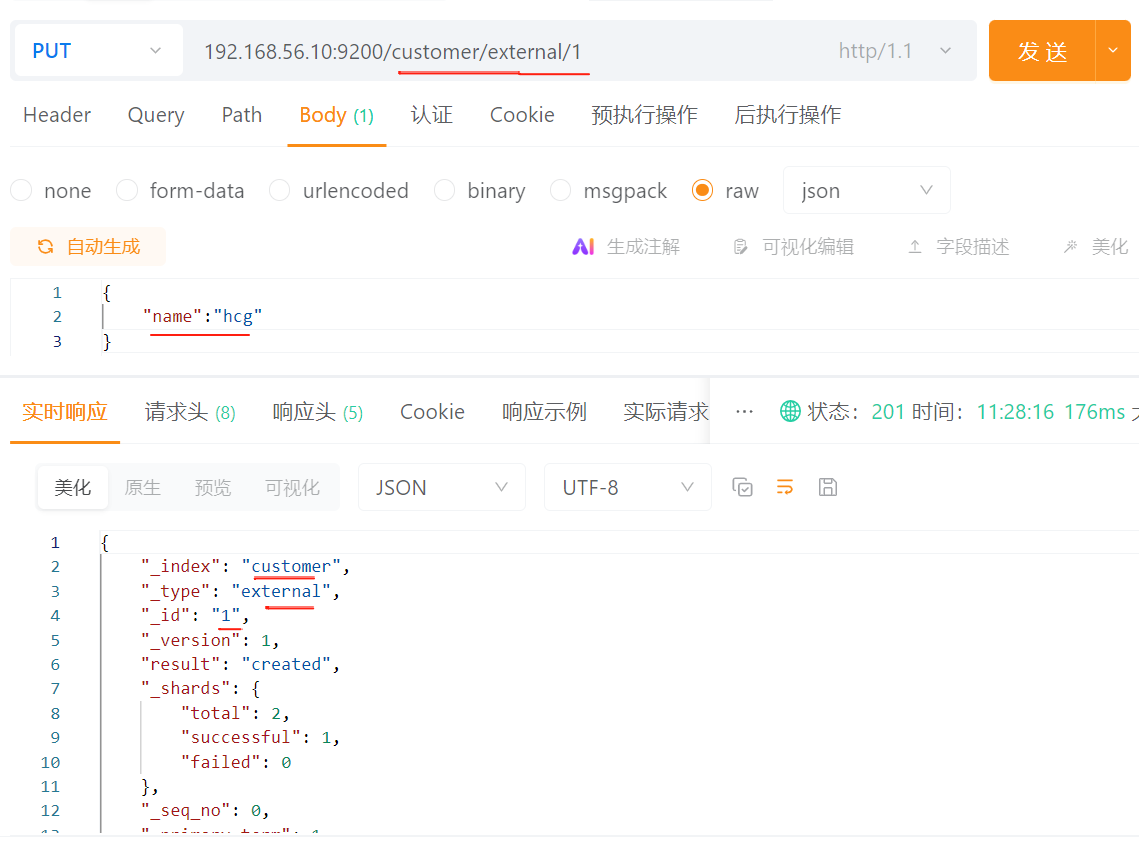

(2)、索引一个文档

保存一个数据,保存在哪个索引的哪个类型下,指定用那个唯一标识

PUT customer/external/1 在 customer索引 下的 external类型 下保存 1号 数据为

这些返回的JSON串的含义;这些带有下划线开头的,称为元数据,反映了当前的基本信息。

"_index": "customer" 表明该数据在哪个索引下;

"_type": "external" 表明该数据在哪个类型下;

"_id": "1" 表明被保存数据的id;

"_version": 1, 被保存数据的版本

"result": "created" 这里是创建了一条数据,如果重新put一条数据,则该状态会变为updated,并且版本号也会发生变化。

PUT和POST都可以

POST新增。如果不指定id,会自动生成id。指定id就会修改这个数据,并新增版本号;

PUT可以新增也可以修改。PUT必须指定id;由于PUT需要指定id,我们一般用来做修改操作,不指定id会报错。

(3)、查看文档

{

"_index": "customer",//在哪个索引

"_type": "external",//在哪个类型

"_id": "1",//记录id

"_version": 3,//版本号

"_seq_no": 6,//并发控制字段,每次更新都会+1,用来做乐观锁

"_primary_term": 1,//同上,主分片重新分配,如重启,就会变化

"found": true,

"_source": {

"name": "John Doe"

}

}

通过“if_seq_no=1&if_primary_term=1 ”,当序列号匹配的时候,才进行修改,否则不修改。

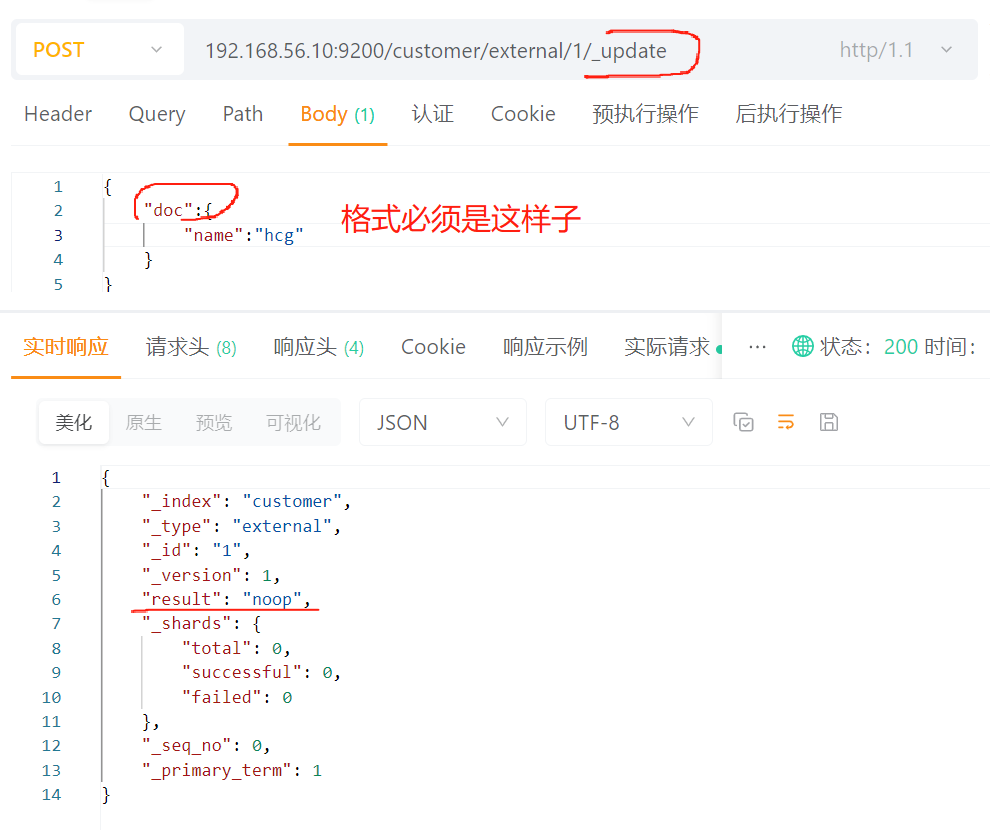

(4)、更新文档

不同:_POST 操作会对比源文档数据,如果相同不会有什么操作,文档version 不增加

PUT 操作总会将数据重新保存并增加 version 版本;

带_update 对比元数据如果一样就不进行任何操作。

看场景; 对于大并发更新,不带 update; 对于大并发查询偶尔更新,带 update;对比更新,重新计算分配规则。

(5)、删除文档或索引

注:elasticsearch并没有提供删除类型的操作,只提供了删除索引和文档的操作。

DELETE customer/external/1 删除索引下的类型的文档

DELETE customer 删除整个索引

(6)、eleasticsearch的批量操作 _bulk

这里的批量操作,当发生某一条执行发生失败时,其他的数据仍然能够接着执行,也就是说彼此之间是独立的。

bulk api以此按顺序执行所有的action(动作)。如果一个单个的动作因任何原因失败,它将继续处理它后面剩余的动作。当bulk api返回时,它将提供每个动作的状态(与发送的顺序相同),所以您可以检查是否一个指定的动作是否失败了。

实例1: 执行多条数据 (postman 报错,在kibana中的Dev_tools中执行)

POST /customer/external/_bulk{"index":{"_id":"1"}}{"name":"John Doe"}{"index":{"_id":"2"}}{"name":"John Doe"}实例2:对于整个索引执行批量操作

POST /_bulk

{"delete":{"_index":"website","_type":"blog","_id":"123"}}

{"create":{"_index":"website","_type":"blog","_id":"123"}}

{"title":"my first blog post"}

{"index":{"_index":"website","_type":"blog"}}

{"title":"my second blog post"}

{"update":{"_index":"website","_type":"blog","_id":"123"}}

{"doc":{"title":"my updated blog post"}}实例3:样本测试数据

es测试数据 - 卡卡罗特琪琪 - 博客园

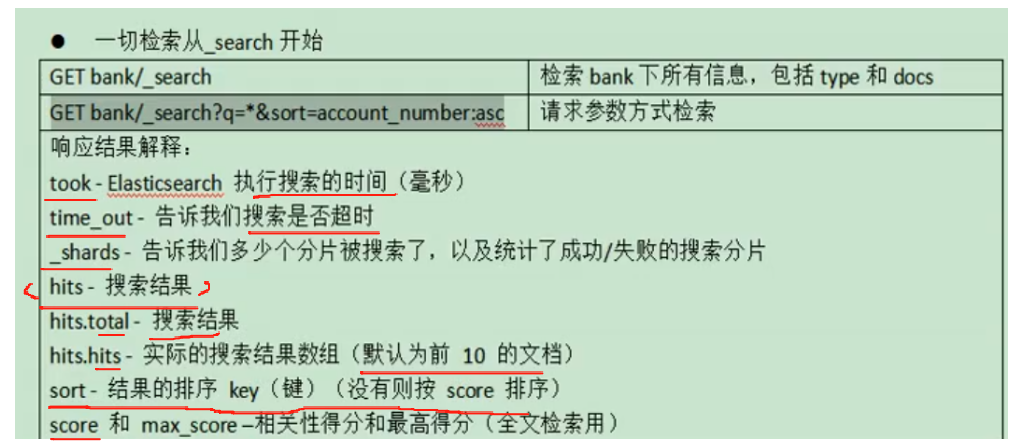

4、检索

(1)、search Api

ES支持两种基本方式检索;

-

通过REST request uri 发送搜索参数 (uri +检索参数)

-

通过REST request body 来发送它们(uri+请求体)

uri+请求体进行检索

GET /bank/_search

{"query": { "match_all": {} },"sort": [{ "account_number": "asc" },{"balance":"desc"}]

}(2)、Query DSL

1、基本语法格式

Elasticsearch提供了一个可以执行查询的Json风格的DSL。这个被称为Query DSL,该查询语言非常全面。

一个查询语句的典型结构

QUERY_NAME:{ //查询的名字

ARGUMENT:VALUE,

ARGUMENT:VALUE,...

}GET bank/_search

{

"query": {

"match_all": {}

},

"from": 0,

"size": 5,

"sort": [

{

"account_number": {

"order": "desc"

}

}

]

}

//match_al查询所有,从第0个数据拿5个数据如果针对于某个字段,那么它的结构如下:

{

QUERY_NAME:{

FIELD_NAME:{

ARGUMENT:VALUE,

ARGUMENT:VALUE,...

}

}

}GET bank/_search

{

"query": {

"match": {

"employer": "Glasstep"

}

}

}//match 匹配查询根据employer = "Glasstep"query定义如何查询;

-

match_all查询类型【代表查询所有的所有】,es中可以在query中组合非常多的查询类型完成复杂查询;

-

除了query参数之外,我们可也传递其他的参数以改变查询结果,如sort,size;

-

from+size限定,完成分页功能;

-

sort排序,多字段排序,会在前序字段相等时后续字段内部排序,否则以前序为准;

2、返回部分字段

_source:展示的数据项

"_source": ["balance","firstname"]

GET bank/_search

{

"query": {

"match_all": {}

},

"from": 0,

"size": 5,

"sort": [

{

"account_number": {

"order": "desc"

}

}

],

"_source": ["balance","firstname"]

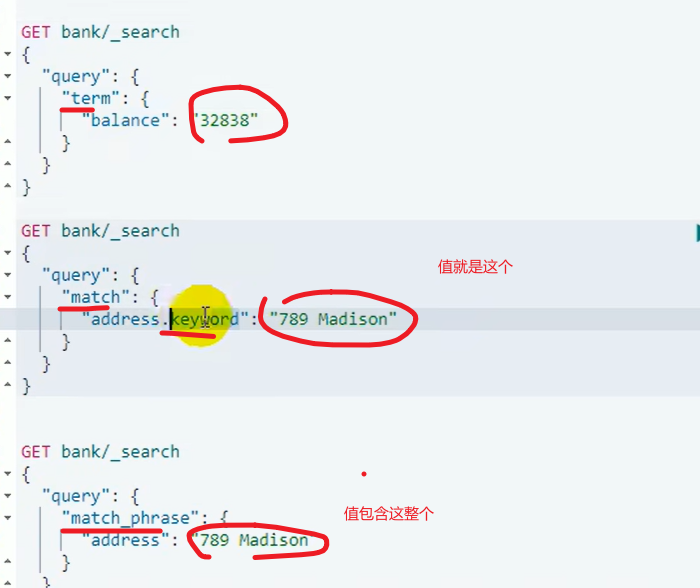

}3、match匹配查询

基本类型(非字符串),"account_number": 20 可加可不加“ ” 不加就是精确匹配

*.keyword:这样就不会进行分词,但是也不会进行模糊匹配,只会精确匹配

match.phrase 这个也不会进行分词,但是会进行模糊匹配

GET bank/_search

{

"query": {

"match": {

"account_number": "20"

}

}

}//match返回account_number=20的数据字符串,全文检索“ ” 模糊查询

GET bank/_search

{

"query": {

"match": {

"address": "kings"

}

}

}//全文检索,最终会按照评分进行排序,会对检索条件进行分词匹配4、match_phrase (短句匹配)

将需要匹配的值当成一整个单词(不分词)进行检索

GET bank/_search

{

"query": {

"match_phrase": {

"address": "mill road"

}

}

}//查处address中包含mill_road的所有记录,并给出相关性得分match_phrase和match的区别,观察如下实例:

match_phrase是做短语匹配

match是分词匹配,例如990 Mill匹配含有990或者Mill的结果

//使用match的keywordGET bank/_search

{

"query": {

"match": {

"address.keyword": "990 Mill"

}

}

}文本字段的匹配,使用keyword,匹配的条件就是要显示字段的全部值,要进行精确匹配的。

match_phrase是做短语匹配,只要文本中包含匹配条件既包含这个短语,就能匹配到。

5、multi_math(多字段匹配)

GET bank/_search

{

"query": {

"multi_match": {

"query": "mill KY",

"fields": [

"state",

"address"

]

}

}

}//state或者address中包含mill,并且在查询过程中,会对于查询条件进行分词。6、bool用来做复合查询

复合语句可以合并,任何其他查询语句,包括符合语句。这也就意味着,复合语句之间可以互相嵌套,可以表达非常复杂的逻辑。

GET bank/_search

{

"query": {

"bool": {

"must": [

{

"match": {

"address": "Howard"

}

},

{

"multi_match": {

"query": "mill KY",

"fields": [

"state",

"address"

]

}

}

]

}

}

}must:必须达到must所列举的所有条件,必须是指定的情况

must_not,必须不匹配must_not所列举的所有条件,必须不是指定的情况

should,应该满足should所列举的条件,应该达到should列举的条件,如果到达会增加相关文档的评分,并不会改变查询的结果。如果query中只有should且只有一种匹配规则,那么should的条件就会被作为默认匹配条件二区改变查询结果。

实例:查询gender=m,并且address=mill的数据,但是age不等于38的,匹配lastName应该等于Wallace的数据

GET bank/_search

{"query": {"bool": {"must": [{"match": {"gender": "M"}},{"match": {"address": "mill"}}],"must_not": [{"term": {"age": {"value": "38"}}}],"should": [{"match": {"lastname": "Wallace"}}]}}

}能够看到相关度越高,得分也越高。

7、Filter(结果过滤)

并不是所有的查询都需要产生分数,特别是哪些仅用于filtering过滤的文档。为了不计算分数,elasticsearch会自动检查场景并且优化查询的执行。

filter在使用过程中,并不会计算相关性得分_score

实例:查询所有匹配address=mill的文档,然后再根据10000<=balance<=20000进行过滤查询结果

GET bank/_search

{"query": {"bool": {"must": [{"match": {"address": "mill"}}],"filter": {"range": {"balance": {"gte": 10000,"lte": 20000}}}}}

}在boolean查询中,must, should 和 must_not 元素都被称为查询子句 。 文档是否符合每个“must”或“should”子句中的标准,决定了文档的“相关性得分”。 得分越高,文档越符合您的搜索条件。 默认情况下,Elasticsearch返回根据这些相关性得分排序的文档。

8、term

和match一样。匹配某个属性的值。全文检索字段用match,其他非text字段匹配用term。

也就是说,全文检索字段用match,其他非text字段匹配用term。

9、Aggregation(执行聚合)

聚合提供了从数据中分组和提取数据的能力。最简单的聚合方法大致等于SQL Group by和SQL聚合函数。在elasticsearch中,执行搜索返回this(命中结果),并且同时返回聚合结果,把以响应中的所有hits(命中结果)分隔开的能力。这是非常强大且有效的,你可以执行查询和多个聚合,并且在一次使用中得到各自的(任何一个的)返回结果,使用一次简洁和简化的API啦避免网络往返。

"size":0 size:0不显示搜索数据

aggs:执行聚合。聚合语法如下:

"aggs":{

"aggs_name这次聚合的名字,方便展示在结果集中":{

"AGG_TYPE聚合的类型(avg,term,terms)":{}

}

},

实例:搜索address中包含mill的所有人的年龄分布以及平均年龄,但不显示这些人的详情

GET bank/_search

{"query": {"match": {"address": "mill"}},"size": 0, "aggs": {"ageTerms": {"terms": {"field": "age","size": 10}},"ageAvg": {"avg": {"field": "age"}}}

}

//ageAgg:聚合名字 terms:聚合类型 "field": "age":按照age字段聚合 size:10:取出前十种age

//avg:平均值聚合类型

//不显示这些人的详情,只看聚合结果实例:按照年龄聚合,并且求这些年龄段的这些人的平均薪资

GET bank/_search

{"query": {"match_all": {}},"aggs": {"ageTerms": {"terms": {"field": "age","size": 100},"aggs": {"balanceAvg": {"avg": {"field": "balance"}}}}}

}实例:查出所有年龄分布,并且这些年龄段中M的平均薪资和F的平均薪资以及这个年龄段的总体平均薪资

GET bank/_search

{"query": {"match_all": {}},"size": 0, "aggs": {"ageTerms": {"terms": {"field": "age","size": 10},"aggs": {"genderTerms": {"terms": {"field": "gender.keyword","size": 10},"aggs": {"balanceAvg": {"avg": {"field": "balance"}}}},"balanceAvg" : {"avg": {"field": "balance"}}}}}

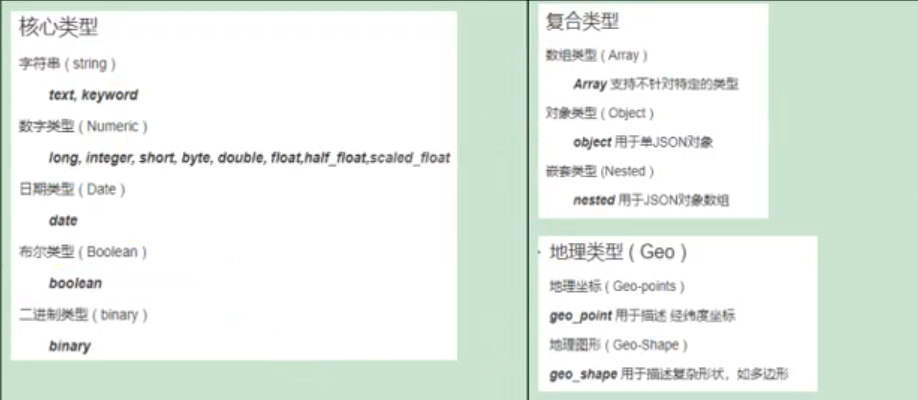

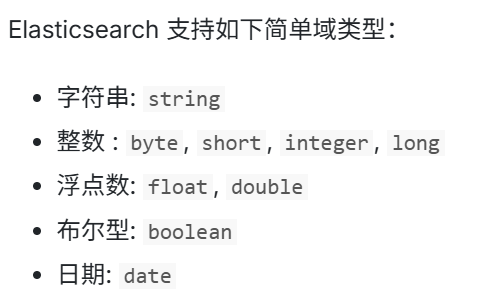

}(3)、Mapping

1、字段类型

2、映射

Mapping(映射) Maping是用来定义一个文档(document),以及它所包含的属性(field)是如何存储和索引的。比如:使用maping来定义:

-

哪些字符串属性应该被看做全文本属性(full text fields);

-

哪些属性包含数字,日期或地理位置;

-

文档中的所有属性是否都嫩被索引(all 配置);

-

日期的格式;

-

自定义映射规则来执行动态添加属性;

-

查看mapping信息

3、新版本改变

ElasticSearch7-去掉type概念

-

关系型数据库中两个数据表示是独立的,即使他们里面有相同名称的列也不影响使用,但ES中不是这样的。elasticsearch是基于Lucene开发的搜索引擎,而ES中不同type下名称相同的filed最终在Lucene中的处理方式是一样的。

-

两个不同type下的两个user_name,在ES同一个索引下其实被认为是同一个filed,你必须在两个不同的type中定义相同的filed映射。否则,不同type中的相同字段名称就会在处理中出现冲突的情况,导致Lucene处理效率下降。

-

去掉type就是为了提高ES处理数据的效率。

-

-

Elasticsearch 7.x URL中的type参数为可选。比如,索引一个文档不再要求提供文档类型。

-

Elasticsearch 8.x 不再支持URL中的type参数。

-

解决:

将索引从多类型迁移到单类型,每种类型文档一个独立索引

将已存在的索引下的类型数据,全部迁移到指定位置即可。详见数据迁移

4、创建映射

创建索引并指定属性的映射规则(相当于新建表并制定字段和字段类型)

PUT /my_index

{"mappings": {"properties": {"age": {"type": "integer"},"email": {"type": "keyword"},"name": {"type": "text"}}}

}5、查看映射

GET /my_index

//"index" : false 是否被索引即能被检索到,默认是true

{

"my_index" : {

"aliases" : { },

"mappings" : {

"properties" : {

"age" : {

"type" : "integer"

},

"email" : {

"type" : "keyword"

},

"employee-id" : {

"type" : "keyword",

"index" : false

},

"name" : {

"type" : "text"

}

}

},

"settings" : {

"index" : {

"creation_date" : "1588410780774",

"number_of_shards" : "1",

"number_of_replicas" : "1",

"uuid" : "ua0lXhtkQCOmn7Kh3iUu0w",

"version" : {

"created" : "7060299"

},

"provided_name" : "my_index"

}

}

}

}

6、添加新的字段映射

这里的 "index": false,表明新增的字段不能被检索,只是一个冗余字段。

PUT /my_index/_mapping

{"properties": {"employee-id": {"type": "keyword","index": false}}

}更新映射:对于已经存在的字段映射,我们不能更新。更新必须创建新的索引,进行数据迁移

7、数据迁移

先创建new_twitter的正确映射。然后使用如下方式进行数据迁移。

// 固定写法

POST _reindex

{"source":{"index":"twitter"},"dest":{"index":"new_twitters"}

}将旧索引的type下的数据进行迁移

// 固定写法

POST _reindex

{"source":{"index":"twitter","type":"twitter"},"dest":{"index":"new_twitters"}

}(4)、分词

一个tokenizer(分词器)接收一个字符流,将之分割为独立的tokens(词元,通常是独立的单词),然后输出tokens流。

POST _analyze

{"analyzer": "standard","text": "The 2 QUICK Brown-Foxes jumped over the lazy dog's bone."

}下载ik分词器

wgethttps://github.com/medcl/elasticsearch-analysis-ik/releases/download/v7.6.2/elasticsearch-analysis-ik-7.6.2.zip![]() https://github.com/medcl/elasticsearch-analysis-ik/releases/download/v7.6.2/elasticsearch-analysis-ik-7.6.2.zip

https://github.com/medcl/elasticsearch-analysis-ik/releases/download/v7.6.2/elasticsearch-analysis-ik-7.6.2.zip

GET my_index/_analyze

{"analyzer": "ik_smart", "text":"我是中国人"

}