《动手学深度学习v2》学习笔记 | 2.3 线性代数

写在前面

本文为《动手学深度学习v2》的学习笔记。本着自己学习、分享他人的态度,分享学习笔记,希望能对大家有所帮助。

本文为同步更新版本,文章格式可能存在问题,建议阅读以下版本:

《动手学深度学习v2》学习笔记-合集![]() https://mp.weixin.qq.com/mp/appmsgalbum?__biz=MzkwMjM0MzA5MA==&action=getalbum&album_id=3180615146931748866#wechat_redirect

https://mp.weixin.qq.com/mp/appmsgalbum?__biz=MzkwMjM0MzA5MA==&action=getalbum&album_id=3180615146931748866#wechat_redirect

目录

-

2.3 线性代数

-

2.3.1 标量

-

2.3.2 向量

-

2.3.3 矩阵

-

2.3.4 张量

-

2.3.5 张量算法的基本性质

-

2.3.6 降维

-

2.3.7 点积(Dot Product)

-

2.3.8 矩阵-向量积

-

2.3.9 矩阵-矩阵乘法

-

2.3.10 范数

-

2.3 线性代数

参考资料:

视频:https://www.bilibili.com/video/BV1eK4y1U7Qy

教材:https://zh.d2l.ai/chapter_preliminaries/linear-algebra.html#sec-linear-algebra

2.3.1 标量

代码实现:

标量由只有一个元素的张量表示。

import torchx = torch.tensor(3.0)

y = torch.tensor(2.0)

x + y, x * y, x / y, x**y

# (tensor(5.), tensor(6.), tensor(1.5000), tensor(9.))

2.3.2 向量

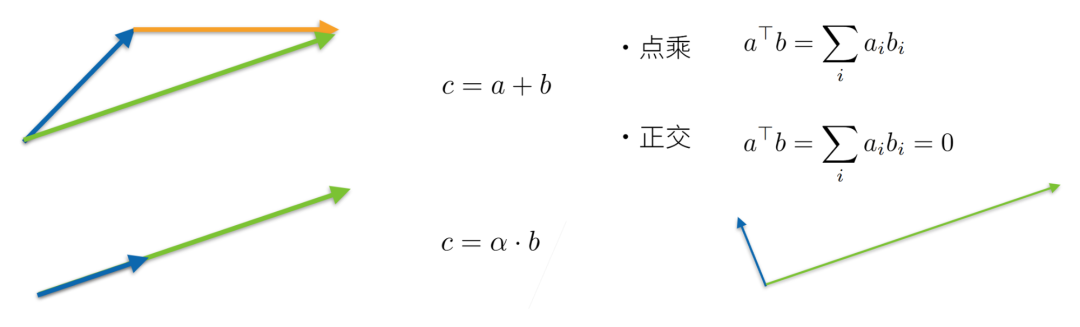

简单操作:

长度:

即 L2范数

代码实现:

向量可以被视为标量值组成的列表。

x = torch.arange(4)

x

# tensor([0, 1, 2, 3])

我们可以使用下标来引用向量的任一元素。

x[3]

# tensor(3)

在数学中,向量 可以写为:

访问向量的长度

len(x)

# 4

向量是只有一个轴的张量,形状只有一个元素。

x.shape

# torch.Size([4])

2.3.3 矩阵

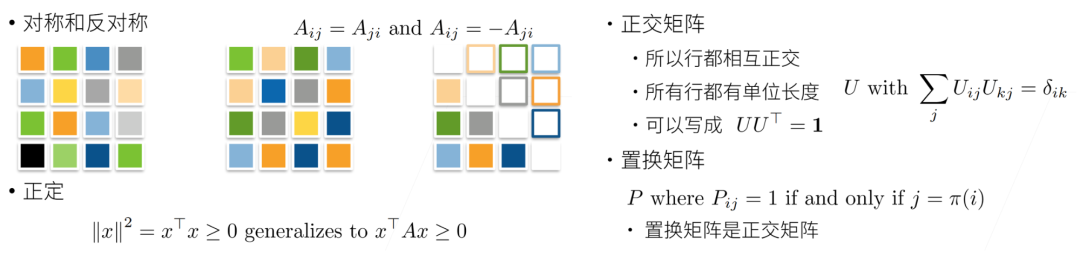

简单操作:

范数:

取决于如何衡量 和 的长度

常见范数:

-

矩阵范数:最小的满足上面公式的值

-

Frobenius 范数:

特殊矩阵:

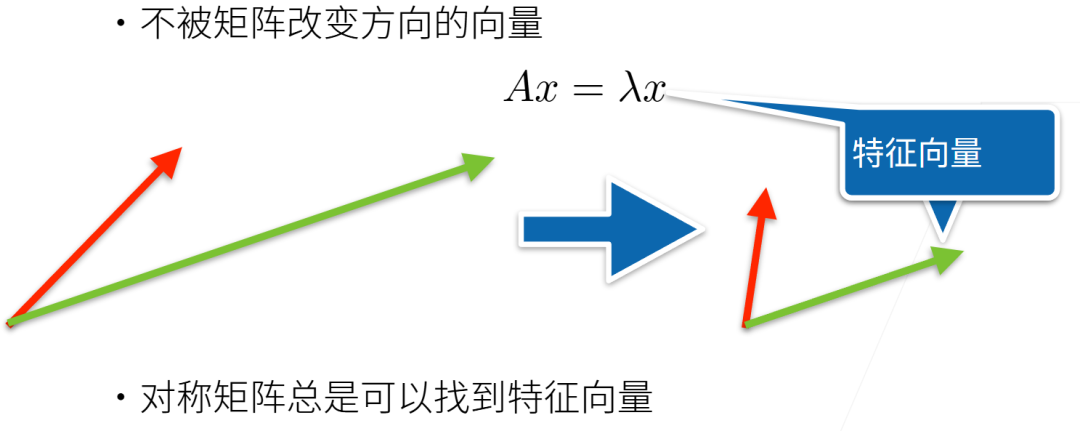

特征向量和特征值:

代码实现:

通过指定两个分量 和 来创建一个形状为 的矩阵

A = torch.arange(20).reshape(5, 4)

A

# tensor([[ 0, 1, 2, 3],

# [ 4, 5, 6, 7],

# [ 8, 9, 10, 11],

# [12, 13, 14, 15],

# [16, 17, 18, 19]])

当我们交换矩阵的行和列时,结果称为矩阵的转置(transpose)。通常用 来表示矩阵的转置。在代码中访问矩阵的转置:

A.T

# tensor([[ 0, 4, 8, 12, 16],

# [ 1, 5, 9, 13, 17],

# [ 2, 6, 10, 14, 18],

# [ 3, 7, 11, 15, 19]])

作为方阵的一种特殊类型,对称矩阵(symmetric matrix) 等于其转置:。这里定义一个对称矩阵 :

B = torch.tensor([[1, 2, 3], [2, 0, 4], [3, 4, 5]])

B

# tensor([[1, 2, 3],

# [2, 0, 4],

# [3, 4, 5]])B == B.T

# tensor([[True, True, True],

# [True, True, True],

# [True, True, True]])

2.3.4 张量

就像向量是标量的推广,矩阵是向量的推广一样,我们可以构建具有更多轴的数据结构。张量是描述具有任意数量轴的 维数组的通用方法。例如,向量是一阶张量,矩阵是二阶张量。

X = torch.arange(24).reshape(2, 3, 4)

X

# tensor([[[ 0, 1, 2, 3],

# [ 4, 5, 6, 7],

# [ 8, 9, 10, 11]],

#

# [[12, 13, 14, 15],

# [16, 17, 18, 19],

# [20, 21, 22, 23]]])

2.3.5 张量算法的基本性质

给定具有相同形状的任意两个张量,任何按元素二元运算的结果都将是相同形状的张量。

A = torch.arange(20, dtype=torch.float32).reshape(5, 4)

B = A.clone() # 通过分配新内存,将A的一个副本分配给B

A, A + B

# (tensor([[ 0., 1., 2., 3.],

# [ 4., 5., 6., 7.],

# [ 8., 9., 10., 11.],

# [12., 13., 14., 15.],

# [16., 17., 18., 19.]]),

# tensor([[ 0., 2., 4., 6.],

# [ 8., 10., 12., 14.],

# [16., 18., 20., 22.],

# [24., 26., 28., 30.],

# [32., 34., 36., 38.]]))

两个矩阵的按元素乘法称为Hadamard积(Hadamard product)(数学符号 )

A * B

# tensor([[ 0., 1., 4., 9.],

# [ 16., 25., 36., 49.],

# [ 64., 81., 100., 121.],

# [144., 169., 196., 225.],

# [256., 289., 324., 361.]])

将张量乘以或加上一个标量不会改变张量的形状,其中张量的每个元素都将与标量相加或相乘。

a = 2

X = torch.arange(24).reshape(2, 3, 4)

a + X, (a * X).shape

# (tensor([[[ 2, 3, 4, 5],

# [ 6, 7, 8, 9],

# [10, 11, 12, 13]],

#

# [[14, 15, 16, 17],

# [18, 19, 20, 21],

# [22, 23, 24, 25]]]),

# torch.Size([2, 3, 4]))

2.3.6 降维

计算其元素的和

x = torch.arange(4, dtype=torch.float32)

x, x.sum()

# (tensor([0., 1., 2., 3.]), tensor(6.))

表示任意形状张量的元素和

A = torch.arange(20, dtype=torch.float32).reshape(5, 4)

A.shape, A.sum()

# (torch.Size([5, 4]), tensor(190.))

默认情况下,调用求和函数 sum() 会沿所有的轴降低张量的维度,使它变为一个标量。我们还可以指定张量沿哪一个轴来通过求和降低维度。

A_sum_axis0 = A.sum(axis=0)

A_sum_axis0, A_sum_axis0.shape

# (tensor([40., 45., 50., 55.]), torch.Size([4]))A_sum_axis1 = A.sum(axis=1)

A_sum_axis1, A_sum_axis1.shape

# (tensor([ 6., 22., 38., 54., 70.]), torch.Size([5]))A.sum(axis=[0, 1]) # 结果和 A.sum() 相同

# tensor(190.)

一个与求和相关的量是平均值(mean或average)。 我们通过将总和除以元素总数来计算平均值。

A.mean(), A.sum() / A.numel()

# (tensor(9.5000), tensor(9.5000))

也可以沿指定轴来计算平均值。

A.mean(axis=0), A.sum(axis=0) / A.shape[0]

# (tensor([ 8., 9., 10., 11.]), tensor([ 8., 9., 10., 11.]))

非降维求和

有时在调用函数来计算总和或均值时保持轴数不变会很有用

sum_A = A.sum(axis=1, keepdims=True)

sum_A

# tensor([[ 6.],

# [22.],

# [38.],

# [54.],

# [70.]])

例如,由于 sum_A 在对每行进行求和后仍保持两个轴,我们可以通过广播将 A 除以 sum_A。

A / sum_A

# tensor([[0.0000, 0.1667, 0.3333, 0.5000],

# [0.1818, 0.2273, 0.2727, 0.3182],

# [0.2105, 0.2368, 0.2632, 0.2895],

# [0.2222, 0.2407, 0.2593, 0.2778],

# [0.2286, 0.2429, 0.2571, 0.2714]])

某个轴计算A元素的累积总和

A.cumsum(axis=0)

# tensor([[ 0., 1., 2., 3.],

# [ 4., 6., 8., 10.],

# [12., 15., 18., 21.],

# [24., 28., 32., 36.],

# [40., 45., 50., 55.]])

2.3.7 点积(Dot Product)

向量的点积是相同位置的元素乘积的和,dot() 函数只能求两个 1D 向量的点积。

y = torch.ones(4, dtype = torch.float32)

x, y, torch.dot(x, y)

# (tensor([0., 1., 2., 3.]), tensor([1., 1., 1., 1.]), tensor(6.))

我们也可以通过执行按元素乘法,然后进行求和来表示两个向量的点积:

torch.sum(x * y)

# tensor(6.)

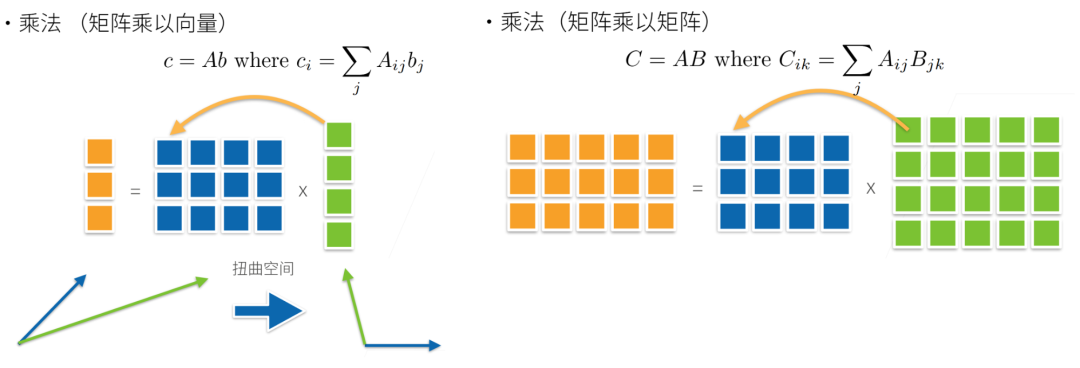

2.3.8 矩阵-向量积

让我们将矩阵 用它的行向量表示:

其中每个 都是行向量,表示矩阵的第 行。矩阵向量积 是一个长度为 的列向量,其第 个元素是点积 :

在代码中使用张量表示矩阵-向量积,我们使用 mv() 函数。 当我们为矩阵A和向量x调用 torch.mv(A, x) 时,会执行矩阵-向量积。注意,A 的列维数(沿轴 1 的长度)必须与 x 的维数(其长度)相同。

A.shape, x.shape, torch.mv(A, x)

# (torch.Size([5, 4]), torch.Size([4]), tensor([ 14., 38., 62., 86., 110.]))

2.3.9 矩阵-矩阵乘法

假设有两个矩阵和:

用行向量表示矩阵的第行,并让列向量作为矩阵的第列。要生成矩阵积,最简单的方法是考虑的行向量和的列向量:

当我们简单地将每个元素计算为点积:

B = torch.ones(4, 3)

torch.mm(A, B)

# tensor([[ 6., 6., 6.],

# [22., 22., 22.],

# [38., 38., 38.],

# [54., 54., 54.],

# [70., 70., 70.]])

矩阵-矩阵乘法可以简单地称为矩阵乘法,不应与“Hadamard积”混淆。

2.3.10 范数

范数是向量元素平方和的平方根:

其中,在 范数中常常省略下标 ,也就是说 等同于 。在代码中,我们可以按如下方式计算向量的 范数。

u = torch.tensor([3.0, -4.0])

torch.norm(u)

# tensor(5.)

范数表示为向量元素的绝对值之和:,与 范数相比, 范数受异常值的影响较小。为了计算 范数,我们将绝对值函数和按元素求和组合起来。

torch.abs(u).sum()

# tensor(7.)

范数和 范数都是更一般的 范数的特例:

类似于向量的 范数,矩阵 的Frobenius范数(Frobenius norm)是矩阵元素平方和的平方根:

Frobenius 范数满足向量范数的所有性质,它就像是矩阵形向量的 范数。调用以下函数将计算矩阵的 Frobenius 范数。

torch.norm(torch.ones((4, 9)))

# tensor(6.)

--------------- 结束 ---------------

注:本文为个人学习笔记,仅供大家参考学习,不得用于任何商业目的。如有侵权,请联系作者删除。