Kafka 副本同步异常与 ISR 收缩故障排查实录

背景

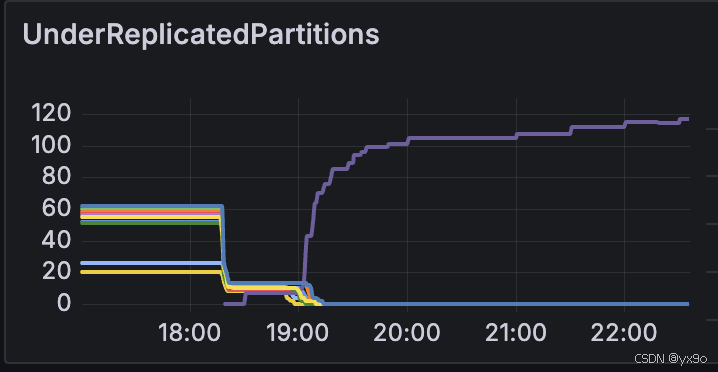

某高流量 Kafka 集群(原 10G 网卡)在切中心时频繁触发带宽报警,扩容至 25G 网卡后出现副本同步异常:

- 操作流程:停机→升级网卡→重启→触发分区同步→切换首选 Leader

- 现象:

- 写入流量上升后,ISR(同步副本集合)频繁收缩

- 部分分区退化为单副本

- 根因:新旧节点

message.max.bytes配置不一致导致同步失败

关键问题分析

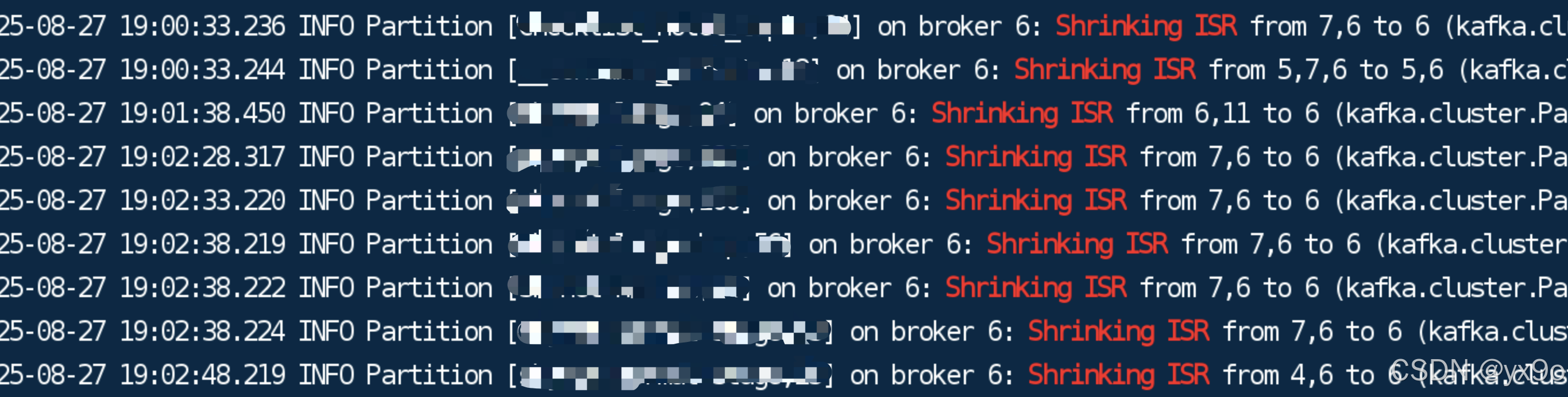

- ISR 收缩本质:Broker 节点被踢出 ISR,意味着副本同步落后,无法跟上 Leader 的数据进度。

- 排查路径:重点关注同步线程(如 ReplicaFetcherThread)相关日志,寻找报错原因。

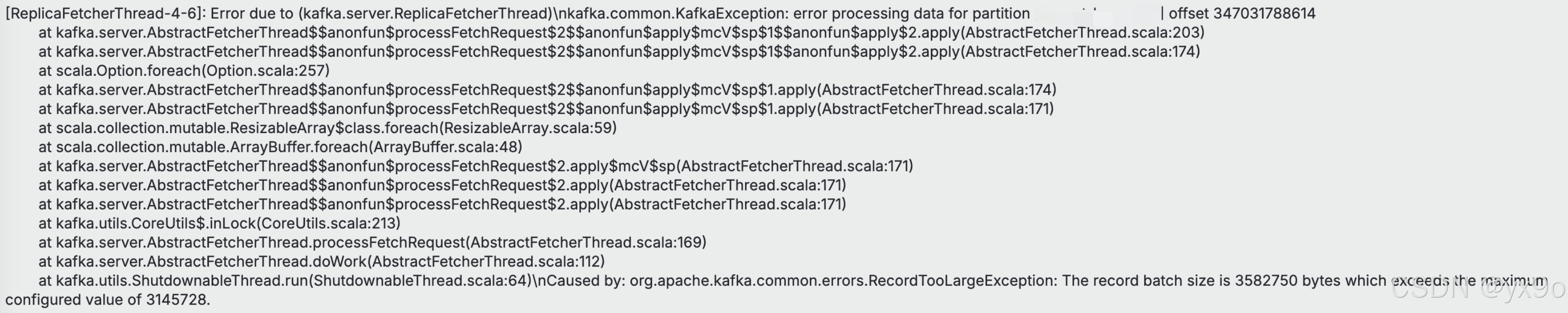

- 典型报错:RecordTooLargeException —— Follower 拉取 Leader 消息时,批次大小超过自身配置上限。

- 典型报错:RecordTooLargeException —— Follower 拉取 Leader 消息时,批次大小超过自身配置上限。

根因复盘

- 配置不一致导致同步失败

- 新节点升级后采用新配置(如 message.max.bytes=10485760,即10MB)

- 旧节点遗留旧配置(如 message.max.bytes=3145728,即3MB)

- 同步失败链路

- 新 Leader 节点可接收大消息

- 旧 Follower 节点拉取大消息时超限,消费线程异常断开

- Follower 被 Leader 剔除出 ISR

- 多数 Follower 失联,分区退化为单副本

最佳实践建议

- 运维变更前后,务必全量核查关键 Kafka 配置参数一致性

- 建议用自动化脚本统一检查和修复配置,降低人工疏漏

- 变更后持续监控ISR、分区健康、Lag等指标

- 建议建立配置审计机制,每次升级或扩容都要 review 配置一致性

总结

Kafka 副本同步高度依赖于核心参数的一致性,message.max.bytes 等配置如不统一,极易引发副本同步失败、ISR 收缩和分区退化等高危故障。

务必在运维升级、扩容、迁移等操作前后,统一配置并做好监控。