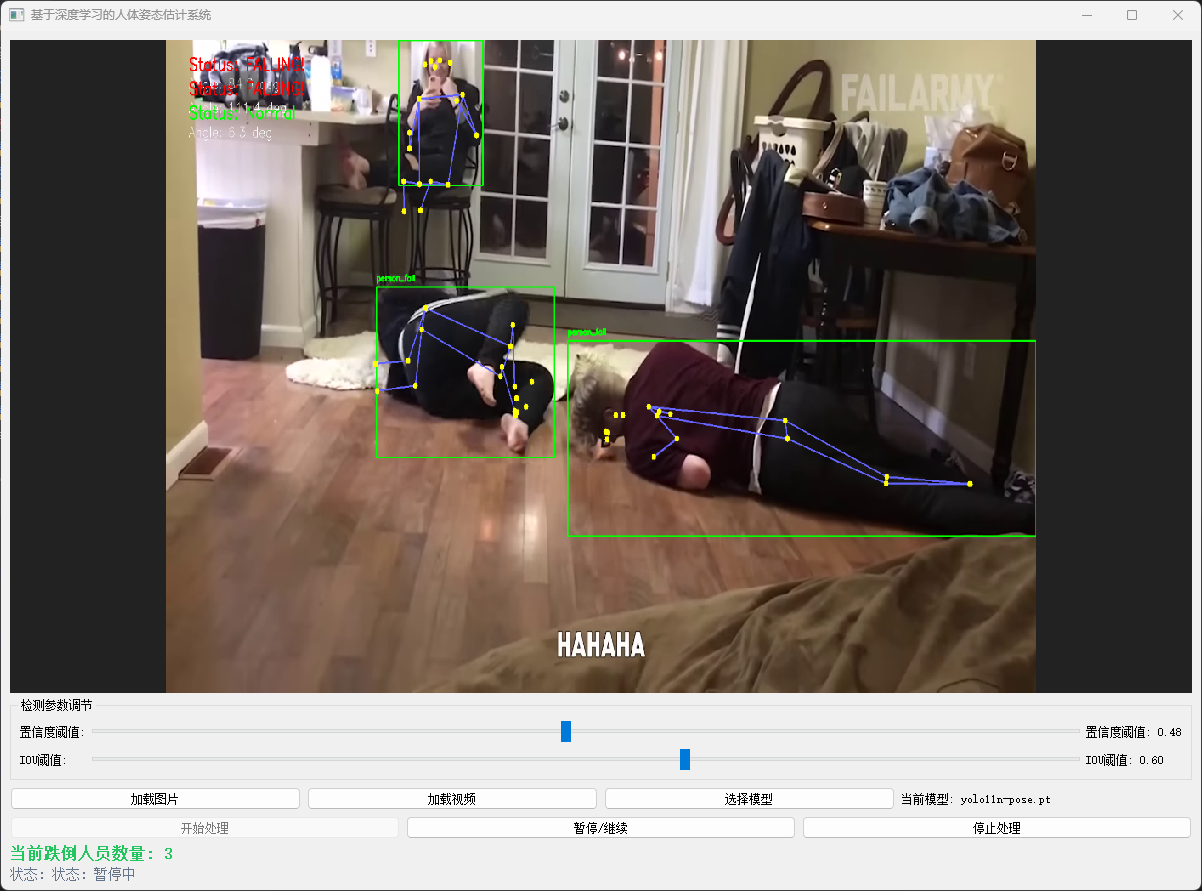

【图像算法 - 25】基于深度学习 YOLOv11 与 OpenCV 实现人员跌倒识别系统(人体姿态估计版本)

摘要: 本文将详细介绍如何利用先进的深度学习目标检测算法 YOLOv11 结合 OpenCV 计算机视觉库,构建一个高效、实时的人员跌倒识别系统。跌倒检测在智慧养老、安防监控、工业安全等领域至关重要。我们将从环境搭建、数据准备、模型训练到跌倒行为判断逻辑,完整地实现这一智能监控应用。

关键词: YOLOv11, OpenCV, 人员跌倒识别, 行为分析, 深度学习, 人体姿态估计, Python, 智能监控

【图像算法 - 25】基于深度学习 YOLOv11 与 OpenCV 实现人员跌倒识别系统(人体姿态估计版本)

1. 引言

人员跌倒是一种常见的意外事件,尤其对老年人或在特定工作环境中(如工地、工厂)的人员构成严重威胁。及时发现跌倒并进行救助至关重要。传统的监控依赖人工值守,效率低且易遗漏。利用计算机视觉技术实现自动化的跌倒识别,可以大大提高响应速度和安全性。

YOLOv11 以其卓越的速度和精度,非常适合实时视频流中的目标检测任务。OpenCV 提供了强大的图像处理和视频分析功能。本文将结合两者,通过检测人体姿态或运动特征来判断跌倒行为。

2. 技术方案选择

跌倒识别主要有三种思路:

- 基于目标检测 + 规则判断: 使用 YOLOv11 检测出人体,然后根据人体边界框的宽高比、位置变化等特征,结合简单规则判断是否跌倒。

- 基于姿态估计: 使用 YOLOv11 的姿态估计模型(

yolov11n-pose.pt等)检测人体关键点(如头、肩、髋、膝、踝),通过分析关键点的相对位置和角度来判断姿态,从而更精确地识别跌倒。 - 基于目标检测:将跌倒视为一个需要检测的独立目标类别。我们不再先检测“人”,再判断其状态,而是训练一个模型,使其能够直接输出“跌倒”检测结果。

【图像算法 - 06】YOLO 全家桶人体姿态识别完全指南:从 YOLOv8 到 YOLO12 核心原理 + 代码实战,新手入门保姆级教程(附视频详解)

【图像算法 - 24】基于深度学习与 OpenCV 实现人员跌倒识别系统(目标检测方案 - 跌倒即目标)

本文将采用 姿态估计 方案,因为它能提供更丰富的姿态信息,判断更准确。

3. 环境准备

3.1 软件依赖

# 安装 PyTorch (根据你的CUDA版本选择)

pip install torch torchvision torchaudio# 安装 YOLOv11 (包含姿态估计功能)

pip install ultralytics# 安装 OpenCV

pip install opencv-python# 其他

pip install numpy

4. 原理分析:如何通过姿态判断跌倒

跌倒时,人体姿态通常呈现以下特征:

- 身体倾斜角过大: 身体主轴(如从头到髋)与垂直方向的夹角接近或超过90度。

- 关键点相对位置异常: 例如,头部关键点位置远低于髋部或膝盖。

- 运动速度突变: (可选,结合光流或帧间差分)从站立到跌倒瞬间速度变化剧烈。

本文主要利用 身体倾斜角 作为核心判断依据。

5. 核心代码实现

5.1 加载模型

from ultralytics import YOLO

import cv2

import math

import numpy as np# 加载 YOLO11 姿态估计模型

model = YOLO('yolo11n-pose.pt') # 或 yolo11s-pose.pt, 更大模型精度更高

5.2 计算身体倾斜角

def calculate_fall_angle(keypoints):"""根据关键点计算身体倾斜角keypoints: 模型输出的关键点数组,格式为 [x, y, confidence]假设关键点索引:0-鼻子, 5-左肩, 6-右肩, 11-左髋, 12-右髋"""# 选择肩部和髋部关键点计算身体中轴# 取左右肩和左右髋的平均值作为肩中点和髋中点left_shoulder = keypoints[5][:2] # [x, y]right_shoulder = keypoints[6][:2]left_hip = keypoints[11][:2]right_hip = keypoints[12][:2]# 计算中点shoulder_mid = ((left_shoulder[0] + right_shoulder[0]) / 2,(left_shoulder[1] + right_shoulder[1]) / 2)hip_mid = ((left_hip[0] + right_hip[0]) / 2,(left_hip[1] + right_hip[1]) / 2)# 计算向量 (从髋到肩)vector = (shoulder_mid[0] - hip_mid[0], shoulder_mid[1] - hip_mid[1])# 计算与垂直方向(0, -1)的夹角 (使用点积)vertical = (0, -1) # 垂直向上dot_product = vector[0] * vertical[0] + vector[1] * vertical[1]vector_magnitude = math.sqrt(vector[0]**2 + vector[1]**2)vertical_magnitude = 1.0# 避免除零if vector_magnitude == 0:return 90.0 # 默认值cos_angle = dot_product / (vector_magnitude * vertical_magnitude)# 限制在 [-1, 1] 防止数值误差cos_angle = max(min(cos_angle, 1.0), -1.0)angle_rad = math.acos(cos_angle)angle_deg = math.degrees(angle_rad)return angle_deg

5.3 判断跌倒

def is_falling(angle, threshold=60.0):"""根据角度判断是否跌倒angle: 身体倾斜角 (度)threshold: 判断跌倒的阈值 (度),例如60度表示身体倾斜超过60度认为是跌倒"""return angle < threshold # 角度越小,身体越接近水平

5.4 视频流处理与识别

cap = cv2.VideoCapture(0) # 0 表示默认摄像头,或替换为视频文件路径while cap.isOpened():success, frame = cap.read()if not success:print("无法读取视频流")break# 使用 YOLO11 进行姿态估计results = model(frame, stream=True) # stream=True for generatorfor r in results:# 获取关键点keypoints = r.keypointsif keypoints is not None and len(keypoints) > 0:# 遍历检测到的每个人for i, person_kps in enumerate(keypoints.xy.cpu().numpy()): # xy: [x, y]# 计算身体倾斜角angle = calculate_fall_angle(person_kps)# 判断是否跌倒falling = is_falling(angle, threshold=60.0)# 在图像上绘制结果# 绘制关键点和骨架 (使用YOLO11自带的plot方法或手动绘制)# 这里简化,只绘制框和标签# 获取边界框 (可选)# box = r.boxes.xyxy[i].cpu().numpy().astype(int)# x1, y1, x2, y2 = box# 在图像上显示角度和状态status = "FALLING!" if falling else "Normal"color = (0, 0, 255) if falling else (0, 255, 0) # 红色表示跌倒cv2.putText(frame, f'Status: {status}', (50, 50 + i*40),cv2.FONT_HERSHEY_SIMPLEX, 1, color, 2)cv2.putText(frame, f'Angle: {angle:.1f} deg', (50, 80 + i*40),cv2.FONT_HERSHEY_SIMPLEX, 0.8, (255, 255, 255), 1)# (可选) 绘制身体中轴线# shoulder_mid, hip_mid = ... (从calculate_fall_angle获取或重新计算)# cv2.line(frame, tuple(map(int, shoulder_mid)), tuple(map(int, hip_mid)), color, 2)# 显示视频帧cv2.imshow('Person Fall Detection', frame)if cv2.waitKey(1) & 0xFF == ord('q'):breakcap.release()

cv2.destroyAllWindows()

6. 优化与挑战

-

阈值选择:

threshold参数需要根据实际场景(摄像头角度、距离)进行调整和测试。 -

误报:

弯腰、下蹲等动作可能被误判为跌倒。可结合:

- 运动速度: 计算连续帧间关键点的移动速度,跌倒通常伴随快速下落。

- 持续时间: 跌倒状态需要持续一定时间(如多帧)才报警,避免瞬时误判。

- 头部高度: 结合头部关键点离地面的高度。

-

遮挡: 部分身体被遮挡时,关键点检测可能不全或不准。

-

多角度: 摄像头角度对判断影响大,需要针对性调整算法或收集多角度数据训练。

-

实时性: YOLOv11-pose 的推理速度需要满足实时要求,可选择更小的模型(如

yolov11n-pose)或优化硬件。

7. 总结

本文利用 YOLO11 的姿态估计能力,结合简单的几何计算,实现了一个基础的人员跌倒识别系统。该方案思路清晰,实现相对简单,并具有一定的实用性。通过调整判断逻辑和引入更多特征(如速度、持续时间),可以进一步提升系统的准确性和鲁棒性。此技术可广泛应用于智慧养老院、家庭看护、工地安全监控等场景,为人员安全提供智能化保障。