运动想象 (MI) 分类学习系列 (18) : MSVTNet

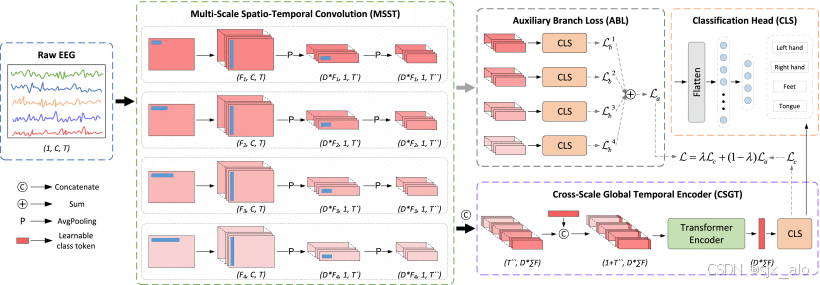

运动想象分类学习系列:用于基于脑电图的运动图像解码的多尺度视觉转换器神经网络

- 0. 引言

- 1. 主要贡献

- 2. 方法

- 3. 结果

-

- 3.1 脑电图数据预处理

- 3.2 解码性能比较

- 3.3 消融实验

- 4. 总结

- 欢迎来稿

论文地址:https://ieeexplore.ieee.org/document/10652246

论文题目:MSVTNet: Multi-Scale Vision Transformer Neural Network for EEG-Based Motor Imagery Decoding

论文代码:https://github.com/SheepTAO/MSVTNet/tree/main

今天介绍一篇有意思的文章,这篇文章在我们自己的数据集下相对于已有的很多方法都达到了一个较高的精度(相对于其它模型有6-8个点的提高)。

为什么有意思:本质是多尺度的EEGNet+Transformer(对于没有使用联合损失而言)。

对比模型:EEGNet、FBCNet、LmdaNet、EEG-Conformer、Labram、Sparcnet。

为什么没使用更多的最近年来的模型:未开源≈不可用(即使你复现也很难出现效果),所以我们用的基本都是