快速理解LLM的temperature和top_p参数

喵法口袋

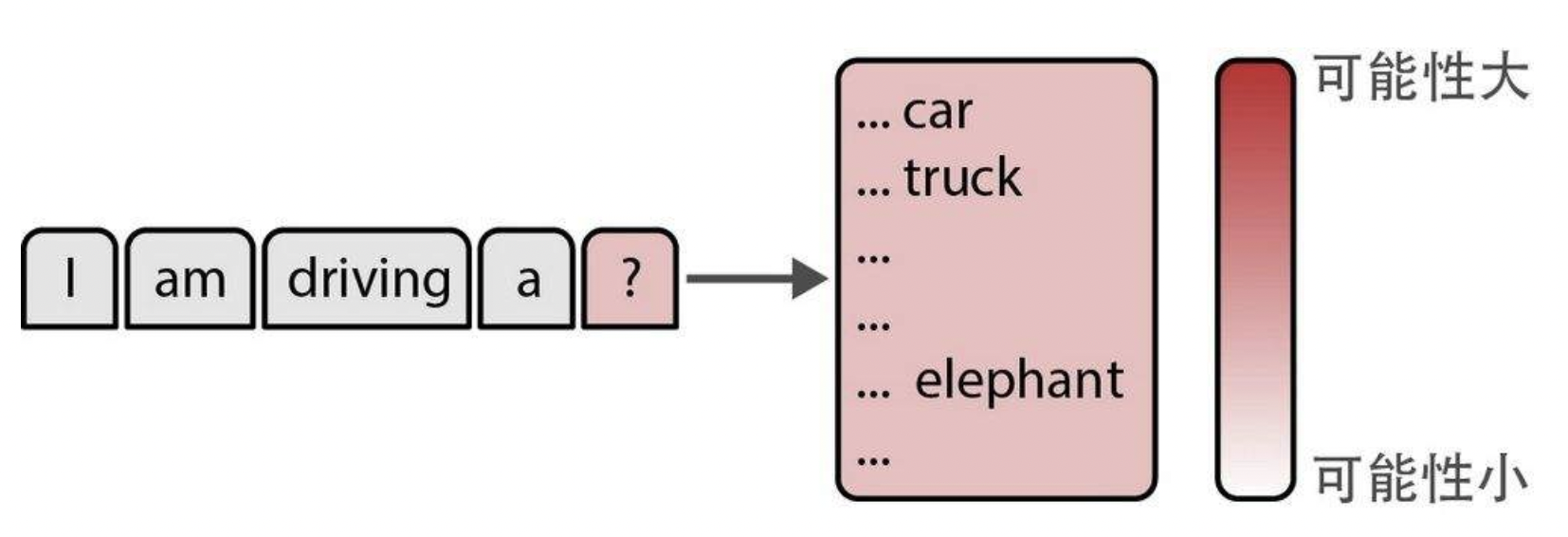

LLM令人兴奋的技术特点之一是,它能够为完全相同的提示词生成不同的响应。每当LLM需要生成一个词元时,它都会为每个可能的词元分配一个可能性分数。如图-1所示,在句子“I am driving a…”(我正在开……)中,a后面接词元car(车)或truck(卡车)的可能性通常比接词元elephant(大象)要大。然而,生成elephant的可能性仍然存在,只是要小得多。

图-1 模型根据可能性选择下一个要生成的词元

temperature参数

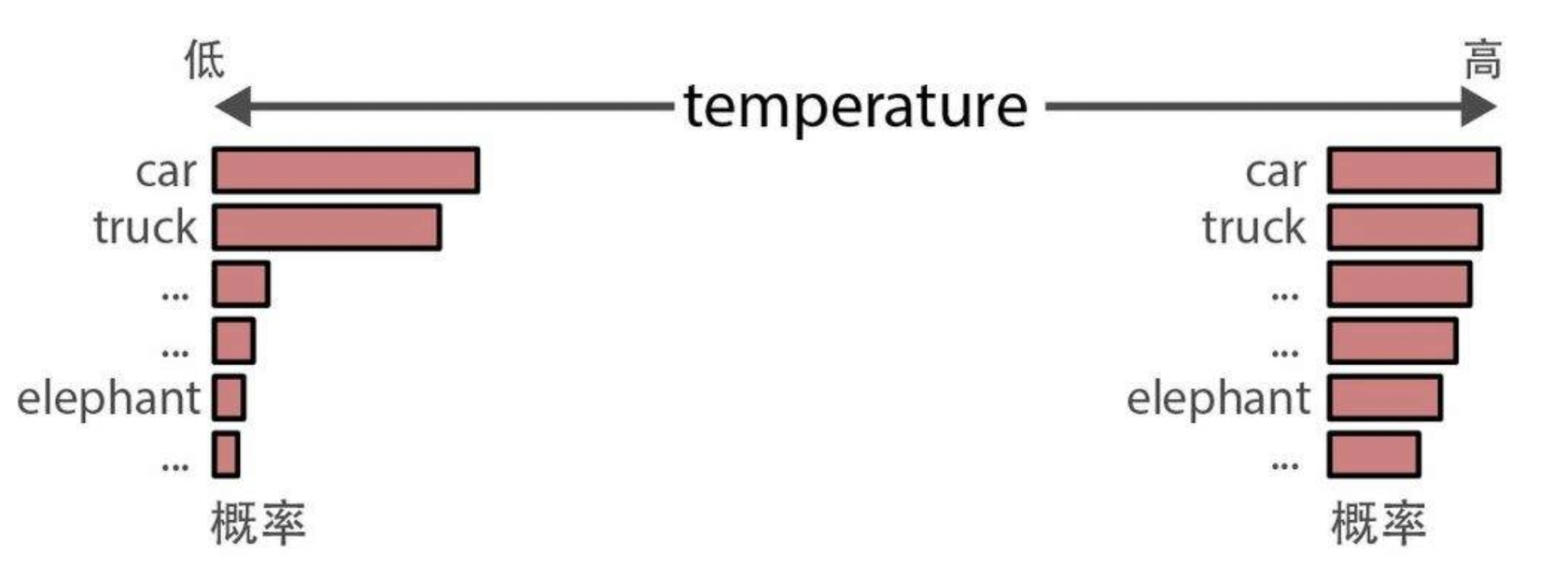

emperature(温度)决定生成文本的随机性或创造性。它定义了选择本来不太可能出现的词元的概率。其基本原理是,temperature为0时每次都会生成相同的响应,因为它总是选择可能性最大的词。如图-2所示,较高的temperature值允许生成可能性更小的词。

图-2

因此,较高的temperature(如0.8)通常会产生更多样化的输出,而较低的temperature(如0.2)会产生更具确定性的输出。

top_p参数

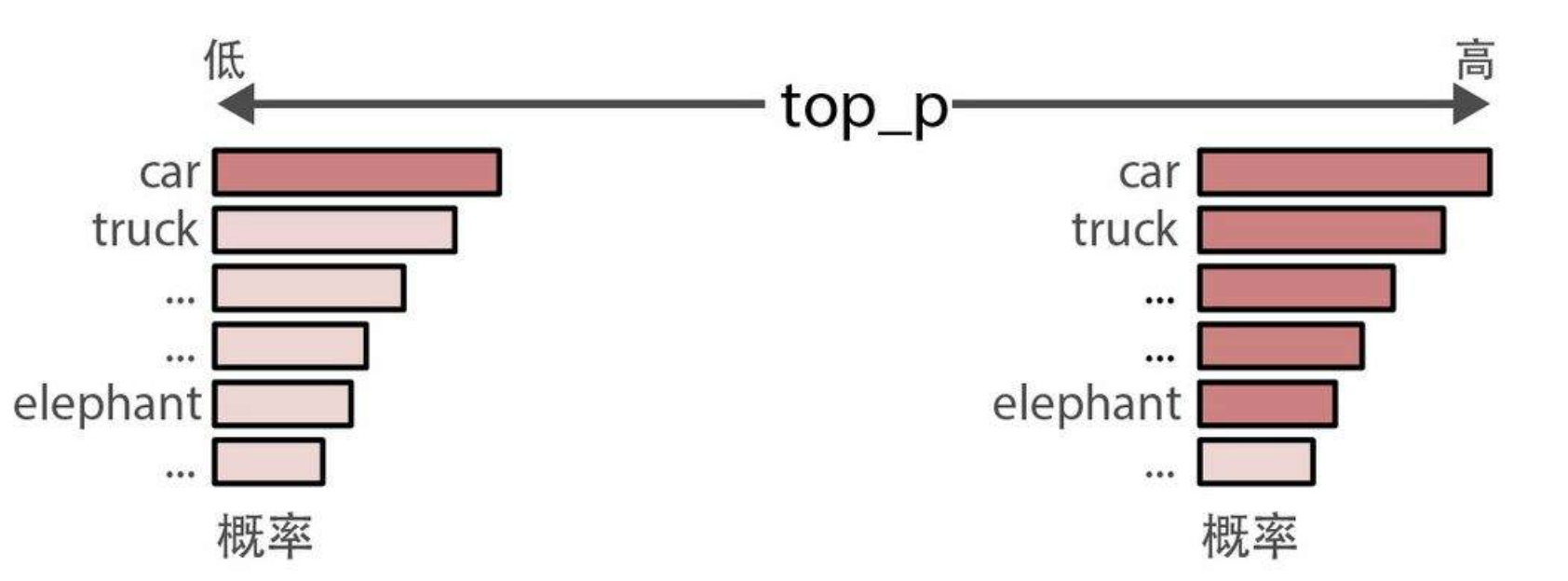

top-p采样,也称为核采样(nucleus sampling),是一种控制LLM可以考虑哪些词元子集(核)的采样技术。它会考虑概率最高的若干词元,直到达到其累积概率限制。如果我们将top_p设置为0.1,模型会从概率最高的词元开始考虑,直到这些词元的累积概率达到0.1。如果我们将top_p设置为1,模型会考虑所有词元。

如图-3所示,降低top_p值会减少LLM考虑的词元数量,通常会生成“更具确定性”的输出;而提高top_p值则允许LLM从更多词元中进行选择,从而生成“更具创造性”的输出。

图-3 较高的top_p会增加词元候选集的数量,反之亦然

参数应用场景

| 应用场景参考 | temperature | top_p | 说明 |

|---|---|---|---|

| 头脑风暴 | 高 | 高 | 高随机性输出,且可能输出的词元集合较大。生成的结果通常高度多样化,往往富有创意和出人意料。 |

| 邮件生成 | 低 | 低 | 高确定性的输出,且可能输出的词元集合较小。这会产生可预测、重点明确和保守的输出 |

| 创意写作 | 高 | 低 | 高随机性输出,但可能输出的词元集合较小。这会产生有创意的输出,但仍保持连贯性 |

| 翻译 | 低 | 高 | 高确定性的输出,但可能输出的词元集合较大。这会产生连贯的输出,并且具有更广泛的词汇范围,从而更具语言多样性 |