LLM 常见面试题 2

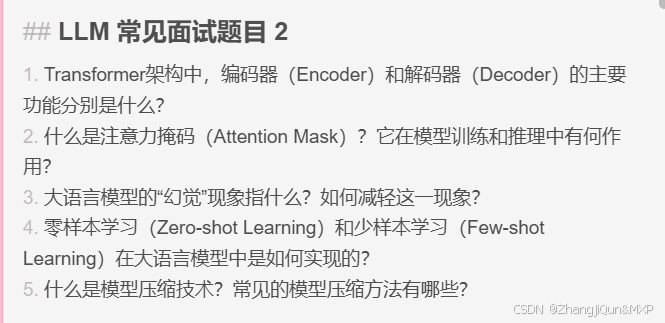

LLM 常见面试题目 2

- Transformer架构中,编码器(Encoder)和解码器(Decoder)的主要功能分别是什么?

- 什么是注意力掩码(Attention Mask)?它在模型训练和推理中有何作用?

- 大语言模型的“幻觉”现象指什么?如何减轻这一现象?

- 零样本学习(Zero-shot Learning)和少样本学习(Few-shot Learning)在大语言模型中是如何实现的?

- 什么是模型压缩技术?常见的模型压缩方法有哪些?

题目讲解

- Transformer架构中,编码器(Encoder)和解码器(Decoder)的主要功能分别是什么?

编码器的主要功能是对输入文本进行编码,将其转化为包含上下文信息的向量表示。它通过多层自注意力机制和前馈神经网络,捕捉输入文本中各个词