【AI论文】Qwen3 嵌入:通过基础模型推进文本嵌入和重新排序

摘要:在这项工作中,我们介绍了Qwen3 Embedding系列,这是其前身GTE-Qwen系列在文本嵌入和重新排序能力方面的一项重大进步,建立在Qwen3基础模型之上。 利用Qwen3 LLM在多语言文本理解和生成方面的强大功能,我们的创新多阶段训练管道将大规模无监督预训练与高质量数据集上的监督微调相结合。 有效的模型融合策略进一步确保了Qwen3 Embedding系列的鲁棒性和适应性。 在训练过程中,Qwen3 LLMs不仅作为骨干模型,而且在跨多个领域和语言合成高质量、丰富和多样化的训练数据方面发挥着至关重要的作用,从而增强了训练管道。 Qwen3 Embedding系列为嵌入和重新排序任务提供了一系列模型大小(0.6B、4B、8B),解决了用户可以针对效率或有效性进行优化的各种部署场景。 实证评估表明,Qwen3 Embedding系列在各种基准测试中取得了最先进的结果。 值得注意的是,它在多语言评估基准MTEB文本嵌入以及各种检索任务(包括代码检索、跨语言检索和多语言检索)方面表现出色。 为了促进可重复性并促进社区驱动的研究和开发,Qwen3 Embedding模型在Apache 2.0许可下公开发布。Huggingface链接:Paper page,论文链接:2506.05176

一、研究背景和目的

研究背景:

随着自然语言处理(NLP)和信息检索(IR)领域的快速发展,文本嵌入和重新排序技术成为了众多应用的核心组件,如网络搜索、问答系统、推荐系统等。高质量的文本嵌入能够捕捉文本之间的语义关系,而有效的重新排序机制则能确保最相关的结果被优先展示。近年来,大型语言模型(LLMs)的兴起为文本嵌入和重新排序技术的发展带来了新的机遇和挑战。传统的基于预训练编码器(如BERT)的方法虽然取得了一定成效,但在可扩展性、上下文理解和与特定下游任务的对齐方面仍存在不足。

研究目的:

本文旨在介绍Qwen3 Embedding系列模型,这是一系列基于Qwen3基础模型构建的文本嵌入和重新排序模型。

通过利用Qwen3 LLMs在多语言文本理解和生成方面的强大能力,结合大规模无监督预训练和高质量数据集上的监督微调,Qwen3 Embedding系列旨在显著提升文本嵌入和重新排序的性能。具体目标包括:

- 提升多语言文本嵌入能力:在多语言评估基准(如MTEB)上取得优异成绩,支持包括代码检索、跨语言检索和多语言检索在内的多种检索任务。

- 优化重新排序机制:通过引入指令跟随能力和点式重新排序策略,提高重新排序的准确性和效率。

- 提供多样化的模型尺寸:满足不同部署场景下的效率与效果需求,提供0.6B、4B、8B三种参数规模的模型。

- 促进社区驱动的研究和开发:通过公开模型权重和训练代码,推动文本嵌入和重新排序技术的进一步发展。

二、研究方法

1. 模型架构:

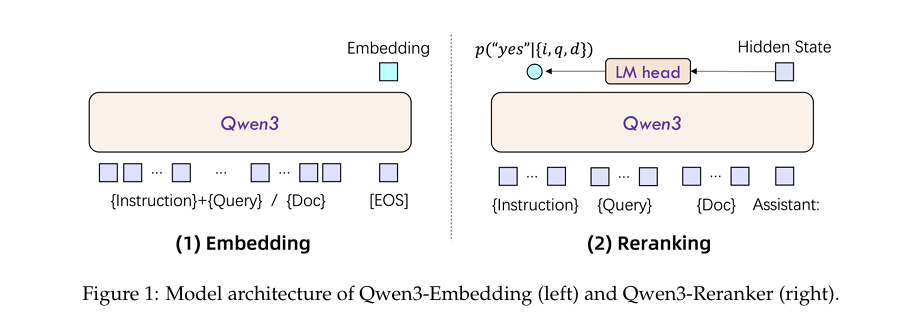

Qwen3 Embedding系列模型基于Qwen3基础模型构建,包括嵌入模型和重新排序模型两种类型。嵌入模型采用因果注意力机制的LLM,在输入序列末尾追加[EOS]标记,并从该标记对应的最后一层隐藏状态中导出最终嵌入。重新排序模型则采用点式重新排序策略,将相似性评估任务建模为二分类问题,通过LLM聊天模板实现指令跟随能力。

2. 多阶段训练管道:

Qwen3 Embedding系列采用多阶段训练策略,包括大规模无监督预训练和高质量数据集上的监督微调。

- 大规模无监督预训练:利用Qwen3 LLMs生成大规模、高质量的多语言文本对数据集,通过改进的对比损失函数(基于InfoNCE框架)进行预训练。

- 高质量数据集上的监督微调:从多个开源数据集(如MS MARCO、NQ、HotpotQA等)中精选高质量数据,并结合合成的高质量数据进行微调。合成数据通过Qwen3-32B模型生成,确保数据的质量和多样性。

3. 模型融合策略:

为了进一步提升模型的鲁棒性和适应性,Qwen3 Embedding系列采用了有效的模型融合策略。通过合并多个基础模型的预测结果,减少单个模型的偏差,提高整体性能。

三、研究结果

1. 文本嵌入性能:

Qwen3 Embedding系列在多个多语言文本嵌入基准测试中取得了优异成绩。在MTEB多语言基准测试中,Qwen3-8B-Embedding模型以70.58分的成绩超越了之前的最佳模型Gemini-Embedding。在MTEB代码基准测试中,该模型同样以80.68分的成绩位列榜首。此外,在MTEB英文、MTEB中文等多个细分基准测试中,Qwen3 Embedding系列也表现出色,证明了其在多语言文本嵌入方面的强大能力。

2. 重新排序性能:

在重新排序任务中,Qwen3 Reranker系列模型同样展现出了卓越的性能。通过引入指令跟随能力和点式重新排序策略,Qwen3 Reranker模型在多个检索基准测试中取得了显著提升。特别是在跨语言检索和多语言检索任务中,Qwen3 Reranker-8B模型相比基线模型提升了3.0个百分点以上,证明了其在复杂检索场景下的有效性。

3. 模型尺寸与性能平衡:

Qwen3 Embedding系列提供了0.6B、4B、8B三种参数规模的模型,以满足不同部署场景下的需求。实验结果表明,随着模型参数规模的增加,性能也相应提升。然而,即使在参数规模较小的情况下(如0.6B),Qwen3 Embedding系列模型依然能够取得与大型模型相媲美的性能,展示了其高效的资源利用能力。

4. 合成数据的有效性:

通过对比仅使用合成数据和仅使用高质量监督数据进行训练的模型性能,研究发现合成数据在预训练阶段对于提升模型性能具有重要作用。特别是在低资源语言和任务中,合成数据能够显著增强模型的泛化能力。此外,模型融合策略也进一步证明了其在提升模型鲁棒性和适应性方面的有效性。

四、研究局限

尽管Qwen3 Embedding系列在文本嵌入和重新排序任务中取得了显著成果,但仍存在一些局限性:

1. 计算资源需求:

多阶段训练管道,特别是大规模无监督预训练阶段,对计算资源的需求较高。这可能限制了资源有限的研究机构和个人开发者对该技术的广泛应用。

2. 数据多样性与偏差:

尽管合成数据在预训练阶段发挥了重要作用,但其多样性和真实性与真实世界数据仍存在一定差距。此外,高质量监督数据的选择和标注也可能引入偏差,影响模型的泛化能力。

3. 模型复杂性与可解释性:

随着模型参数规模的增加,模型的复杂性也随之提高,这可能导致模型的可解释性降低。在需要高度可解释性的应用场景中(如医疗、法律等),这可能成为一个限制因素。

4. 特定任务优化:

尽管Qwen3 Embedding系列在多个基准测试中表现优异,但在某些特定任务或领域中,其性能可能仍有提升空间。针对特定任务的定制化优化可能是未来研究的一个重要方向。

五、未来研究方向

针对Qwen3 Embedding系列的局限性和当前研究趋势,未来研究可以从以下几个方面展开:

1. 计算资源优化:

探索更高效的训练算法和硬件加速技术,以降低多阶段训练管道对计算资源的需求。例如,利用分布式训练、模型剪枝和量化等技术手段,提高训练效率和资源利用率。

2. 数据增强与多样性提升:

进一步探索数据增强技术,提高合成数据的多样性和真实性。同时,开发更有效的数据筛选和标注方法,减少高质量监督数据中的偏差。此外,还可以考虑利用多模态数据(如图像、音频等)来丰富文本嵌入和重新排序模型的输入信息。

3. 模型可解释性研究:

针对模型复杂性增加导致的可解释性降低问题,开展模型可解释性研究。探索可视化技术、特征重要性分析等方法,帮助用户理解模型的决策过程。此外,还可以考虑开发可解释性更强的模型架构,如基于注意力机制的模型等。

4. 特定任务定制化优化:

针对特定任务或领域(如医疗、法律、金融等),开展定制化优化研究。通过引入领域知识、构建特定任务的数据集和评估指标等方式,提高模型在特定任务上的性能。此外,还可以探索跨任务迁移学习的方法,利用在相关任务上学到的知识来提升目标任务的性能。

5. 实时性与效率提升:

针对实时应用场景(如在线搜索、实时推荐等),研究如何提升Qwen3 Embedding系列的实时性和效率。通过优化模型结构、减少计算量、利用缓存技术等方式,降低模型的推理延迟和资源消耗。同时,还可以探索模型压缩和加速技术,如知识蒸馏、量化感知训练等,以进一步提高模型的实时性和效率。

6. 社区驱动的研究与开发:

继续推动Qwen3 Embedding系列的社区驱动研究和开发。通过公开模型权重、训练代码和数据集等方式,鼓励更多的研究者和开发者参与到该技术的研究和应用中来。同时,建立活跃的社区交流平台,促进知识共享和技术交流,共同推动文本嵌入和重新排序技术的发展。

综上所述,Qwen3 Embedding系列通过结合Qwe3基础模型的强大能力和多阶段训练策略,在文本嵌入和重新排序任务中取得了显著成果。未来研究可以进一步探索计算资源优化、数据增强与多样性提升、模型可解释性研究、特定任务定制化优化、实时性与效率提升以及社区驱动的研究与开发等方面,以推动该技术的持续发展和广泛应用。