深度学习习题2

1.如果增加神经网络的宽度,精确度会增加到一个特定阈值后,便开始降低。造成这一现象的可能原因是什么?

A、即使增加卷积核的数量,只有少部分的核会被用作预测

B、当卷积核数量增加时,神经网络的预测能力会降低

C、当卷积核数量增加时,导致过拟合

D、以上都不正确

2.构建一个神经网络,将前一层的输出和它自身作为输入。下列哪一种架构有反馈连接?

A、循环神经网络 B、卷积神经网络 C、限制玻尔兹曼机 D、都不是

在训练神经网络时,损失函数(loss)在最初的几个epochs时没有下降,可能的原因是?

A、学习率(learning rate)太低 B、正则参数太高 C、陷入局部最小值 D、以上都有可能

3.下列哪一项属于特征学习算法(representation learning algorithm)?

A、K近邻算法 B、随机森林 C、神经网络 D、都不属于

4.假设我们拥有一个已完成训练的、用来解决车辆检测问题的深度神经网络模型,训练所用的数据集由汽车和卡车的照片构成,而训练目标是检测出每种车辆的名称(车辆共有10种类型)。现在想要使用这个模型来解决另外一个问题,问题数据集中仅包含一种车(福特野马)而目标变为定位车辆在照片中的位置。

A、除去神经网络中的最后一层,冻结所有层然后重新训练

B、对神经网络中的最后几层进行微调,同时将最后一层(分类层)更改为回归层

C、使用新的数据集重新训练模型

D、所有答案均不对

5.假设你有5个大小为7x7、边界值为0的卷积核,同时卷积神经网络第一层的深度为1。此时如果你向这一层传入一个维度为224x224x3的数据,那么神经网络下一层所接收到的数据维度是多少?

A、218x218x5 B、217x217x8 C、217x217x3 D、220x220x5

6.假设我们有一个使用ReLU激活函数的神经网络,假如我们把ReLU激活替换为线性激活,那么这个神经网络能够模拟出同或函数(XNOR function)吗?

A、可以 B、不好说 C、不一定 D、不能

7.下列的哪种方法可以用来降低深度学习模型的过拟合问题?

1增加更多的数据 2使用数据扩增技术 3使用归纳性更好的架构 4正则化处理 5降低架构的复杂度

A、1 4 5 B、1 2 3 C、1 3 4 5 D、都有用

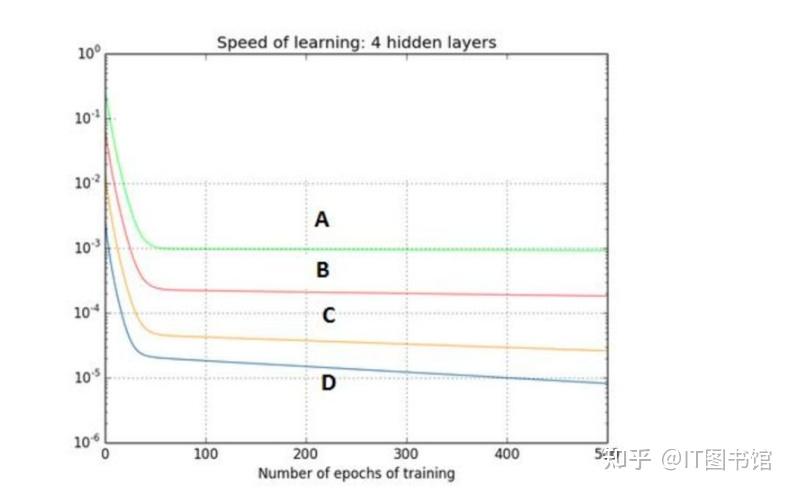

8.下图是一个利用sigmoid函数作为激活函数的含四个隐藏层的神经网络训练的梯度下降图。这个神经网络遇到了梯度消失的问题。下面哪个叙述是正确的?

A、第一隐藏层对应D,第二隐藏层对应C,第三隐藏层对应B,第四隐藏层对应A

B、第一隐藏层对应A,第二隐藏层对应C,第三隐藏层对应B,第四隐藏层对应D

C、第一隐藏层对应A,第二隐藏层对应B,第三隐藏层对应C,第四隐藏层对应D

D、第一隐藏层对应B,第二隐藏层对应D,第三隐藏层对应C,第四隐藏层对应A

9.考虑某个具体问题时,你可能只有少量数据来解决这个问题。不过幸运的是你有一个类似问题已经预先训练好的神经网络。可以用下面哪种方法来利用这个预先训练好的网络?

A、把除了最后一层外所有的层都冻结,重新训练最后一层

B、对新数据重新训练整个模型

C、只对最后几层进行调参 (fine tune)

D、对每一层模型进行评估,选择其中的少数来用

A和C都有道理,A的计算量小且可以有等价的效果

10.在选择神经网络的深度时,下面哪些参数需要考虑?

1 神经网络的类型(如MLP,CNN)

2 输入数据

3 计算能力(硬件和软件能力决定)

4 学习速率

5 映射的输出函数

A、1,2,4,5 B、2,3,4,5 C、都需要考虑 D、1,3,4,5

11.当数据过大以至于无法在RAM中同时处理时,哪种梯度下降方法更加有效?

A、随机梯度下降法 B、不知道 C、整批梯度下降法 D、都不是

12.在一个神经网络中,知道每一个神经元的权重和偏差是最重要的一步。如果知道了神经元准确的权重和偏差,便可以近似任何函数,但怎么获知每个神经的权重和偏移呢?

A、搜索每个可能的权重和偏差组合,直到得到最佳值

B、赋予一个初始值,然后检查跟最佳值的差值,不断迭代调整权重(梯度下降)

C、随机赋值,听天由命

D、以上都不正确的