HRI-2025 | 大模型驱动的个性化可解释机器人人机交互研究

- 作者:Ferran Gebelli 1 ^{1} 1, Lavinia Hriscu 2 ^{2} 2, Raquel Ros 1 ^{1} 1, Séverin Lemaignan 1 ^{1} 1, Alberto Sanfeliu 2 ^{2} 2, Anais Garrell 2 ^{2} 2

- 单位: 1 ^{1} 1PAL Robotics, 2 ^{2} 2IRI (UPC-CSIC)

- 论文标题:Personalised Explainable Robots Using LLMs

- 论文链接:https://ieeexplore.ieee.org/abstract/document/10974125

主要贡献

- 提出了一种基于大语言模型(LLMs)的架构,用于在人机交互(HRI)中提供个性化的可解释性,填补了当前XHRI研究中个性化解释的空白。

- 通过在老年医院巡逻机器人的用例中进行模拟,展示了该架构在实际场景中的可行性,能够根据不同用户类型和交互历史生成针对性的解释。

- 提供了未来研究方向,包括强化学习、不确定性感知以及向异构和变化群体提供解释等,为后续研究提供了思路和方向。

研究背景

- 在人机交互(HRI)领域,解释性被认为是增强人类对机器人行为和决策过程理解的关键机制。然而,目前大多数研究集中在如何使机器人行为可解释,而较少关注个性化解释。

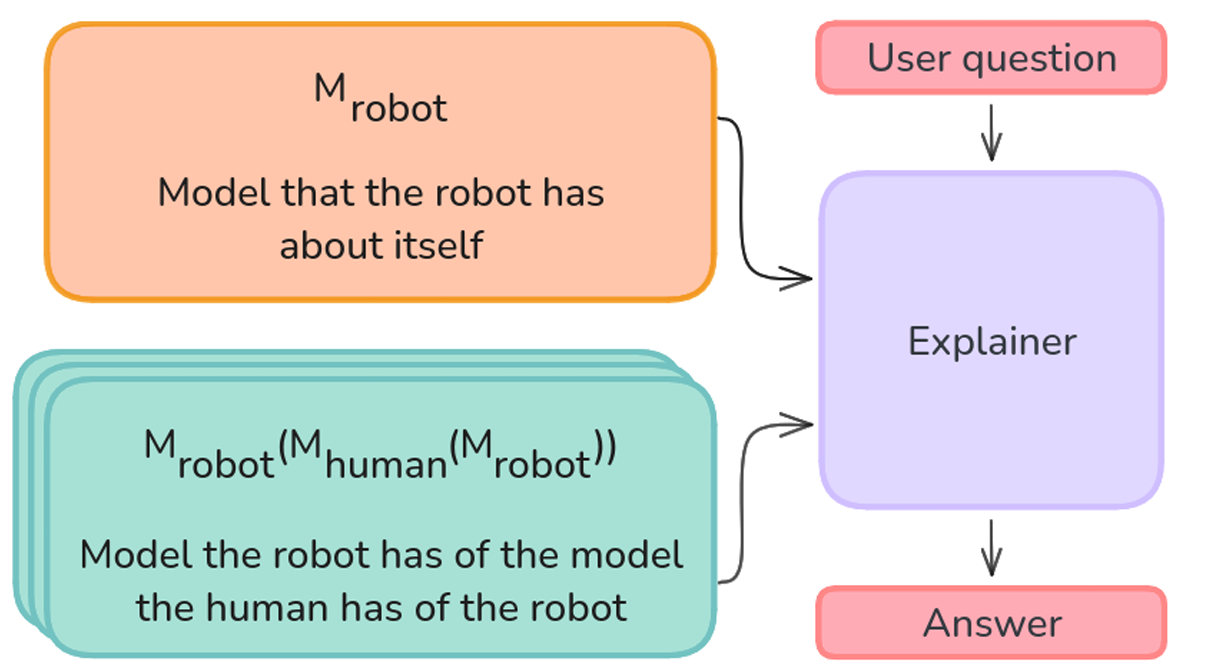

- 从心理理论(ToM)的角度来看,可解释的HRI(XHRI)被概念化为一个模型协调问题,即机器人需要估计用户对机器人的心理模型,并与自身的内部心理模型进行比较,以识别潜在的不匹配并生成沟通行为来弥合差距。

- 由于机器人需要为每个用户估计不同的心理模型,因此个性化至关重要。然而,现有研究中很少有针对XHRI中的个性化问题进行探讨。

研究方法

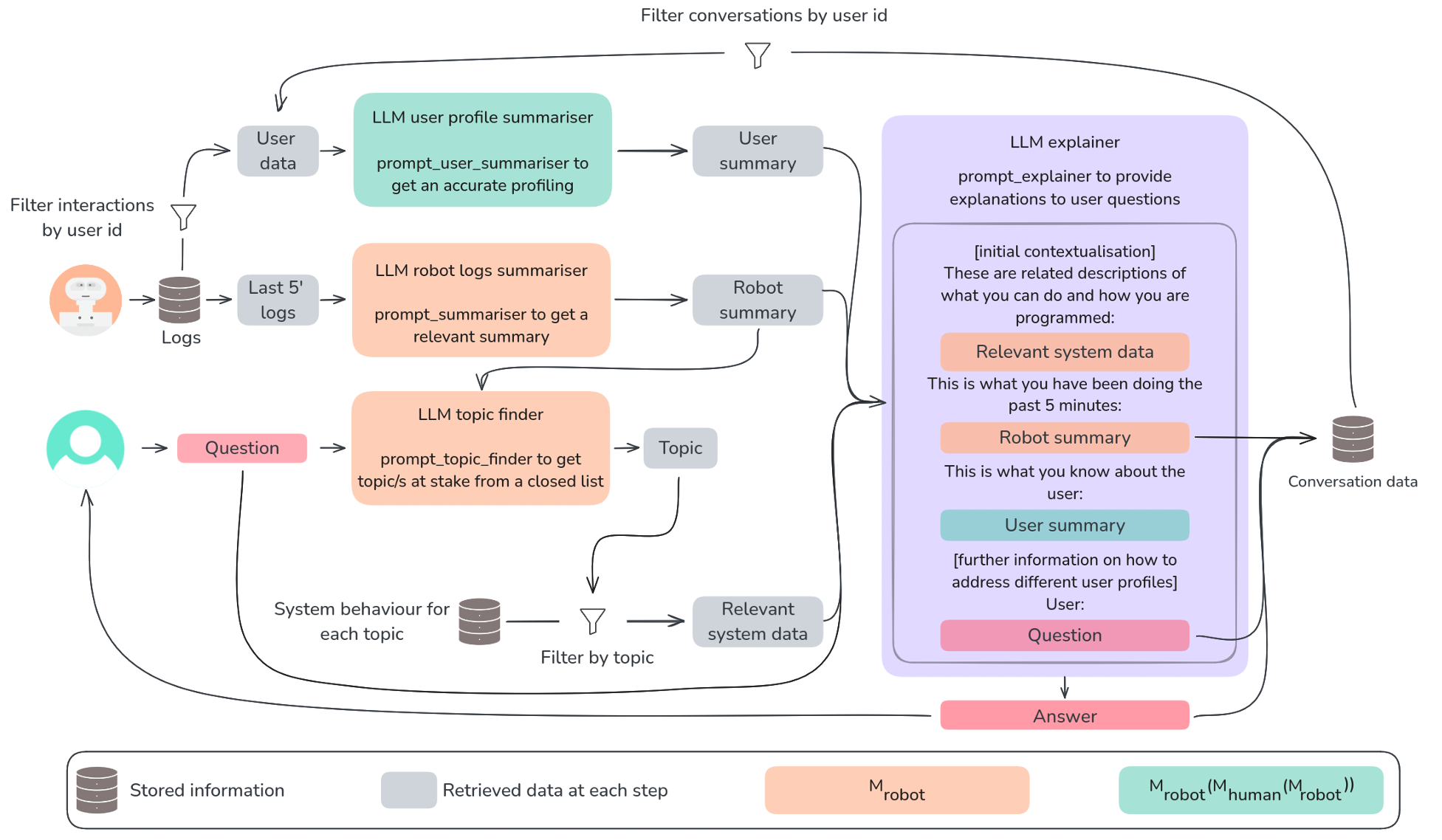

- 架构设计:提出了一种基于LLMs的架构,通过整合结构化知识来解释决策和行为。该架构包括以下几个关键部分:

- Mrobot表示:结合了机器人过去行为的总结和针对不同主题或情境的预定义行为规则。其中,过去行为的总结通过LLM从最近5分钟的活动日志中提取相关信息生成;主题查找器通过LLM识别用户问题所涉及的主题;并根据主题从数据库中检索相应的预定义行为规则。

- M r o b o t ( M h u m a n ( M r o b o t ) M_{robot}(M_{human}(M_{robot}) Mrobot(Mhuman(Mrobot)表示:利用LLM对用户进行建模,基于用户与机器人的过往交互数据(包括对话、日志摘要以及任务相关交互)生成用户画像,反映用户对机器人的知识水平和潜在的认知差距。

- LLM解释器:结合静态知识(行为规则)、动态知识(最近5分钟的日志总结)以及用户画像来回答用户问题,实现个性化解释。

- 模型选择:采用OpenAI的gpt-4o-mini模型作为基础LLM。

实验

- 用例设置:以在老年医院巡逻的机器人作为实验场景,该机器人的主要任务是监测患者房间并在检测到潜在危险情况(如患者跌倒、患者独自站立、门未按要求打开等)时向护理人员发出警报。实验记录了机器人两个月的高级日志,包括日程变更、行为状态转换和警报触发等信息,以及护理人员通过移动应用与机器人的交互记录。

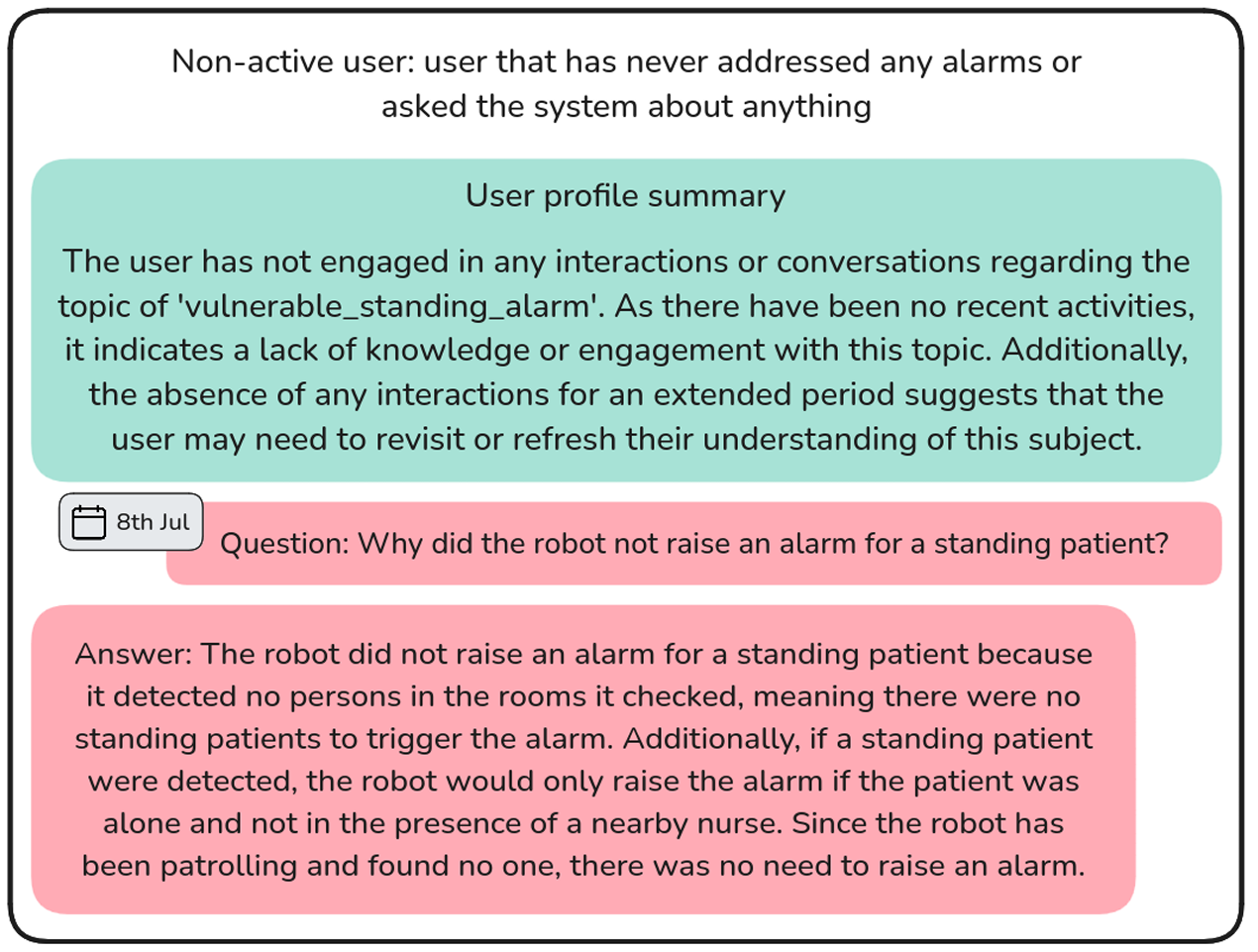

- 模拟交互:利用记录的日志模拟不同用户在指定时间点向机器人提出关于警报触发或未触发的可解释性问题。根据用户的交互历史和知识水平,将用户分为以下几种类型:

- 非活跃用户:未与系统进行过积极互动或对话,对于此类用户,系统提供了详细的解释,以帮助其更好地理解机器人未触发警报的原因。

- 活跃用户:在一段时间内与机器人有过多次互动,系统能够根据用户的活跃度提供简洁的回答,避免过多重复信息。

- 活跃用户但有时间间隔:曾与机器人有过频繁互动,但在一段时间(如一个月)内未进行任何交互。对于这种用户,系统不仅考虑了过去的活动,还考虑了时间间隔,生成的解释既参考了之前的讨论,又提供了足够的细节以弥补知识的可能遗忘。

结论与未来工作

- 结论:通过将用户过去的对话总结、机器人高级日志总结以及相关系统数据相结合,该基于LLMs的架构能够提供针对机器人决策和行为的个性化解释。在老年医院巡逻机器人的用例中展示了其可行性和有效性。

- 未来工作:

- 用户研究与模型改进:进行用户研究,比较不同表示、更新和检索Mrobot和Mrobot(Mhuman(Mrobot)的方法,并整合多模态输入。探索检索增强生成(RAG)技术以优化信息检索过程,减少对5分钟时间窗口的依赖。

- 实时性优化:通过并行化某些步骤和比较不同提供商的LLM模型,确保系统的实时性要求。

- 强化学习:通过从用户反馈中进行强化学习来微调LLMs,以实现更深入的个性化解释。

- 不确定性感知:探索在Mrobot和Mrobot(Mhuman(Mrobot)中加入模型不确定性的估计,并让LLM根据不确定性生成相应的回答。

- 面向异构和变化群体的解释:研究如何向不同用户群体提供解释,考虑群体成员的变化以及信息共享的情况。