深度学习与神经网络 前馈神经网络

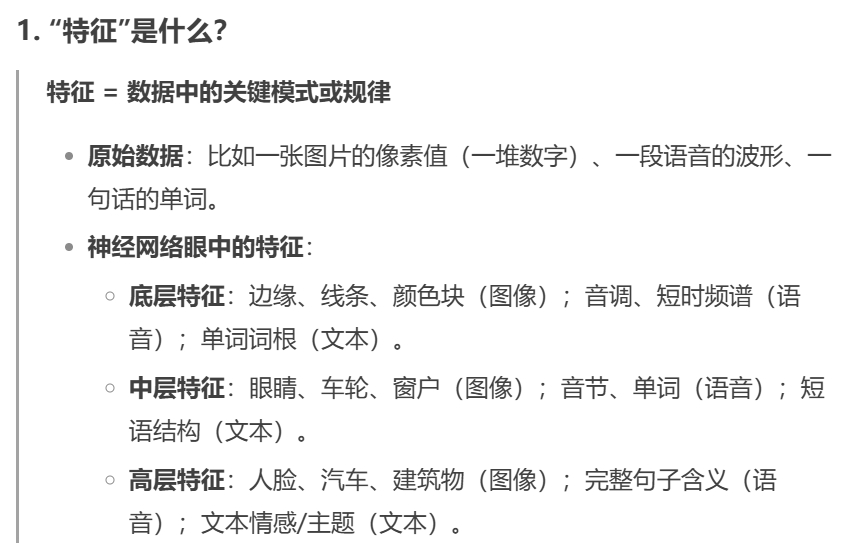

1.神经网络特征

无需人去告知神经网络具体的特征是什么,神经网络可以自主学习

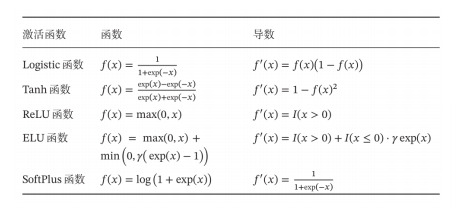

2.激活函数性质

(1)连续并可导(允许少数点不可导)的非线性函数

(2)单调递增

(3)函数本身及其导函数要尽可能的简单

(4)导函数的值域要在合适的范围内

3.常用激活函数

(1)sigma函数

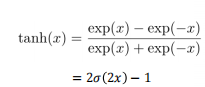

(2)tanh函数

sigma和tanh均为饱和函数,且sigma函数存在特征变量之间只能向同一方向迭代(非负)导致迭代速度慢,且二者均可能由于层数过多在反向传播时出现梯度消失的现象(导函数的取值在0-1之间)

(3)ReLU函数

ReLU变体

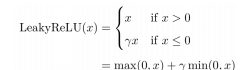

(4)LeakyRuLU函数

(5)PReLU函数

ReLU及其变体激活函数也被称为斜坡函数,可以有效避免梯度消失问题和迭代次数过多问题,最激活函数最常用的就是ReLU函数

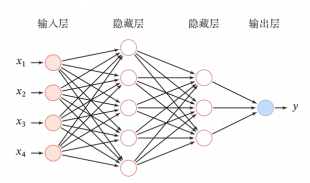

4.前馈神经网络结构

输入层----隐藏层----输出层

各神经元分别属于不同的层,层内无连接;相邻两层之间的神经元全部两两相连(单向);整个网络中无反馈,信号从输入层向输出层单向传播,可用一个有向无环图表示

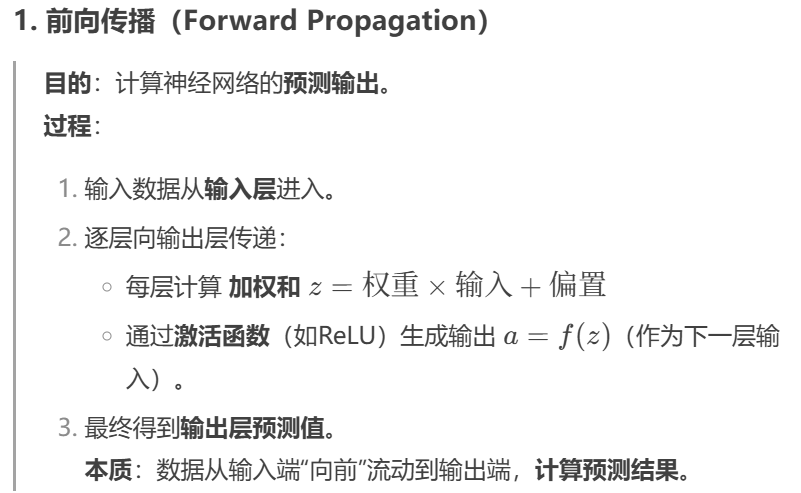

5.前向传播

从输入层向输出层信息传播的算法

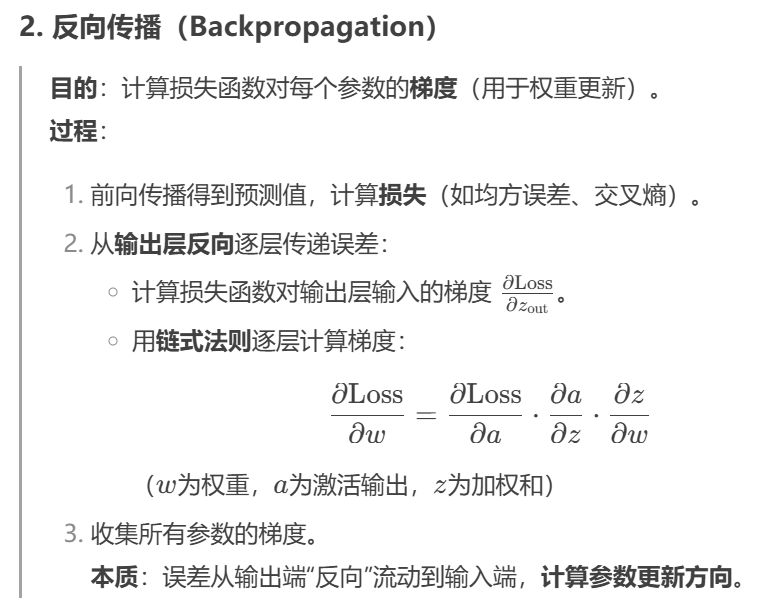

6.反向传播

从输出层向输入层信息传播的算法

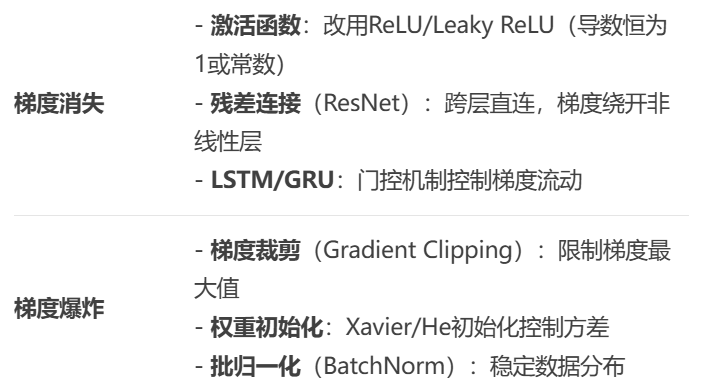

7.梯度消失&梯度爆炸

均发生在反向传播算法当中,链式法则存在连乘效应,如果梯度处于0-1或大于1时,当层数足够大时,容易出现0和无穷的现象导致梯度消失和爆炸

解决思路: