Srinath多元假设检验 (Multiple-hypothesis Testing)(To 廖老师)

Mandyam D. Srinath《Introduction to Statistical Signal Processing with Applications》

多元假设检验

迄今为止我们已研究了在两种假设之间的判决问题。但在许多情况下,源有若干个输出,我们必须判决对应于输出的几个假设中,哪一个是正确的。若源有 M M M个输出,则在每次试验时总共有 M M M个不同的假设可能出现。对于这种问题,可严格地参照二元假设检验问题的做法,应用贝叶斯准则。因此,假定先验概率 P ( H 0 ) P(H_0) P(H0), P ( H 1 ) P(H_1) P(H1), …, P ( H M − 1 ) P(H_{M-1}) P(HM−1)已知。若假设 H j H_j Hj成立时选择了 H i H_i Hi,规定其代价为 C i j C_{ij} Cij。

平均代价为

C ‾ = ∑ i = 0 M − 1 ∑ j = 0 M − 1 C i j P ( D i ∣ H j ) P ( H j ) (1) \overline{C} = \sum_{i=0}^{M-1} \sum_{j=0}^{M-1} C_{ij} P(D_i|H_j) P(H_j) \tag{1} C=i=0∑M−1j=0∑M−1CijP(Di∣Hj)P(Hj)(1)

式中 P ( D i ∣ H j ) P(D_i|H_j) P(Di∣Hj)是假设 H j H_j Hj为真时选择 H i H_i Hi的概率。我们仍将观测空间 Z \mathcal{Z} Z分成互不相交的子空间 Z 0 \mathcal{Z}_0 Z0, Z 1 \mathcal{Z}_1 Z1, …, Z M − 1 \mathcal{Z}_{M-1} ZM−1,并且对每一子空间的点都赋予一个相应的假设。目的是求出使平均代价 C ‾ \overline{C} C最小的判决面。我们记

Z = Z 0 + Z 1 + ⋯ + Z M − 1 ≜ Z 0 ∪ Z 1 ∪ ⋯ ∪ Z M − 1 (2) \mathcal{Z} = \mathcal{Z}_0 + \mathcal{Z}_1 + \cdots + \mathcal{Z}_{M-1} \triangleq \mathcal{Z}_0 \cup \mathcal{Z}_1 \cup \cdots \cup \mathcal{Z}_{M-1}\tag{2} Z=Z0+Z1+⋯+ZM−1≜Z0∪Z1∪⋯∪ZM−1(2)

利用这些判决域,可把概率 P ( D i ∣ H j ) P(D_i|H_j) P(Di∣Hj)写成

P ( D i ∣ H j ) = ∫ Z i p ( z ∣ H j ) d z (3) P(D_i|H_j) = \int_{\mathcal{Z}_i} p(\bm{z} \mid H_j) {\rm d}z\tag{3} P(Di∣Hj)=∫Zip(z∣Hj)dz(3)

把式 (3) 代入式 (1),得

C ‾ = ∑ i = 0 M − 1 ∑ j = 0 M − 1 C i j P ( H j ) ∫ Z i p ( z ∣ H j ) d z = ∑ i = 0 M − 1 C i i P ( H i ) ∫ Z i p ( z ∣ H i ) d z + ∑ i = 0 M − 1 ∑ j = 0 j ≠ i M − 1 C i j P ( H j ) ∫ Z i p ( z ∣ H j ) d z (4) \begin{aligned} \overline{C} &= \sum_{i=0}^{M-1} \sum_{j=0}^{M-1} C_{ij} P(H_j) \int_{\mathcal{Z}_i} p(\bm{z} \mid H_j) {\rm d}z \\ &= \sum_{i=0}^{M-1} C_{ii} P(H_i) \int_{\mathcal{Z}_i} p(\bm{z} \mid H_i) {\rm d}z \\ &+ \sum_{i=0}^{M-1} \sum_{\substack{j=0 \\ j \neq i}}^{M-1} C_{ij} P(H_j) \int_{\mathcal{Z}_i} p(\bm{z} \mid H_j) {\rm d}z \end{aligned}\tag{4} C=i=0∑M−1j=0∑M−1CijP(Hj)∫Zip(z∣Hj)dz=i=0∑M−1CiiP(Hi)∫Zip(z∣Hi)dz+i=0∑M−1j=0j=i∑M−1CijP(Hj)∫Zip(z∣Hj)dz(4)

考虑到第一个和式的 Z i \mathcal{Z}_i Zi可以写成 Z − ⋃ j = 0 j ≠ i M − 1 Z j Z - \bigcup_{\substack{j=0 \\ j \neq i}}^{M-1} \mathcal{Z}_j Z−⋃j=0j=iM−1Zj,又由于

∫ Z p ( z ∣ H i ) d z = 1 \int_Z p(\bm{z} \mid H_i) {\rm d}z = 1 ∫Zp(z∣Hi)dz=1

可以把此式写成更简洁的形式

C ‾ = ∑ i = 0 M − 1 C i i P ( H i ) + ∑ i = 0 M − 1 ∫ Z i ∑ j = 0 j ≠ i M − 1 P ( H j ) ( C i j − C j j ) p ( z ∣ H j ) d z (5) \begin{aligned} \overline{C} &= \sum_{i=0}^{M-1} C_{ii} P(H_i) \\ &+ \sum_{i=0}^{M-1} \int_{\mathcal{Z}_i} \sum_{\substack{j=0 \\ j \neq i}}^{M-1} P(H_j) (C_{ij} - C_{jj}) p(\bm{z} \mid H_j) {\rm d}z \end{aligned}\tag{5} C=i=0∑M−1CiiP(Hi)+i=0∑M−1∫Zij=0j=i∑M−1P(Hj)(Cij−Cjj)p(z∣Hj)dz(5)

同以前一样,第一项代表固定代价,各个积分代表变化的代价,它随判决域的选择而变化。显然,我们应把各观测值 z z z分配给这样的区域,使得在该区域中积分值为最小。因此,若令

I i ( z ) = ∑ j = 0 j ≠ i M − 1 P ( H j ) ( C i j − C j j ) p ( z ∣ H j ) (6) I_i(z) = \sum_{\substack{j=0 \\ j \neq i}}^{M-1} P(H_j)(C_{ij} - C_{jj}) p(\bm{z} \mid H_j) \tag{6} Ii(z)=j=0j=i∑M−1P(Hj)(Cij−Cjj)p(z∣Hj)(6)

则判决规则应是选择使 I i ( z ) I_i(z) Ii(z)为最小的假设为正确的假设。

我们可根据如下定义,利用似然比表示判决规则

Λ i ( z ) = p ( z ∣ H i ) p ( z ∣ H 0 ) , i = 1 , ⋯ , M − 1 \Lambda_i(z) = \frac{p(\bm{z} \mid H_i)}{p(\bm{z} \mid H_0)}, \quad i=1,\cdots,M-1 Λi(z)=p(z∣H0)p(z∣Hi),i=1,⋯,M−1

和

J i ( z ) = I i ( z ) p ( z ∣ H 0 ) = ∑ j = 0 j ≠ i M − 1 P ( H j ) ( C i j − C j j ) Λ j ( z ) J_i(z) = \frac{I_i(z)}{p(\bm{z} \mid H_0)} = \sum_{\substack{j=0 \\ j \neq i}}^{M-1} P(H_j)(C_{ij}-C_{jj}) \Lambda_j(z) Ji(z)=p(z∣H0)Ii(z)=j=0j=i∑M−1P(Hj)(Cij−Cjj)Λj(z)

判决规则就是选择使 J i ( z ) J_i(z) Ji(z)为最小的假设。可以看出,判决规则对应于由似然比 Λ 1 ( z ) , ⋯ , Λ M − 1 ( z ) \Lambda_1(z), \cdots, \Lambda_{M-1}(z) Λ1(z),⋯,ΛM−1(z)构成的 M − 1 M-1 M−1维空间中的超平面。

我们最关心的是 i ≠ j i \neq j i=j时 C i j = 1 C_{ij}=1 Cij=1而 C i i = 0 C_{ii}=0 Cii=0的情况。这种情况下的准则就是最小错误概率准则。这时式 (6) 化为

I i ( z ) = ∑ j = 0 j ≠ i M − 1 P ( H j ) p ( z ∣ H j ) = ∑ j = 0 j ≠ i M − 1 P ( H j ∣ z ) p ( z ) = [ 1 − P ( H i ∣ z ) ] p ( z ) (9) \begin{aligned} I_i(z) &= \sum_{\substack{j=0 \\ j \neq i}}^{M-1} P(H_j)p(\bm{z} \mid H_j) \\ &= \sum_{\substack{j=0 \\ j \neq i}}^{M-1} P(H_j|z)p(z) \\ &= [1-P(H_i|z)]p(z) \end{aligned}\tag{9} Ii(z)=j=0j=i∑M−1P(Hj)p(z∣Hj)=j=0j=i∑M−1P(Hj∣z)p(z)=[1−P(Hi∣z)]p(z)(9)

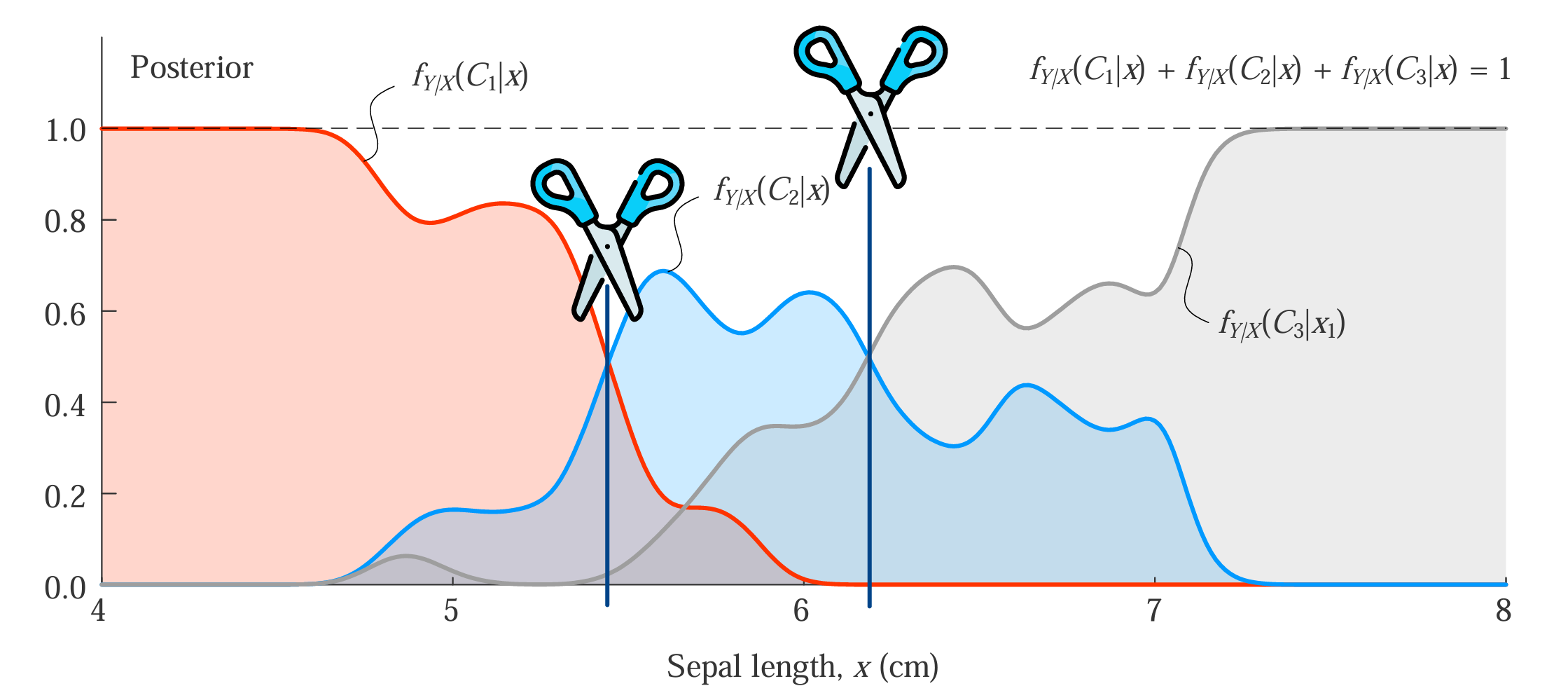

因此,对于这种特殊的代价分配而言,使 I i ( z ) I_i(z) Ii(z)最小同使 P ( H i ∣ z ) P(H_i|z) P(Hi∣z)最大是等价的(最大后验概率准则), P ( H i ∣ z ) P(H_i|z) P(Hi∣z)是给定观测值 z z z时假设 H i H_i Hi的后验概率,故最小错误概率处理机也就是最大后验概率计算机。

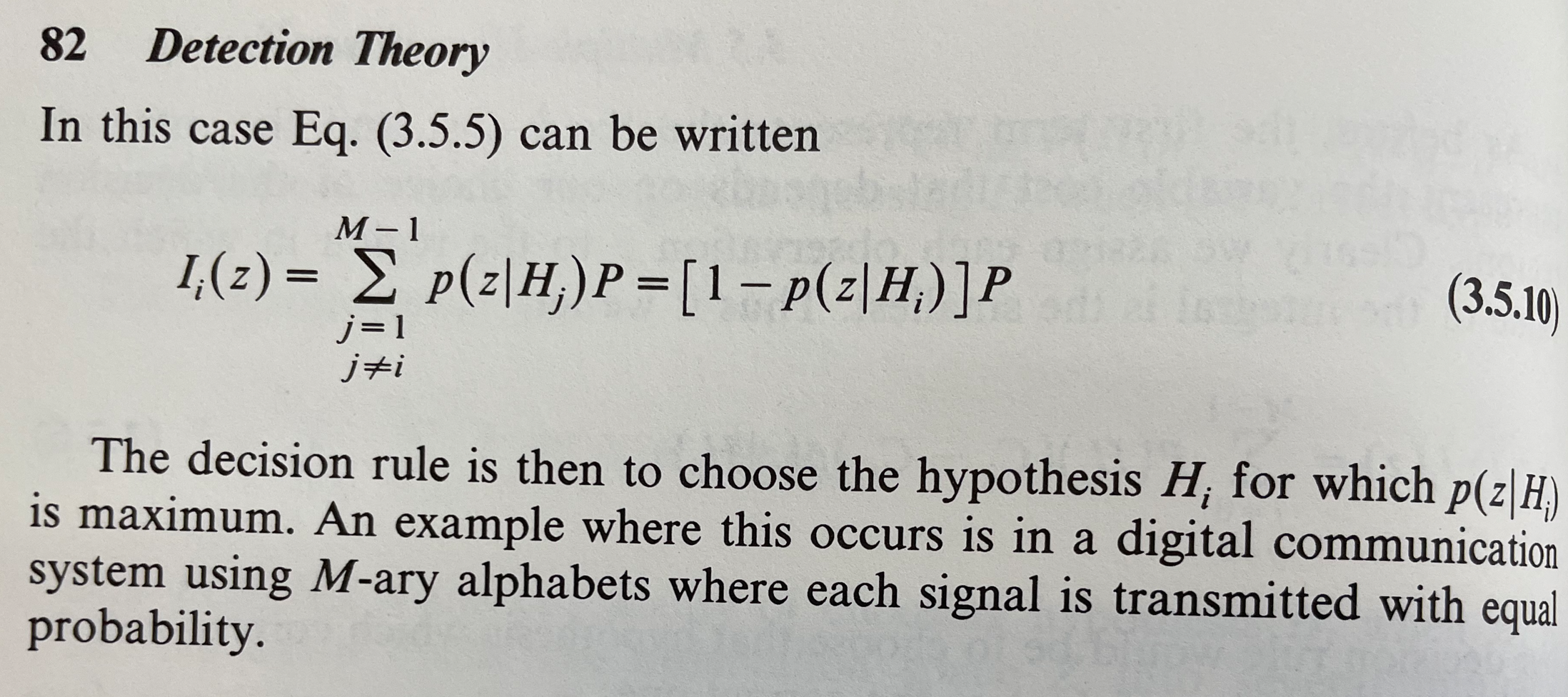

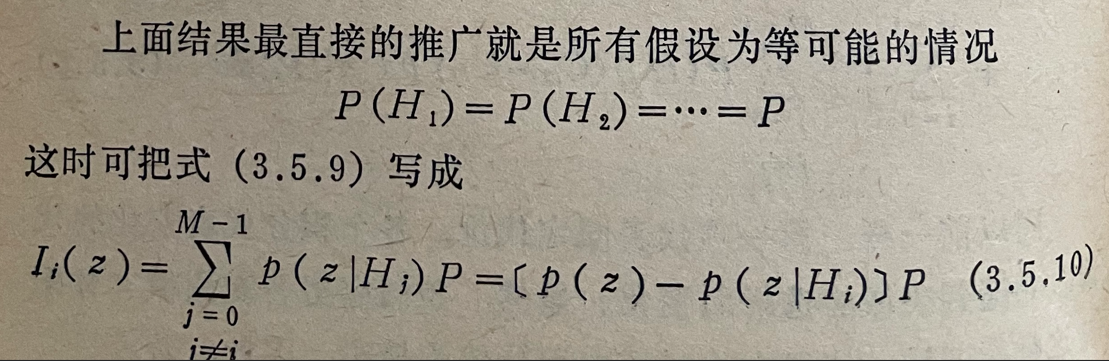

上面结果最直接的推广就是所有假设为等可能的情况

P ( H 1 ) = P ( H 2 ) = ⋯ = P P(H_1) = P(H_2) = \cdots = P P(H1)=P(H2)=⋯=P

这时可把式 (9) 写成

I i ( z ) = ∑ j = 0 j ≠ i M − 1 p ( z ∣ H j ) P = p ( z ) − p ( z ∣ H i ) P (10) I_i(z) = \sum_{\substack{j=0 \\ j \neq i}}^{M-1} p(\bm{z} \mid H_j)P = p(z)-p(\bm{z} \mid H_i)P\tag{10} Ii(z)=j=0j=i∑M−1p(z∣Hj)P=p(z)−p(z∣Hi)P(10)

于是判决规则就是选择使 p ( z ∣ H i ) p(\bm{z} \mid H_i) p(z∣Hi)最大的假设(极大似然准则)。数字通信系统中就有这种例子,该系统中利用 M M M个字母作信号,发射每个信号的概率相等。

Comments(To 廖老师)

1 极大似然估计的公式原著和译本都错了

公式 (10)的极大似然估计,原著中错了。

廖老师改的是对的,Srinath 译书中确实错了。我猜测译者应该是发现原著中错了(说明那个年代译者还纠错,现在的译者只管翻译,懂不懂都很难说,翻译完全不说人话),但是又改错了,去掉中括号就对了,利用全概率公式很容易推导出。

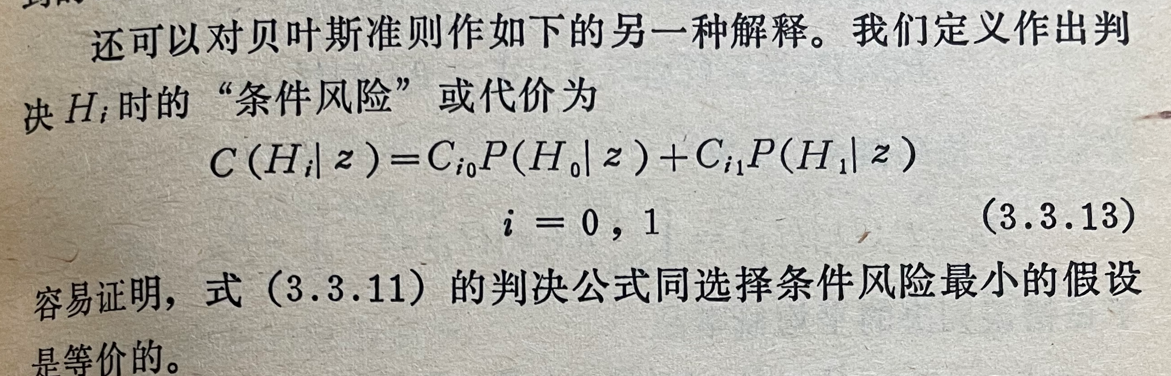

2 关于准则函数

首先,如果只是比较准则函数,没有必要将 C i i C_{ii} Cii有关项单独提取出来,用条件风险即可,不必 I i ( z ) I_i(z) Ii(z);而且作者在判决准则中提到了另一种解释。条件风险这样的解释更有物理意义,且计算直观、简单。

其次,我认为作者表示 I i ( z ) I_i(z) Ii(z)的目的是为了 J i ( z ) J_i(z) Ji(z)(不知道廖老师是否看到这个 J i ( z ) J_i(z) Ji(z)),与似然比建立联系,而不是单单为了 I i ( z ) I_i(z) Ii(z)。但是,我认为表示这样的似然比没有意义,因为多类问题需要比较所有值,两个数的比值没有意义,还增加计算量。

所以,我想这就是现在的教材使用条件风险作为准则的原因。 I i ( z ) I_i(z) Ii(z)、 J i ( z ) J_i(z) Ji(z)都能作为准则,但是啰嗦。

3 从式 (4)到式 (5)的推导

这里的推导,我认为这样的逻辑更加好理解。

C ‾ = ∑ i = 0 M − 1 ∑ j = 0 M − 1 C i j P ( H j ) ∫ Z i p ( z ∣ H j ) d z = ∑ i = 0 M − 1 C i i P ( H i ) ∫ Z i p ( z ∣ H i ) d z + ∑ i = 0 M − 1 ∑ j = 0 j ≠ i M − 1 C i j P ( H j ) ∫ Z i p ( z ∣ H j ) d z (4) \begin{aligned} \overline{C} &= \sum_{i=0}^{M-1} \sum_{j=0}^{M-1} C_{ij} P(H_j) \int_{\mathcal{Z}_i} p(\bm{z} \mid H_j) {\rm d}z \\ &= \sum_{i=0}^{M-1} C_{ii} P(H_i) \int_{\mathcal{Z}_i} p(\bm{z} \mid H_i) {\rm d}z \\ &+ \sum_{i=0}^{M-1} \sum_{\substack{j=0 \\ j \neq i}}^{M-1} C_{ij} P(H_j) \int_{\mathcal{Z}_i} p(\bm{z} \mid H_j) {\rm d}z \end{aligned}\tag{4} C=i=0∑M−1j=0∑M−1CijP(Hj)∫Zip(z∣Hj)dz=i=0∑M−1CiiP(Hi)∫Zip(z∣Hi)dz+i=0∑M−1j=0j=i∑M−1CijP(Hj)∫Zip(z∣Hj)dz(4)

由于

Z i = Z − ⋃ j = 0 j ≠ i M − 1 Z j , ∫ Z p ( z ∣ H i ) d z = 1 \mathcal{Z}_i = \mathcal{Z} - \bigcup_{\substack{j=0 \\ j \neq i}}^{M-1} \mathcal{Z}_j,\int_Z p(\bm{z} \mid H_i) {\rm d}z = 1 Zi=Z−j=0j=i⋃M−1Zj,∫Zp(z∣Hi)dz=1

式(4)可写为

C ‾ = ∑ i = 0 M − 1 C i i P ( H i ) [ 1 − ∑ j = 0 j ≠ i M − 1 ∫ Z j p ( z ∣ H i ) ] d z + ∑ i = 0 M − 1 ∑ j = 0 j ≠ i M − 1 C i j P ( H j ) ∫ Z i p ( z ∣ H j ) d z \overline{C}= \sum_{i=0}^{M-1} C_{ii} P(H_i) \left[1- \sum_{\substack{j=0 \\ j \neq i}}^{M-1} \int_{\mathcal{Z}_j} p(\bm{z} \mid H_i) \right]{\rm d}\bm{z}+ \sum_{i=0}^{M-1} \sum_{\substack{j=0 \\ j \neq i}}^{M-1} C_{ij} P(H_j) \int_{\mathcal{Z}_i} p(\bm{z} \mid H_j) {\rm d}\bm{z} C=i=0∑M−1CiiP(Hi) 1−j=0j=i∑M−1∫Zjp(z∣Hi) dz+i=0∑M−1j=0j=i∑M−1CijP(Hj)∫Zip(z∣Hj)dz

展开

C ‾ = ∑ i = 0 M − 1 C i i P ( H i ) − ∑ i = 0 M − 1 ∑ j = 0 j ≠ i M − 1 C i i P ( H i ) ∫ Z j p ( z ∣ H i ) d z + ∑ i = 0 M − 1 ∑ j = 0 j ≠ i M − 1 C i j P ( H j ) ∫ Z i p ( z ∣ H j ) d z \overline{C}= \sum_{i=0}^{M-1} C_{ii} P(H_i) - \sum_{i=0}^{M-1} \sum_{\substack{j=0 \\ j \neq i}}^{M-1}C_{ii} P(H_i) \int_{\mathcal{Z}_j} p(\bm{z} \mid H_i) {\rm d}\bm{z} + \sum_{i=0}^{M-1} \sum_{\substack{j=0 \\ j \neq i}}^{M-1} C_{ij} P(H_j) \int_{\mathcal{Z}_i} p(\bm{z} \mid H_j) {\rm d}\bm{z} C=i=0∑M−1CiiP(Hi)−i=0∑M−1j=0j=i∑M−1CiiP(Hi)∫Zjp(z∣Hi)dz+i=0∑M−1j=0j=i∑M−1CijP(Hj)∫Zip(z∣Hj)dz

交换第二项的求和下标号: j → i j \rightarrow i j→i, i → j i \rightarrow j i→j;

C ‾ = ∑ i = 0 M − 1 C i i P ( H i ) − ∑ j = 0 M − 1 ∑ i = 0 i ≠ j M − 1 C j j P ( H j ) ∫ Z i p ( z ∣ H j ) d z + ∑ i = 0 M − 1 ∑ j = 0 j ≠ i M − 1 C i j P ( H j ) ∫ Z i p ( z ∣ H j ) d z \overline{C}= \sum_{i=0}^{M-1} C_{ii} P(H_i) - \sum_{j=0}^{M-1} \sum_{\substack{i=0 \\ i \neq j}}^{M-1} C_{jj} P(H_j) \int_{\mathcal{Z}_i} p(\bm{z} \mid H_j) {\rm d}\bm{z} + \sum_{i=0}^{M-1} \sum_{\substack{j=0 \\ j \neq i}}^{M-1} C_{ij} P(H_j) \int_{\mathcal{Z}_i} p(\bm{z} \mid H_j) {\rm d}\bm{z} C=i=0∑M−1CiiP(Hi)−j=0∑M−1i=0i=j∑M−1CjjP(Hj)∫Zip(z∣Hj)dz+i=0∑M−1j=0j=i∑M−1CijP(Hj)∫Zip(z∣Hj)dz

∑ i = 0 M − 1 ∑ j = 0 j ≠ i M − 1 a i j = ∑ j = 0 M − 1 ∑ i = 0 i ≠ j M − 1 a i j \sum_{i=0}^{M-1} \sum_{\substack{j=0 \\ j \neq i}}^{M-1} a_{ij} = \sum_{j=0}^{M-1} \sum_{\substack{i=0 \\ i \neq j}}^{M-1} a_{ij} ∑i=0M−1∑j=0j=iM−1aij=∑j=0M−1∑i=0i=jM−1aij( a i j a_{ij} aij求和,除去对角项),改变第二项的求和次序。

C ‾ = ∑ i = 0 M − 1 C i i P ( H i ) − ∑ i = 0 M − 1 ∑ j = 0 j ≠ i M − 1 C j j P ( H j ) ∫ Z i p ( z ∣ H j ) d z + ∑ i = 0 M − 1 ∑ j = 0 j ≠ i M − 1 C i j P ( H j ) ∫ Z i p ( z ∣ H j ) d z \overline{C}= \sum_{i=0}^{M-1} C_{ii} P(H_i) - \sum_{i=0}^{M-1} \sum_{\substack{j=0 \\ j \neq i}}^{M-1} C_{jj} P(H_j) \int_{\mathcal{Z}_i} p(\bm{z} \mid H_j) {\rm d}\bm{z} + \sum_{i=0}^{M-1} \sum_{\substack{j=0 \\ j \neq i}}^{M-1} C_{ij} P(H_j) \int_{\mathcal{Z}_i} p(\bm{z} \mid H_j) {\rm d}\bm{z} C=i=0∑M−1CiiP(Hi)−i=0∑M−1j=0j=i∑M−1CjjP(Hj)∫Zip(z∣Hj)dz+i=0∑M−1j=0j=i∑M−1CijP(Hj)∫Zip(z∣Hj)dz

然后,将后两项合并。

C ‾ = ∑ i = 0 M − 1 C i i P ( H i ) + ∑ i = 0 M − 1 ∫ Z i [ ∑ j = 0 j ≠ i M − 1 ( C i j − C j j ) P ( H j ) p ( z ∣ H j ) ] d z (5) \overline{C} = \sum_{i=0}^{M-1} C_{ii} P(H_i) + \sum_{i=0}^{M-1} \int_{\mathcal{Z}_i} \left[ \sum_{\substack{j=0 \\ j \neq i}}^{M-1} (C_{ij} - C_{jj}) P(H_j) p(\bm{z} \mid H_j) \right] {\rm d}\bm{z} \tag{5} C=i=0∑M−1CiiP(Hi)+i=0∑M−1∫Zi j=0j=i∑M−1(Cij−Cjj)P(Hj)p(z∣Hj) dz(5)

式中第一项为固定代价,而第二项随观测空间 Z \mathcal{Z} Z的划分而变化。

写在后面的话

这是很早的一本书,79年英文版,作者是1935年的,今年90了。82年中译本,那个年代的人比较弱,翻译中有些地方不说人话,好在认真,所以也能懂。

Introduction to statistical signal processing with applications November 1995

Authors:

M. D. Srinath,

P. K. Rajasekaran,

R. Viswanathan

Publisher:

Prentice-Hall, Inc.

Division of Simon and Schuster One Lake Street Upper Saddle River, NJ

United States

ISBN:978-0-13-125295-0

译本

还好守着国家图书馆,否则这么久远的书哪里找去。