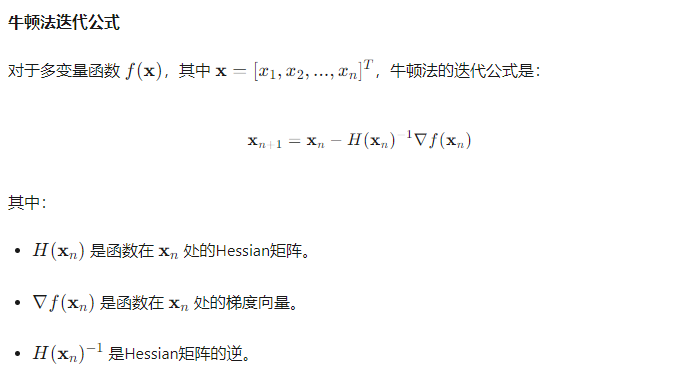

牛顿迭代公式

1. 牛顿迭代公式

2 梯度下降和最小值之间的关系

梯度下降与函数最小值之间的关系可以从以下四个角度深入解析:

2.1、数学原理的对应性

-

梯度方向与极值关联

梯度方向是多元函数增长最快的方向(由各变量偏导数组成的向量),而梯度下降法通过负梯度方向更新参数,使函数值逐步逼近极小值点。这一过程直接对应优化问题中寻找函数最小值的目标。 -

迭代终止条件

2.2、算法实现的核心机制

- 参数更新公式

- 步长的动态调节

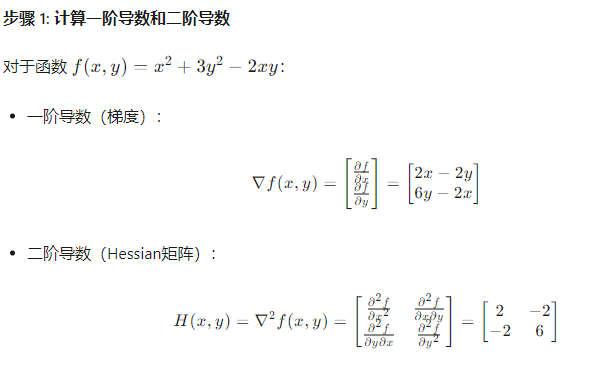

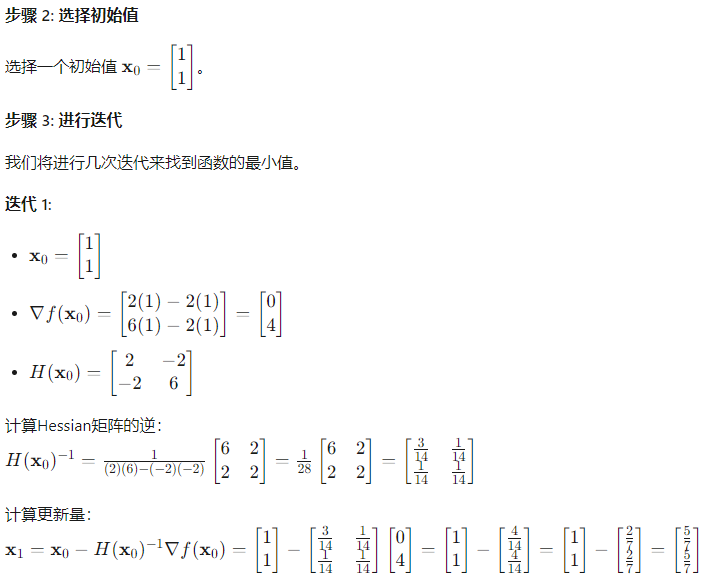

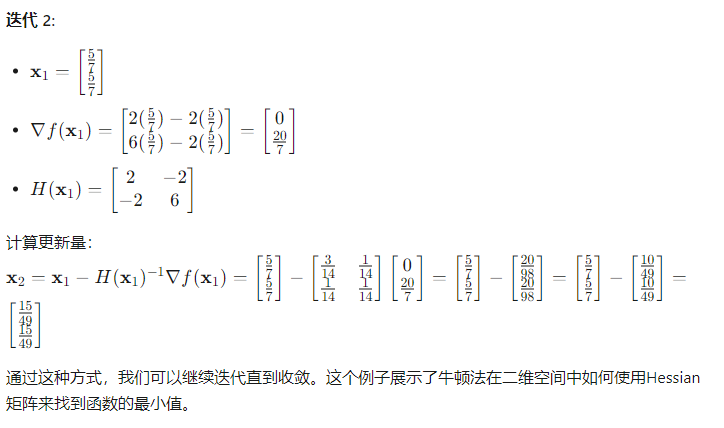

理想步长需通过线性搜索或自适应方法(如Adam算法)确定,以平衡收敛速度与稳定性。例如,Hessian矩阵在二阶优化中可辅助步长计算,但会增加复杂度。

2.3、应用场景的典型表现

-

机器学习模型训练

在损失函数优化中,梯度下降通过调整模型参数(如神经网络的权重)最小化预测误差。例如,线性回归模型使用梯度下降求解最小二乘问题,使预测值与真实值的偏差平方和最小。 -

物理与工程优化

如热力学系统能量最小化、结构设计中的应力分布优化等场景,均依赖梯度下降寻找目标函数的极小值点。

2.4、局限性及应对策略

-

局部最小值陷阱

非凸函数可能存在多个局部最小值,梯度下降可能陷入其中。解决方法包括:- 随机初始化参数(如深度学习中的权重初始化);

- 引入动量项(如带动量的随机梯度下降)。

-

鞍点问题

在高维空间中,鞍点(梯度为零但非极值的点)可能延缓收敛。二阶优化方法(如牛顿法)可部分解决此问题,但计算成本较高。

总结

梯度下降通过负梯度方向的迭代更新,将复杂的高维函数优化问题转化为逐步逼近最小值的可计算过程。其有效性依赖于梯度本身的数学性质(方向导数极值性)与算法参数(如学习率)的合理选择,成为现代优化理论与工程实践的基础工具。