Ollama+OpenWebUI+docker附带软件下载链接,配置流程,适合内网部署,可以多人内网使用

前言:

因为想到有些环境可能没法使用外网的大模型,所以可能需要内网部署,看了一下ollama适合小型的部署,所以就尝试了一下,觉得docker稍微简单一点,就做这个教程的,本文中重要的内容都会给下载链接,方便下载。

ollama下载链接在这里,25年5月1号左右的版本

v0.6.7/OllamaSetup.exe下载链接_ollama 0.6.7 下载-CSDN博客

然后ollama的使用下载教程,我以前写过了,可以参照

超简单! 部署本地deepseek r1详细指南 附带安装包_deepseek r1一键包-CSDN博客

ollama到此为止。

OpenWebUI

两种方式,我选择docker形式

按道理先要去docker官网下载软件,我这里给一下官网的地址

Docker官⽹:https://www.docker.com/

中文网: Docker中文网 官网

还有我的百度网盘地址:

通过网盘分享的文件:Docker Desktop Installer.exe

链接: https://pan.baidu.com/s/128BPUTU6GHNOEidXYMGkEg?pwd=zbcf 提取码: zbcf

先下载下来

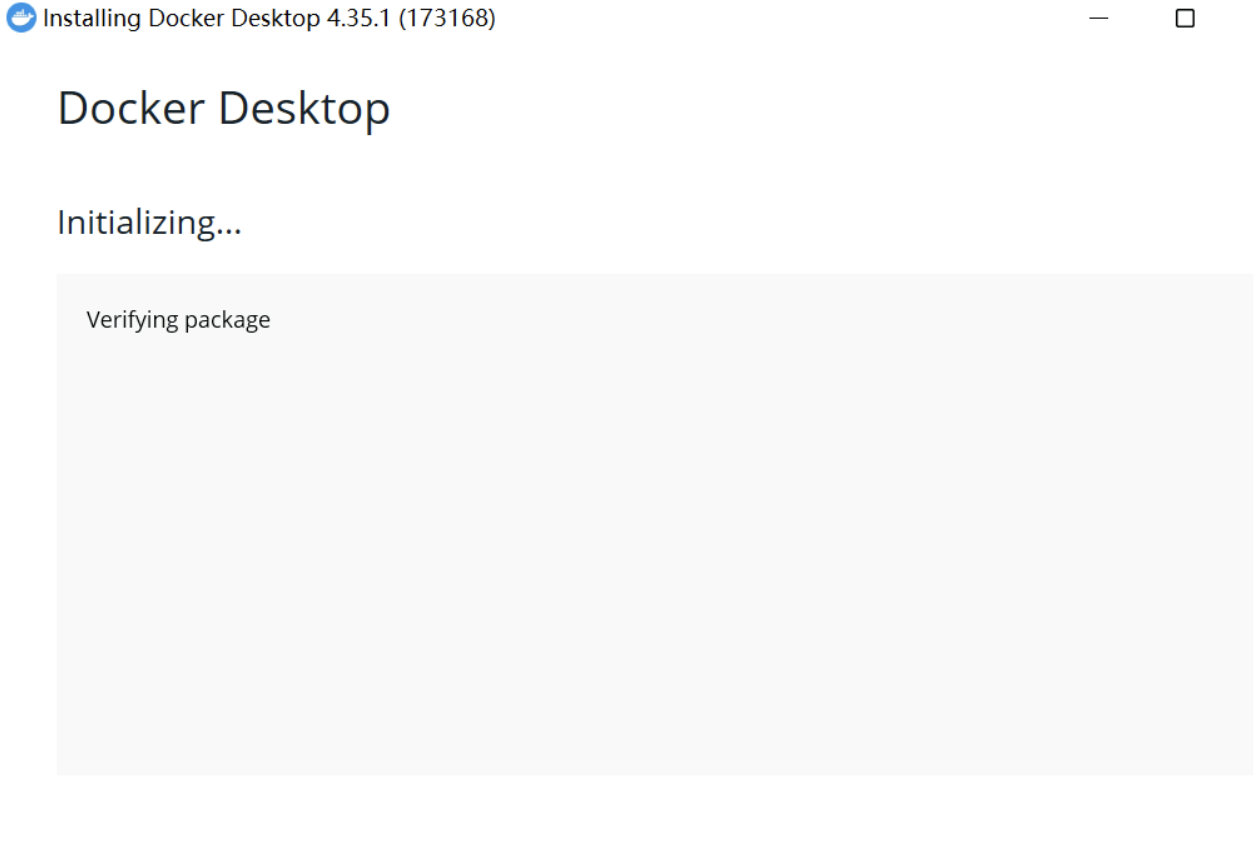

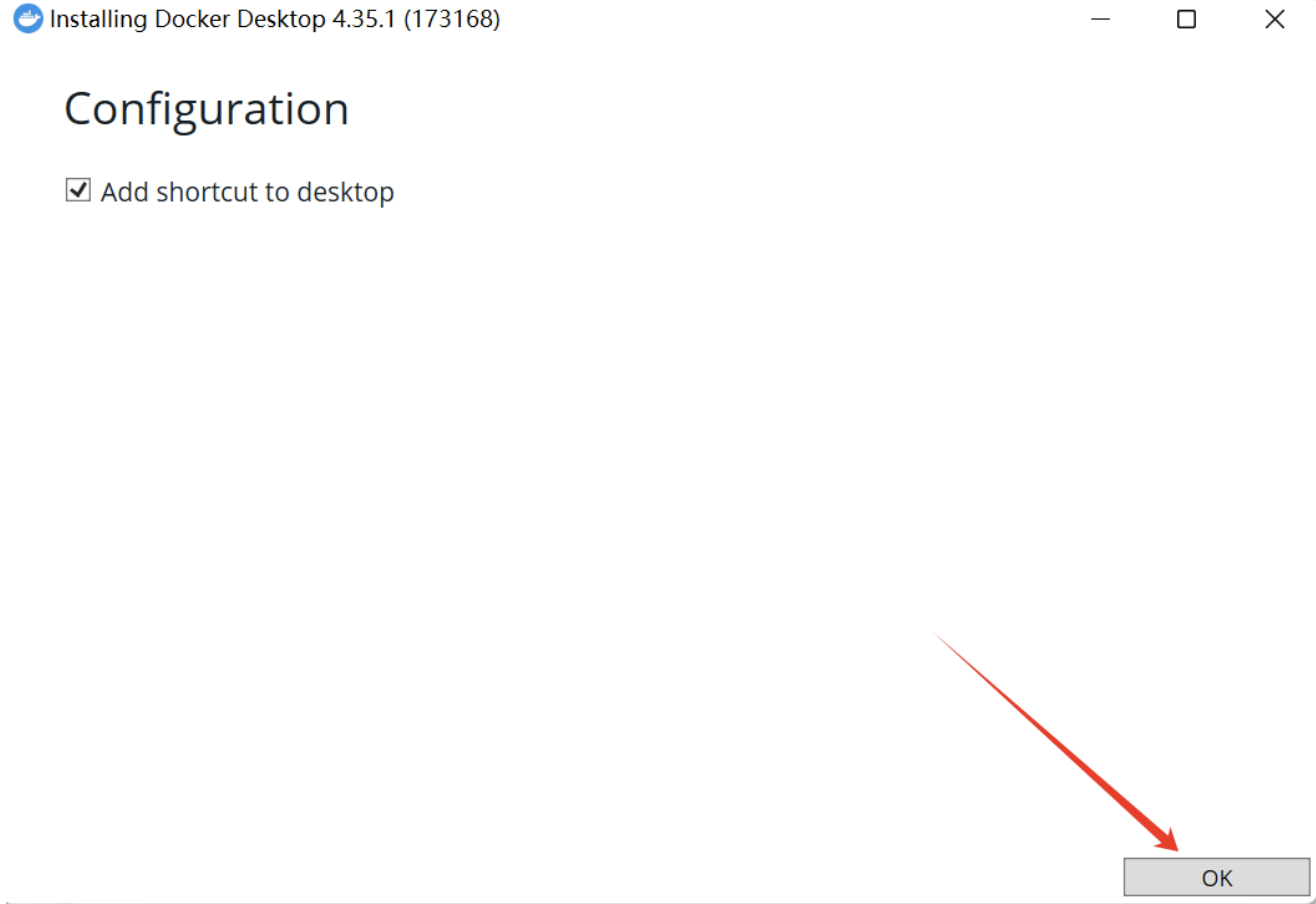

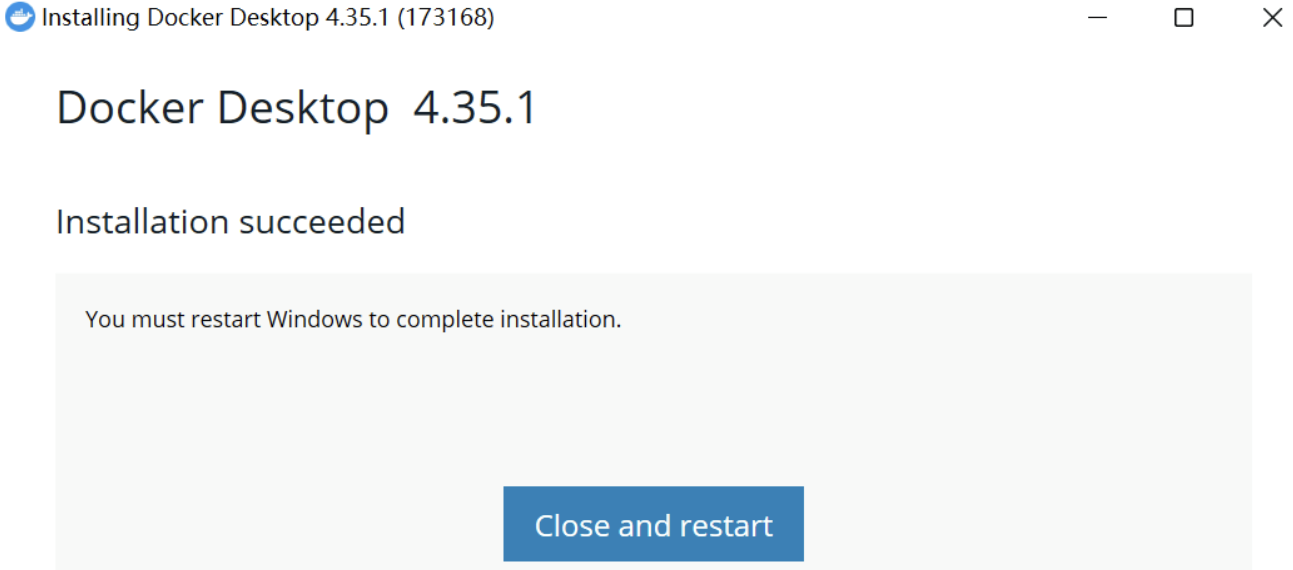

docker的安装

双击安装

这边要添加路径

重启电脑

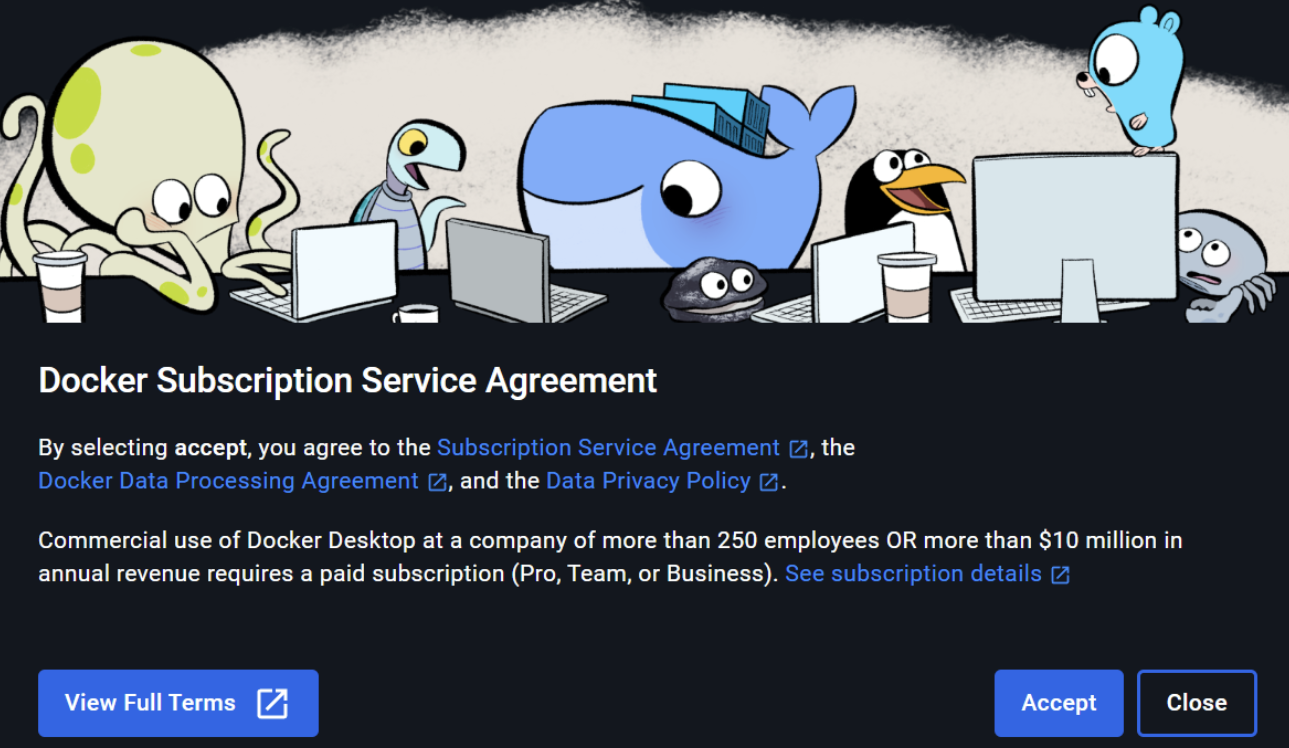

接受协议

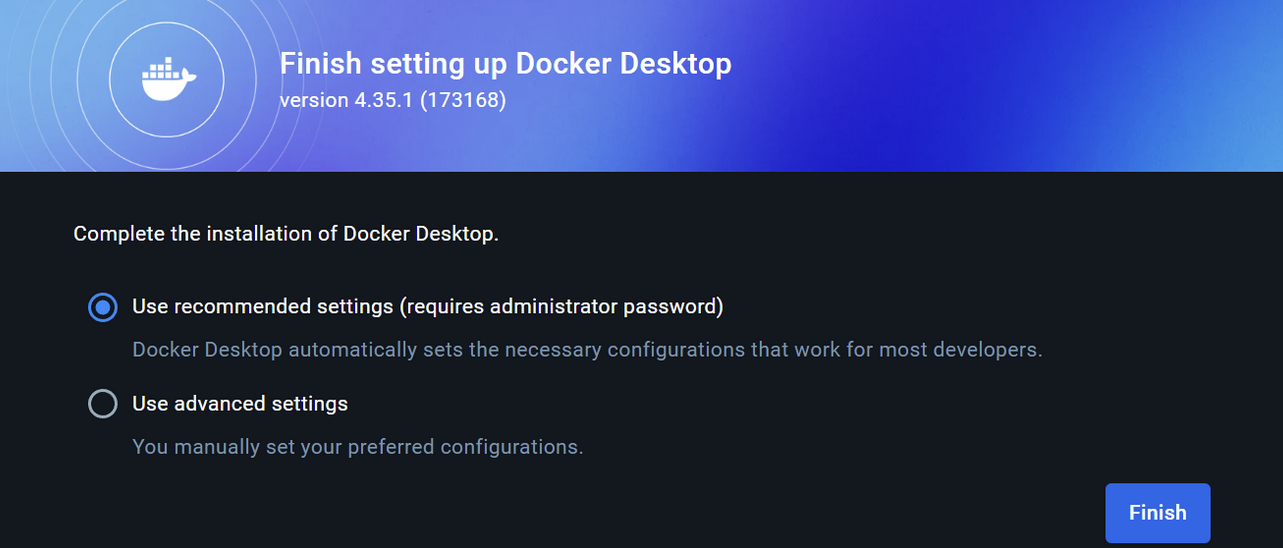

推荐设置

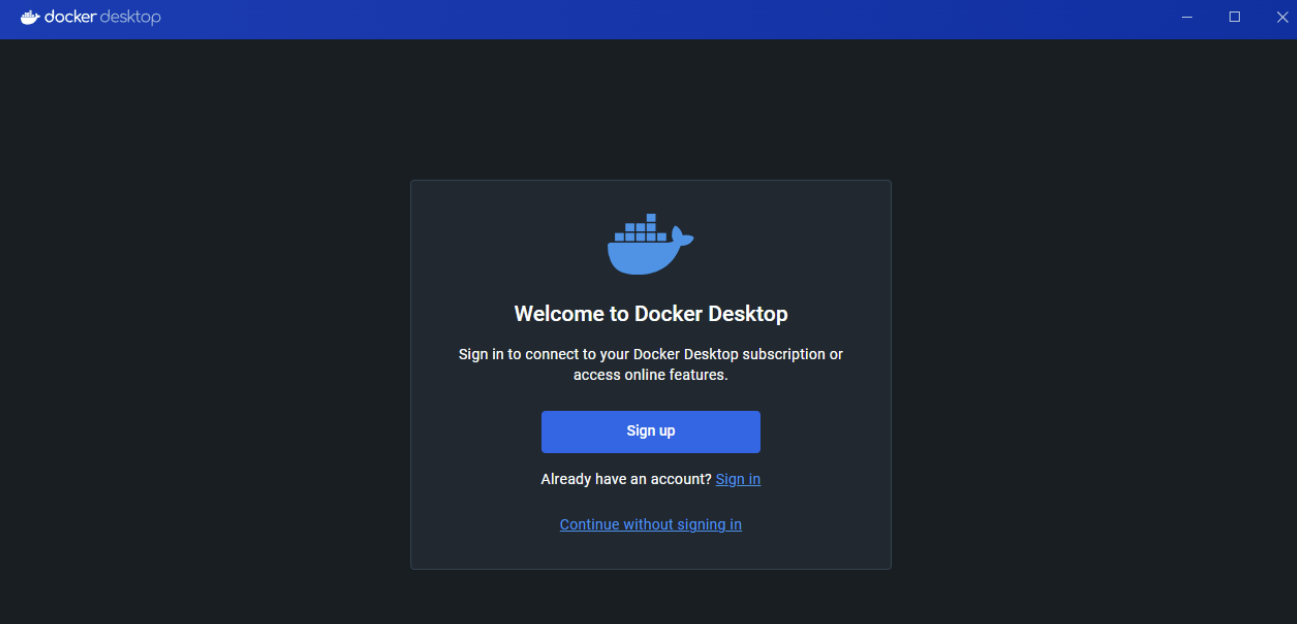

跳过登陆(最下面continnue without signing in)

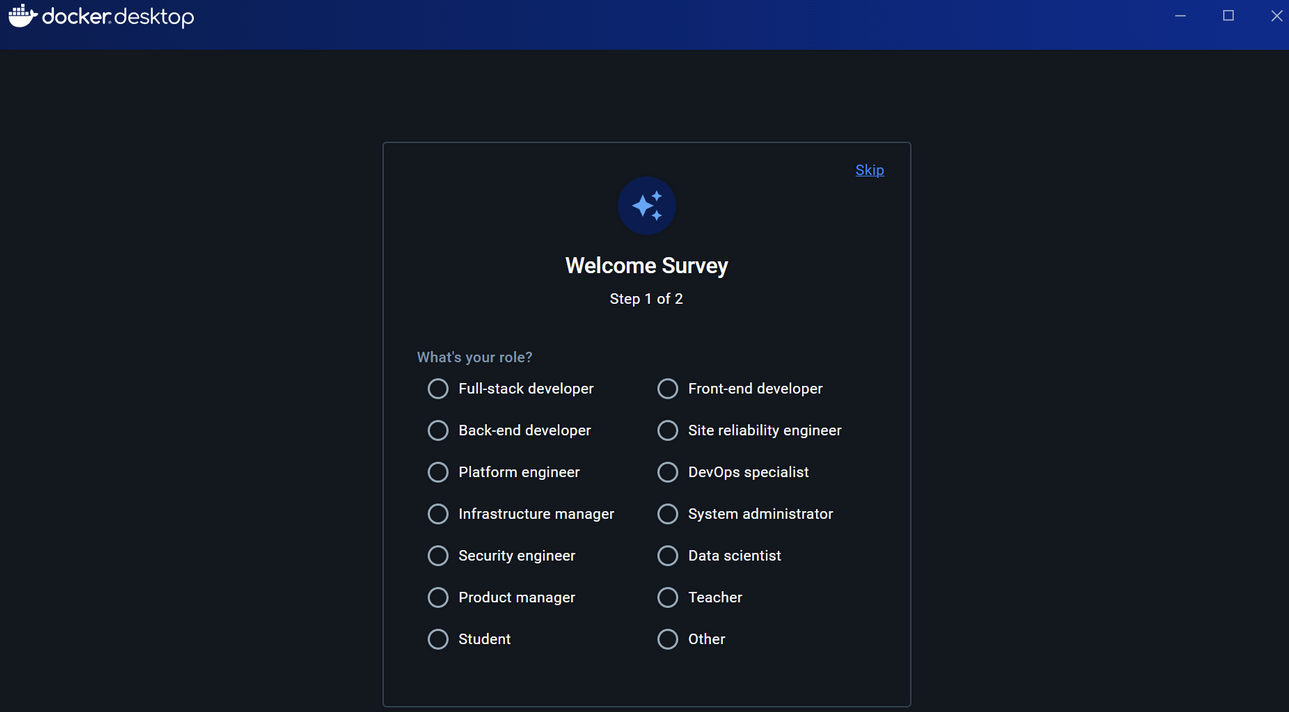

skip跳过

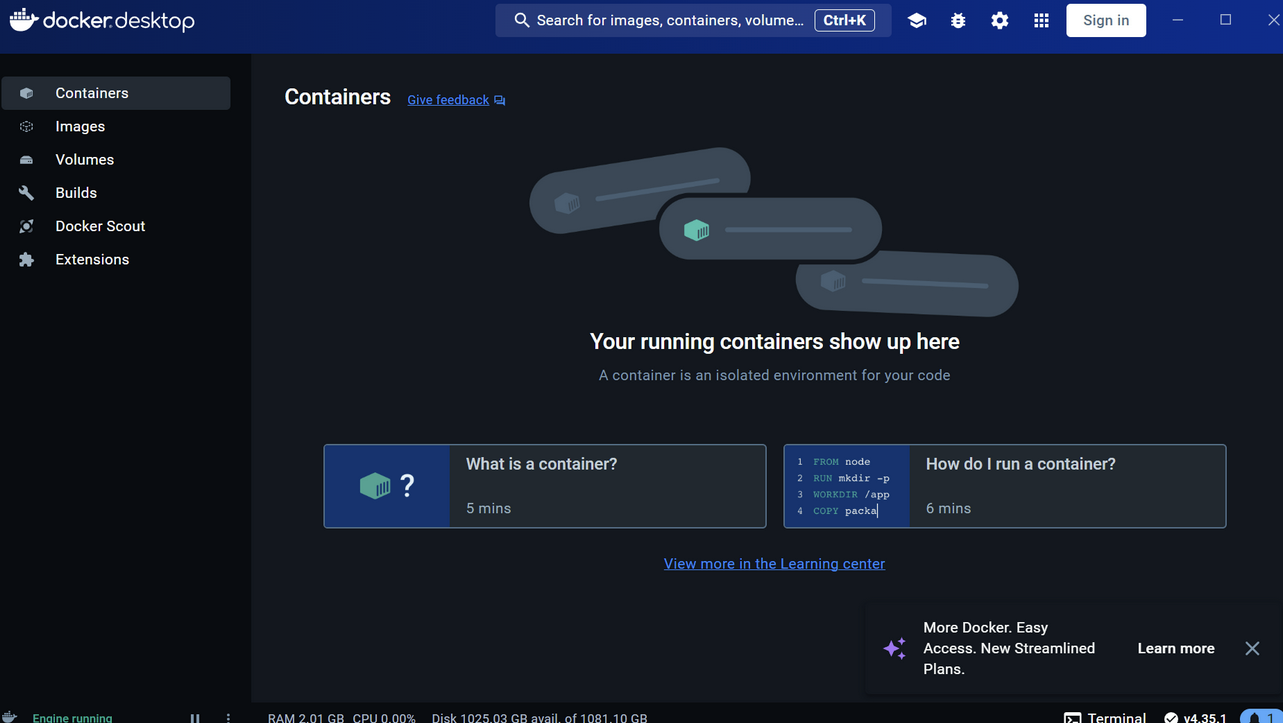

顺利进入

docker的汉化

方便起见,直接我给出汉化包

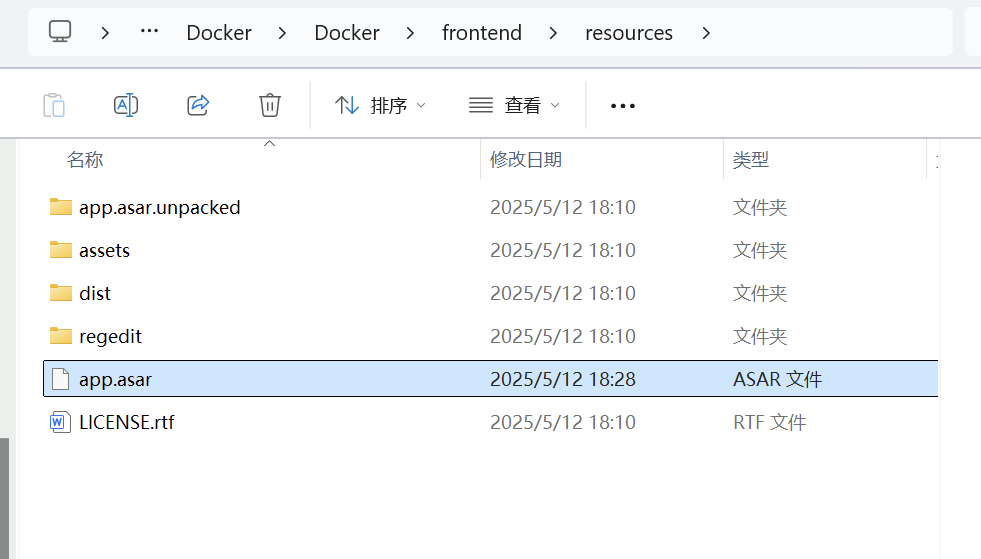

通过网盘分享的文件:app.asar

链接: https://pan.baidu.com/s/1VeXuVCRo4us9aUqKPtT38g?pwd=5q7j 提取码: 5q7j

app.asar 替换原来的就好了,我估计是语言文件

重新打开就汉化成功

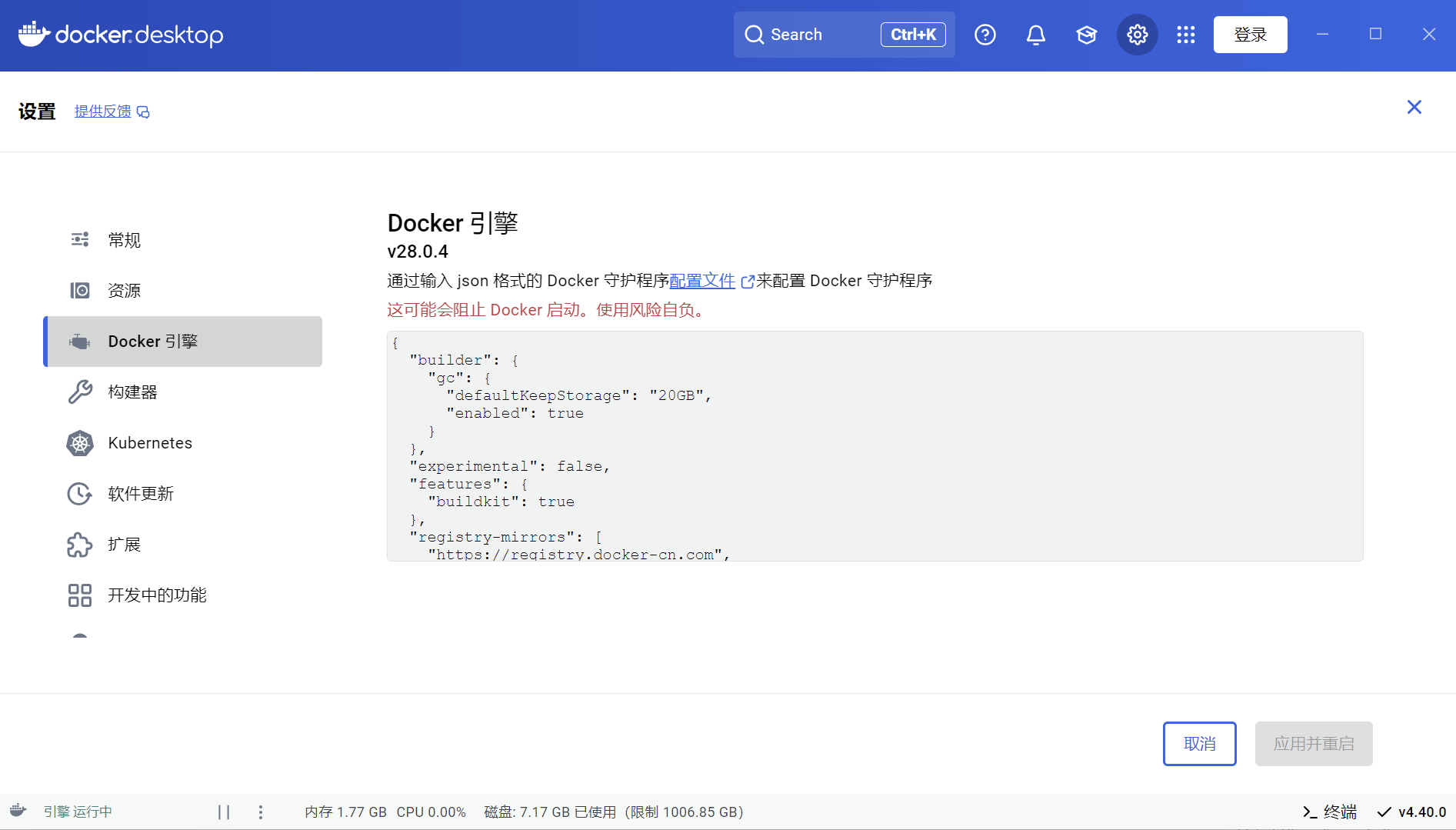

docker替换源

打开设置,找到docker引擎

把这里所有复制进去,换成国内源

{"builder": {"gc": {"defaultKeepStorage": "20GB","enabled": true}},"experimental": false,"features": {"buildkit": true},"registry-mirrors": ["https://registry.docker-cn.com","http://hub-mirror.c.163.com","https://docker.mirrors.ustc.edu.cn","https://cr.console.aliyun.com","https://mirror.ccs.tencentyun.com"]

}安装 open-webui

一句命令,复制,然后cmd打开,运行就好了

docker run -d -p 3000:8080 -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

会下载一段时间

C:\Users\18178>docker run -d -p 3000:8080 -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

Unable to find image 'ghcr.io/open-webui/open-webui:main' locally

main: Pulling from open-webui/open-webui

254e724d7786: Pull complete

eb0baa05daea: Pull complete

457229a5b852: Pull complete

b658f584ba6e: Pull complete

ef9a42a8925e: Pull complete

4f4fb700ef54: Pull complete

a328afb1a1bf: Pull complete

76dea603ebad: Pull complete

eb609898c965: Downloading [=========> ] 62.66MB/341.1MB

274002cd569b: Download complete

725a63749080: Downloading [==> ] 54.75MB/1.312GB

410e23914911: Downloading [=======================> ] 42.91MB/90.9MB

e4b0cd930f1a: Waiting

56dc55632e0c: Waiting

d297a6f5c191: Waiting下载好了就得到了docker

点击3000:8000就可以访问,或http://127.0.0.1:3000/ 看到界面

随便注册,随便写邮箱,进去就ok

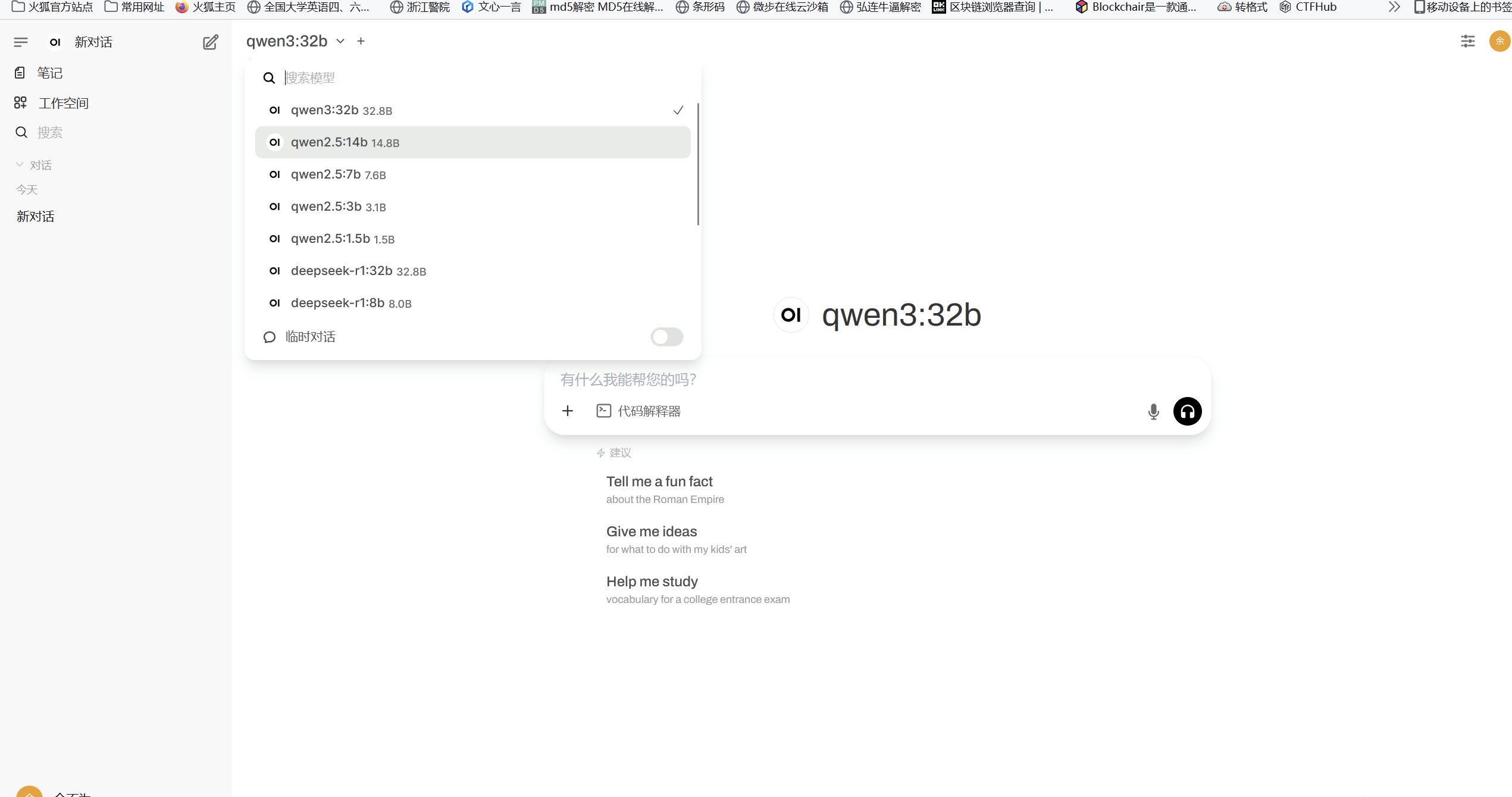

配置ollama+OpenWebUI

添加ollama模型,这里只要添加ollama的地址就好了,不用一个一个模型添加

打开设置 外部连接 添加链接 然后添加ollama的链接 http://localhost:11434

这里不用密码,但是不写不行,所以随便写一个123都可以

添加之后,就可以看到自己ollama下面的所有模型

可以对话