RNN 与 CNN:深度学习中的两大经典模型技术解析

在人工智能和深度学习领域,RNN(Recurrent Neural Network,循环神经网络) 和 CNN(Convolutional Neural Network,卷积神经网络) 是两种非常重要的神经网络结构。

它们分别擅长处理不同类型的数据,在自然语言处理、计算机视觉等多个领域中发挥着关键作用。

本文将从原理、特点、应用场景等方面对这两种模型进行详细解析。

一、CNN(卷积神经网络):图像识别的“火眼金睛”

1. 基本原理

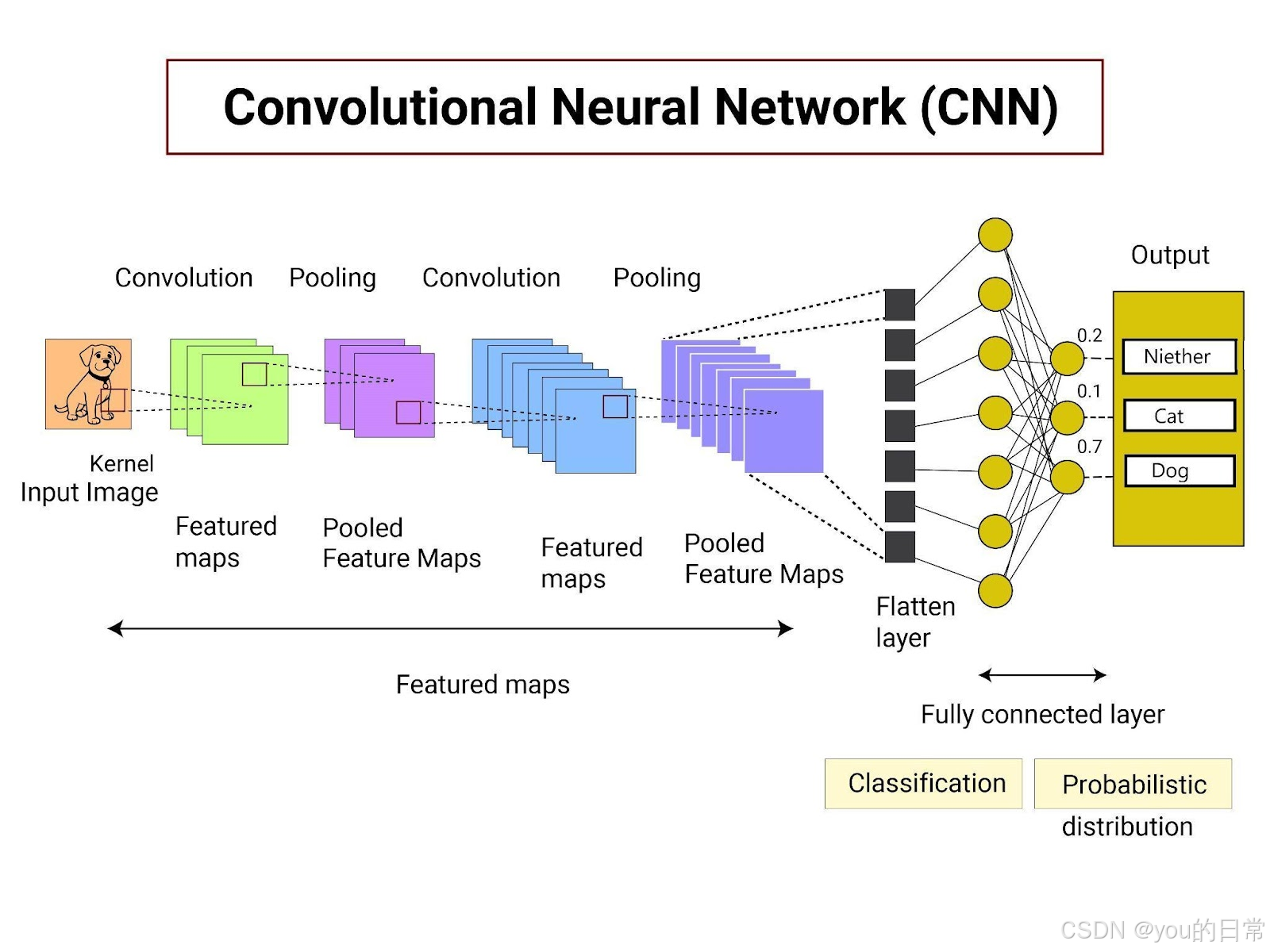

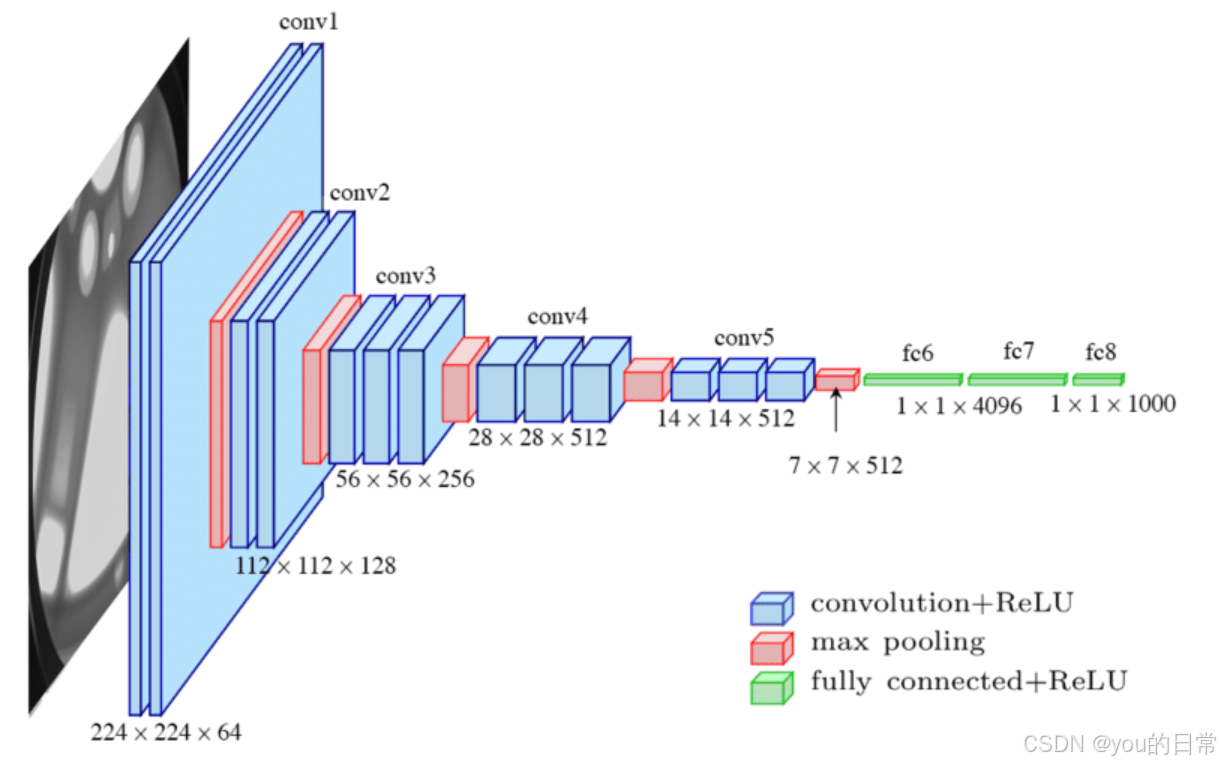

CNN 是一种专为处理具有类似网格结构数据(如图像)而设计的前馈神经网络。它通过引入卷积层(Convolution Layer)、池化层(Pooling Layer) 和 全连接层(Fully Connected Layer) 来自动提取图像的局部特征,并进行分类或识别。

核心组件:

-

卷积层(Convolution Layer):

- 使用多个滤波器(Filter)滑动扫描输入图像。

- 每个滤波器提取特定类型的局部特征(如边缘、角点等)。

- 输出称为特征图(Feature Map)。

-

激活函数(Activation Function):

- 常用 ReLU(Rectified Linear Unit),用于引入非线性特性。

-

池化层(Pooling Layer):

- 对特征图进行下采样(如最大池化、平均池化),减少计算量并增强平移不变性。

-

全连接层(Fully Connected Layer):

- 将前面提取的高维特征映射到输出类别空间,完成最终分类。

2. 特点

- 局部感知(Local Receptive Fields):每个神经元只关注输入的一部分区域,模拟人眼对图像的局部感知机制。

- 参数共享(Shared Weights):同一个滤波器在整个图像上共享权重,大大减少了模型参数数量。

- 平移不变性(Translation Invariance):池化操作使得模型对图像中小幅度的平移不敏感。

3. 应用场景

- 图像分类(如 ImageNet)

- 目标检测(YOLO、Faster R-CNN)

- 图像分割(U-Net)

- 视频分析(动作识别)

二、RNN(循环神经网络):序列建模的“记忆大师”

1. 基本原理

RNN 是一种专门用于处理序列数据(如文本、语音、时间序列)的神经网络。与传统神经网络不同,RNN 具有循环结构(Recurrent S