ReLU函数及其Python实现

ReLU函数及其Python实现

文章目录

- ReLU函数及其Python实现

- 1. ReLU函数定义

- 2. Python实现

- 3. 在深度学习中的应用

- 总结

1. ReLU函数定义

ReLU(Rectified Linear Unit,修正线性单元)函数是深度学习中常用的激活函数之一。它的定义非常简单:对于输入值 x x x,如果 x x x 大于0,则输出 x x x;如果 x x x 小于或等于0,则输出0。

数学表达式如下:

ReLU ( x ) = max ( 0 , x ) \text{ReLU}(x) = \max(0, x) ReLU(x)=max(0,x)

或者可以写成分段函数的形式:

f ( x ) = { x if x > 0 0 if x ≤ 0 f(x) = \begin{cases} x & \text{if } x > 0 \\ 0 & \text{if } x \le 0 \end{cases} f(x)={x0if x>0if x≤0

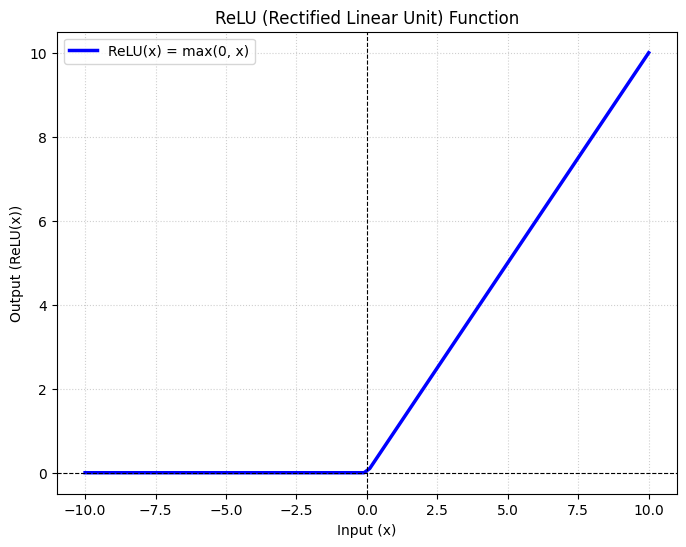

ReLU函数图像如下所示:

当输入为负数或零时,输出为零;当输入为正数时,输出等于输入本身。

2. Python实现

使用Python实现ReLU函数非常直接。我们可以利用numpy库来高效地处理数组(在神经网络中通常是向量或矩阵形式的输入)。

import numpy as npdef relu(x):"""计算ReLU激活函数参数:x: 输入值,可以是单个数值、numpy数组或列表返回:应用ReLU函数后的结果"""# 确保输入是numpy数组以便进行元素级比较x = np.asarray(x)return np.maximum(0, x)# 示例

# 单个数值

print(f"ReLU(5) = {relu(5)}")

print(f"ReLU(-3) = {relu(-3)}")

print(f"ReLU(0) = {relu(0)}")# Numpy数组

input_array = np.array([-2, -1, 0, 1, 2])

output_array = relu(input_array)

print(f"ReLU({input_array}) = {output_array}")# 列表

input_list = [-1.5, 0.5, 2.5]

output_list = relu(input_list)

print(f"ReLU({input_list}) = {output_list}")

上述代码定义了一个relu函数,它接受一个输入x(可以是数字、列表或Numpy数组),并返回应用ReLU函数后的结果。np.maximum(0, x)函数会逐元素比较输入x和0,并返回较大的那个值,这正好符合ReLU的定义。

3. 在深度学习中的应用

ReLU函数因其简单性和有效性,在现代深度神经网络中得到了广泛应用,特别是在卷积神经网络(CNN)和多层感知机(MLP)的隐藏层中。它相比于传统的Sigmoid或Tanh等激活函数,具有以下几个主要优点:

- 计算效率高:ReLU函数的计算仅涉及简单的比较和赋值操作,计算成本远低于Sigmoid或Tanh函数中的指数运算。

- 缓解梯度消失问题:对于正数输入,ReLU函数的导数为1。这意味着在反向传播过程中,梯度可以更容易地流过网络,减少了梯度消失(Vanishing Gradients)的风险,使得训练更深层的网络成为可能。相比之下,Sigmoid和Tanh函数在输入值较大或较小时,其导数接近于0,容易导致梯度消失。

- 引入稀疏性:当输入小于等于0时,ReLU的输出为0,这会导致一部分神经元的输出为0。这种稀疏性可以使网络对噪声具有更好的鲁棒性,并可能有助于提取更有用的特征,类似于生物神经元的激活模式。

缺点与变种:

尽管ReLU很受欢迎,但它也有一个主要的缺点,称为“Dying ReLU”问题:如果一个神经元的输入在训练过程中持续为负,那么该神经元的输出将始终为0,并且其梯度在反向传播中也将始终为0。这意味着该神经元将不再对任何数据进行响应,并且其权重无法再更新。

为了解决这个问题,研究人员提出了一些ReLU的变种,例如:

- Leaky ReLU (LReLU):当输入为负时,输出一个小的正斜率(如0.01x),而不是0。 f ( x ) = max ( α x , x ) f(x) = \max(\alpha x, x) f(x)=max(αx,x),其中 α \alpha α 是一个小的正常数。

- Parametric ReLU (PReLU):Leaky ReLU的一种变体,其中负数部分的斜率 α \alpha α 是一个可学习的参数。

- Exponential Linear Unit (ELU):在负数区域具有平滑的饱和特性,有助于提高模型的鲁棒性。

尽管存在这些变种,标准的ReLU函数仍然是许多深度学习应用中的默认和首选激活函数。

总结

ReLU函数以其简洁的定义、高效的计算和有效缓解梯度消失问题的能力,成为了深度学习领域最重要的激活函数之一。理解其工作原理和Python实现对于构建和训练现代神经网络至关重要。