信息科技伦理与道德3-4:面临挑战

1 人机结合

1.1 人机结合的挑战

- 如何处理好人与机器的决策的关系?

- 智能决策的不透明、不可解释性…

- 出了问题该谁负责?

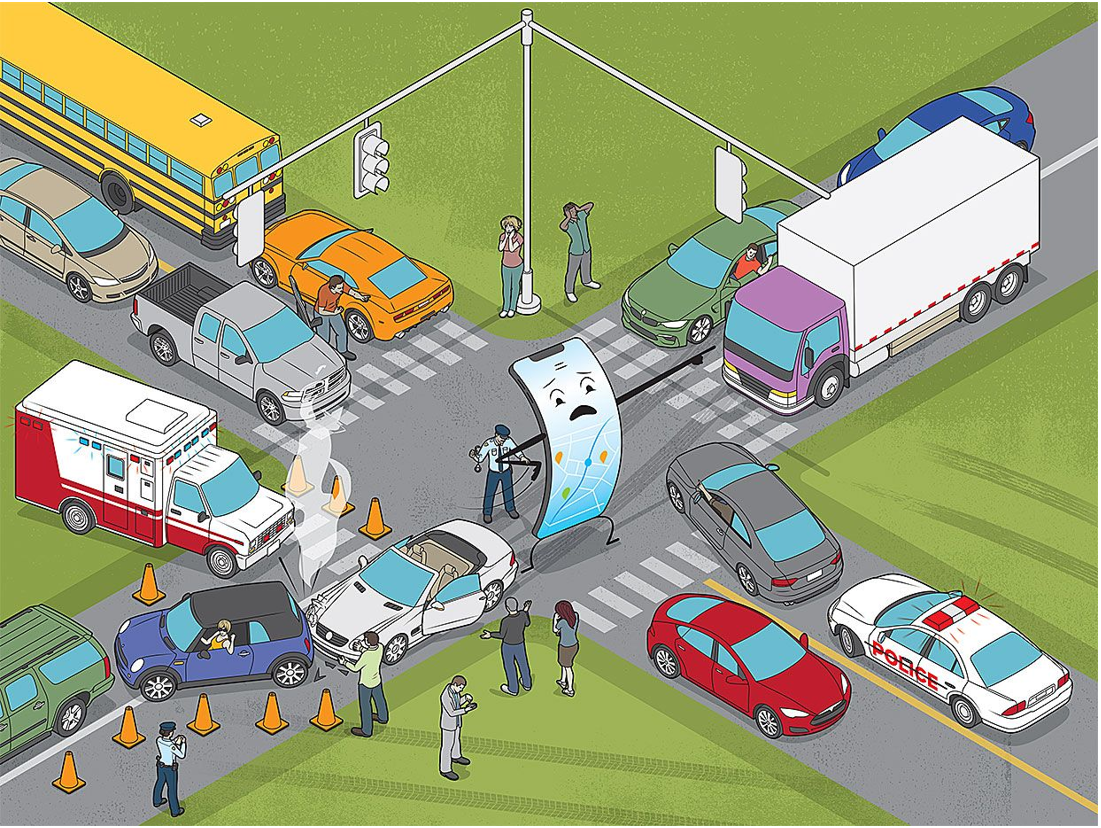

案例1:设想救护车调度系统造成混乱

- 某城市使用一个机器学习平台来进行城市里医院的救护车调度工作。起初,这个平台工作地很高效,纽约的医疗体系运转地井井有条。但在上线的几个月后,它开始将任务集中分配给个别医院,造成了拥挤和混乱。

- “系统在此之前做出了奇怪的决定,结果总是被证明是天才的……我们不知道到底发生了什么,但我们只是认为人工智能知道它在做什么”。

- 我们应该怎样使用调度系统?它的意见应该多大程度地被采纳?出现问题时如何人为地应急呢?

- 当我们不知道调度系统为什么做出决策的时候,是否应该信任它?应该采取什么措施?

- 出现事故之后,我们应该怎样处理事故责任各方?

案例2 :【TED】如何让人类与人工智能合作来改善业务

https://www.bilibili.com/video/BV1rQ4y1K7hC?t=827.7

【TED演讲】如何让人类与人工智能合作来改善业务

案例3:人工智能辅助医疗诊断

2021年,汤珂教授在华东师范大学做了一次学术报告:该报告设计了人工智能辅助人类决策的实验,发现人工智能可以更好的帮助医生进行诊断。

实验分两轮,第一轮为医生自主诊断20个病例,第二轮针对同样的病例,AI首先给出诊断结果,之后看医生是否修改其判断。

本文收集了351位医生的样本,获得了7020条病例诊断数据。当AI和医生在第一轮判断不同时,第二轮40%的医生修改了其答案,在AI的帮助下,医生的准确率平均提升了9%

汤珂 教授

清华大学社会科学学院经济所