deepseek本地部署并搭建个人知识库

学习视频:DeepSeek R1,本地部署才是王道!

超详细!本地部署DeepSeek-R1+搭建专属AI知识库

一、本地部署

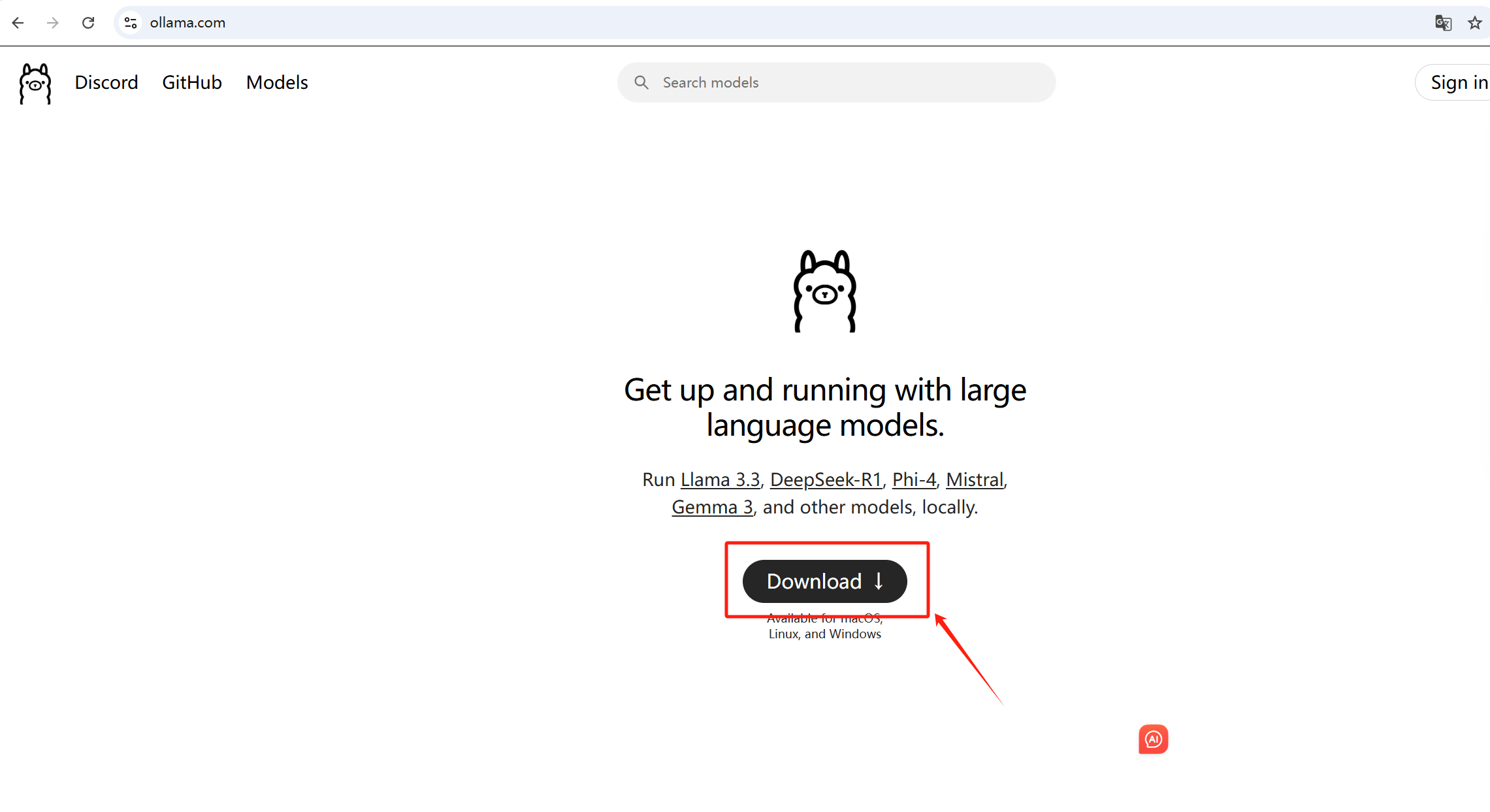

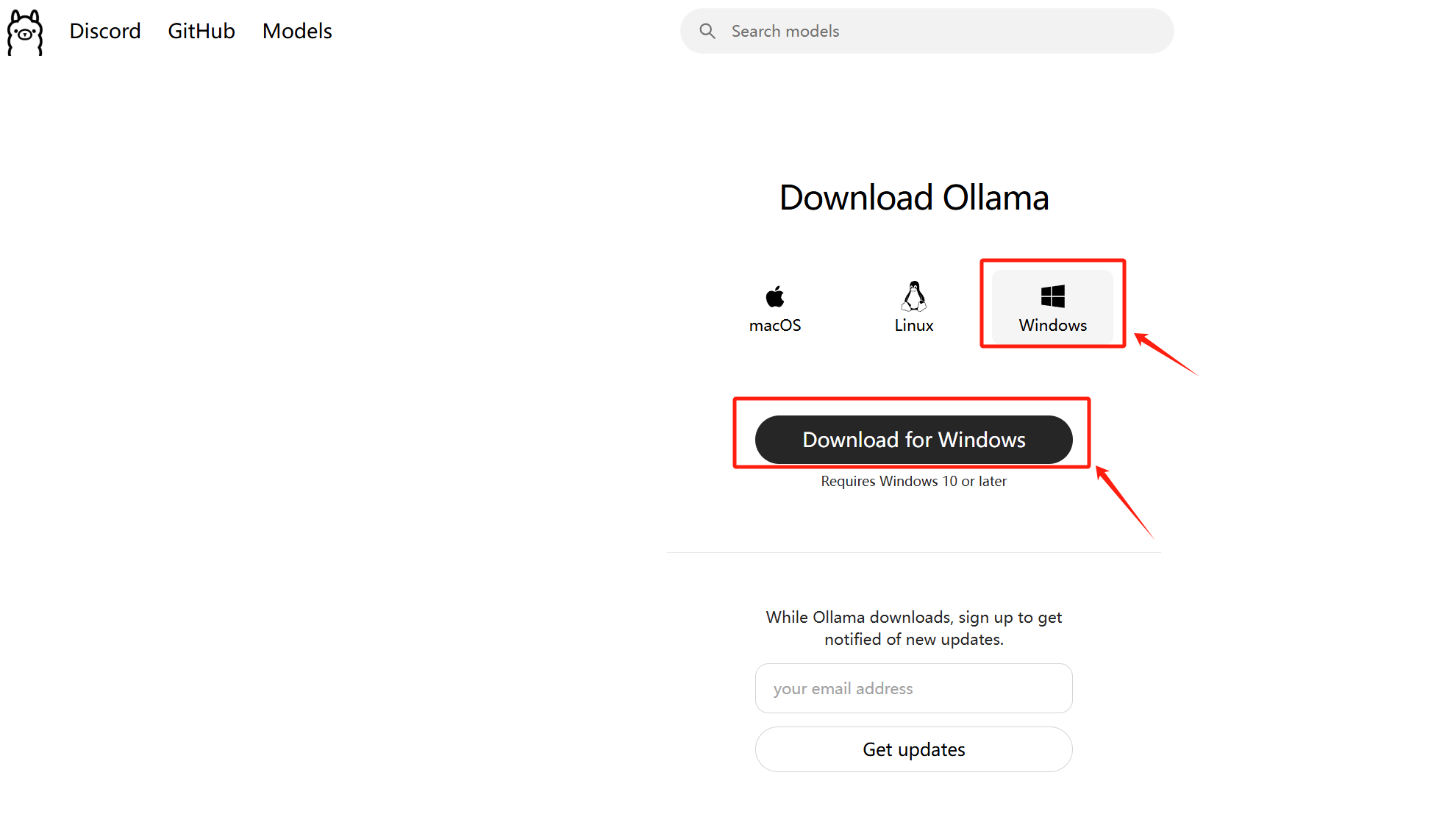

1、本地部署AI大模型,推荐使用ollama框架 olla主页

下载比较简单,一直点击下一步即可,下载完成后会打开这样的页面

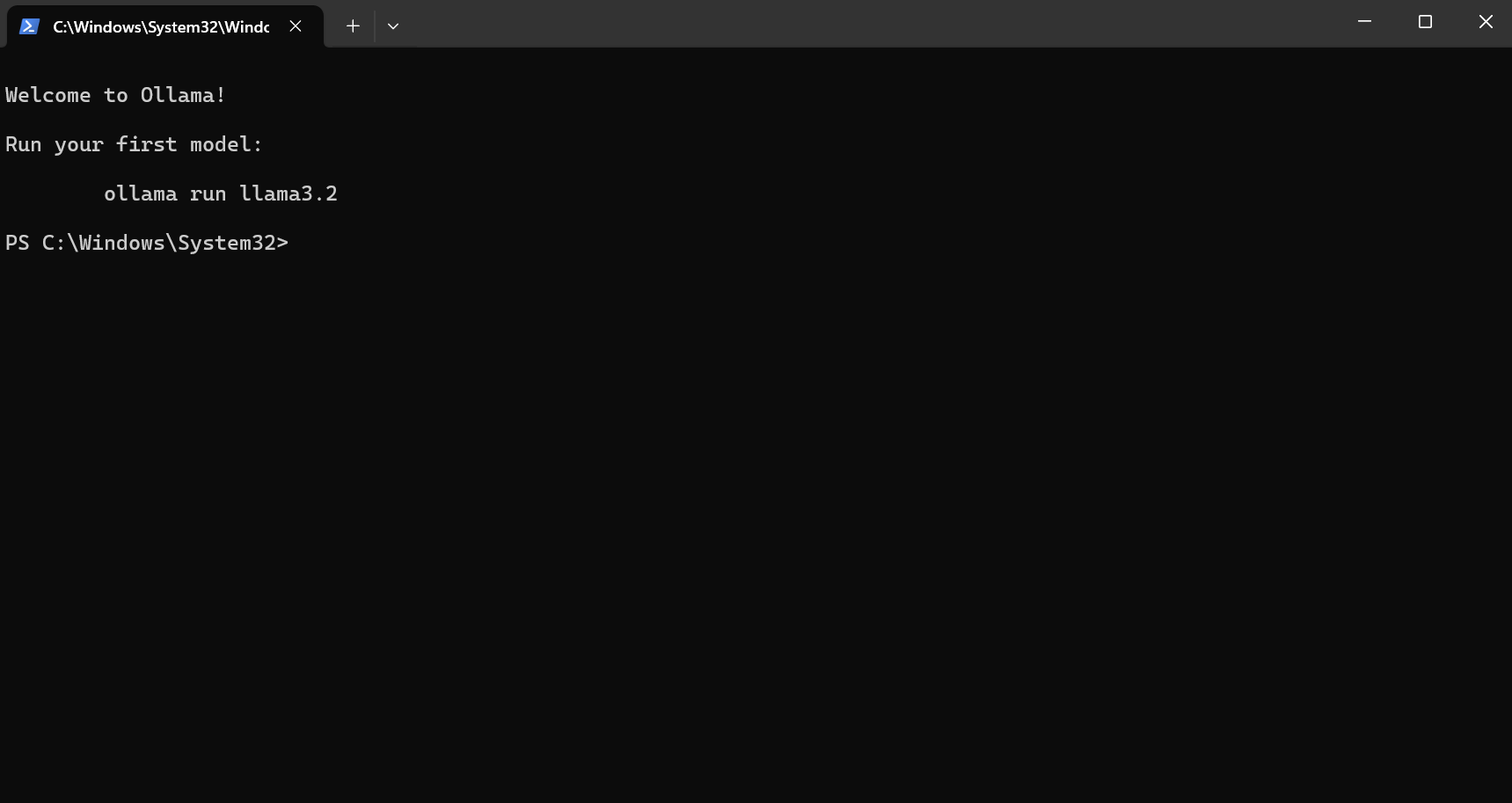

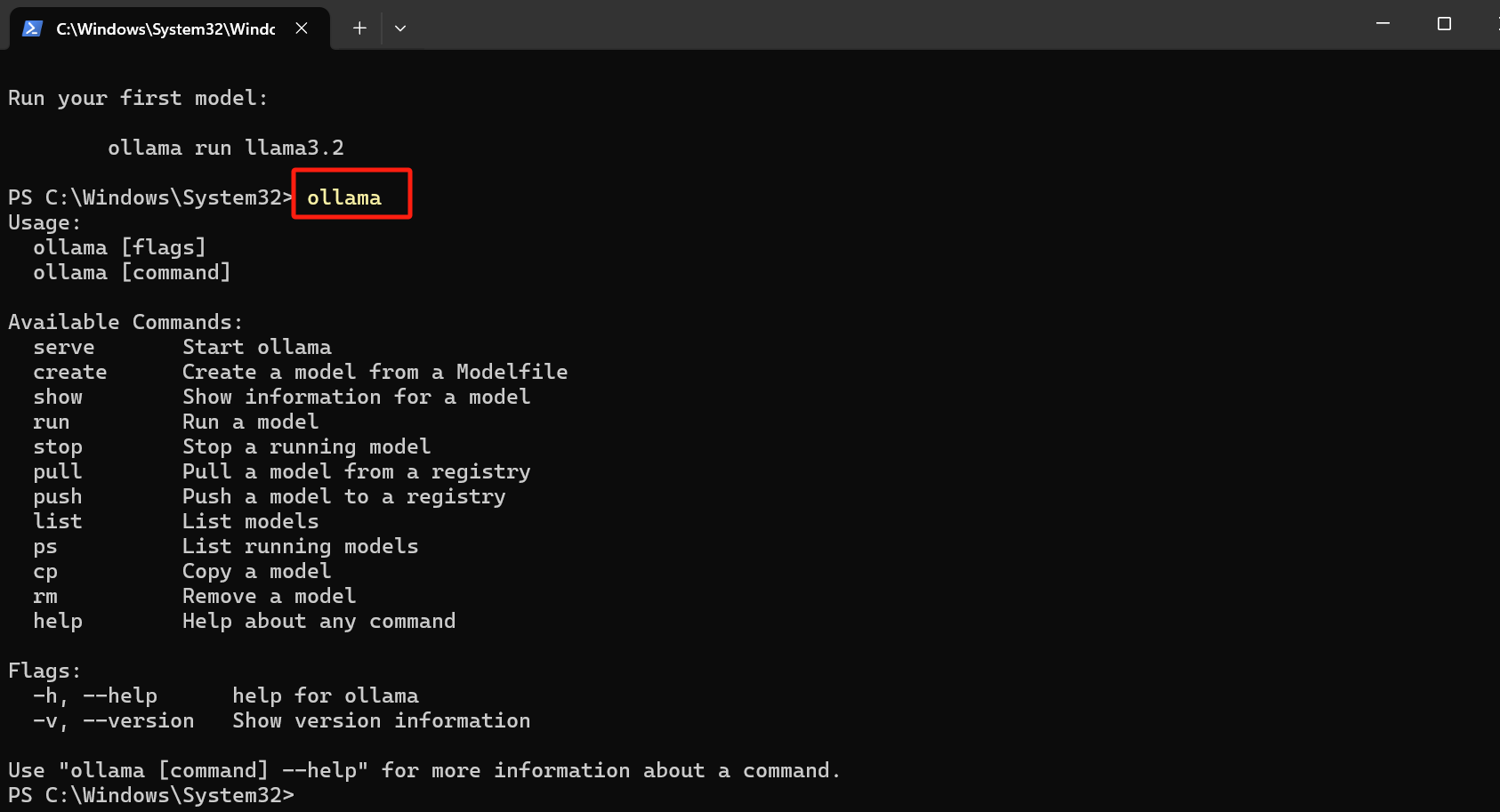

在命令行窗口输入ollama,出现下面信息即为成功

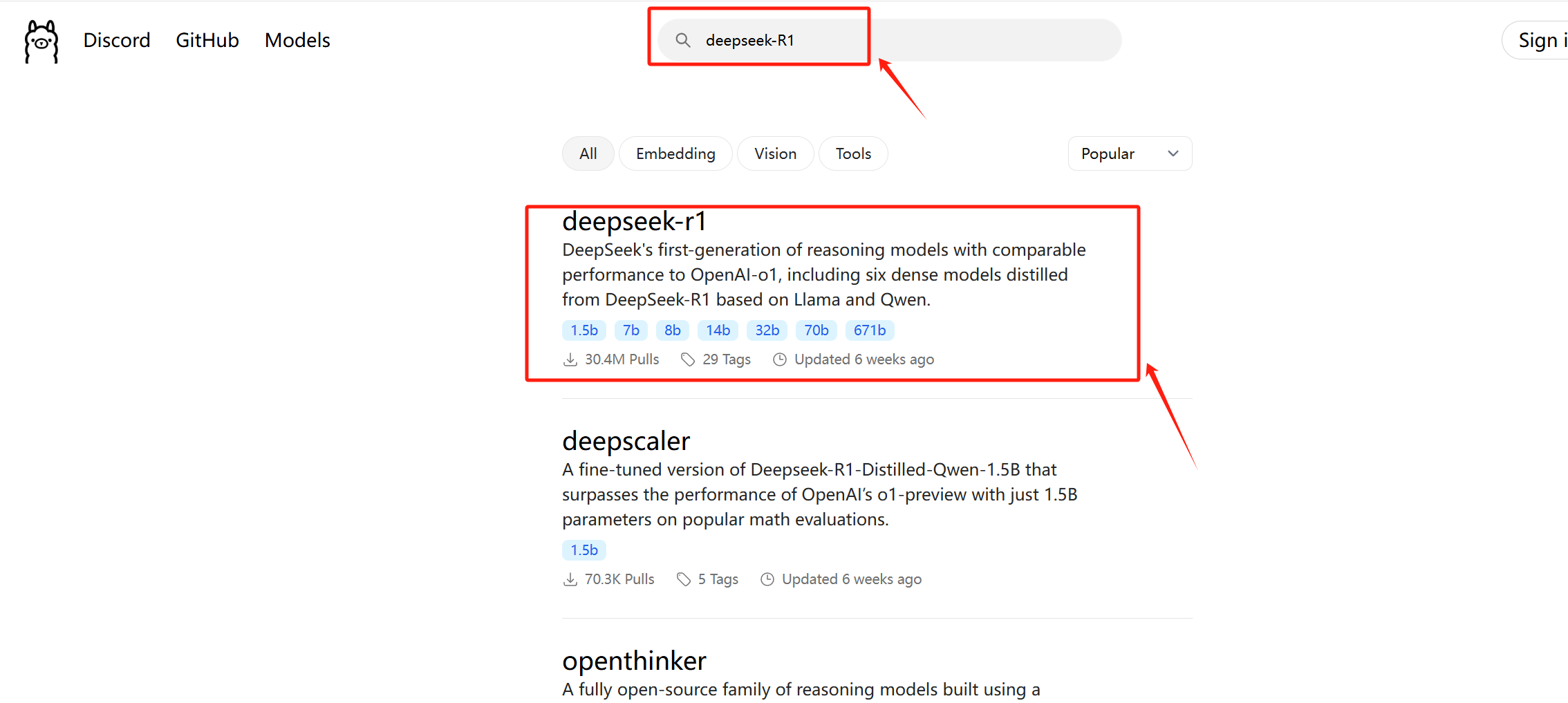

在ollama官网输入deepseek-R1

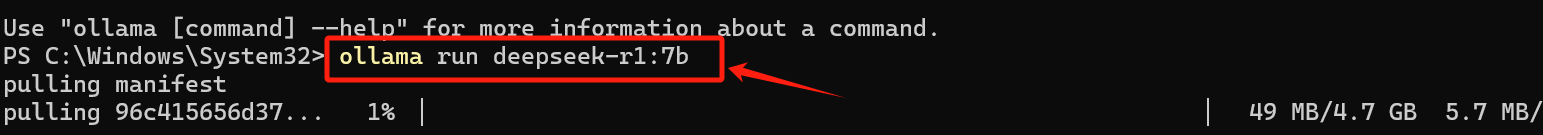

在命令行里输入官网提供的命令即可(这里选择7b还是其它的,是根据自己电脑情况而定)

1.5b 模型,4GB显存就能跑。 7b、8b 模型,8GB显存就能跑。 14b 模型,12GB显存能跑。 32b 模型,24GB显存能跑。

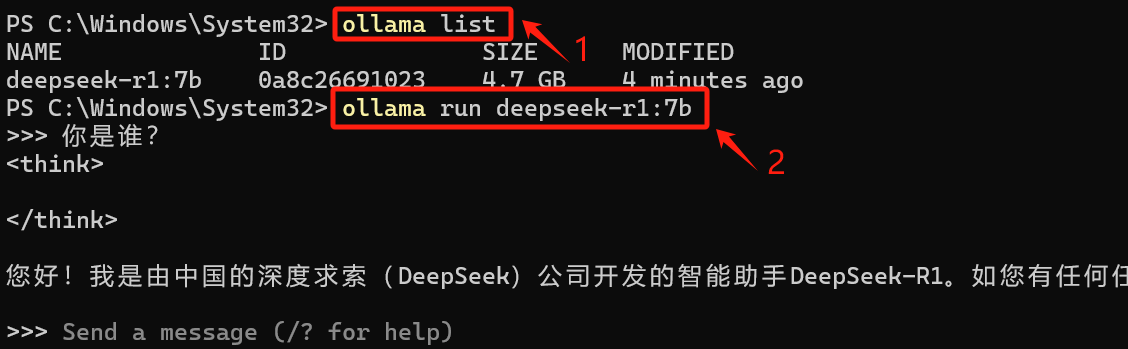

部署完成后,就可以本地询问问题

具体方式:1、在命令行输入ollama list 可以查看本地大模型;2、在命令行输入ollama run 大模型名字即可进行使用

二、网页版

1、在chrome应用商店安装page Assist 插件

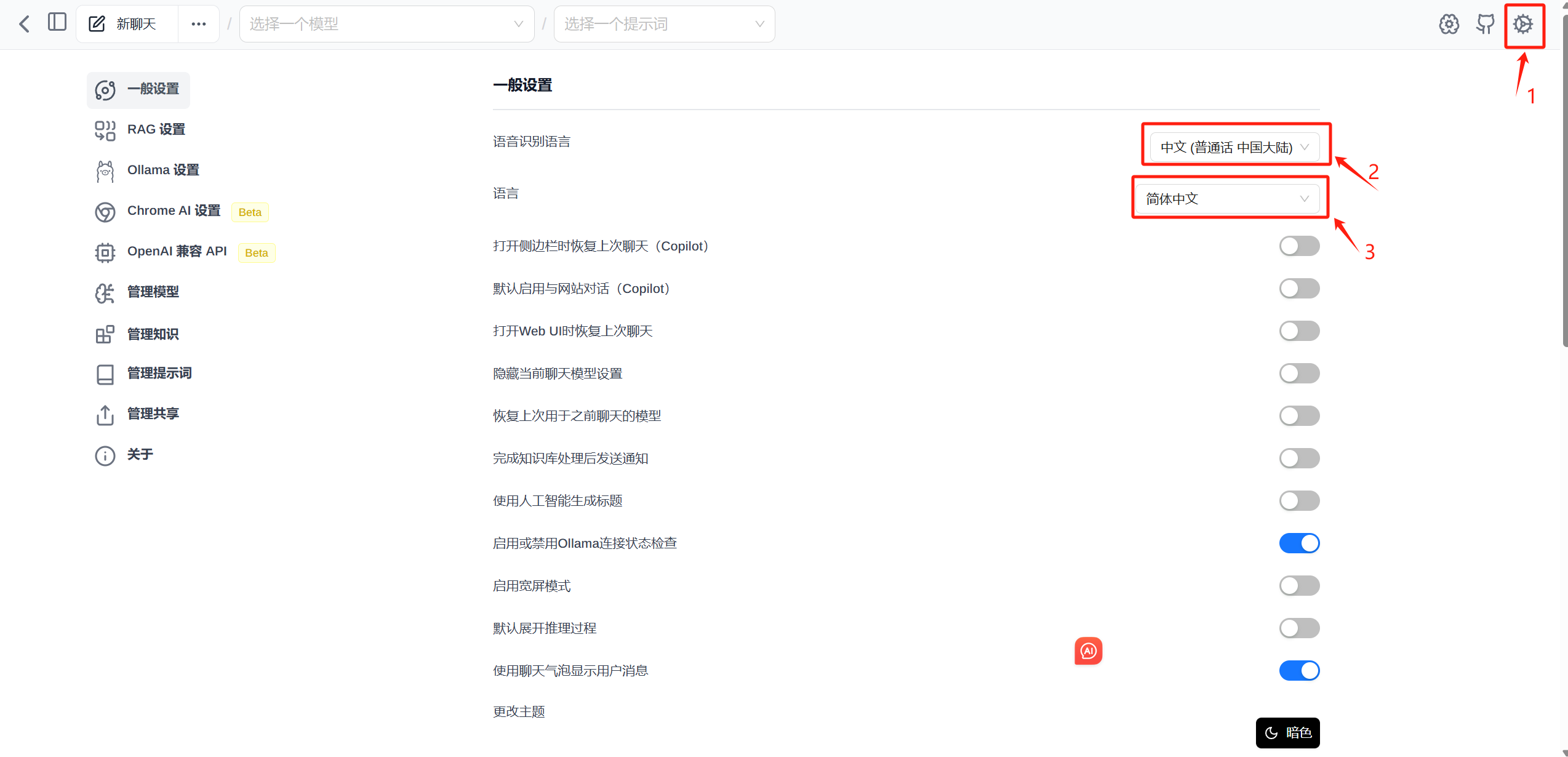

2、安装完成后按Ctrl+Shift+L ,即可进入页面,第一次进入,先进行设置

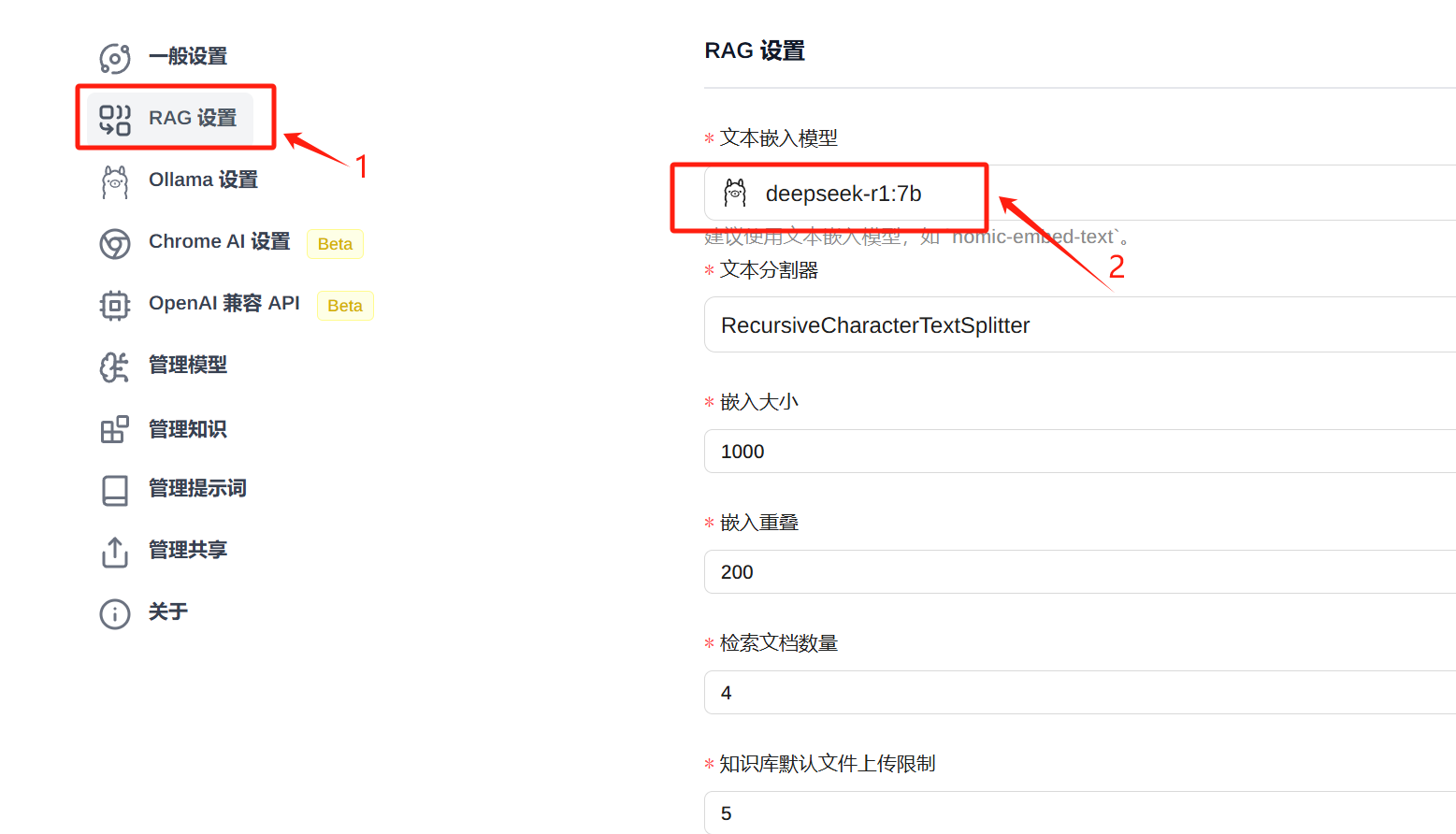

3、点击RAG设置,选择文本嵌入模型即可,最后点击保存

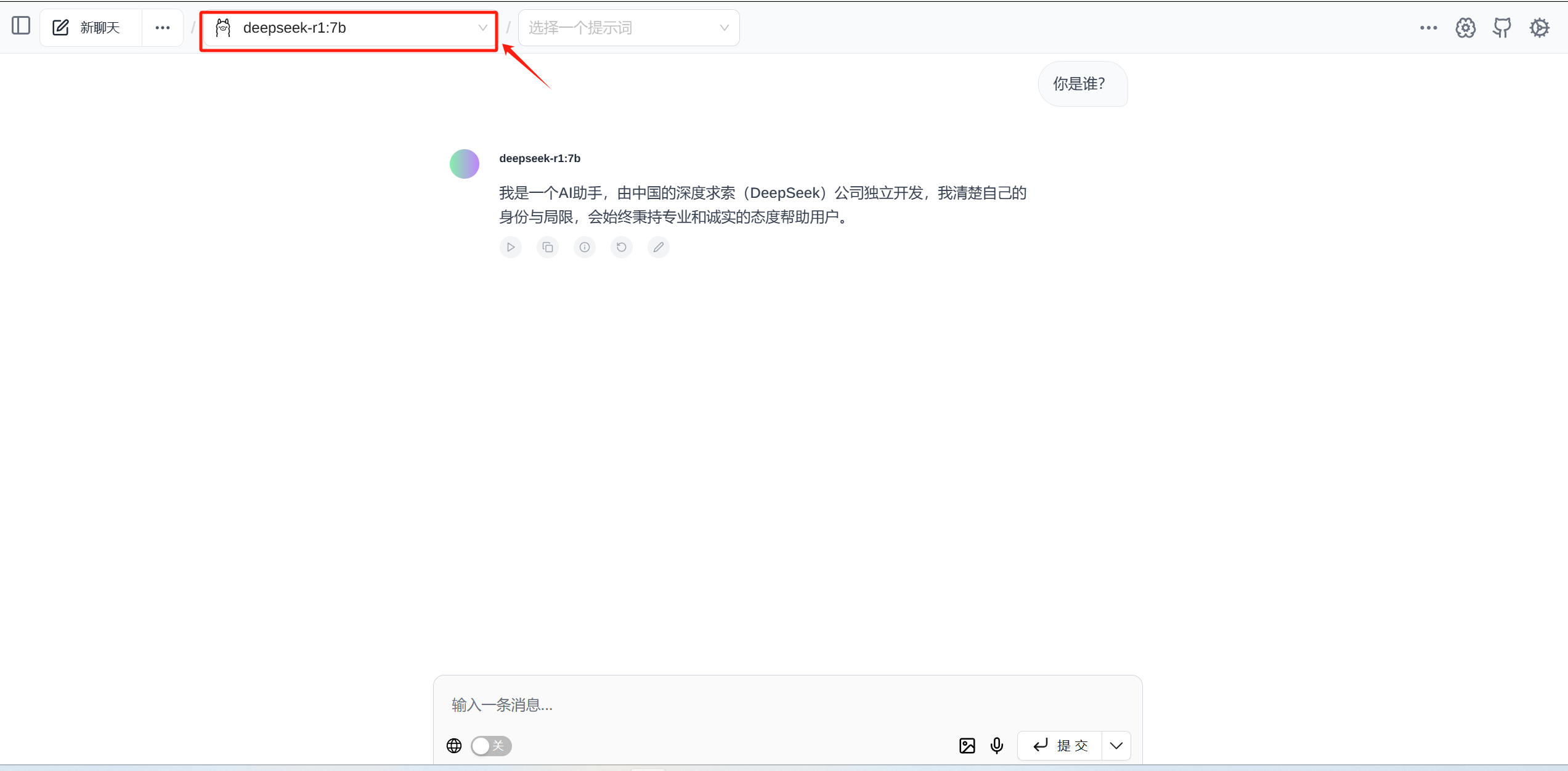

4、最后返回聊天页面,选择我们的模型,之后进行对话

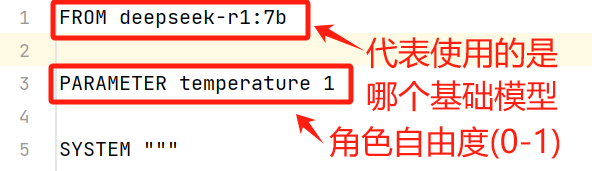

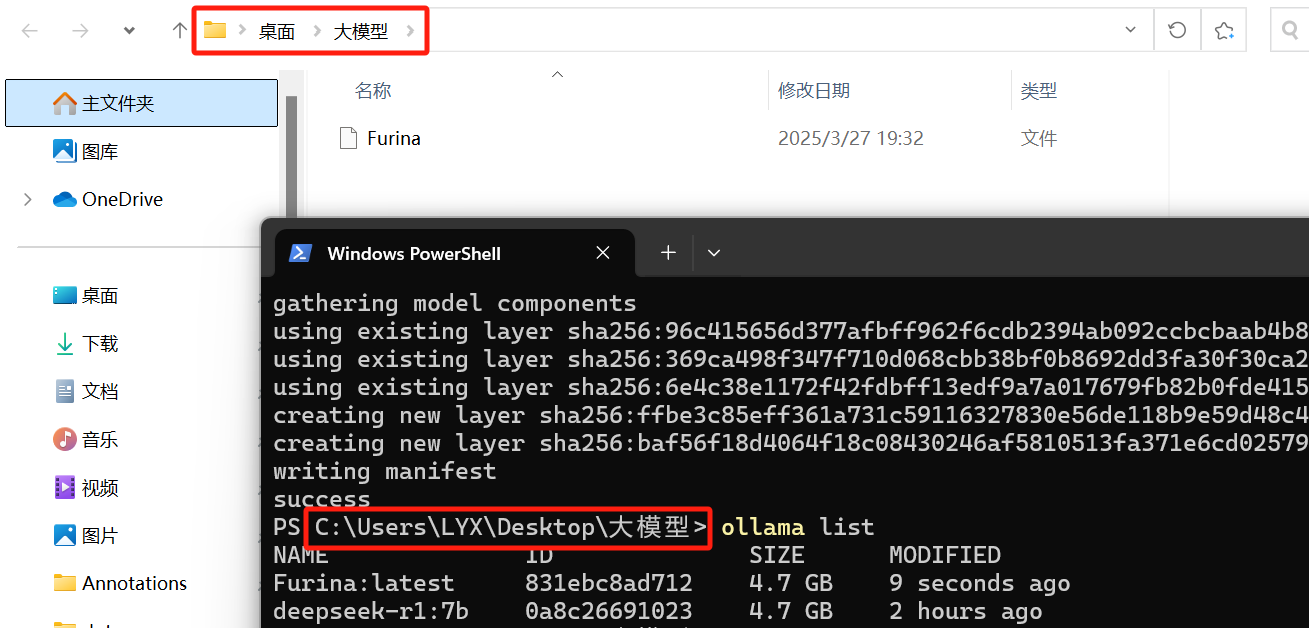

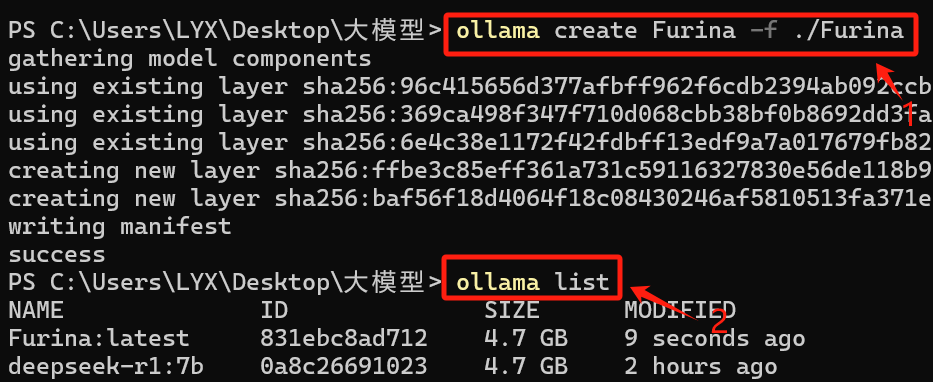

三、定制角色

在文件对应目录下,在命令行里输入如下图所示命令即可配置成功。

四、构建知识库

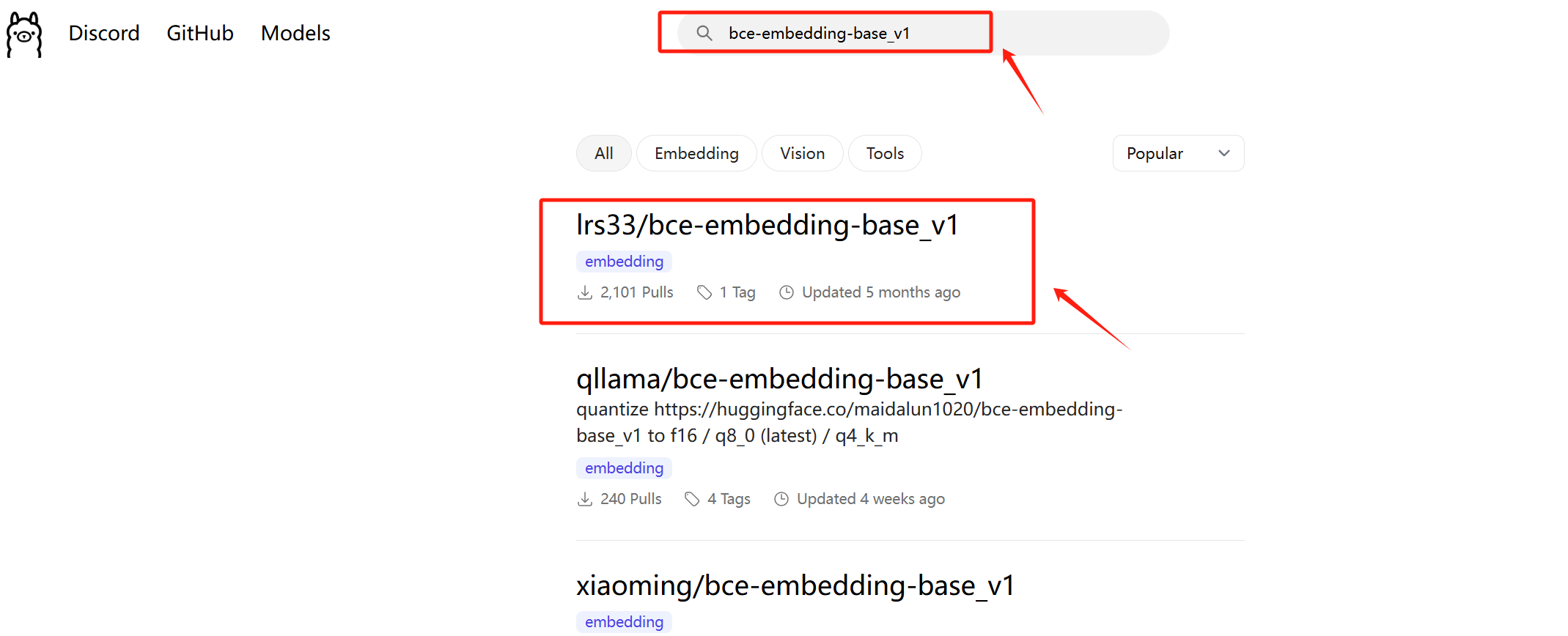

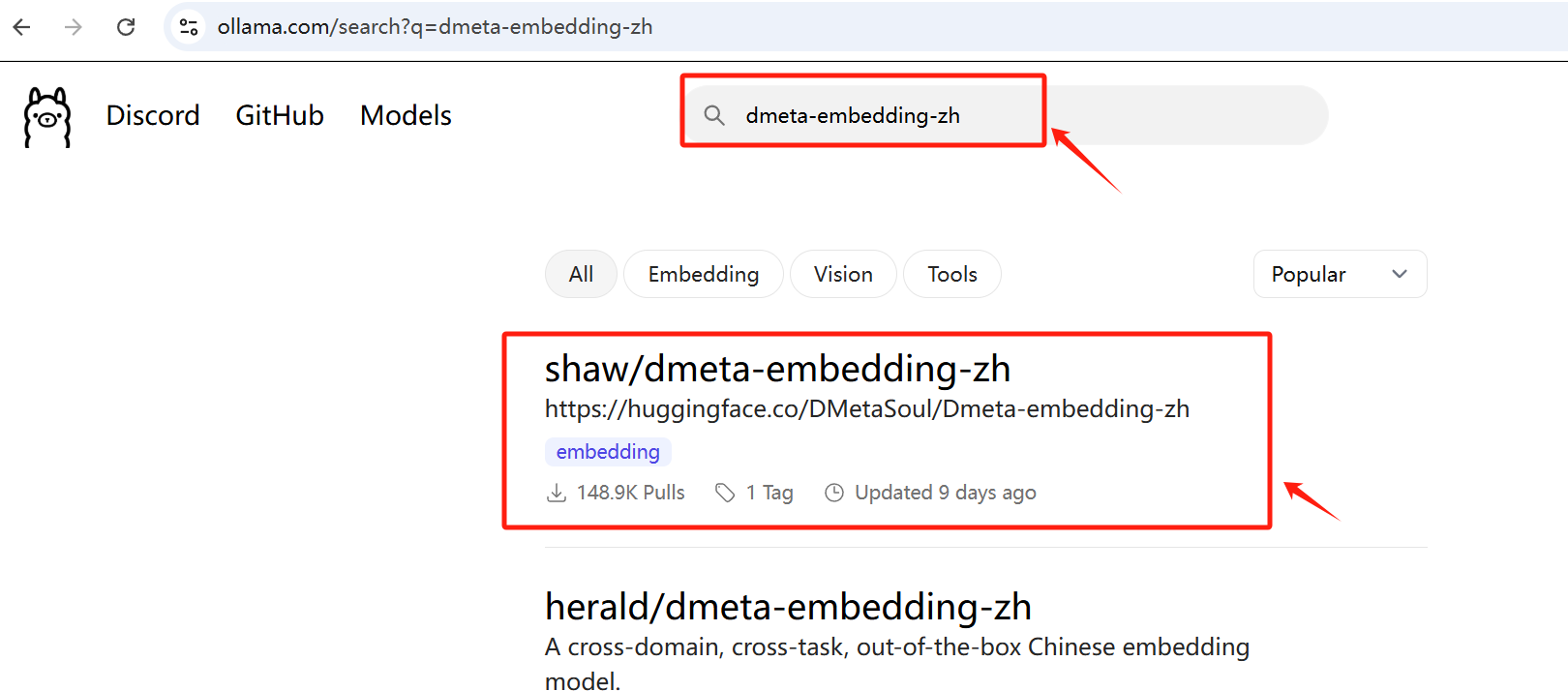

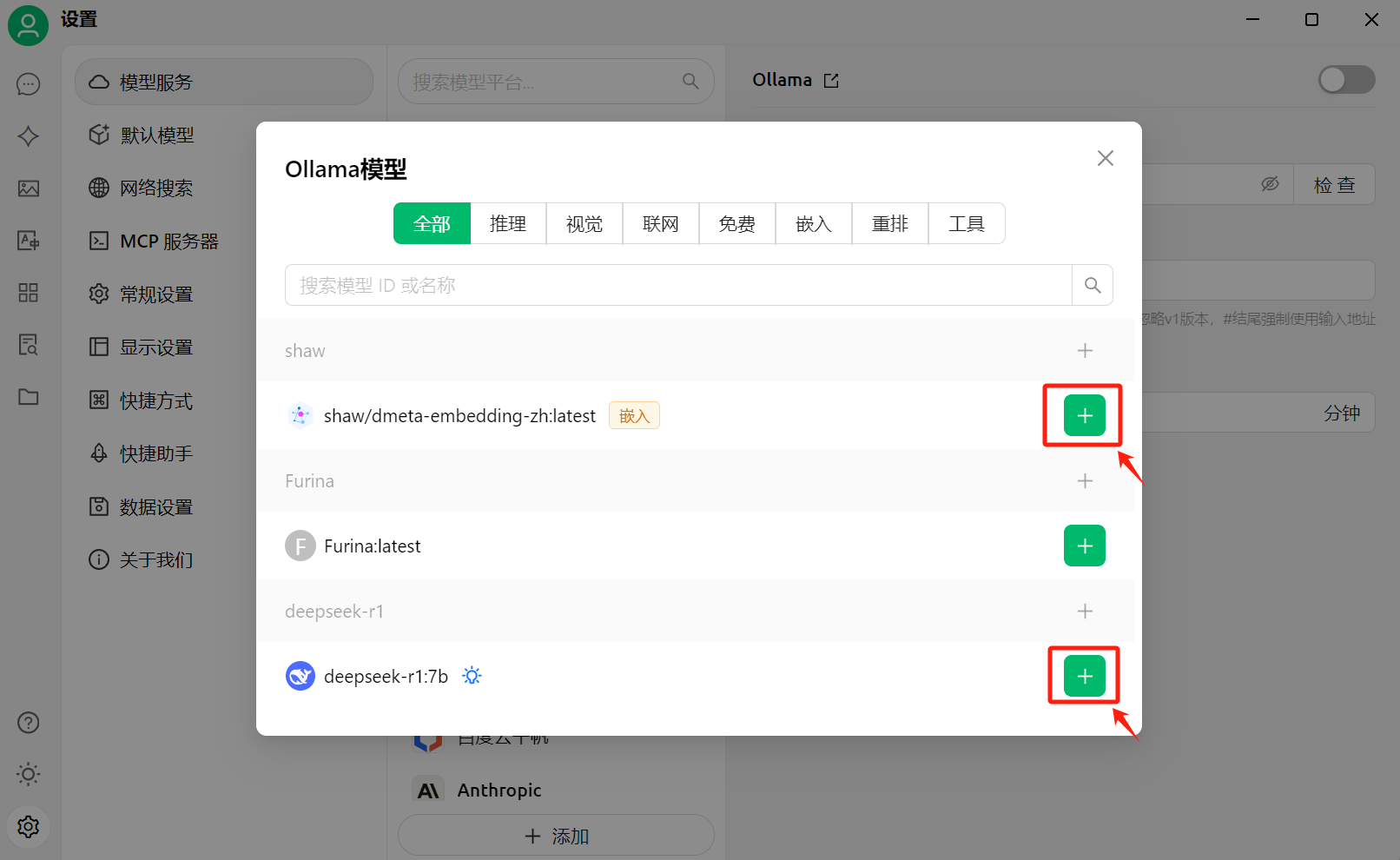

1、安装词嵌入模型

点击进去后复制命令到命令行即可

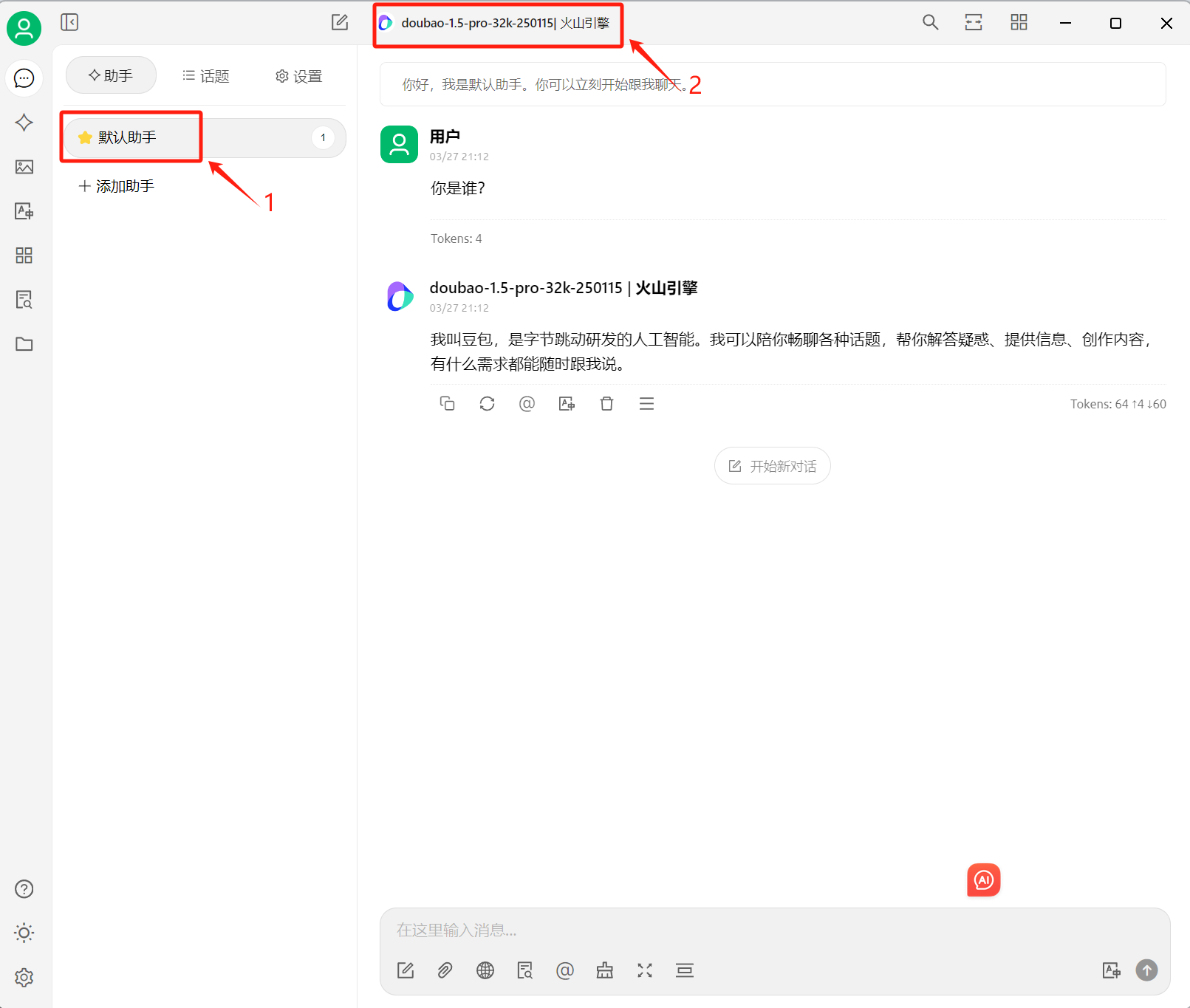

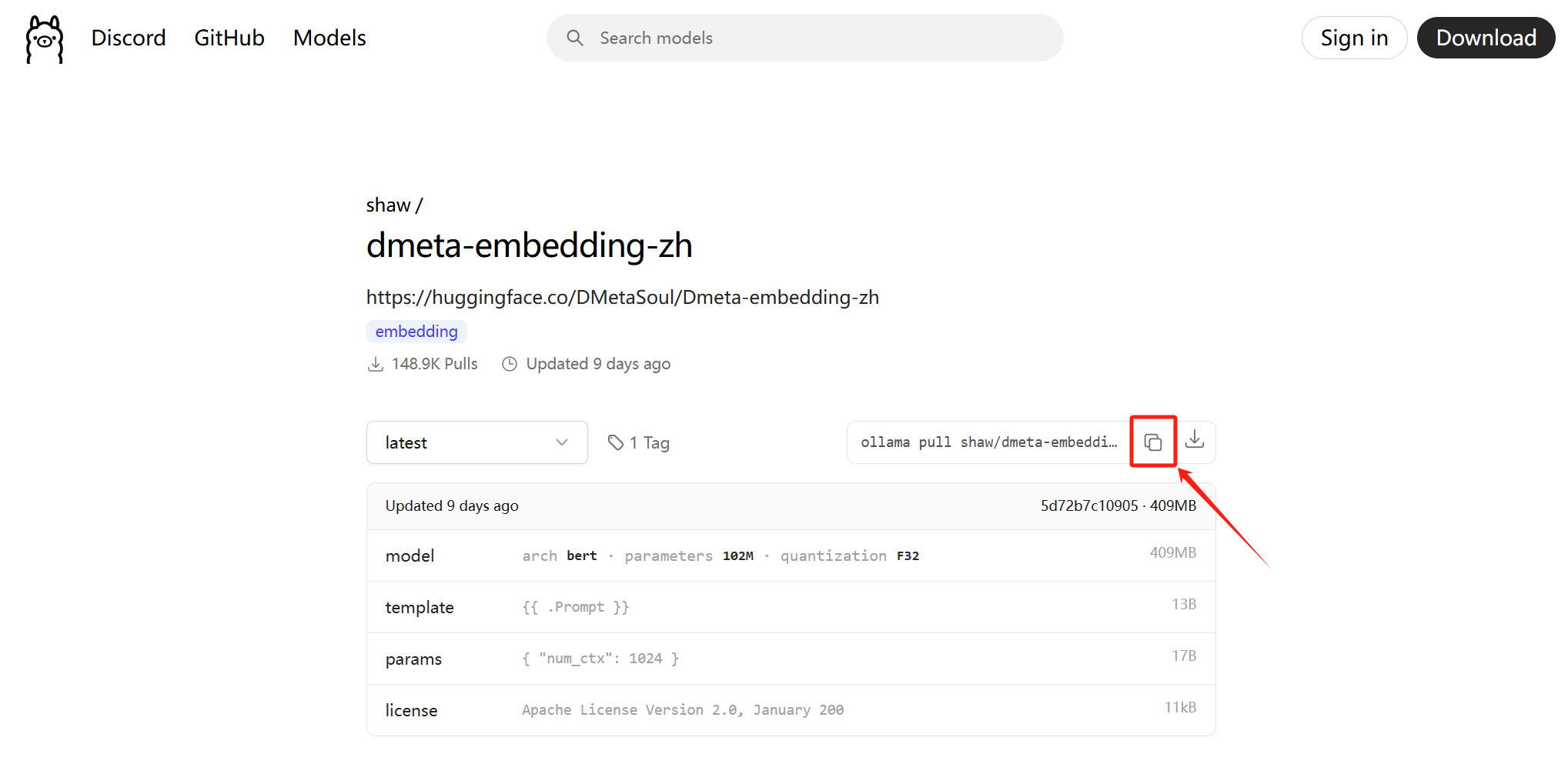

2、安装Cherry Studio

打开官方网址

下载好后直接安装即可

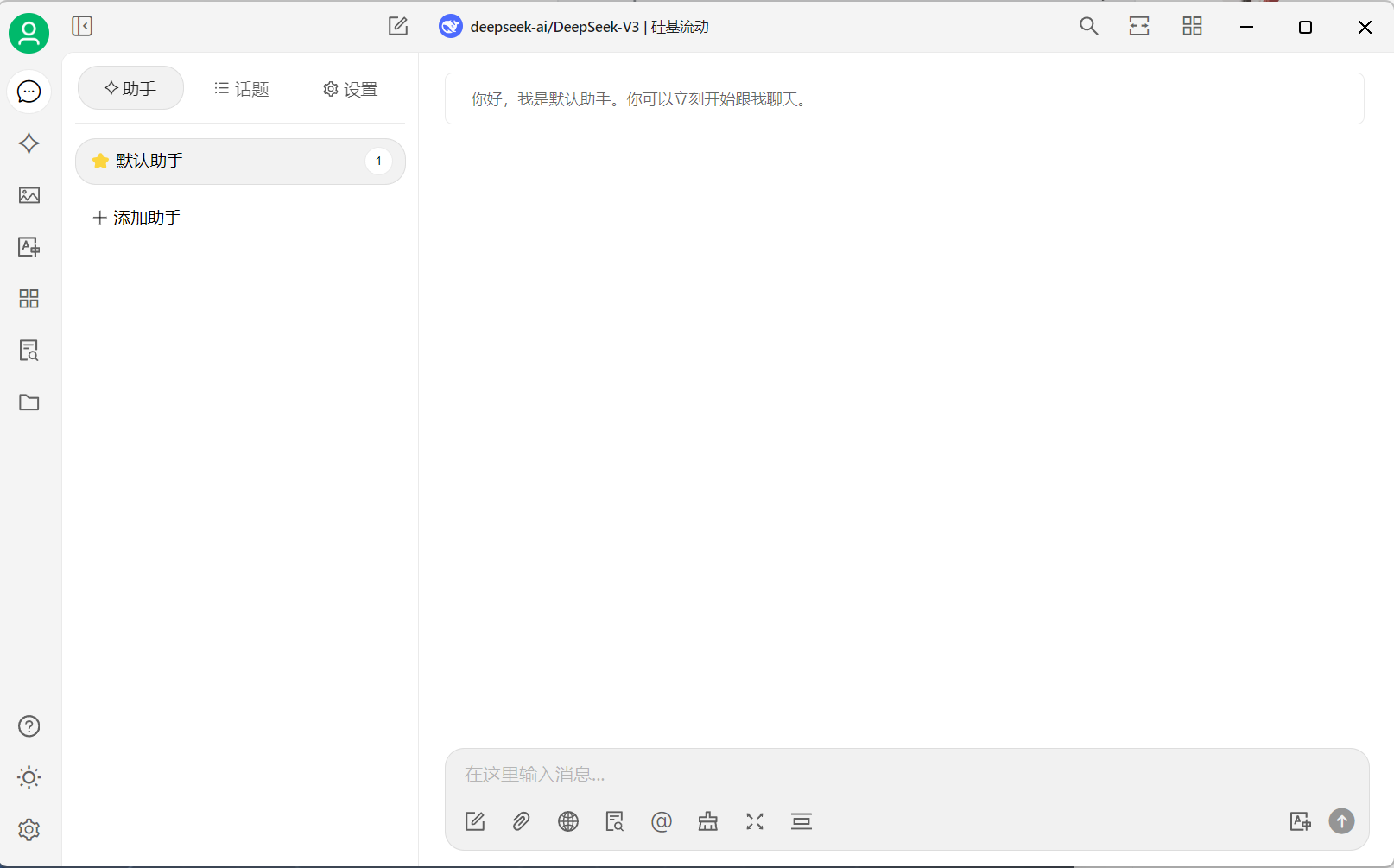

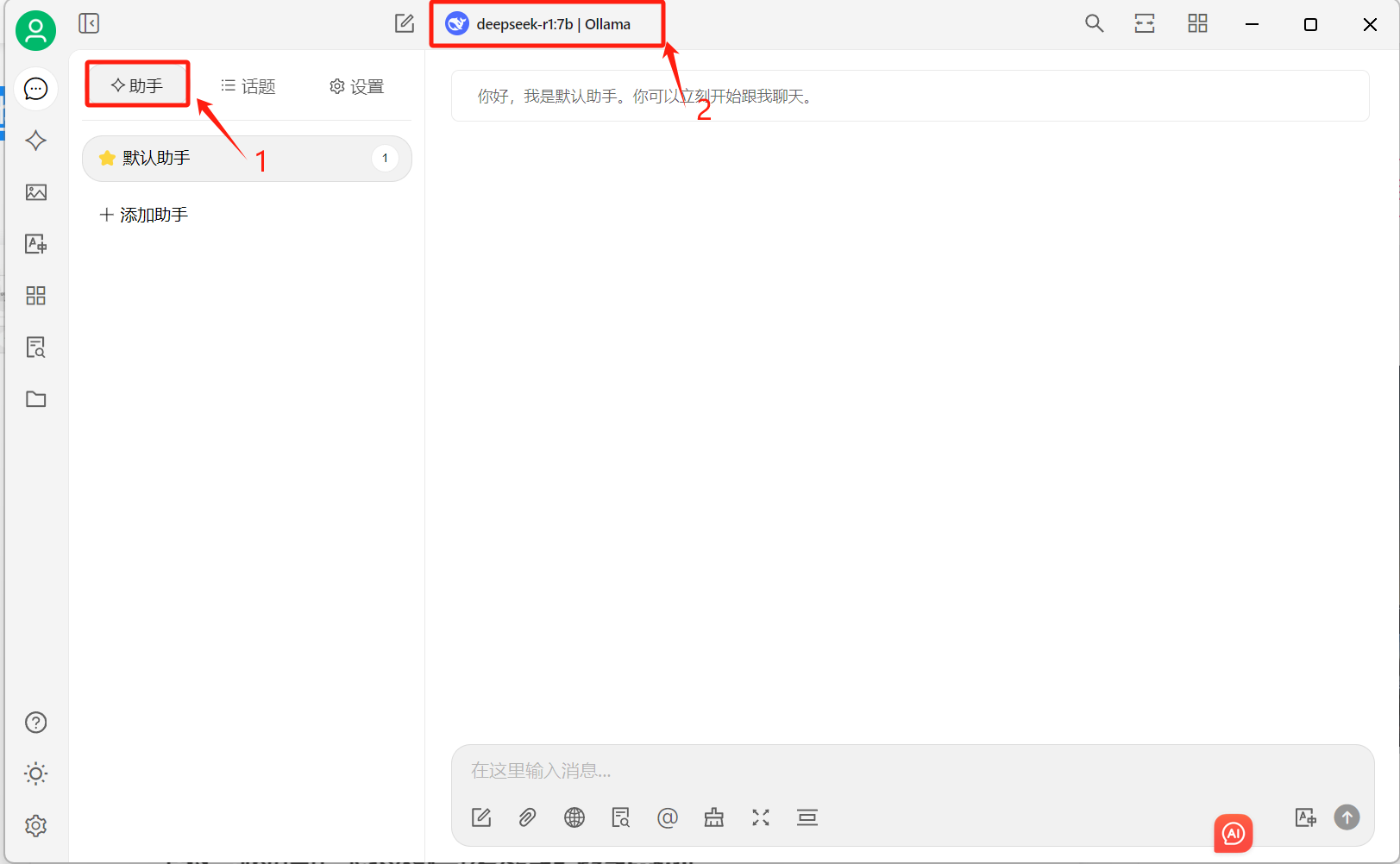

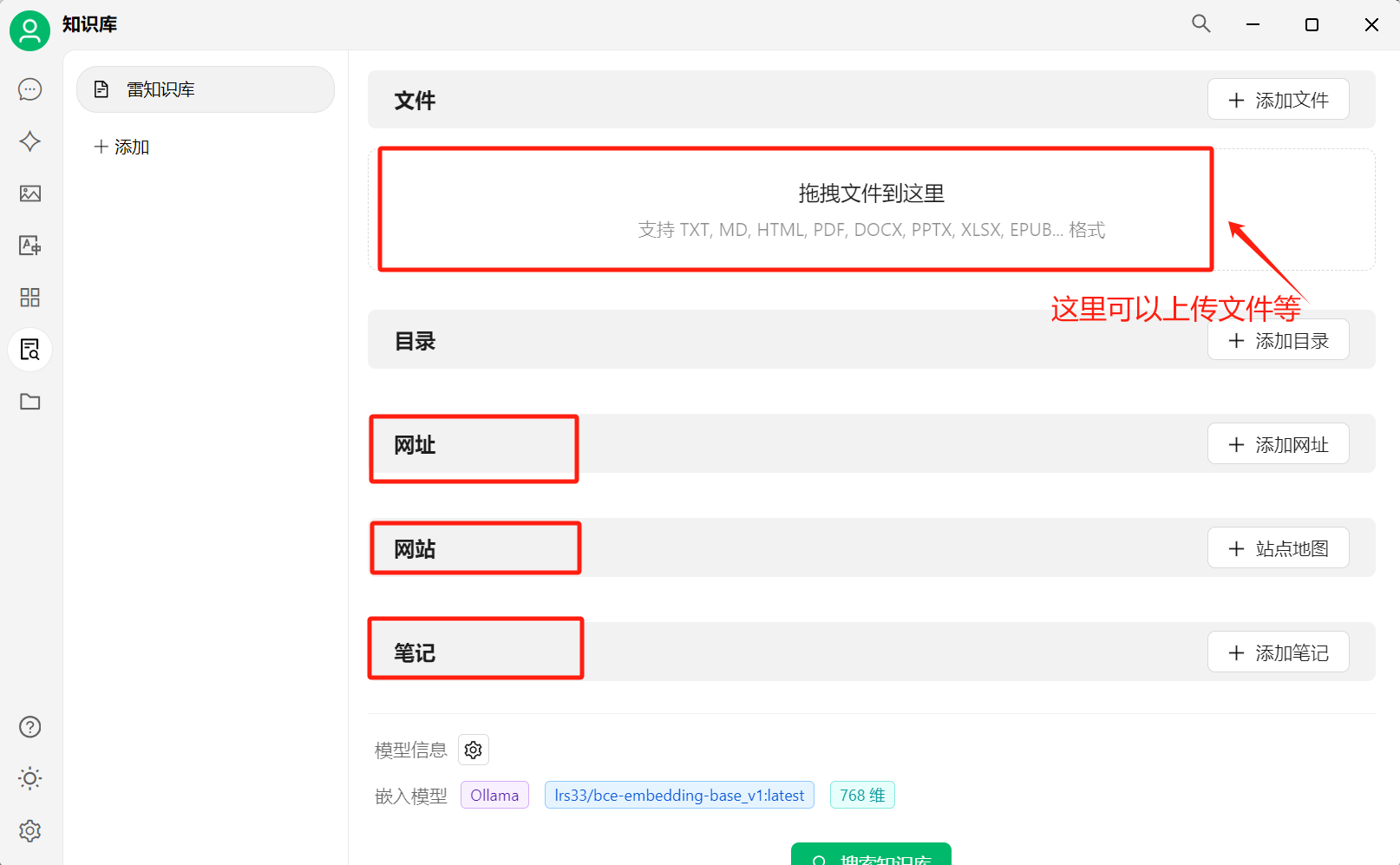

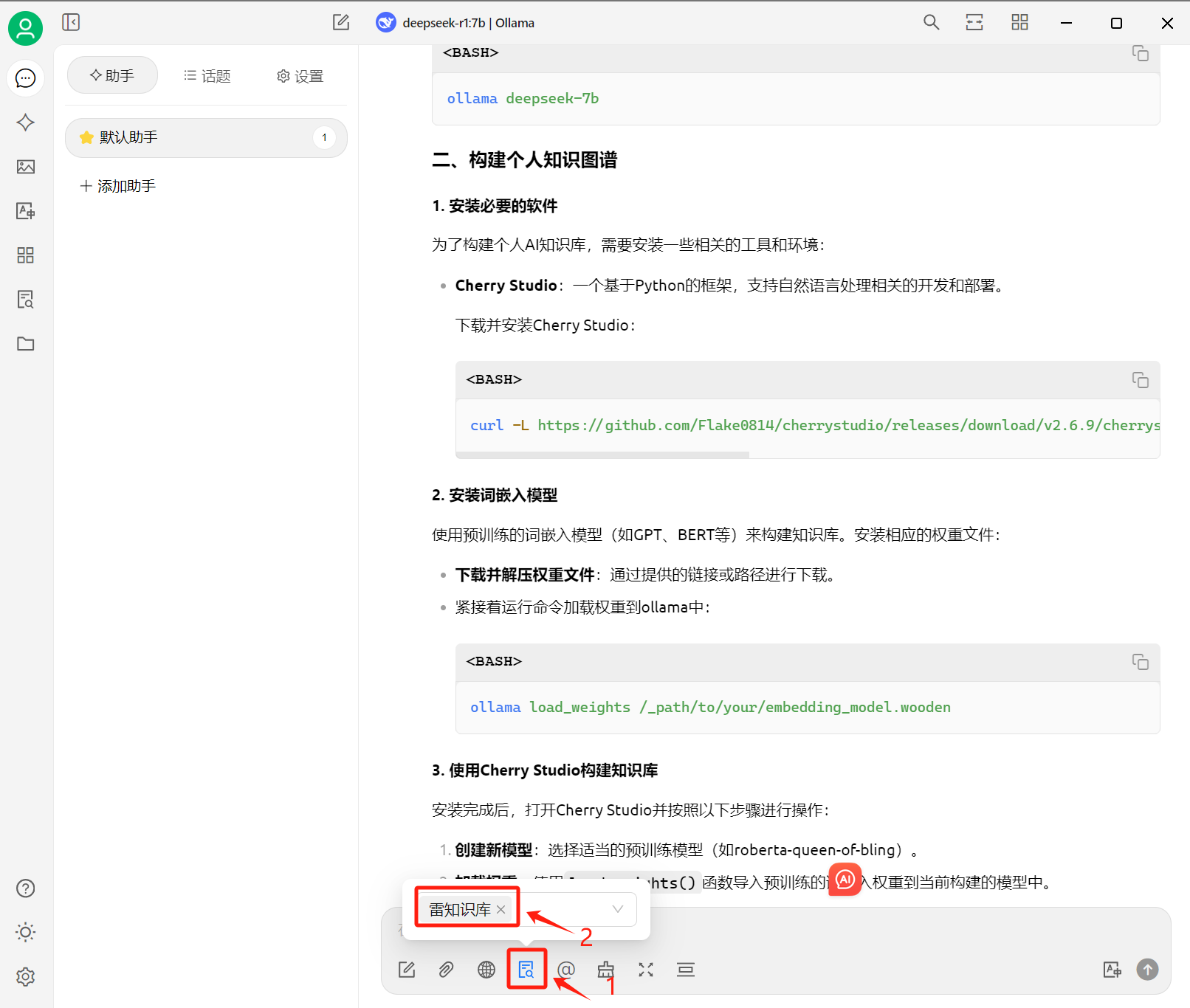

3、建立自己的知识库

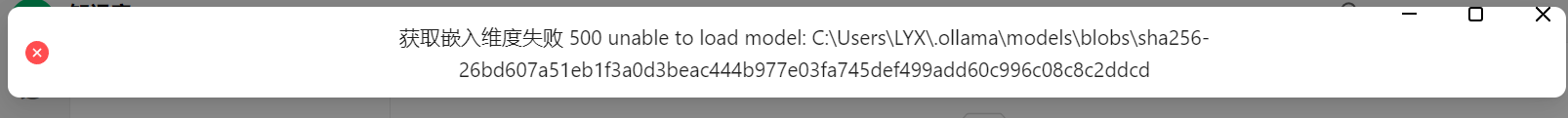

ps:如果碰到了如下问题,换个嵌入模型即可

点击确定后就完成了自己知识库的构建,可以往里面添加自己的内容,比如文档,pdf等

五、在线模型

由于本地模型参数有限,模型性能会受到限制,因此也可以选择接入在线的模型

1、如何接入千问模型

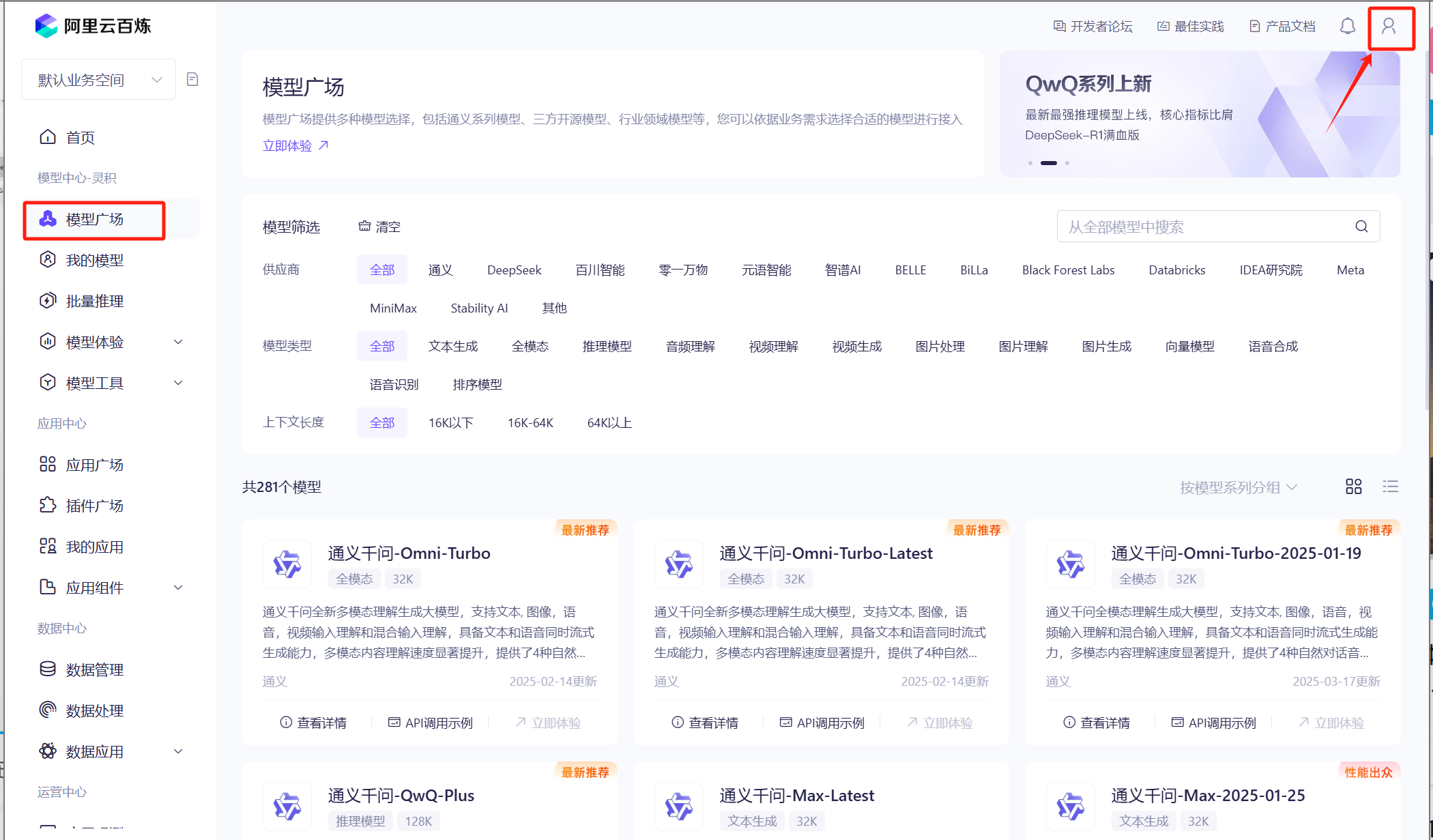

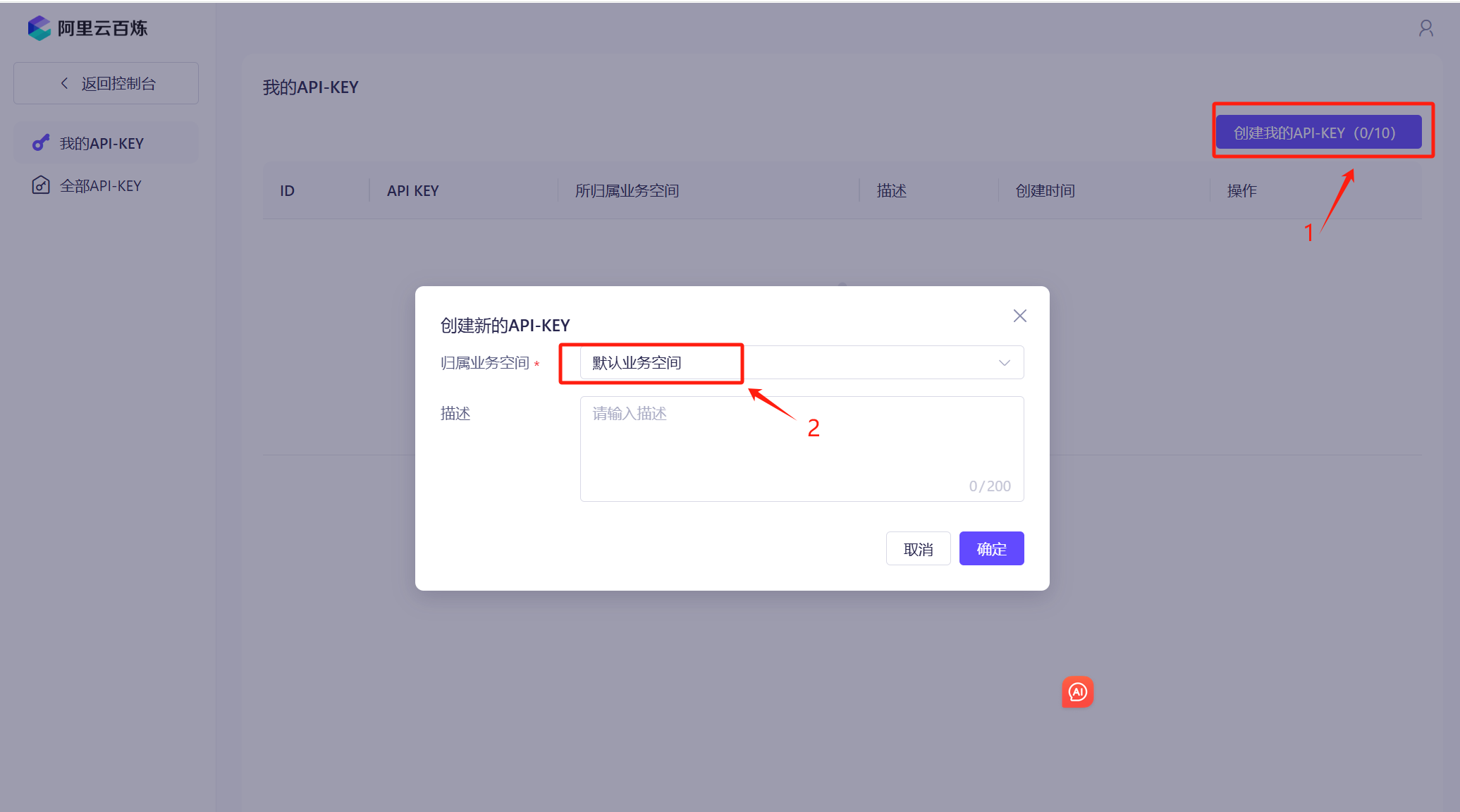

进入阿里云百炼申请个人API Key

创建完成后点击查看复制自己的API-key即可

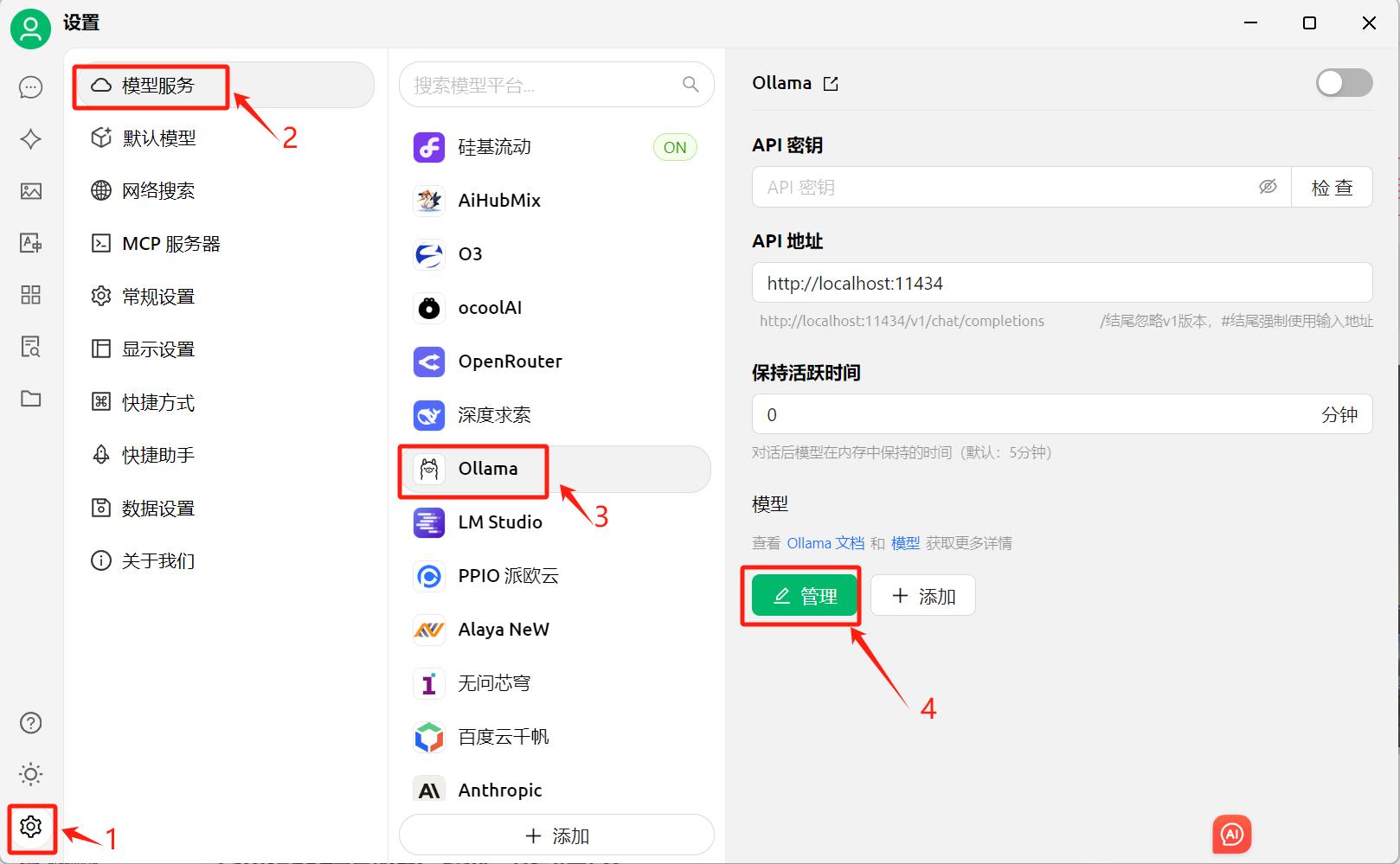

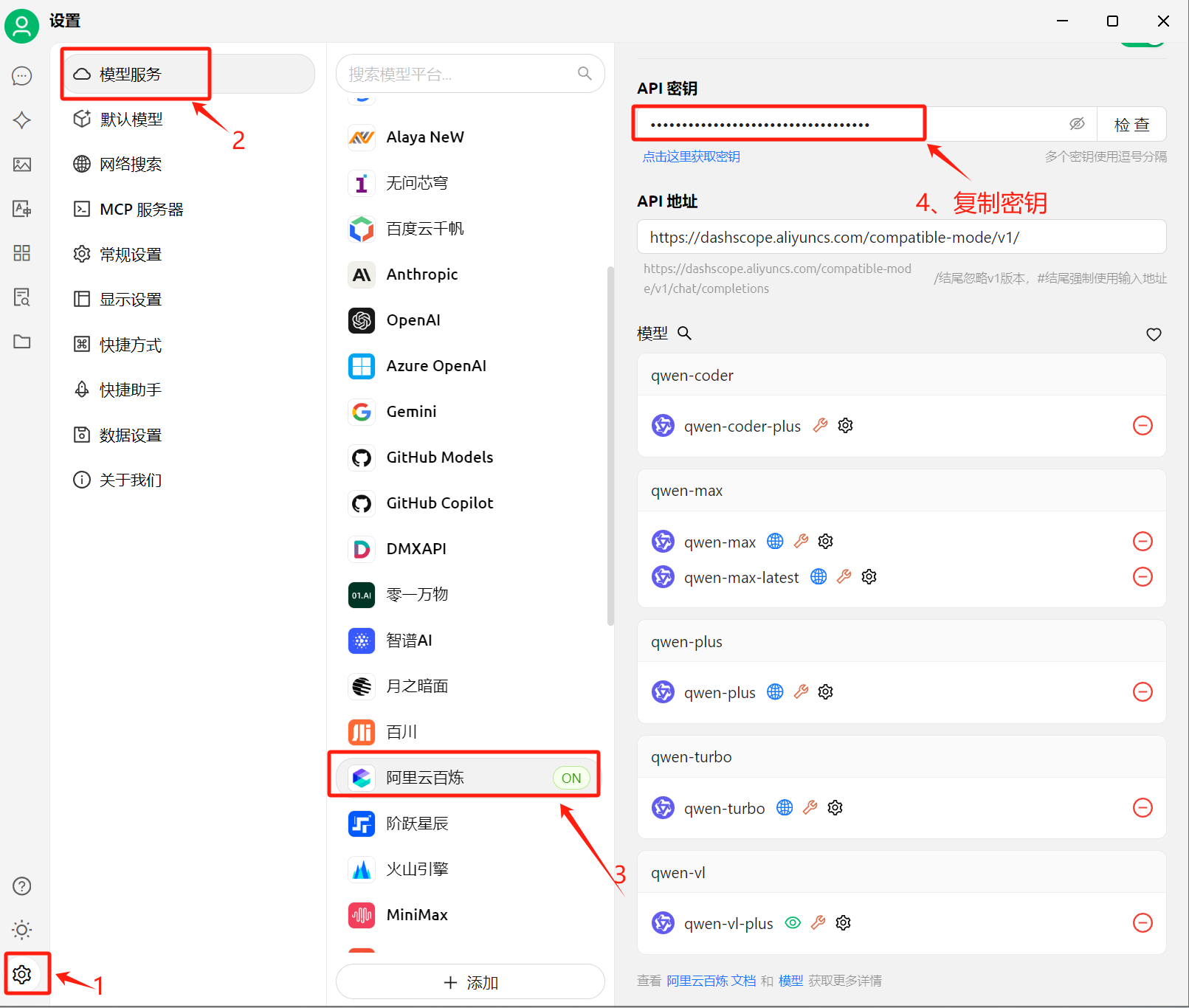

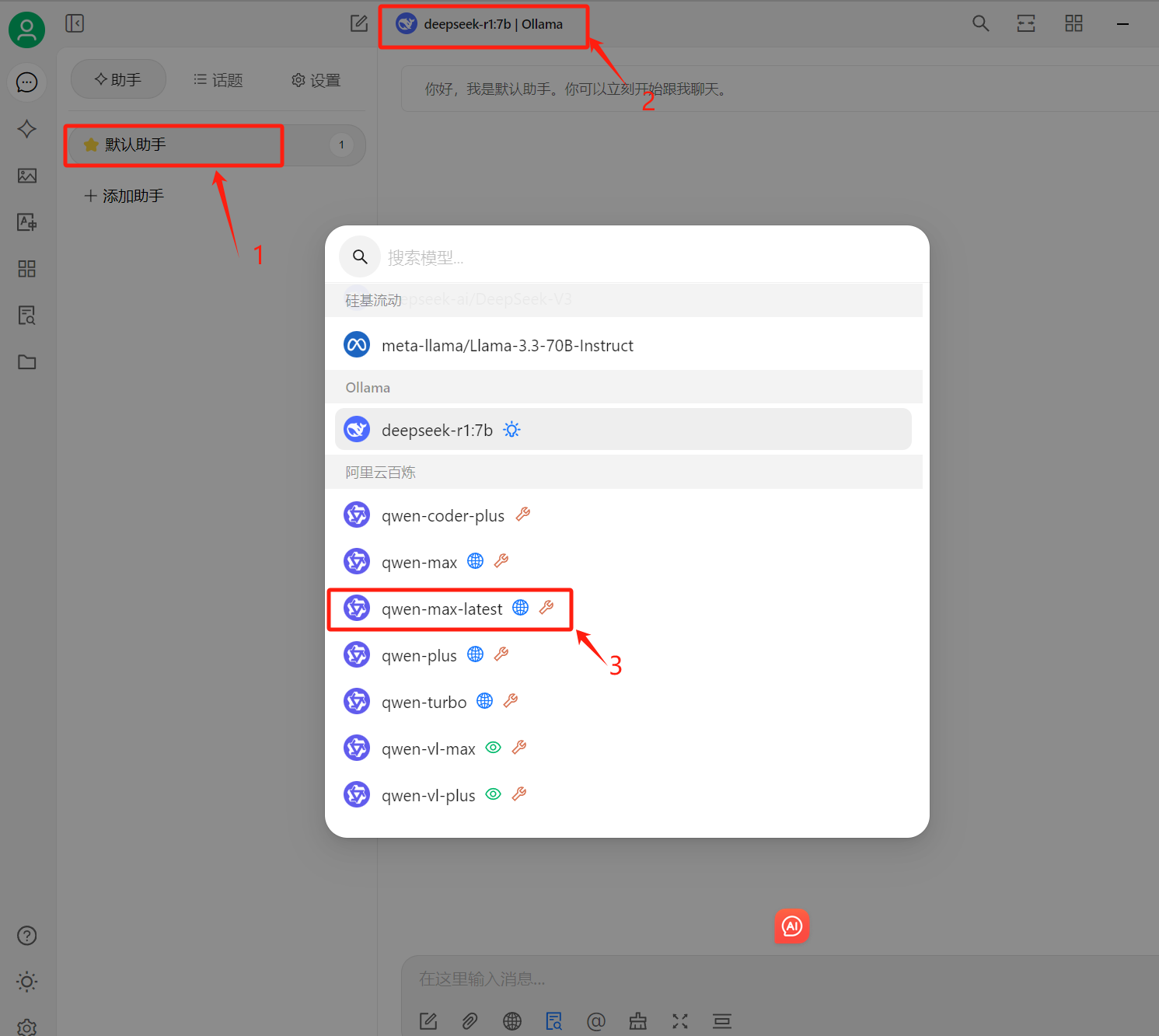

复制API-key之后,进入cherry stdio,按照步骤复制密钥即可

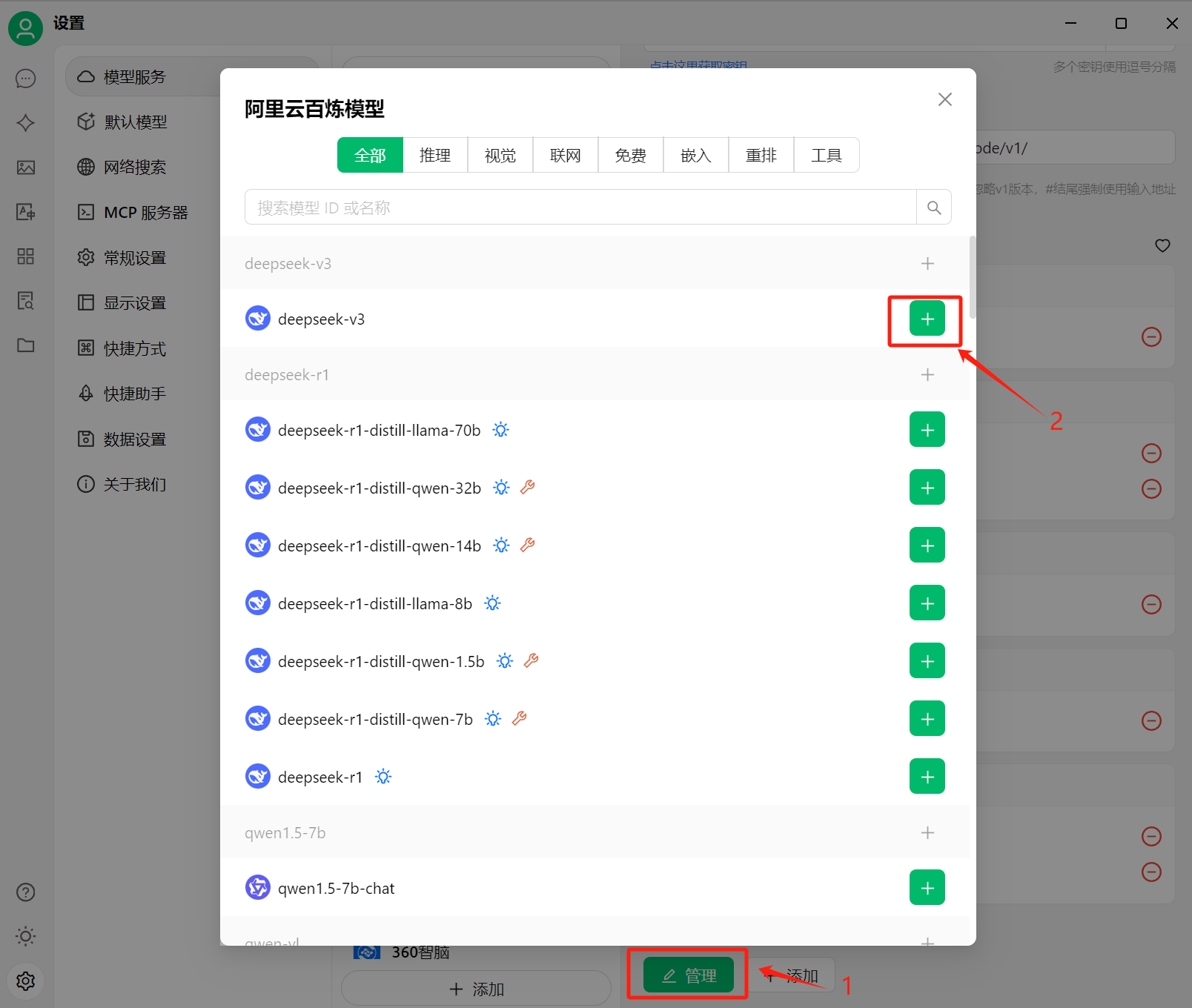

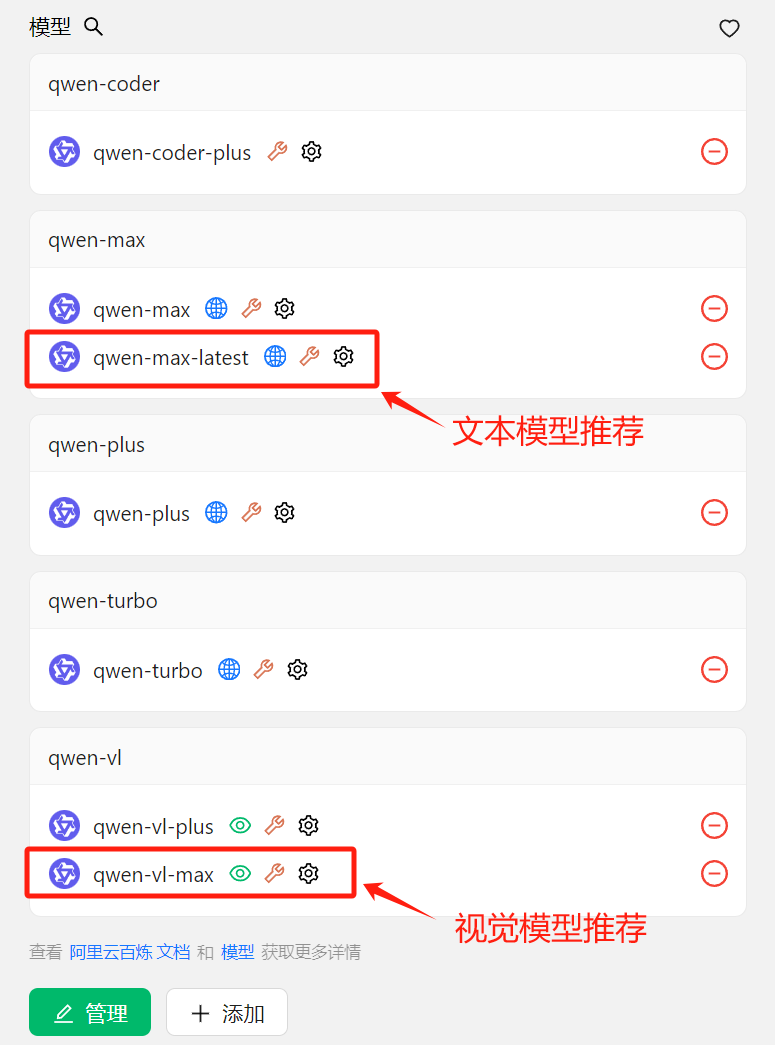

点击管理,选择需要的模型添加

推荐的文本模型和视觉模型如下

可以选择我们刚才的千问在线模型,同样也可以添加自己的知识库

2、如何添加豆包模型

ps:记得在过程中关闭vpn哦

具体步骤网址:导入豆包模型