第N7周:调用Gensim库训练Word2Vec模型

>- **🍨 本文为[🔗365天深度学习训练营]中的学习记录博客**

>- **🍖 原作者:[K同学啊]**

本人往期文章可查阅: 深度学习总结

本周任务:

- 1. 了解并学习NLP基础知识中的Word2vec的相关内容

- 2. 创建一个 .txt 文件存放自定义词汇,防止其被切分

一、准备工作

1. 安装Gensim库

使用pip进行安装:

pip install gensim -i https://pypi.tuna.tsinghua.edu.cn/simple2. 对原始语料分词

选择《人民的名义》的小说原文作为语料,先采用jieba进行分词。这里是直接添加的自定义词汇,没有选择创建自定义词汇文件。

-

jieba.suggest_freq(word, True):-

word是需要调整频率的词语。 -

True表示将该词语的词频调整为更高,确保在分词时能够被识别为一个完整的词。 -

这个函数的作用是告诉

jieba分词器,这些词语是常见的、不应该被拆分的。

-

import jieba

import jieba.analyse

# 利用for循环加入一些词,使得jieba分词准确率更高

for word in ['沙瑞金','田国富','高育良','侯亮平','钟小艾',

'陈岩石','欧阳菁','易学习','王大路','蔡成功',

'孙连成','季昌明','丁义珍','郑西坡','赵东来',

'高小琴','赵瑞龙','林华华','陆亦可','刘新建',

'赵庆祝','赵德汉']:

jieba.suggest_freq(word,True)

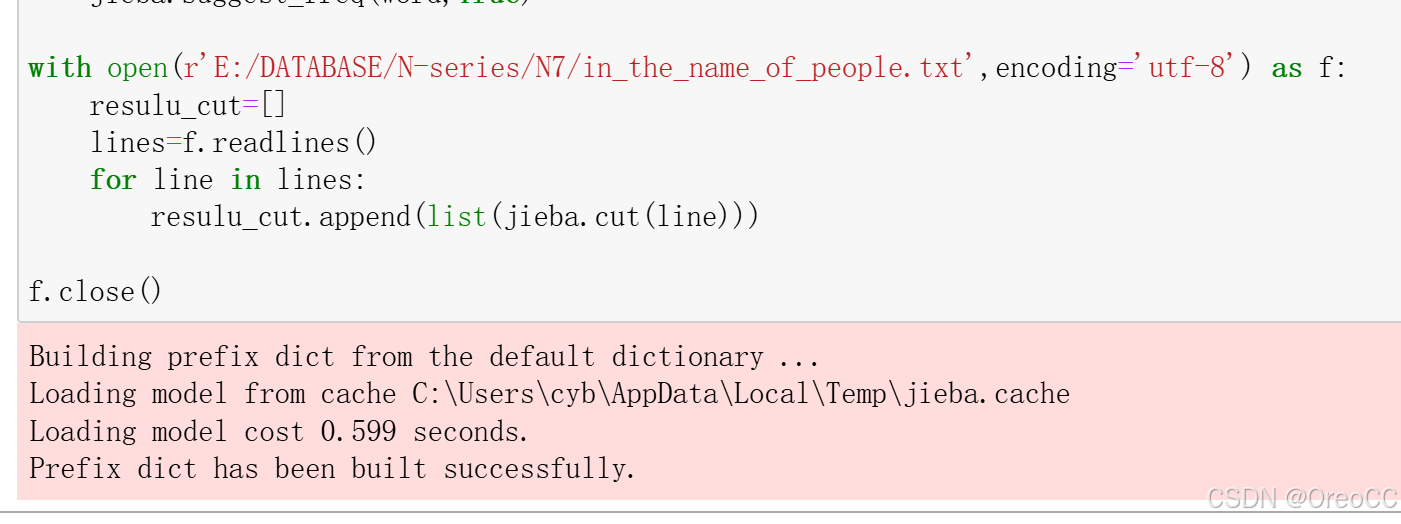

with open(r'E:/DATABASE/N-series/N7/in_the_name_of_people.txt') as f:

resulu_cut=[]

lines=f.readlines()

for line in lines:

resulu_cut.append(list(jieba.cut(line)))

f.close()运行结果:

Building prefix dict from the default dictionary ...

Loading model from cache C:\Users\cyb\AppData\Local\Temp\jieba.cache

Loading model cost 0.599 seconds.

Prefix dict has been built successfully.

UnicodeDecodeError Traceback (most recent call last)

Cell In[1], line 14

12 with open(r'E:/DATABASE/N-series/N7/in_the_name_of_people.txt') as f:

13 resulu_cut=[]

---> 14 lines=f.readlines()

15 for line in lines:

16 resulu_cut.append(list(jieba.cut(line)))

UnicodeDecodeError: 'gbk' codec can't decode byte 0xbf in position 2: illegal multibyte sequence发现结果中存在错误,分析原因是由于Python默认使用了 GBK 编码,但文件内容可能并不是 GBK 编码,导致解码失败。故在 open 函数中指定 encoding='utf-8' 。如下所示:

这样就可以消除错误了。

# 添加自定义停用词

stopwords_list=[",","。","\n","\u3000"," ",":","!","?","…"]

def remove_stopwords(ls): # 去除停用词

return [word for word in ls if word not in stopwords_list]

result_stop=[remove_stopwords(x) for x in resulu_cut if remove_stopwords(x)]拿到了分词后的文件,在一般的NLP处理中,会需要去停用词。由于word2vec的算法依赖于上下文,而上下文有可能就是停用词。因此,对于word2vec,我们可以不用去停用词,仅仅去掉一些标点符号,做一个简单的数据清洗。

现在我们可以直接读分词后的文件到内存。这里使用了word2vec提供的LineSentence类来读文件,然后套用word2vec的模型。在实际应用中,可以调参提高词的embedding的效果。

print(result_stop[100:103])-

[100:103]是 Python 的切片操作,表示从索引 100 开始,到索引 103(不包括 103)的部分。

运行结果:

[['侯亮平', '也', '很', '幽默', '一把', '抓住', '了', '赵德汉', '的', '手', '哎', '赵', '处长', '我', '既', '来', '了', '还', '真', '舍不得', '和', '你', '马上', '就', '分手', '哩', '咱们', '去', '下', '一个点', '吧', '说', '罢', '从', '赵家', '桌上', '杂物', '筐', '里', '准确', '地', '拿出', '一张', '白色', '门卡', '插到', '了', '赵德汉', '的', '上衣', '口袋', '里'], ['赵德汉', '慌', '了', '忙', '把门', '卡往', '外', '掏', '这', '这', '什么', '呀', '这', '是'], ['你', '帝京', '苑', '豪宅', '的', '门', '卡', '啊', '请', '继续', '配合', '我们', '执行公务', '吧']]二、训练Word2Vec模型

关于Word2Vec内容可见:XXX

from gensim.models import Word2Vec

model=Word2Vec(result_stop, # 用于训练的语料数据

vector_size=100, # 是指特征向量的维度,默认为100

window=5, # 一个句子中当前单词和被预测单词的最大距离

min_count=1) # 可以对字典做截断,词频少于min_count次数的单词会被丢弃掉,默认值为5三、模型应用

1. 计算词汇相似度

我们可以使用 similarity() 方法计算两个词汇之间的余弦相似度。

# 计算两个词的相似度

print(model.wv.similarity('沙瑞金','季昌明'))

print(model.wv.similarity('沙瑞金','田国富'))运行结果:

0.9996133

0.9993434# 选出最相似的5个词

for e in model.wv.most_similar(positive=['沙瑞金'],topn=5):

print(e[0],e[1])运行结果:

有些 0.9997698068618774

老 0.9997424483299255

领导 0.999739944934845

像 0.9997387528419495

赵立春 0.99973267316818242. 找出不匹配的词汇

使用 doesnt_match() 方法,我们可以找到一组词汇中与其他词汇不匹配的词汇。

odd_word=model.wv.doesnt_match(["苹果","香蕉","橙子","书"])

print(f"在这组词汇中不匹配的词汇:{odd_word}")运行结果:

在这组词汇中不匹配的词汇:书3. 计算词汇的词频

我们可以使用 get_vecattr() 方法获取词汇的词频。

word_frequency=model.wv.get_vecattr("沙瑞金","count")

print(f"沙瑞金:{word_frequency}")运行结果:

沙瑞金:353四、心得体会

掌握了Gensim库的内容,理解了其使用过程。