大模型AI相关记录

写在开始

1️⃣本文仅仅用作个人记录学习使用,如何涉及版权等其他问题,辛苦及时联系小编修改或者下架,全文预计1200字左右,阅读时间4min;

2️⃣内容摘要: 本文主要介绍LLM过去、现在和未来可能的发展,从而希望能更全面熟悉大模型,后续会补充大模型是什么What, 这次主要讲Why和How:

① Why:为什么会有大模型;大模型的发展;为什么在2024年爆发,有可能会在25年井喷?

② How:怎么全面认识大模型;

前序

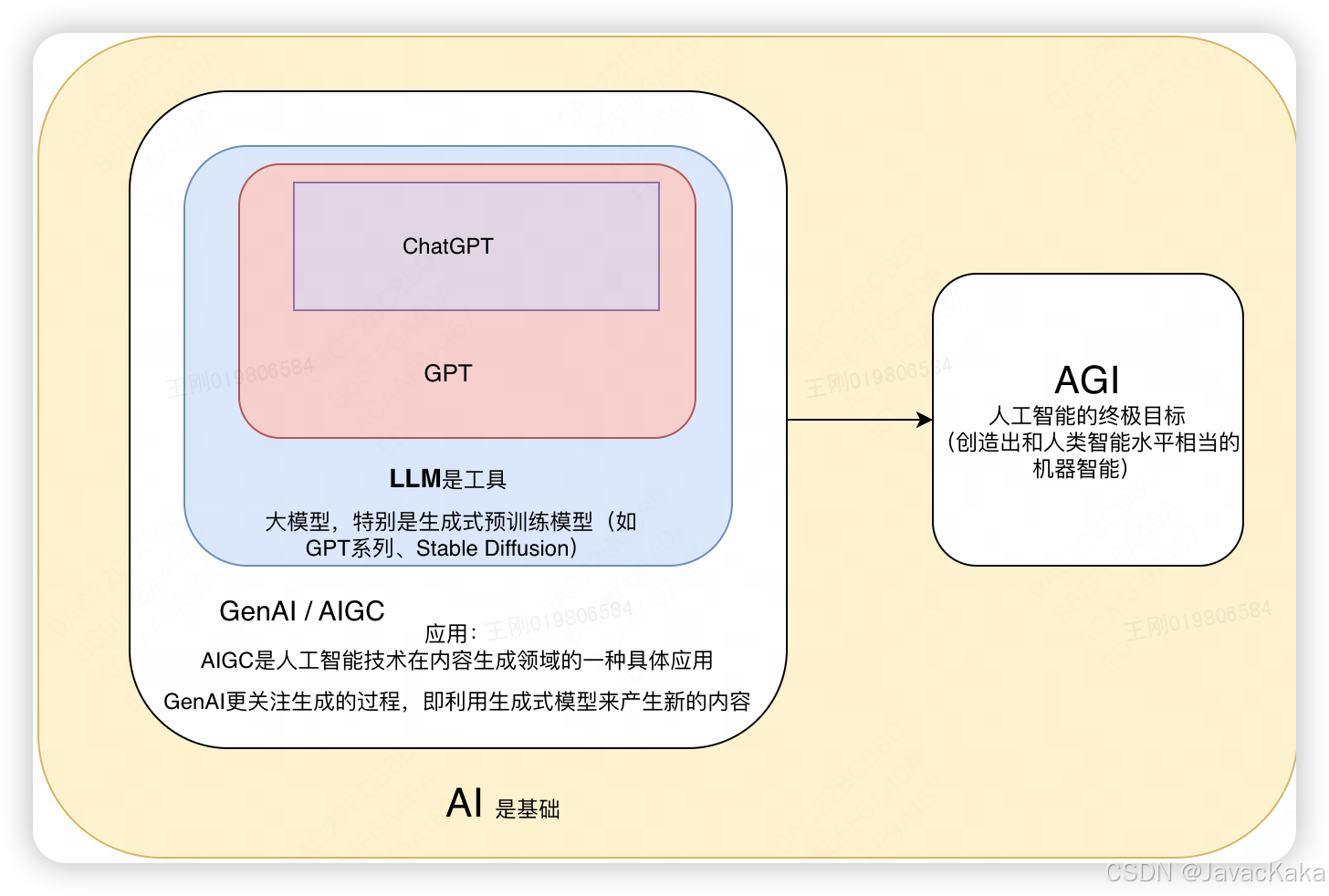

AI(Artificial Intelligence、人工智能):是一个广义的概念,指的是让机器模拟人类的智能行为,包括学习、推理、决策等

AGI(Artificial General Intelligence、通用人工智能):是AI的终极目标,即创造出与人类智能水平相当的机器智能。AGI能够理解、学习、应用各种知识,并解决各种各样的问题,就像人类一样。

AIGC(AI Generated Content、人工智能生成内容):利用人工智能技术,特别是生成式模型,来生成文本、图像、音乐、视频等各种形式的内容.

GenAI(Generative AI、生成式人工智能):生成式人工智能。它强调的是利用人工智能技术来生成新的内容,与AIGC的概念是比较一致的。

LLM(Large Language Model,大语言模型):是AI领域的一个分支,它指的是具有大量参数的深度学习模型。这些模型通常在海量数据上进行训练,以学习复杂的模式和关系。大模型的出现极大地提升了AI在自然语言处理、图像生成等领域的性能。

ChatGPT和GPT(Generative Pre-trained Transformer)都是由OpenAI开发的自然语言处理模型,都是LLM的一种实现,区别如下:

1️⃣ GPT 偏向文本生成、擅长文本生成、翻译、摘要等、比较少考虑上下文;

2️⃣ChatGPT偏向对话生成、擅长对话、问答和角色扮演等任务,注重上下文,且能进行多轮对话;

Why

第一问:为什么有大模型?

LLM只是AI的一个分支,AI算法主要分为机器学习和深度学习,而LLM是基于大量数据进行预训练的超大型深度学习模型。重点在于,基于深度学习的大模型,是可以具备理解能力的,(人不好做的算法问题,都让大模型来做):

- 特征工程的难题:深度学习通过多层神经网络自动学习数据的深层特征,极大地减轻了人工干预。

- 复杂模式的识别:

- 非线性问题的处理

第二问:大模型如何发展?

大模型发展主要经历了三个阶段,分别是萌芽期、探索沉淀期和迅猛发展期

- 萌芽期(1950 年-2005年):以CNN为代表的传统神经网络模型阶段(1956年约翰·麦卡锡提出“人工智能”概念、1980年卷积神经网络的雏形CNN诞生、1998年现代卷积神经网络的基本结构LeNet-5诞生)

- 探索沉淀期(2006年-2019年):以Transformer为代表的全新神经网络模型阶段(2013年自然语言处理模型Word2Vec诞生、2014年被誉为21世纪最强大算法模型之一的GAN(对抗式生成网络)诞生、2017年Google颠覆性地提出了基于自注意力机制的神经网络结构——Transformer架构(SVM开始逆风而行)、2018年,OpenAI和Google分别发布了GPT-1与BERT大模型)

- 迅猛发展期(2020年-至今):以GPT为代表的预训练大模型阶段

2020年,OpenAI公司推出了GPT-3;

2022年11月,搭载了GPT3.5的ChatGPT横空出世;

2023年3月,最新发布的超大规模多模态预训练大模型——GPT-4,具备了多模态理解与多类型内容生成能力

第三问:为什么24年爆发,有可能25年井喷?

政治指引:2024年政府工作报告首提“人工智能+”行动,在政策指引下,各行业加快探索“人工智能+产业发展”新模式,各种创新要素加速在人工智能领域集聚;

- 算力发展

- 函数调用出现: 举例,有这个以后询问天气,它可以调用天气API,获取实时天气数据,反馈一个准确的回答,如果没有的话,只能按以往训练数据的天气描述生成一个答案,不能实时查询;

- 大模型百花齐放

举例:字节跳动的豆包;百度文心一言、阿里的通义千问、华为的盘古大模型、科大讯飞的紫东太初、澜舟科技的DeepSeek、复旦的MOSS、Manus==

How

| 阶段 | 计划 |

|---|---|

| 第一认识大模型 | 了解大模型基本知识概念,了解历史,重点看GPT4-Turbo |

| 第二使用大模型 | 体验一下,比如chatgpt 文心一言;使用AIGC大模型工具;大模型提示工程 |

| 第三API | 强化python等编程能力,prompt应用及API、Plugins调用;思维链和尝试基于API构建小工具 |

| 第四Finetune | RAG;Finetune的技术;训练流程和调优模型 |

| 第五 | langchian SK 拆解 ; AutoGen== |

| 第六 | 入门级大模型训练技巧 |

| 第七 | 高级大模型训练技巧 |

| 第八 | 改Transformer |

写在最后 : 码字不易,如果觉得还不错,或者对您有帮助,麻烦动动小手,点赞或关注,谢谢!