用n8n实现一个长视频生成工作流

前言

前一段时间我尝试搭建了一个基于n8n的AI视频生成工作流,目标是实现从创意到成片的高度自动化流程。整个项目的初衷很简单:能否让AI接管视频创作的大部分环节,让创作者只需要提供一个主题,就能获得一支完整的视频作品?

经过半天的摸索和调试,最终实现了一个AI含量100%的视频生成系统,涵盖了从脚本创作、分镜设计、视频生成完整链路。整个工作流的自动化程度达到90%以上,仅在最后的素材拼装环节需要人工介入。旁白部分并不包含在工作流里,不是因为实现不了,只是单纯没做而已。

视频预览

首先看下最终的成品视频,可直接点击下方腾讯视频链接观看。视频产出后,效果超出了我的预期。视频链接:https://v.qq.com/x/page/m3170basjds.html

设计实现

最终成品视频AI含量100%,包含视频脚本创作、视频内容生成、旁白文案、音频、背景音乐。

创作过程自动化程度90%+,其中视频生成可达到100%自动化,旁白文案和音频素材生成其实也可以放工作流里,实现100%自动化,时间关系本次手动搞了。 最后仅需要使用剪映人工组装音视频。

工具介绍

-

n8n: 一款开源工作流搭建软件(类似coze、dify),完成自动化流程搭建。

-

旁白朗读生成: minimax家的speech-2.5-hd-preview模型

-

背景音乐:本次使用了剪映音乐生成

-

视频生成模型: doubao-seedance-1-0-pro-250528 使用API接入,即梦同款模型

-

剪映: 这个大家都知道,不做介绍。 最后使用剪映完成了所有素材的拼装

-

LLM:大部分节点都使用了deepseek,没啥别的理由,单纯性价比高。

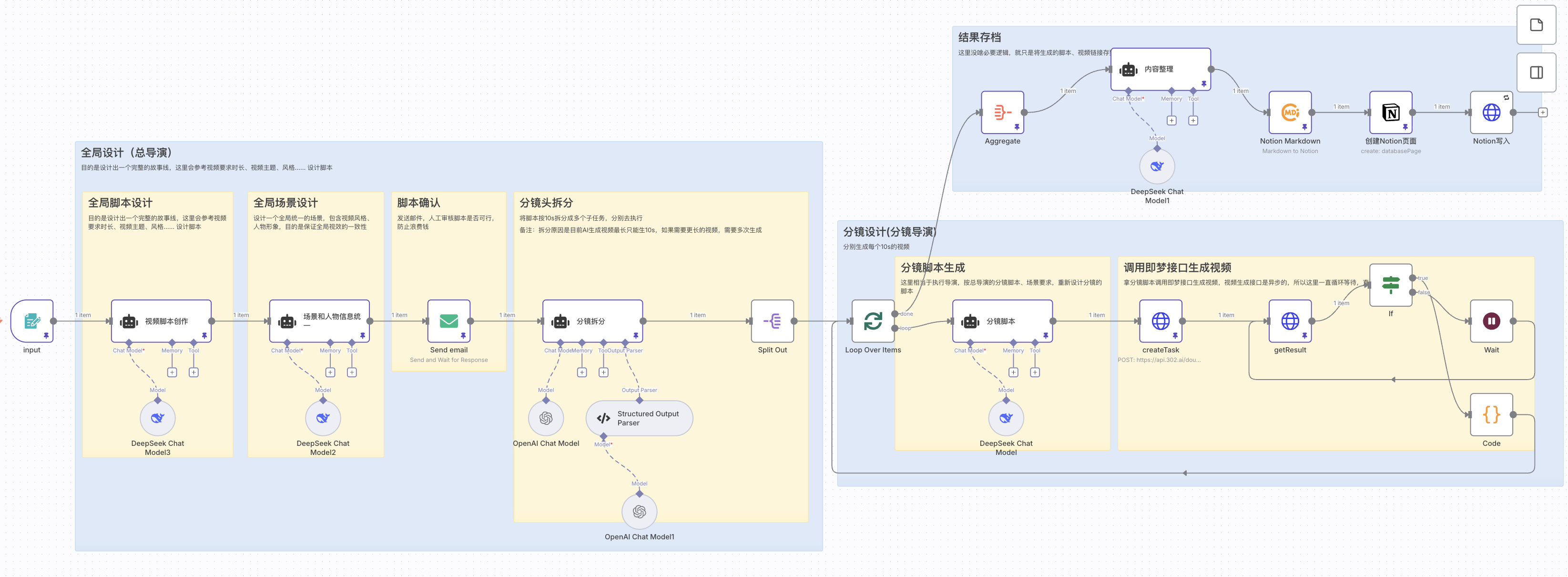

视频生成流程

完整流程:

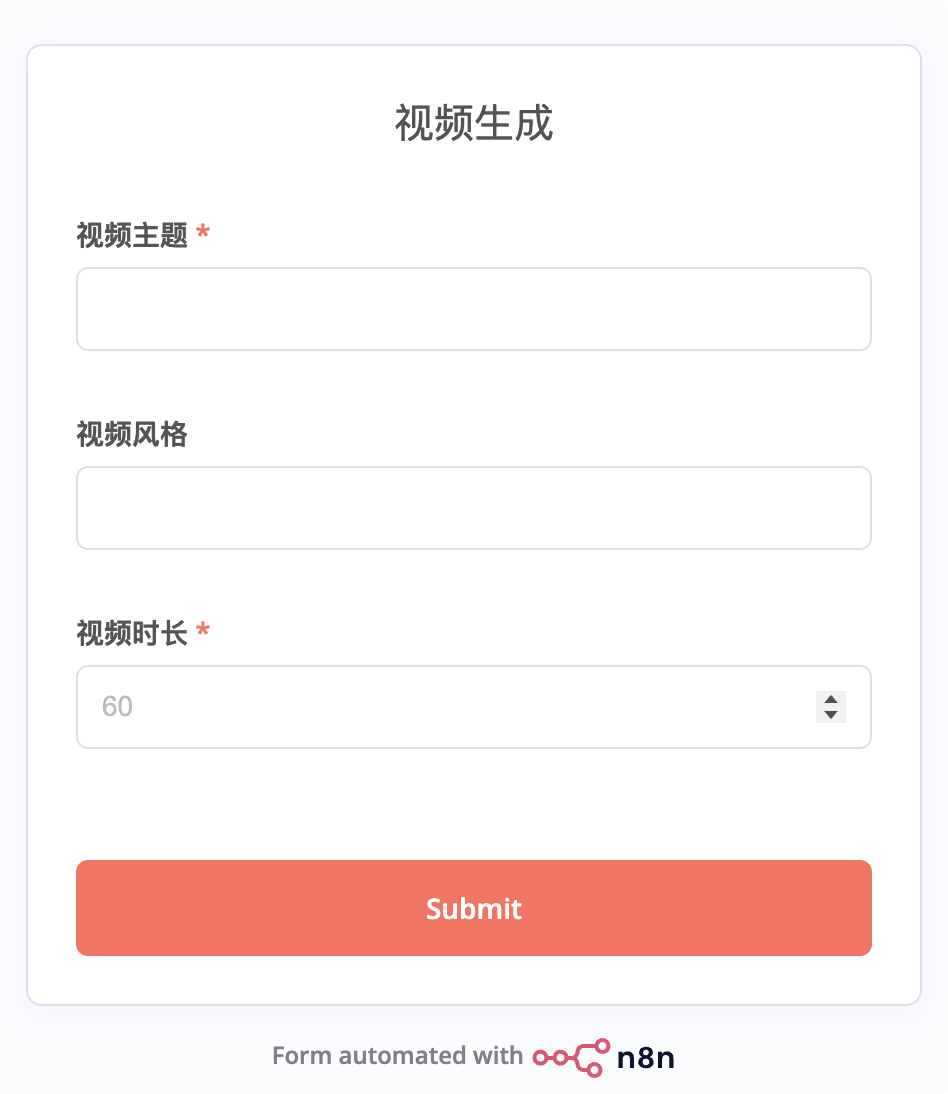

以上工作流已经完全实现自动化产出视频内容(不含音频部分),只需要输入视频主题+风格+视频时长即可。

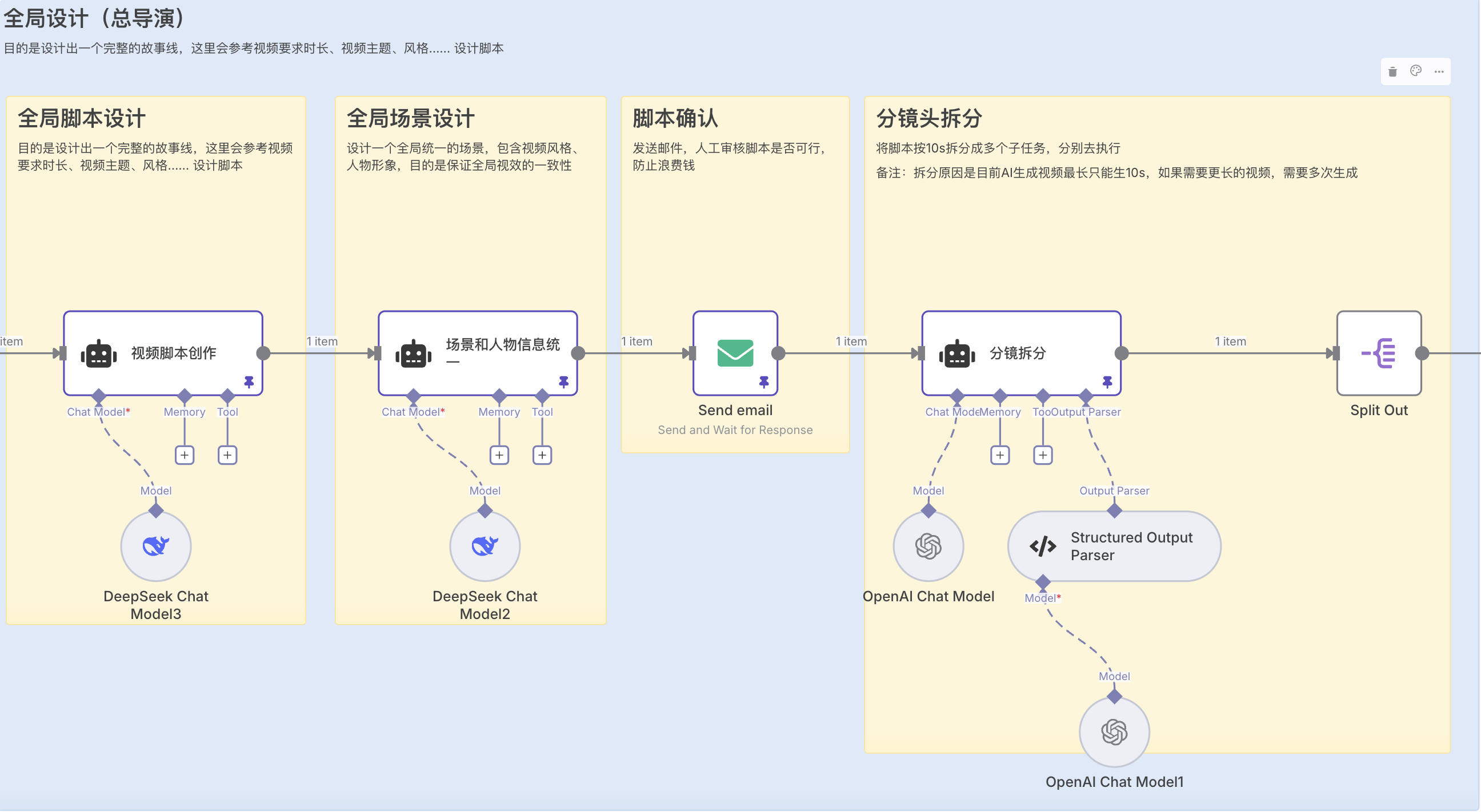

第一阶段:全局设计(总导演)

这个阶段负责影片的顶层设计和整体规划,如同一个项目的总导演。

-

初始构思与脚本创作:工作流从一个核心创意(文本输入)开始。AI首先会像编剧一样,创作出完整的视频故事脚本,并设计统一的场景风格和人物形象,确保整个视频在视觉和叙事上的一致性。

-

人工审核确认:在正式生成视频前,系统会通过邮件发送脚本以供人工审核。这个关键的“制片人”环节确保了创意方向的正确性,有效避免了后续资源的浪费。

-

智能分镜拆分:脚本一经批准,AI会将整个故事线智能地拆分成多个适合生成(如10秒)的短镜头片段,为下一步的逐个生成做好准备。

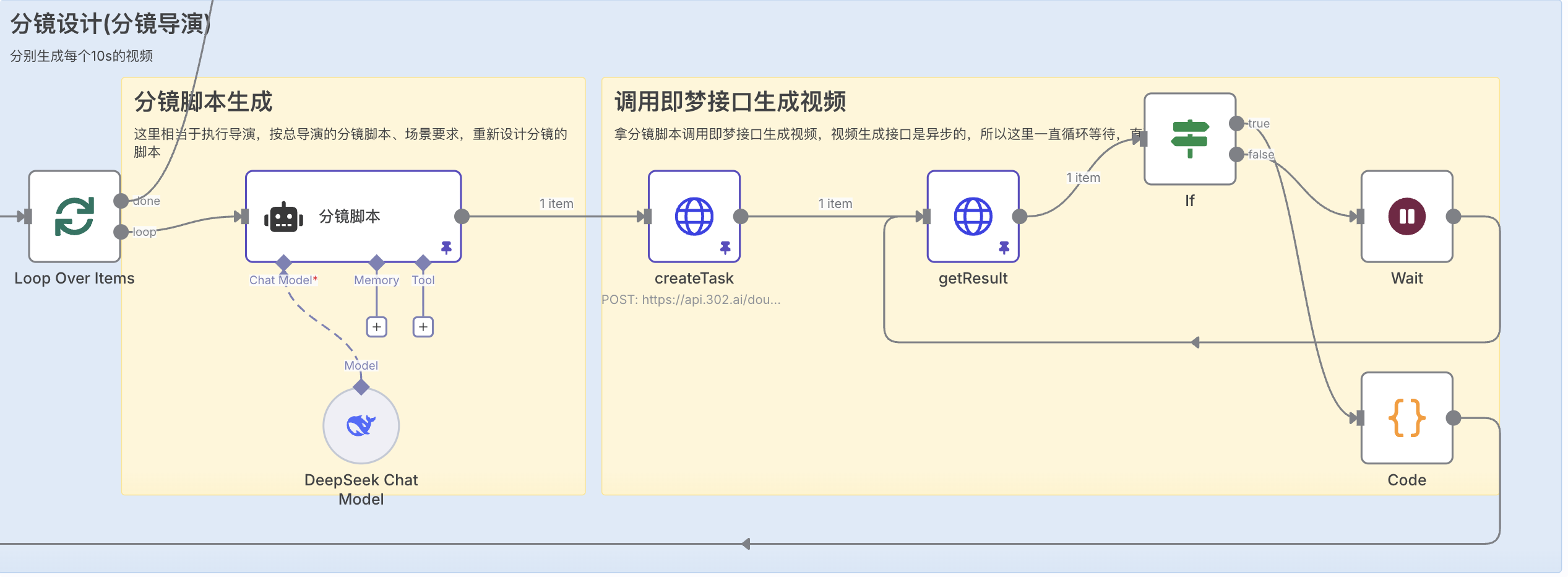

第二阶段:分镜设计与生成(分镜导演)

这个阶段将聚焦于每一个独立的镜头,如同分镜导演一样,精细地执行拍摄计划。

-

分镜脚本细化:工作流会遍历每一个镜头片段。AI“分镜导演”会为每个片段撰写详细的执行脚本,描述具体的画面内容和动态。

-

调用API生成视频:随后,系统会将详细的分镜脚本发送给视频生成API(“doubao-seedance-1-0-pro-250528”接口,即梦同款接口)来创建实际的视频片段。

-

异步轮询等待:由于视频生成需要时间,工作流会自动启动一个轮询机制,持续检查视频是否生成完毕,直到成功获取到视频文件,再继续处理下一个镜头。

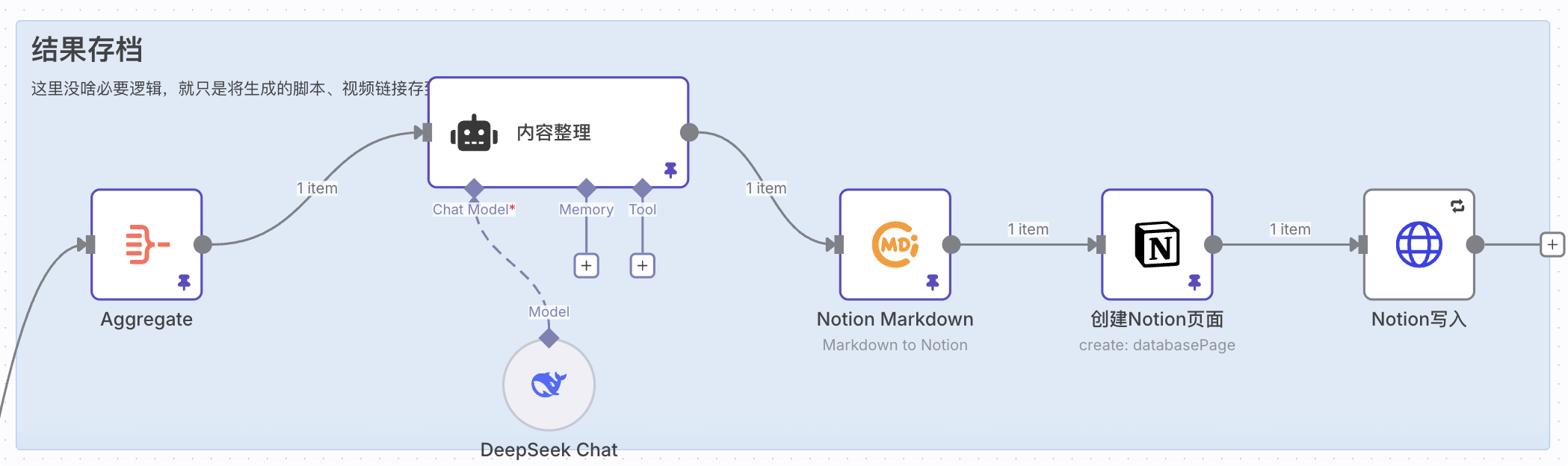

第三阶段:结果汇总与存档

在所有视频片段都生成完毕后,工作流进入最后的整理和归档阶段。

-

内容聚合整理:系统将所有生成的分镜脚本和视频链接汇总在一起,并利用AI进行最终的排版和整理,形成一份完整的成果报告。

-

自动存档至Notion:这个步骤对视频生成没有实质性的作用,只是为了存档方便查阅。

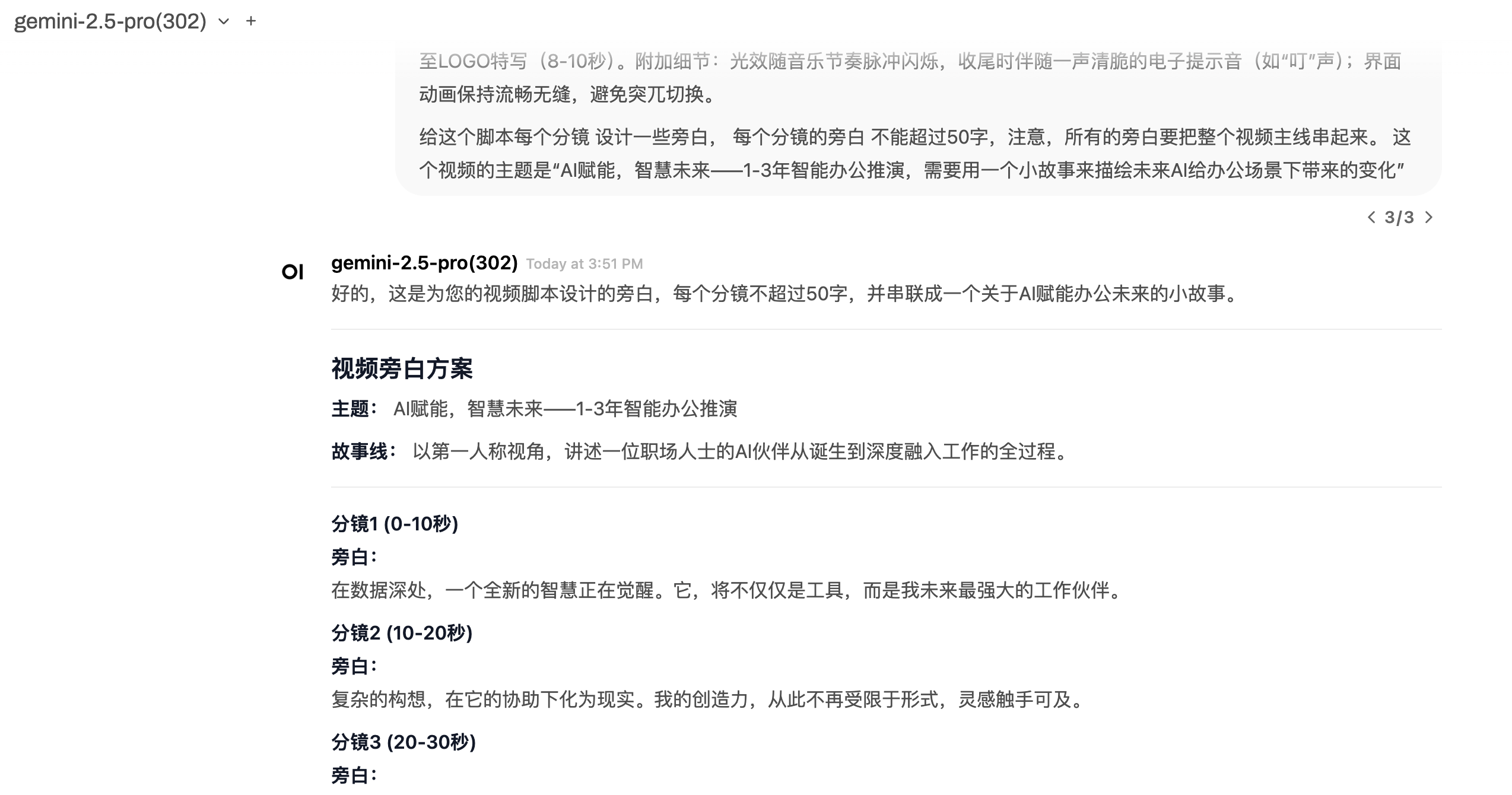

第四阶段:旁白文案音频生成

这部目前没有整合到上面工作流中(不是啥技术问题,就单纯没做)。拿到上面生成视频过程中产出的视频脚本后,直接使用AI对每个分镜生成一句 旁白文案即可,调用minimax的tts能力生成朗读音频。

第五阶段:所有素材拼装剪辑成片

这是目前唯一无法自动化的步骤,因为所有素材都是由AI独立生成的,彼此之间缺乏必然的关联性。在此阶段,需要使用剪映等视频编辑软件将生成的视频片段、旁白音频和背景音乐组装并同步。通过调整视频转场、音频淡入淡出和时间轴对齐,确保最终成片流畅连贯。

结语

起初我对AI生成的视频并没抱太大期望,但最终剪辑完成后,效果出乎意料地好。尤其是将所有AI生成的素材拼装在一起后,整体呈现出了令人满意的连贯性和观赏性。整个流程从创意到成片,AI的参与度达到了前所未有的高度,让我看到了视频创作自动化的巨大潜力。不过,现在距离大规模生产还有一个门槛——成本问题。我使用的即梦同款生成模型,成本高达每秒近1元。