(论文速读)光伏缺陷检测中的快速自适应:集成CLIP与YOLOv8n实现高效学习

论文题目:Rapid adaptation in photovoltaic defect detection: Integrating CLIP with YOLOv8n for efficient learning(光伏缺陷检测中的快速自适应:集成CLIP与YOLOv8n实现高效学习)

期刊:Energy Reports(SCI3区)

摘要:光伏发电系统的故障检测对于保持光伏发电系统的有效性和可靠性至关重要。训练目标识别模型的传统方法,包括YOLO (You Only Look Once),通常需要大量的数据集才能获得最佳性能。当只有少量的数据可访问时,这就构成了一个很大的障碍。为了解决这个问题,经常使用预训练模型,因为它们能够捕获鲁棒的和广泛适用的特征,这反过来又增强了微调期间的学习过程。本文介绍了一种检测光伏系统缺陷的新方法。最新版本的YOLO之一,被称为YOLOv8n,集成了更深更复杂的层,从而提高了速度和准确性。该方法将CLIP (contrast Language-Image PreTraining)嵌入与YOLOv8n相结合,提高了缺陷识别的准确性和效率。我们提出的方法利用OpenAI的CLIP来利用丰富的多模态嵌入,从而提高视觉输入的上下文理解。我们的技术通过使用CLIP嵌入初始化YOLOv8的层来提高数据效率、灵活性和鲁棒性。这种灵活的方法使模型即使在训练样本较少的情况下也能获得良好的性能,有效地从小数据集中获取区分信息。与当前的方法相比,集成YOLOv8n_CLIP模型在性能上有了很大的提高。达到的指标如下:准确率为95.74%,召回率为96.51%,平均准确率为98.5%。结果表明,使用当前模型检测PV问题的准确性和可靠性超过了最先进的方法。通过包含CLIP嵌入,该模型即使在有限数量的训练样本下也能实现高性能,快速适应新任务,并在压力测试中表现出更好的弹性。

🌟 引言

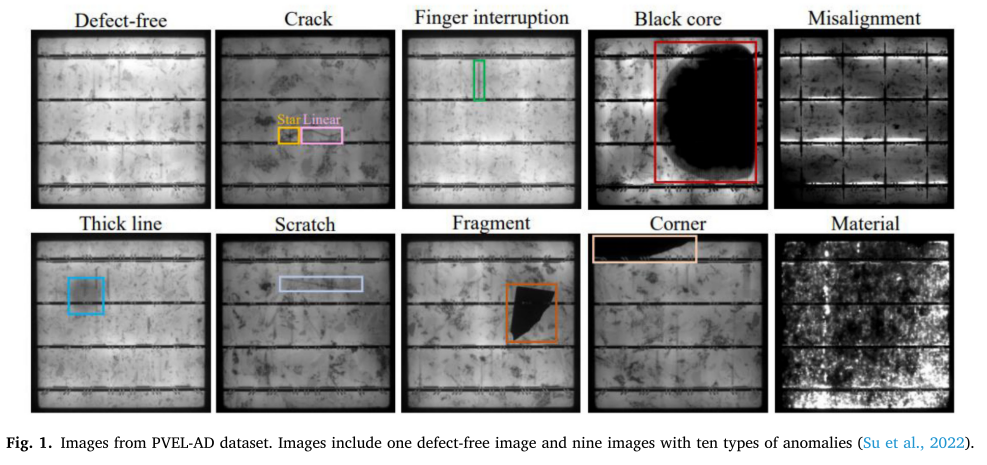

在可再生能源领域,光伏(PV)系统的效率和可靠性至关重要。然而,PV面板的各种缺陷(如裂纹、黑核、错位等)会严重影响发电效率。传统的人工检测方法不仅耗时费力,而且容易出错。那么,能否利用AI技术实现快速、准确、自动化的缺陷检测呢?

来自沙特阿拉伯Imam Mohammad Ibn Saud Islamic University的研究团队给出了肯定答案!他们提出的YOLOv8n_CLIP模型在PVEL-AD数据集上实现了98.5%的mAP,仅需每类30张图像训练,大幅降低了数据需求。

🔍 问题的挑战

传统方法的困境

光伏缺陷检测面临三大挑战:

📊 数据标注成本高

- YOLO等深度学习模型通常需要数千张标注图像

- 光伏缺陷图像获取和标注需要专业知识

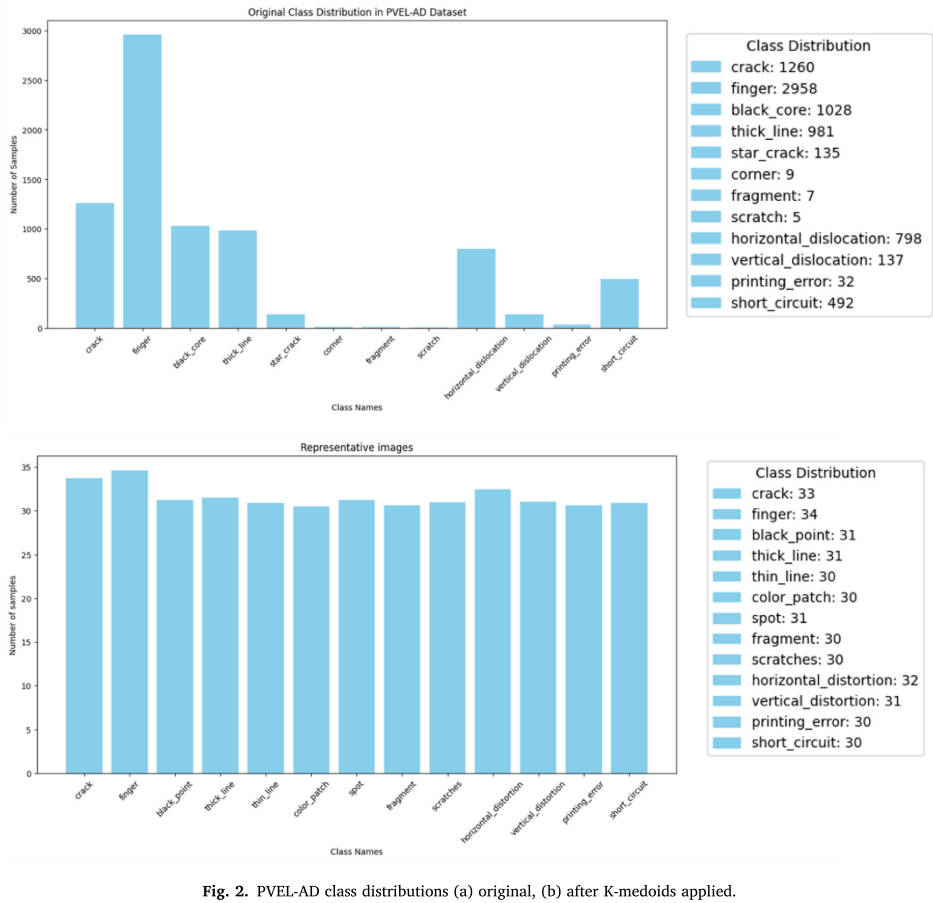

- 某些缺陷类型样本稀少(如corner仅9个样本)

⚡ 实时性要求高

- 大规模光伏电站需要快速巡检

- 传统Faster R-CNN等方法速度慢

🎯 检测精度要求严格

- 漏检可能导致安全隐患

- 误检增加维护成本

💡 创新解决方案

核心思想:让模型"站在巨人肩膀上"

研究团队的关键洞察是:为什么要从零开始学习视觉特征?能否利用已有的强大预训练模型?

他们选择了OpenAI的**CLIP(Contrastive Language-Image Pre-Training)**模型,这是一个在4亿图像-文本对上训练的多模态模型,具有强大的视觉理解能力。

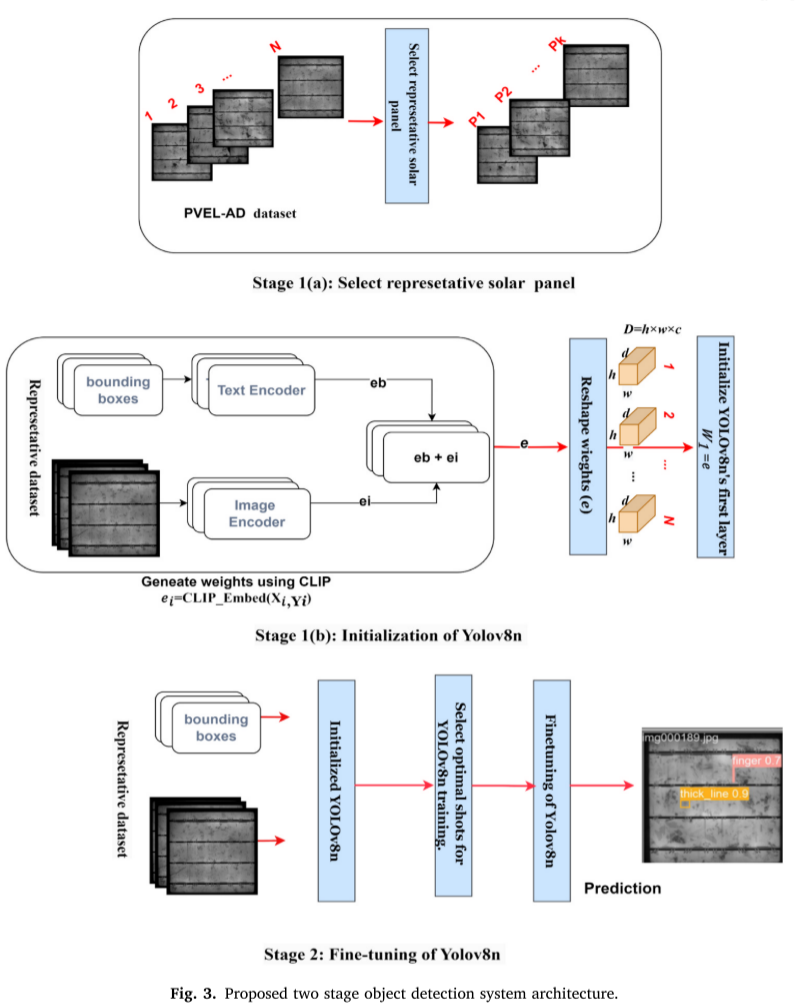

🏗️ 两阶段架构设计

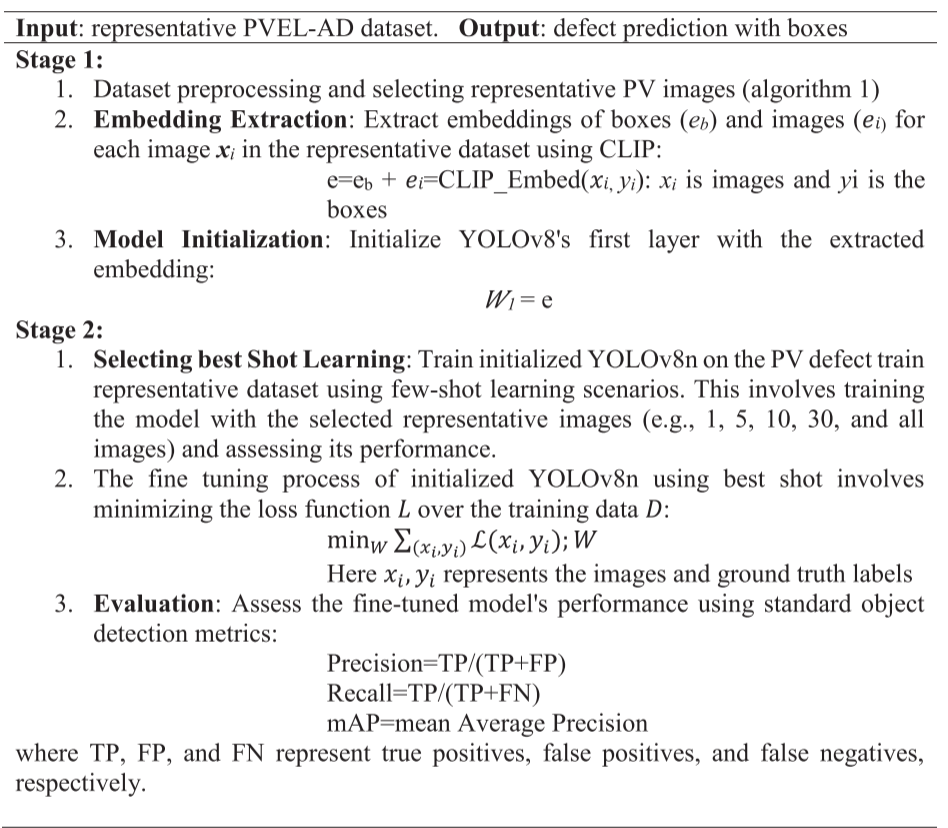

Stage 1: 智能初始化

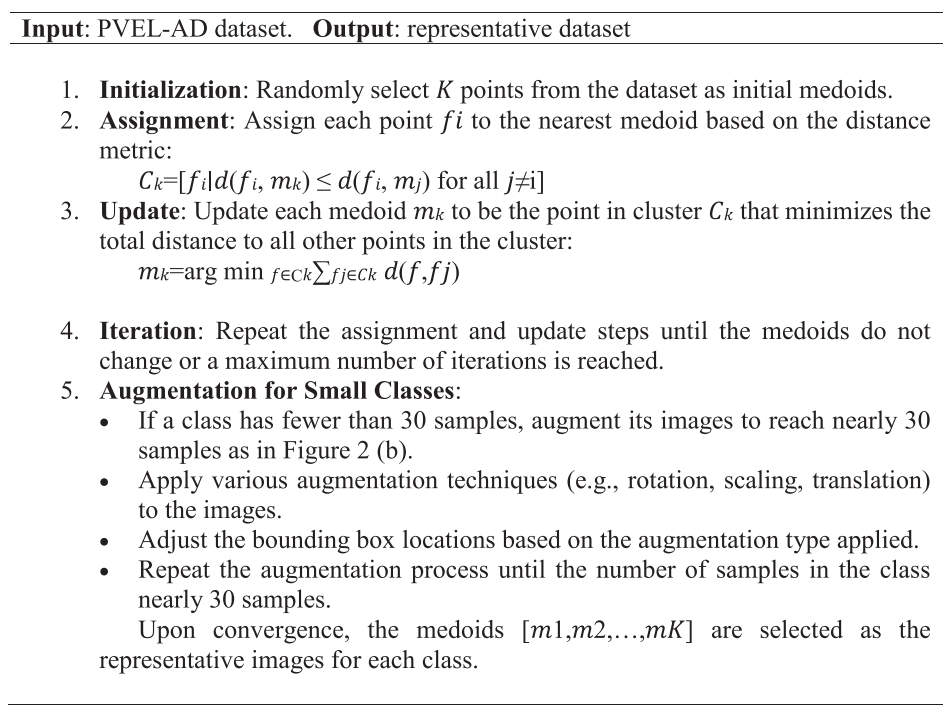

1. K-medoids聚类 → 选择最具代表性的图像└─ 相比随机采样,保证样本多样性2. CLIP嵌入提取 → 生成丰富的视觉特征└─ eb = CLIP_Text_Embed(boxes)└─ ei = CLIP_Image_Embed(images)3. 初始化YOLOv8n → W1 = eb + ei└─ 用CLIP嵌入初始化第一层权重

Stage 2: 少样本微调

测试不同shot数量:

├─ 5-shot: 有改善但不够稳定

├─ 10-shot: 性能提升明显

└─ 30-shot: 达到最佳性能 ✓

🔬 技术细节亮点

为什么选择YOLOv8n?

- ⚡ 速度快:单阶段检测,适合实时应用

- 🎯 精度高:改进的FPN和PAN结构

- 💻 轻量级:参数少,适合边缘设备部署

K-medoids vs 随机采样

- 选择类内最具代表性的medoid作为训练样本

- 最小化簇内距离,最大化样本覆盖度

- 对异常值更鲁棒

数据增强策略

if class_samples < 30:apply_augmentation(rotation, scaling, translation)adjust_bounding_boxes()

📊 实验结果

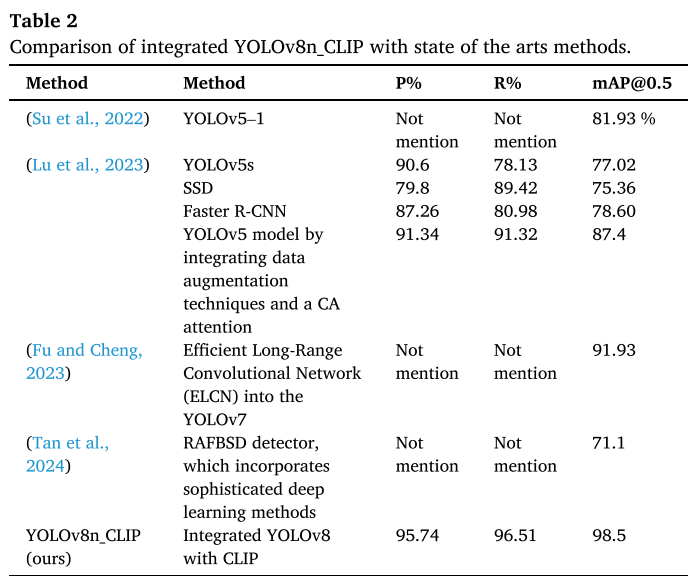

性能对比

| 方法 | Precision ↑ | Recall ↑ | mAP@0.5 ↑ |

|---|---|---|---|

| 🏆 YOLOv8n_CLIP | 95.74% | 96.51% | 98.5% |

| YOLOv5s + CA | 91.34% | 91.32% | 87.4% |

| ELCN-YOLOv7 | - | - | 91.93% |

| Faster R-CNN | 87.26% | 80.98% | 78.60% |

| SSD | 79.8% | 89.42% | 75.36% |

💪 显著优势:mAP提升7.1个百分点(相比次优方法)

少样本学习效果

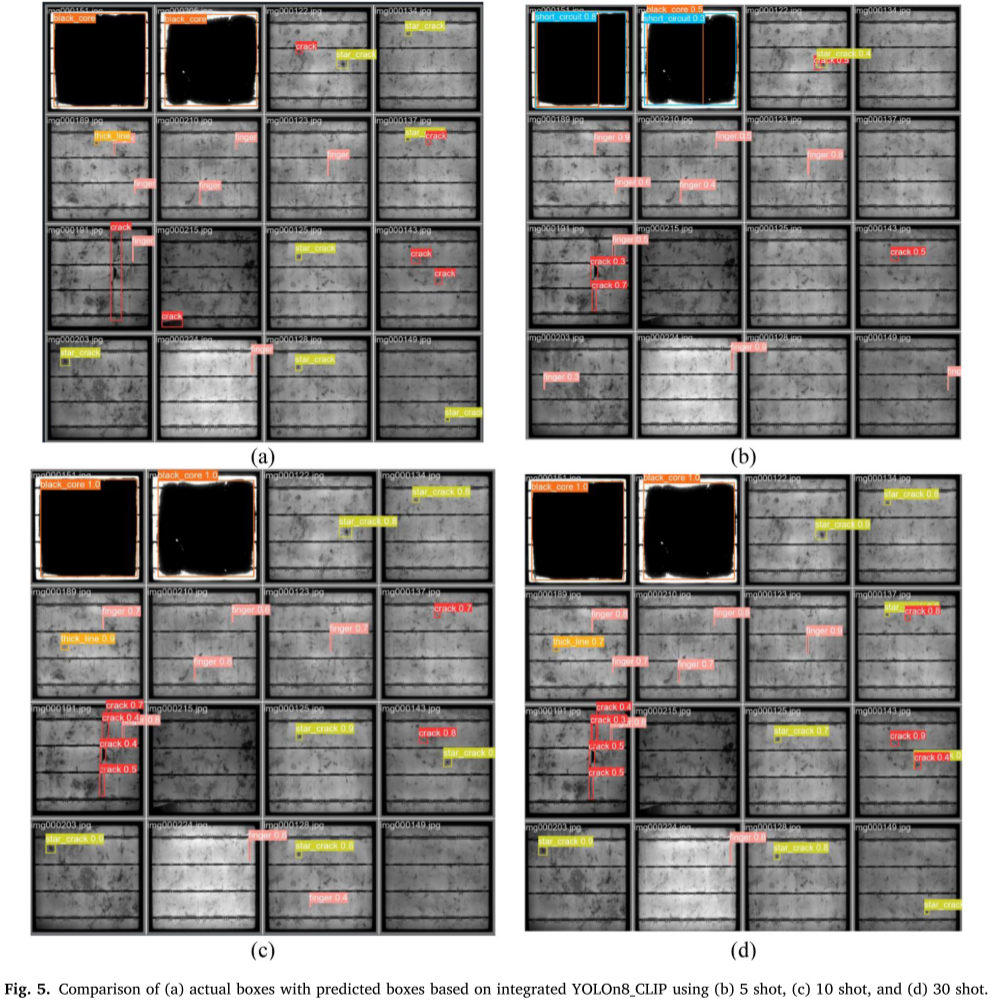

通过可视化对比发现:

- 5-shot:能检测到缺陷,但边界框不够精确

- 10-shot:定位精度明显提升

- 30-shot:达到最佳性能,边界框与实际完美匹配 ✓

统计显著性验证

进行了10次独立实验的Wilcoxon符号秩检验:

- p值 = 0.002 (< 0.05)

- 证明改进具有统计显著性,不是偶然现象

🎯 为什么这个方法有效?

1. CLIP的零样本迁移能力

CLIP在海量数据上预训练,学到了通用的视觉表示:

- 理解各种材质、纹理、形状

- 捕捉细微的视觉差异

- 提供强大的初始化

2. YOLOv8n的效率优势

- 单阶段检测架构

- 优化的特征金字塔网络

- 轻量级设计(相比Faster R-CNN参数更少)

3. 智能数据选择

K-medoids确保:

- 每个类别的代表性样本被选中

- 避免冗余和噪声数据

- 最大化有限数据的价值

4. 两阶段训练策略

预训练知识(CLIP)→ 初始化(Stage 1)→ 任务适配(Stage 2)└─ 减少训练样本需求└─ 加快收敛速度└─ 提升最终性能

🔍 深入分析:混淆矩阵告诉我们什么?

对比Fine-tuned YOLOv8n vs YOLOv8n_CLIP:

预训练YOLOv8n的问题:

- ❌ thick_line误分类为背景(26%)

- ❌ black_core与背景混淆(27%)

- ❌ horizontal_dislocation检测不稳定

YOLOv8n_CLIP的改进:

- ✅ thick_line误分类降至4%

- ✅ black_core准确率100%

- ✅ 所有类别的背景混淆大幅减少

关键洞察:CLIP嵌入帮助模型更好地区分缺陷与背景,理解细微的纹理差异。

🚀 实际应用价值

1. 降低部署门槛

- 无需数千张标注图像

- 30-shot即可训练高性能模型

- 缩短从数据收集到模型部署的时间

2. 提高巡检效率

传统方式:人工巡检 → 1000块面板/天

YOLOv8n_CLIP:自动检测 → 10000+块面板/天

效率提升:10倍以上 ✓

3. 适应新场景

- 快速适应新的缺陷类型

- 只需少量样本即可fine-tune

- 降低持续维护成本

4. 边缘设备部署

YOLOv8n轻量级设计:

- 可在无人机上实时检测

- 支持移动巡检设备

- 降低算力需求

💭 方法论启示

这项研究给我们的启发:

1. 预训练模型的力量

不要总想着从零训练,善用大模型的知识:

# 传统方式

model = YOLOv8n(random_weights) # 从零开始# 本文方式

clip_embeddings = CLIP.encode(images)

model = YOLOv8n(init_weights=clip_embeddings) # 站在巨人肩膀上

2. 数据质量 > 数据数量

- 通过K-medoids选择代表性样本

- 30张精选图像 > 300张随机图像

3. 两阶段训练的普适性

Stage 1: 利用通用预训练模型

Stage 2: 针对具体任务fine-tune

这个范式可推广到其他领域的少样本学习。

4. 多模态融合的潜力

CLIP整合了视觉和语言:

- 未来可加入文本描述("crack"、"finger interruption")

- 实现更灵活的zero-shot检测

🔮 未来方向

论文指出了几个值得探索的方向:

1. 实时检测部署

- 在实际运行的光伏系统中测试

- 优化推理速度,达到视频流实时检测

2. 扩展到更多缺陷类型

- 目前针对10种常见缺陷

- 可扩展到更多罕见缺陷

3. 跨模态增强

- 整合红外图像

- 结合气象数据提高准确性

4. 其他能源系统

- 风力涡轮机叶片检测

- 输电线路巡检

- 变电站设备监控

📚 技术实现要点

如果你想复现这个工作,关键步骤:

# 1. 数据预处理

from sklearn.cluster import KMedoids

representative_samples = KMedoids(n_clusters=K).fit(features)# 2. CLIP嵌入提取

import clip

model, preprocess = clip.load("ViT-B/32")

embeddings = model.encode_image(images)# 3. 初始化YOLOv8n

from ultralytics import YOLO

model = YOLO('yolov8n.pt')

model.model[0].weight = clip_embeddings # 初始化第一层# 4. Fine-tune

model.train(data='pvel-ad.yaml',epochs=50,batch=16,imgsz=640

)

🎓 结论

这项研究展示了如何通过clever engineering而非brute force解决实际问题:

✅ 数据效率:30-shot达到98.5% mAP

✅ 性能优异:超越所有baseline方法

✅ 实用性强:可快速部署到实际应用

✅ 方法通用:可推广到其他检测任务

如果你对光伏检测、少样本学习或YOLO系列模型感兴趣,欢迎关注和讨论!这项工作为资源受限场景下的目标检测提供了宝贵经验。 🌞