网站公司怎么做运营商做网站和软件哪个挣钱

研究背景

在机器人与物理世界交互的领域,传统视觉 - 语言 - 动作模型常因缺乏深度推理能力,难以应对复杂动态任务。上海交通大学联合项目以 Franka Research 3机器人为载体,提出了 Hume 模型方案。

该方案通过在视觉 - 语言 - 动作模型中引入系统2思维,结合价值引导的思维机制与级联动作去噪技术,实现了机器人在复杂任务中的精准控制与高效决策。最终在多个基准测试中超越现有最先进模型,解决了传统模型在复杂场景下推理不足、动作精度低的核心问题。

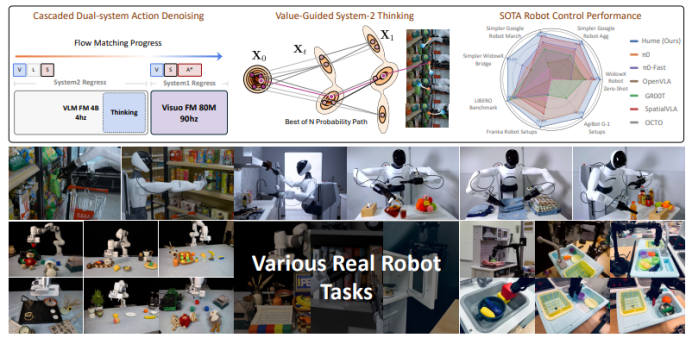

Hume,这是一种双系统视觉语言行动模型,旨在探索类人思维能力,以实现灵巧的机器人控制。该模型配备了价值导向的系统2思维和级联行动去噪功能,具备卓越的复杂推理和控制能力。该模型在各种评估中均达到了最先进的性能,并展现出 在复杂机器人控制任务方面取得了显著进展。

核心方法

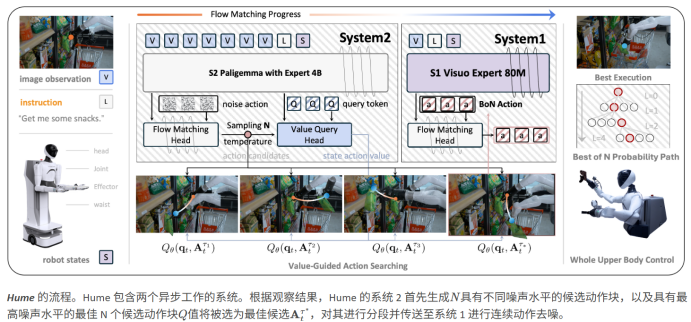

双系统架构设计:系统2作为 “慢思考” 核心,基于40亿参数的视觉语言模型构建,通过价值查询头估计动作的状态 - 动作价值,重复采样并筛选最优动作块;系统1作为轻量级 “快执行” 模块,以8000万参数实现90赫兹高频动作输出,对系统2的动作进行级联去噪。

价值引导思维机制:系统2通过流匹配去噪头生成多组候选动作,结合价值查询头的评估结果,选择价值最高的动作路径,提升复杂任务的推理准确性。

异步协作模式:系统2以4赫兹低频运行,负责长期规划;系统1异步接收动作指令并实时执行,平衡 “慢思考” 与 “快控制” 的需求。

实验设置

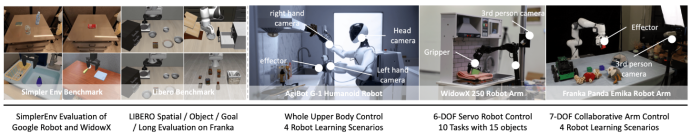

硬件设备:WidowX、AgiBot G-1和Franka机器人

机械臂:采用Franka Research 3协作机械臂,7个自由度,重复定位精度±0.1mm,配备力矩传感器,支持力控操作,适用于精细抓取与装配任务。

Franka 机器人凭实力 “内卷” 人工智能圈

相机:搭载 Intel RealSense D455 深度相机,分辨率 1280×720,帧率 30fps,同步获取 RGB 图像与深度信息,为视觉观测提供高精度数据。

计算平台:采用 NVIDIA RTX 4090 显卡与 Intel Xeon W-2295 处理器,满足模型实时推理与数据处理需求;配套机器人控制系统实现动作指令的精准执行。

实验设计与验证

场景覆盖:包含 21 个真实世界场景(如厨房物品整理、桌面装配)与 3 个模拟环境,测试变量涵盖视角变化、光照差异、未知物体与环境布局调整。

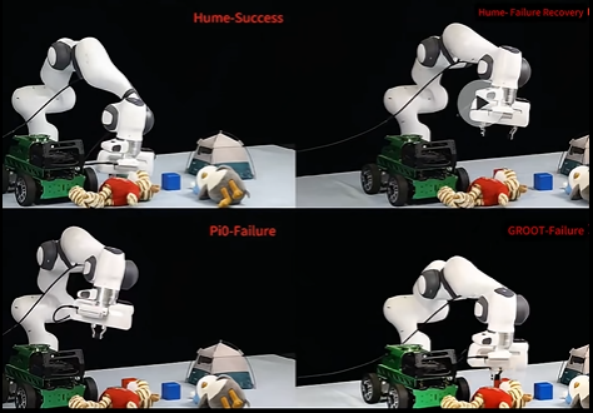

对比方案:与 OpenVLA、GR00T、π0 等主流视觉 - 语言 - 动作模型进行对比,评估指标包括任务成功率、动作流畅度、环境适应性。

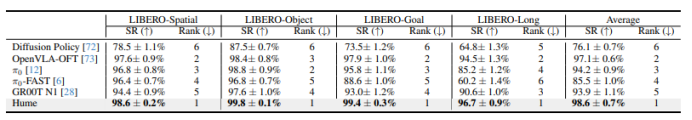

表1:LIBERO基准测试结果。展示了每种方法在四个任务套件中的成功率(SR)和标准误差,这些结果是在三个随机种子下进行500次试验的平均值。Hume取得了最高的平均成功率和排名,其次是OpenVLA-OFT和π0。

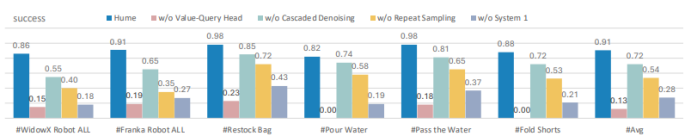

消融实验:通过移除系统 2 价值引导模块、级联去噪机制等组件,验证各核心模块的必要性;针对类人机器人控制等复杂任务进行专项测试。

在WidowX、Franka和Agibot G-1机器人上的实际消融实验。在3个不同的实际机器人平台上对Hume进行了消融研究,涵盖15个机器人学习场景和21个实际操作任务。

关键成果与突破

-

性能领先:在LIBERO基准测试中成功率提升4.4%,Simpler基准测试提升 25.9%,真实世界部署中提升12.9%,刷新同类模型最佳表现。

-

复杂推理能力:通过系统2思维实现多步任务规划,例如 “打开抽屉 - 取出物品 - 关闭抽屉” 的连贯操作,解决传统模型因短视导致的任务中断问题。

-

鲁棒性增强:在光照突变、物体位置偏移等干扰下,任务完成率仍保持 85% 以上,较传统模型提升30%以上。

结语

Hume 模型通过双系统架构与价值引导思维,为机器人赋予了类人化的 “思考” 能力,在 Franka Research 3 机器人上的实验验证了其在复杂场景中的优越性。

该成果不仅推动了视觉 - 语言 - 动作模型的技术突破,更为通用机器人在工业协作、家庭服务等领域的应用提供了关键支撑。未来可进一步优化模型效率,拓展至多机器人协同场景,持续探索类人思维与机器人控制的深度融合。