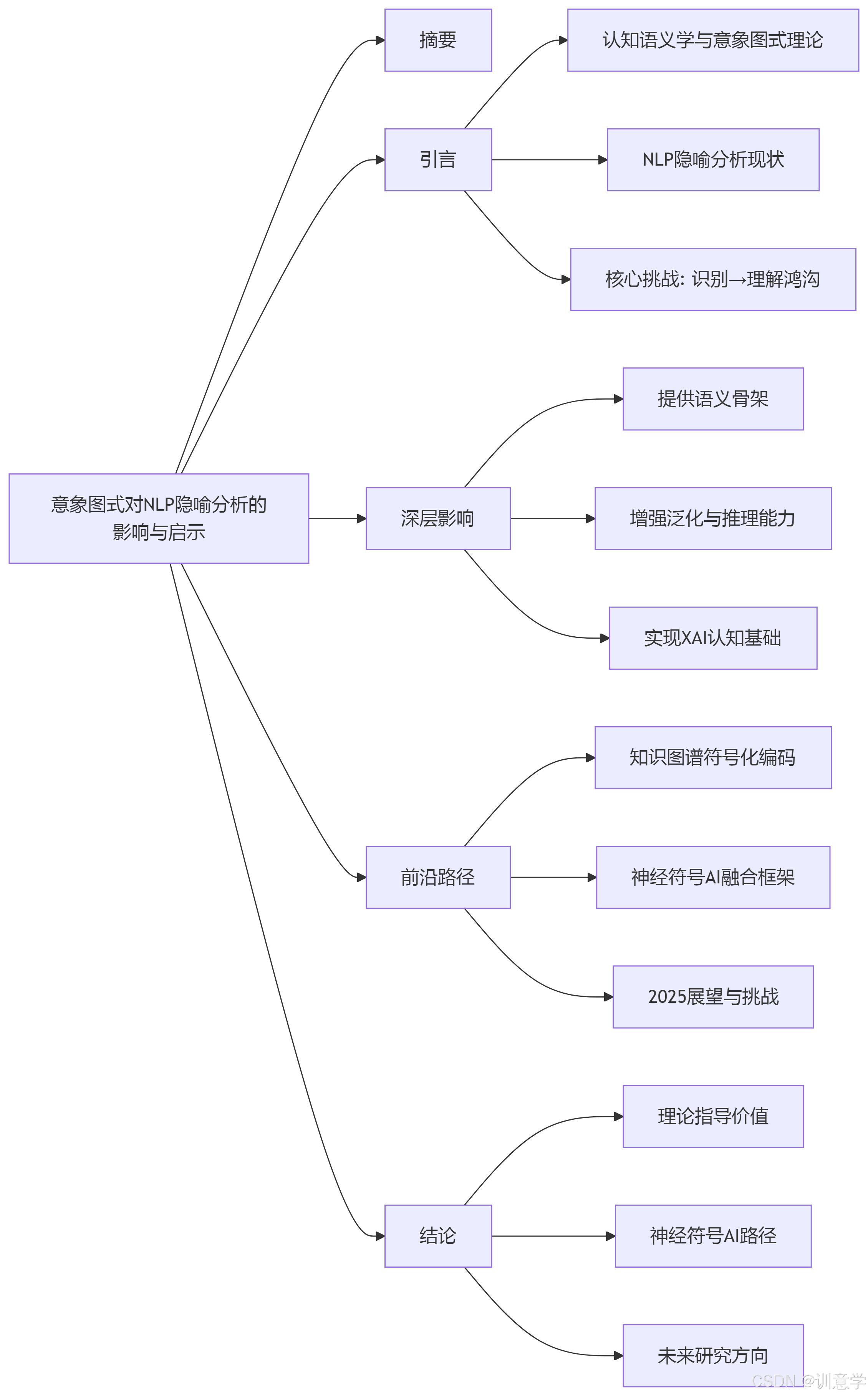

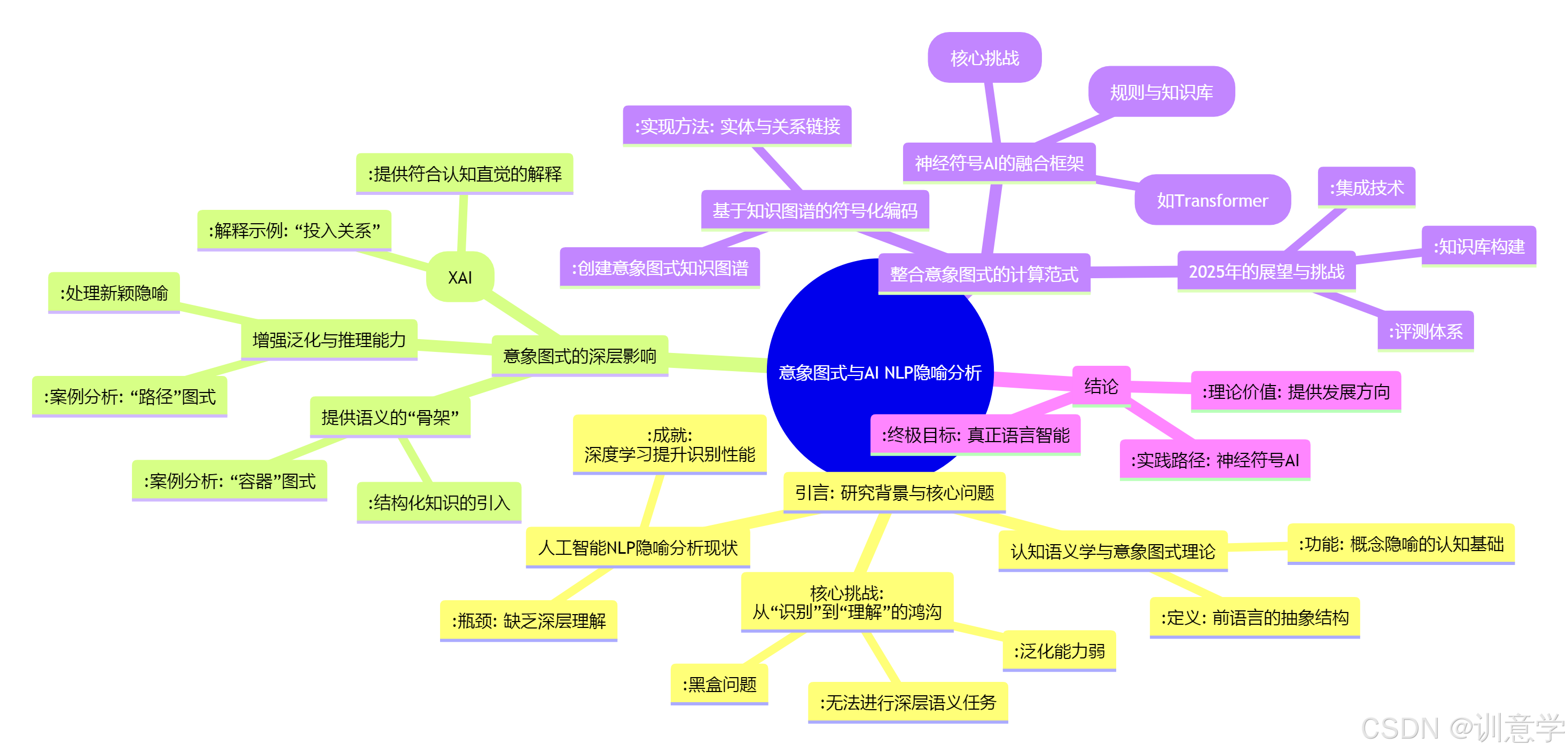

认知语义学意象图式对人工智能自然语言处理中隐喻分析的影响与启示

1. 摘要

本报告旨在深入探讨认知语义学中的核心概念“意象图式”(Image Schema)如何对人工智能自然语言处理(NLP)领域的隐喻分析产生深远影响,并为未来的技术发展提供关键启示。认知语言学认为,意象图式是源于人类身体经验和感知交互的、前语言的抽象结构,是概念隐喻形成的认知基础 。然而,截至2025年,主流的NLP隐喻分析技术,尽管在隐喻“识别”任务上借助深度学习模型取得了显著的性能表现 但大多仍停留在基于词汇分布和上下文统计的模式匹配层面,缺乏对隐喻背后概念映射机制的深层“理解”。这种“知其然,而不知其所以然”的现状,构成了当前深层语义分析的主要瓶颈。本报告分析指出,将意象图式理论整合到NLP模型中,能够为AI提供结构化的语义“骨架”,增强模型对新颖隐喻的泛化能力,并为实现可解释性人工智能(XAI)中的隐喻分析提供坚实的认知基础。报告进一步展望,以神经符号AI(Neuro-Symbolic AI)为代表的新兴技术范式,通过结合神经网络的感知学习能力与符号系统的逻辑推理能力,为将抽象的意象图式计算化、并最终赋能下一代NLP隐喻理解系统,提供了最具前景的实现路径 。

2. 引言:研究背景与核心问题

2.1 认知语义学与意象图式理论

认知语义学主张语言的意义根植于人类的经验和认知过程,而非孤立的符号系统 。在这一理论框架中,意象图式是一个基石性概念。它被定义为一种反复出现的、动态的模式,是我们通过身体与世界互动而形成的抽象结构,例如“容器”(CONTAINER)、“路径”(PATH)、“平衡”(BALANCE)、“中心-边缘”(CENTER-PERIPHERY)等 。这些图式是先于具体概念和语言的,构成了我们组织经验和知识的出发点 。

至关重要的是,意象图式通过概念隐喻(Conceptual Metaphor)这一认知机制,将我们对具体、物理领域的理解(如“空间移动”)投射到抽象领域(如“时间”、“论辩”),从而构建起庞大的概念系统 。例如,“人生是一段旅程”这一宏大隐喻,其底层结构正是基于“路径”意象图式,包含了起点、终点、方向、障碍等一系列逻辑推论。因此,意象图式被公认为概念隐喻的基础,是词义扩展和一词多义现象的关键驱动力 。

2.2 人工智能NLP中的隐喻分析现状

在自然语言处理领域,对隐喻的计算化处理经历了从早期基于规则和词典资源的方法,到基于统计和机器学习,再到当前由深度学习主导的范式演进 。特别是自Transformer架构 及其预训练语言模型(如BERT)诞生以来,NLP系统在隐喻“识别”(Metaphor Identification)任务上的性能得到了大幅提升 。

这些模型通常在如VUA(VU Amsterdam Metaphor Corpus)或MOH等标准数据集上进行训练和评测 。通过学习词语在特定上下文中的分布特征,模型能够以较高的准确率(Accuracy)和F1分数(F1-score)判断一个词或句子是否被隐喻性地使用 。例如,一些基于BERT和图神经网络(GNN)的先进模型在VUA数据集上已经取得了超过0.7甚至更高的F1分数 。

2.3 核心挑战:从“识别”到“理解”的鸿沟

尽管在性能指标上取得了成功,但当前主流的NLP隐喻分析模型存在一个根本性的局限:它们主要解决了“是什么”(识别隐喻)的问题,而未能触及“为什么”(理解隐喻机制)和“怎么样”(解释隐喻含义)的层面。这些深度学习模型本质上是强大的模式匹配器,它们通过分析海量文本发现“价格”和“高/低”经常一起出现,从而能够“识别”出“价格很高”中的隐喻用法,但它们并不“理解”这背后基于“多即是上”(MORE IS UP)这一源自垂直空间经验的意象图式隐喻。

这种缺乏深层理解的模式导致了几个问题:

- 黑盒问题:我们无法得知模型做出判断的具体依据,其决策过程不透明,难以信任和调试 。

- 泛化能力弱:对于训练语料中未出现过的、或创造性的新颖隐喻,模型的表现往往会急剧下降,因为它缺乏抽象和推理的能力 。

- 无法进行深层语义任务:模型难以完成如隐喻释义(paraphrasing)或隐喻蕴含(entailment)等需要真正理解隐喻映射关系的任务。

因此,如何在NLP模型中弥合从“识别”到“理解”的鸿沟,是当前深层语义分析领域面临的核心挑战。

3. 意象图式对NLP隐喻分析的深层影响

将意象图式理论引入NLP隐喻分析,并非简单的理论嫁接,而是为解决上述核心挑战提供了根本性的思路。其影响主要体现在以下几个方面:

3.1 提供语义的“骨架”:结构化知识的引入

意象图式为原本扁平化的词向量空间引入了结构化的、具有内在逻辑的“语义骨架”。一个词语不再仅仅是一个高维向量,而是可以与一个或多个意象图式相关联。

- 案例分析:以“容器”意象图式为例,它包含了一套内在逻辑:有内部(IN)、外部(OUT)、边界(BOUNDARY)、容量(CAPACITY)等。当AI模型被赋予这种结构化知识后,它在分析诸如“陷入爱情”(fall in love)、“摆脱困境”(get out of trouble)、“他的理论内容空洞”(his theory is empty)等海量隐喻时,就不仅仅是基于“in”、“out”、“empty”与“love”、“trouble”、“theory”的共现频率,而是能够将它们统一归因于“将抽象概念(如情感、状态、思想)视为容器”这一底层认知模式。这使得模型的理解从零散的实例上升到了系统性的规律。

3.2 增强模型的泛化能力与推理能力

基于意象图式的模型有望显著提升其泛化能力,尤其是在处理新颖隐喻时。因为意象图式本身是生成性的,其内在逻辑可以被推理和应用到新的情境中 。

- 案例分析:一个掌握了“路径”意象图式(包含起点、终点、方向、障碍物、岔路等元素)的AI模型,在理解“他的职业生涯走到了十字路口”时,能够自动推理出“十字路口”意味着需要做出“选择”,这个选择将决定未来的“方向”。即使模型之前从未见过“职业生涯”与“十字路口”的搭配,它也能通过“路径”这个中介,完成从源域(物理旅程)到目标域(职业发展)的正确推理,从而展现出强大的零样本或少样本学习能力。

3.3 实现可解释性分析(XAI)的认知基础

意象图式为隐喻分析提供了符合人类认知直觉的解释框架,是实现可解释AI(Explainable AI, XAI)的关键途径 。当模型判定一个表达为隐喻时,它可以不再给出一个冷冰冰的概率值,而是生成一个人类可以理解的解释。

- 解释示例:对于句子“我们在这段关系中投入了太多”,一个基于意象图式的XAI系统可以生成如下解释:“该句使用了隐喻。它激活了‘实体’(SUBSTANCE)意象图式和‘容器’(CONTAINER)意象图式,将抽象的‘努力/情感’概念化为可以‘投入’的‘实体’,并将‘关系’概念化为一个‘容器’。这个隐喻强调了已付出的成本和沉没感。” 这种解释不仅确认了隐喻的存在,更揭示了其背后的概念建构方式,极大地提升了AI决策的透明度和可信度 。

4. 启示与前沿路径:整合意象图式的计算范式

尽管意象图式理论的价值巨大,但将其从抽象的认知概念转化为可计算的实体,并整合进NLP模型,是学术界和工业界长期以来的一个难题 。搜索结果显示,直接将意象图式编码为具体算法或在主流深度学习模型(如Transformer、GNN)中实现的研究仍然非常稀少,构成了理论与应用之间的“最后一公里”。然而,截至2025年,若干前沿路径已展现出巨大潜力。

4.1 路径一:基于知识图谱的符号化编码

一种直接的方法是将意象图式及其相关逻辑构建成一个符号化的知识库,例如知识图谱(Knowledge Graph)。

- 实现方法:可以创建一个“意象图式知识图谱”,其中节点代表不同的意象图式(如“容器”)、其组成部分(如“边界”)和相关概念(如“进入”、“流出”)。边则代表它们之间的关系(如“is_a”、“has_part”、“entails”)。当NLP模型处理文本时,可以通过实体链接和关系抽取技术,将文本中的词语与知识图谱中的节点进行关联,从而激活相应的图式结构,为下游的推理和解释提供依据。例如,一个图编码模型(如KEG)可以被扩展,以整合这种认知层面的图知识 。

4.2 路径二:神经符号AI的融合框架

这是目前被认为最有前景、也最具挑战性的路径。神经符号AI旨在融合神经网络强大的模式识别能力和符号系统清晰的逻辑推理能力,以取长补短 。这为整合意象图式提供了完美的理论框架。

- 实现架构展望:一个未来的神经符号隐喻分析系统可能如下运作:

- 神经感知层 (Neural Perception Layer) :一个大规模的预训练Transformer模型(如BERT或其后续变体)作为底层编码器,负责处理原始文本,捕捉丰富的上下文语义和词汇分布信息,并初步识别出可能存在隐喻的文本片段 。

- 符号知识层 (Symbolic Knowledge Layer) :一个以逻辑规则或知识图谱形式存在的意象图式知识库。这一层显式地定义了各种意象图式及其推理规则(例如,IF an entity is IN a CONTAINER, THEN it cannot be OUT of it simultaneously)。

- 交互与推理层 (Interaction & Reasoning Layer) :这是神经符号系统的核心。当神经感知层检测到潜在隐喻(如“思想的深度”)时,它会触发对符号知识层的查询。符号层会匹配到“垂直”(VERTICALITY)意象图式,并返回相关的结构(上/下)和隐喻映射规则(如“重要即是深”)。此信息随后被反馈给神经层,以约束或修正其最终的语义表示。这种交互可以通过语义损失函数(Semantic Loss Function)或更复杂的逻辑张量网络(Logic Tensor Networks) 等技术实现,引导神经网络的学习过程使其符合符号知识的逻辑。

这种框架的优势在于,它既利用了深度学习处理复杂、模糊语言现象的能力,又通过符号知识赋予了模型结构化推理和可解释性,直击当前NLP隐喻分析的痛点 。

4.3 2025年的展望与挑战

展望2025年,我们正处于将认知语言学理论深度融入AI的黎明。虽然关于神经符号AI的研究在2020年后呈爆炸式增长 但将其应用于隐喻和意象图式的具体研究仍处于起步阶段 。

主要挑战包括:

- 知识库构建:如何系统、全面地构建一个机器可读的、覆盖广泛的意象图式知识库。

- 集成技术:开发更高效、更通用的神经-符号集成算法,解决两种范式在表示和计算上的差异。

- 评测体系:设计新的评测基准和任务,用于评估模型是否真正“理解”而不仅仅是“识别”隐喻,例如基于推理和解释的评测。

5. 结论

认知语义学中的意象图式理论为人工智能的深层语义分析,特别是隐喻分析,提供了不可或缺的理论指导和发展方向。它揭示了当前主流NLP模型在隐喻处理上从“识别”到“理解”的认知鸿沟。将意象图式这一源于人类经验的结构化知识引入AI,不仅能极大提升模型的泛化与推理能力,更是实现可解释隐喻分析的关键。

面向未来,以神经符号AI为代表的融合范式,为这一宏伟目标铺设了切实可行的技术路径。通过构建神经感知与符号推理相结合的混合系统,我们有望创造出新一代的NLP模型,它们不仅能发现语言中的隐喻,更能理解其背后的概念运作机制,并以人类可理解的方式进行解释。虽然挑战依然存在,但这无疑是推动AI迈向真正语言智能的必经之路,是值得在未来十年持续投入研究的核心方向。