介绍⼀下Llama的结构

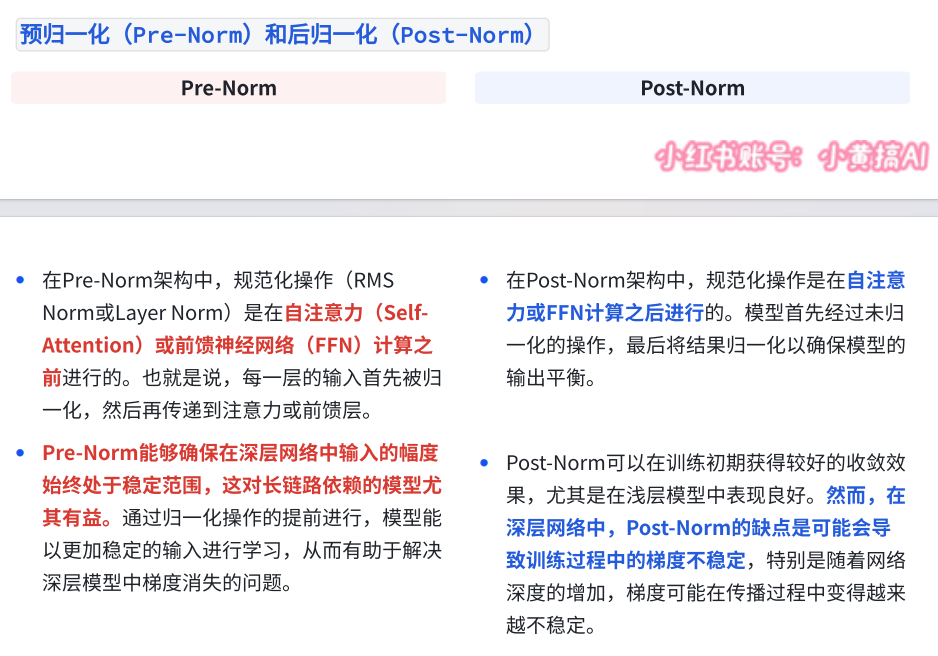

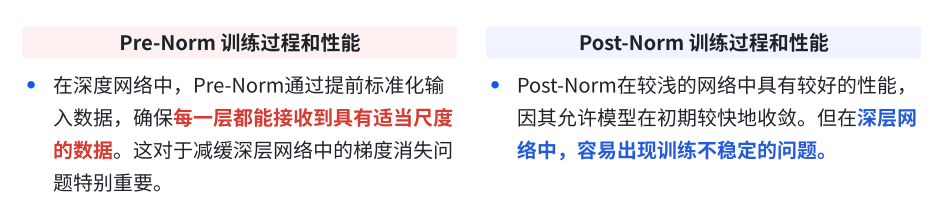

1、RMS Pre-Norm(Root Mean Square Pre-Normalization)

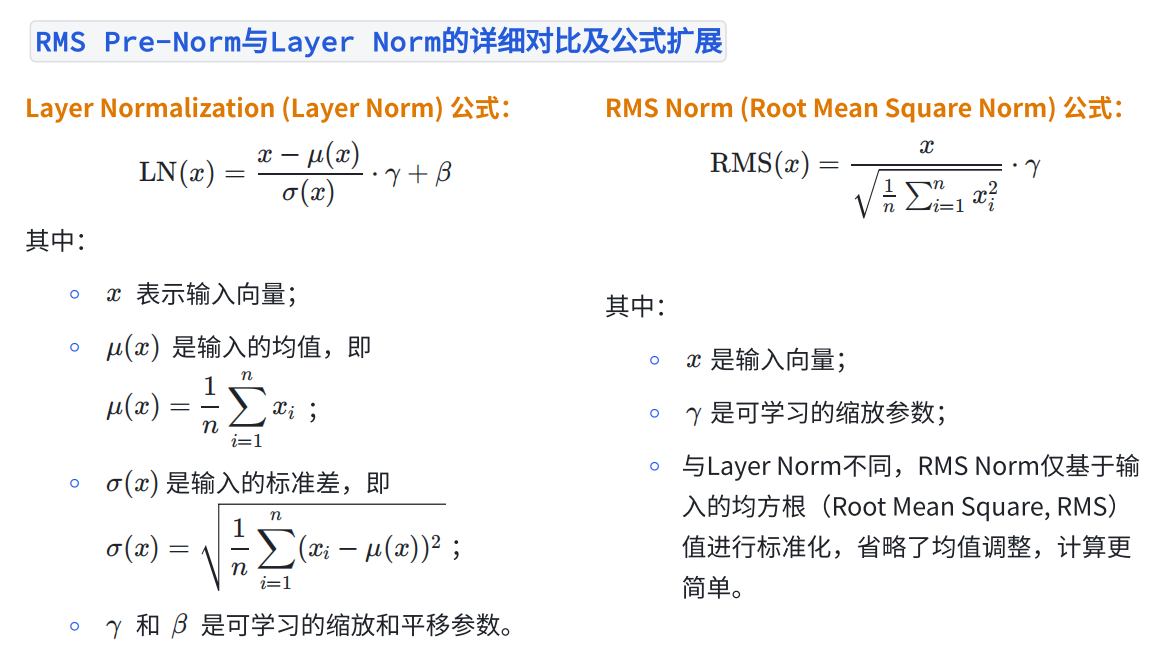

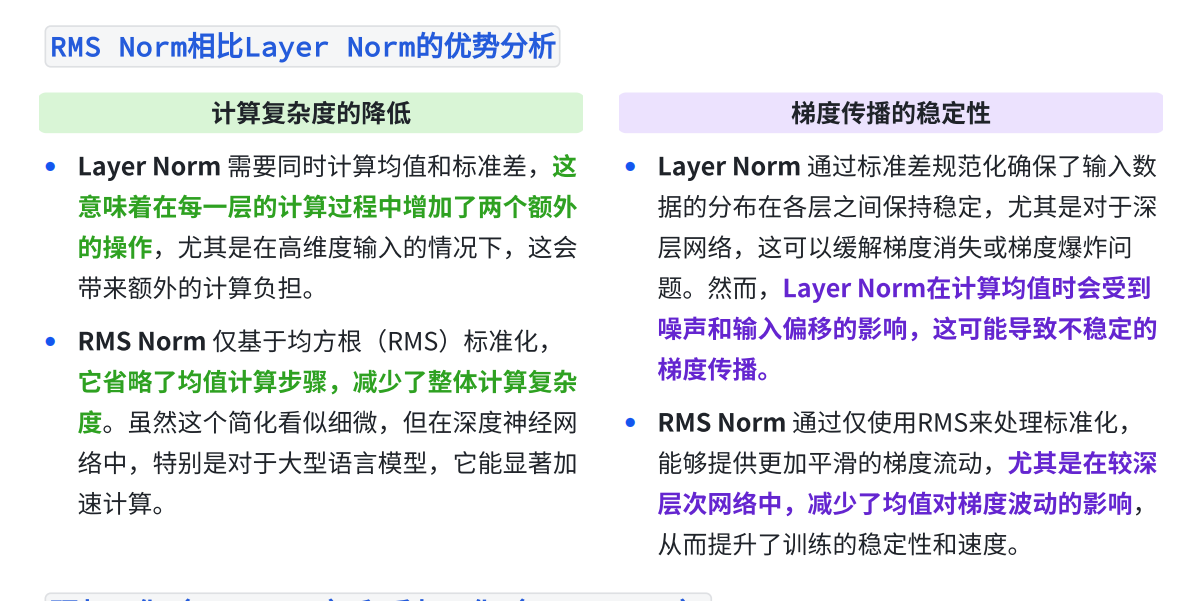

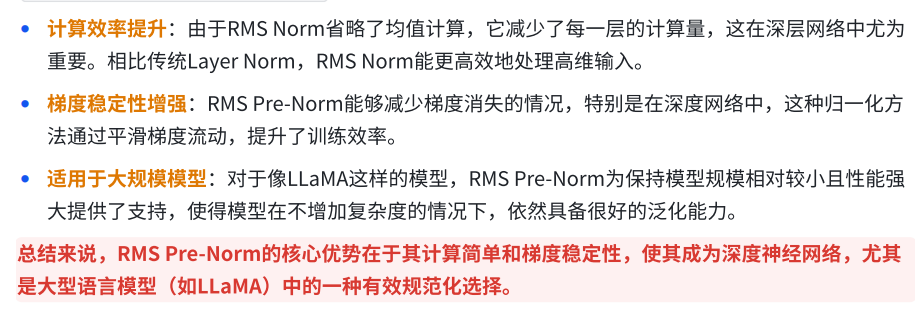

LLaMA引⼊了RMSNorm作为Layer Norm的替代。传统的Layer Norm依赖于对输⼊进⾏均值和标准差的标准化,⽽RMSNorm简化了这⼀过程,只进⾏标准化。这意味着它跳过了减去均值的步骤,计算更加⾼效。这种规范化⽅式有助于模型的梯度平滑传播,特别是在深度⽹络中,RMSNorm有助于稳定训练过程,减少梯度消失或爆炸的⻛险。

总结:RMS Pre-Norm的好处

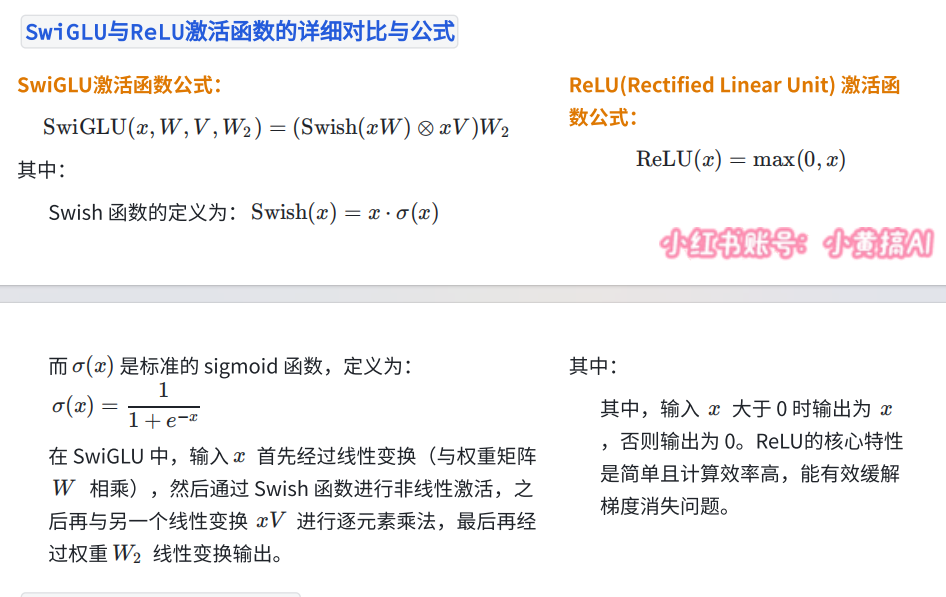

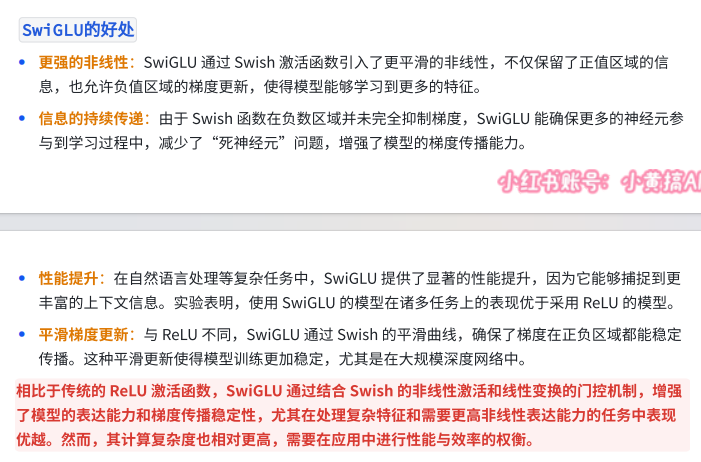

2、SwiGLU

3、RoPE

位置编码方式——RoPE-CSDN博客

综上,LLaMA模型通过引⼊RMS Pre-Norm规范化技术、SwiGLU激活函数和RoPE位置编码等创新点,有效地优化了Transformer结构,提升了模型在⾃然语⾔处理任务上的性能和效率。这些精⼼设计的改进使得LLaMA成为⼀个在多种应⽤场景下都具有竞争⼒的语⾔模型。