大模型中的核心参数temperature 您知道是什么东东吗?

大模型的 temperature 参数是控制生成文本随机性与创造性的关键超参数,其本质是通过修改概率分布来调节模型输出的“保守”或“冒险”程度。

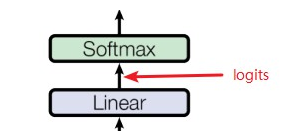

一、核心原理:Softmax 的温度调节

设模型原始输出的 logits 为 $z_i$,预测概率为:

![]()

备注:

在深度学习的上下文中,logits 就是一个向量,下一步通常被投给 softmax/sigmoid 的向量。

其中:

-

$z_i$:模型输出的原始 logits(未归一化的预测值)

-

$T$:温度参数(Temperature)

-

$N$:候选词数量

-

$P_i$:最终输出的概率

$T$ 作用如下:

| Temperature (T) | 对概率分布的影响 | 生成效果 |

|---|---|---|

| T → 0 | 放大最高概率项,分布尖锐化 | 确定性高,选择最可能结果(保守) |

| T = 1 | 保持原始概率分布 | 平衡随机性与确定性 |

| T > 1 | 压缩概率差异,分布平坦化 | 随机性强,创意涌现(冒险) |

直观示例:假设三个候选词概率为 [0.7, 0.2, 0.1]

-

T=0.1 → 输出概率

[0.99, 0.01, 0.00](几乎必然选第一个) -

T=1 → 保持

[0.7, 0.2, 0.1] -

T=2 → 输出概率

[0.52, 0.31, 0.17](第二、三选项机会大增)

Logits ($z_i$) 的本质:

-

Logits 是模型输出的原始分数,表示每个候选词的"相对可能性"

-

例如三个候选词 logits: $[3.0, 1.5, 0.5]$,值越大表示模型认为该词越可能被选择

二、不同场景下的推荐取值

| 任务类型 | 推荐 Temperature | 原因说明 |

|---|---|---|

| 代码生成 | 0.1 ~ 0.3 | 需要精确语法,避免随机错误 |

| 测试用例生成 | 0.2 ~ 0.5 | 平衡覆盖边界值与保持规范性 |

| 技术文档摘要 | 0.3 ~ 0.6 | 保留关键信息的同时避免呆板 |

| 创意故事写作 | 0.7 ~ 1.2 | 激发多样性情节和人物对话 |

| 头脑风暴/创意命名 | > 1.0 | 最大化探索可能性空间 |

| 医学/法律咨询 | < 0.3 | 禁止随机性,确保事实准确性 |

三、与 Top-p/Top-k 采样的关系

Temperature 常与以下参数协同使用:

| 参数 | 作用 | 与 Temperature 的配合 |

|---|---|---|

| Top-k | 限制候选词数量 | 先选 k 个最可能词,再用 T 调节分布 |

| Top-p | 限制概率累积阈值 | 选概率和达 p 的词集,再用 T 平滑 |

经典组合方案:

-

确定性任务:

temperature=0.2 + top_p=0.9 -

创意任务:

temperature=0.8 + top_k=50

四、极端值的影响与风险

| Temperature | 优势 | 风险 |

|---|---|---|

| T=0 | 输出稳定可重现 | 陷入重复循环(如:”测试步骤1. 测试步骤1. 测试步骤1...“) |

| T>1.5 | 极高创造性 | 逻辑断裂、事实错误(如生成”负数年龄“的测试用例) |

注:部分框架中 T=0 等效于 greedy decoding(始终选最高概率词)

五、在测试用例生成中的实战技巧

# 示例:DeepSeek-R1 的测试用例生成参数优化

response = client.chat.completions.create(model="deepseek-chat",messages=[{"role": "user", "content": "生成登录功能的边界值测试用例"}],temperature=0.3, # 平衡规范性与边界覆盖top_p=0.95, # 保留95%概率质量的候选max_tokens=1024,stop=["###"] # 防止过度生成

)# 典型问题及调参方案:

# 1. 用例缺乏边界场景 → 提高temperature至0.4-0.5

# 2. 用例包含非法输入(如非邮箱格式)→ 降低temperature至0.2 + 提示中强化约束六、不同模型的默认值参考

| 大模型 | 默认 Temperature | 推荐技术任务范围 |

|---|---|---|

| DeepSeek-R1 | 0.7 | 0.2 ~ 0.5 |

| GPT-4 | 1.0 | 0.3 ~ 0.7 |

| Claude 3 | 0.5 | 0.2 ~ 0.6 |

| Llama 3 | 0.6 | 0.1 ~ 0.8 |

七、高级技巧:动态温度调节

在长文本生成中可分段设置温度:

def dynamic_temperature(step):if step < 10: # 开头阶段保守return 0.2 elif step < 30: # 主体阶段平衡return 0.5 else: # 结尾激发创意return 0.8适用场景:测试用例生成中先规范描述步骤(低温),后补充异常场景(中温)

掌握 temperature 的精细调节,可让大模型在精准性与创造力间达到最佳平衡,尤其对技术文档生成、测试用例设计等场景至关重要。