3D 软件在游戏开发中的全链路应用:从原型到上线的实战解析

在游戏产业高速发展的今天,3D 技术已成为打造沉浸式体验的核心支柱。从独立团队开发的像素风小游戏,到 3A 大作的宏大开放世界,3D 软件贯穿了游戏开发的全流程。了解这些工具的协同逻辑,能让创意落地更高效。

原型阶段:快速搭建可交互框架

游戏开发的第一步是验证玩法可行性,这时不需要高精度模型,而是追求快速迭代。Blender 的基础建模功能足以满足需求,设计师用简单的几何体搭建场景,再通过 Unity 的组件系统赋予基本物理属性 —— 比如让角色模型实现重力感应、碰撞检测。

这个阶段的关键是 “轻量化”。用 Sketchfab 下载低多边形模型,配合 Substance 3D Painter 的预设材质库,能在一天内完成可玩原型。独立游戏《星露谷物语》的早期版本,就是用类似流程验证了农场经营玩法的趣味性。

资产制作:打造高精度游戏元素

进入正式开发后,3D 软件开始分工协作。角色模型师用 3ds Max 构建基础网格,再用 ZBrush 雕刻细节 —— 比如盔甲的磨损痕迹、面部的皱纹肌理。这些高模通过 “烘焙” 技术,将细节信息转移到低模上,既保证视觉效果,又能控制文件大小。

场景资产则依赖模块化设计。用 Maya 制作重复使用的组件(如路灯、栏杆),导入 Unreal Engine 后通过蓝图系统实现批量布置。《赛博朋克 2077》的夜之城之所以庞大且精细,正是得益于这种 “组件化 + 实例化” 的工作流。

材质和纹理是提升真实感的关键。Substance Designer 允许艺术家创建程序化材质,比如随距离变化的路面磨损效果;Quixel Mixer 则能快速合成照片级纹理,让沙漠场景的沙子呈现出自然的颗粒感。这些工具生成的文件会被导入游戏引擎,实时渲染出符合预期的视觉效果。

动画与交互:让角色 “活” 起来

游戏角色的灵魂在于动画。Maya 的骨骼绑定系统能创建精准的角色控制器,动画师通过关键帧制作行走、攻击等基础动作;再用 MotionBuilder 处理动作捕捉数据,让角色表情、肢体运动更自然。《最后生还者》中 Ellie 的细腻动作,就是这样通过 “手工调帧 + 动捕修正” 实现的。

交互逻辑则由引擎和辅助工具共同完成。用 Houdini 制作粒子特效 —— 比如角色技能释放时的火焰、烟雾;再通过 Unity 的 C# 脚本控制特效触发时机。当玩家按下技能键时,引擎会同步调用 Maya 制作的角色动作、Houdini 的粒子效果,以及 FMOD 生成的音效,形成完整的反馈闭环。

优化与上线:平衡性能与体验

开发后期的核心是性能优化。用 Marmoset Toolbag 预览模型在不同设备上的渲染表现,调整材质精度;通过 Unreal Engine 的统计工具检测 Draw Call 数量,合并冗余模型。《原神》能在手机端流畅运行,离不开对模型面数、材质分辨率的精细化控制。

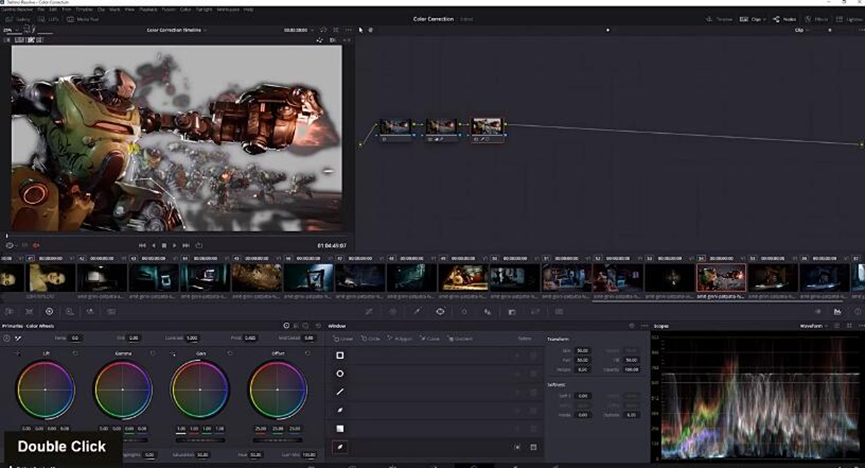

最终发布前,还需要用 Adobe Substance 3D Stager 制作宣传素材,配合 DaVinci Resolve 剪辑游戏预告。这些内容既能用于市场推广,也能帮助测试团队更直观地发现视觉 BUG。

从原型到上线,3D 软件的协同就像一场精密的交响乐。中小团队不必追求全套顶级工具,用 Blender+Unity 的组合就能完成大部分工作;而 3A 项目则需要根据环节需求灵活搭配专业软件。

本地性能不足,可以使用云渲染平台,渲云基于分布式云计算架构,将渲染任务拆解后并行处理,显著提升渲染效率。32核起步的高性能云主机可弹性扩展至192核以应对超大型场景和动画。