Deit 模型讲解和代码资源合集

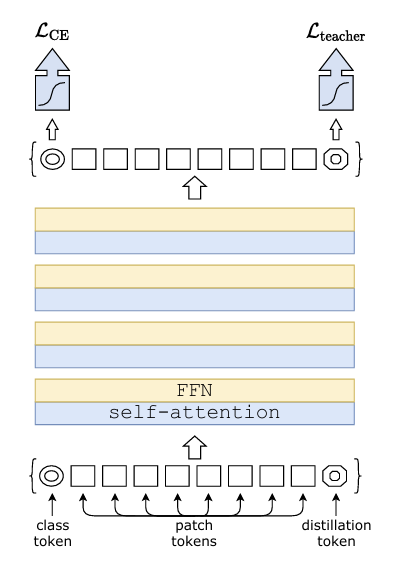

DeiT(Data-efficient Image Transformer)是由Facebook AI和索邦大学联合提出的高效视觉Transformer模型,通过引入注意力蒸馏(distillation through attention)机制显著提升了训练效率。相关资源包括:

1)论文与源码(arXiv:2012.12877,GitHub开源);

2)技术解析文章(51CTO/CSDN等平台详解模型原理与蒸馏方法);

3)实现教程(PyTorch版ViT/DeiT代码库);

4)论文翻译(完整中译版)。

核心创新在于采用CNN教师模型进行知识蒸馏,使Transformer在较小数据集上达到SOTA性能。多篇解读从不同角度剖析了其架构设计、训练策略及与ViT的对比。

论文链接:https://arxiv.org/abs/2012.12877

发表单位:FaceBook AI & Sorbonne University

源码地址:https://github.com/facebookresearch/deit

资源合集

1、Transformer + Distillation:DeiT 高效的图像Transformer

详细讲解了DeiT模型论文

链接:搞懂Vision Transformer 原理和代码,看这篇技术综述就够了(三)_51CTO博客_vision transformer和transformer区别

2、DeiT:ViT & 模型蒸馏

简单阐述了DeiT的机制,并介绍了模型蒸馏方法,额外提供了DeiT的实现代码

链接:(73 封私信 / 81 条消息) DeiT:ViT&模型蒸馏 - 知乎

3、DeiT:Training data-efficient image transformers & distillation through attention

简要讲解了DeiT论文内容

链接:DeiT:Training data-efficient image transformers & distillation through attention-CSDN博客

4、Transformer主干网络——DeiT保姆级解析

链接:Transformer主干网络——DeiT保姆级解析_deit v2-CSDN博客

5、【论文阅读】DeiT | Training data-efficient image transformers & distillation through attention

链接:【论文阅读】DeiT | Training data-efficient image transformers & distillation through attention-CSDN博客

6、 论文阅读笔记 | Transformer系列——DeiT

链接:论文阅读笔记 | Transformer系列——DeiT_deit系列-CSDN博客

7、【读论文】Transformer的蒸馏DeiT: Training data-efficient image transformers & distillation through attention

又是一篇赏析DeiT论文的文章

链接:(73 封私信 / 81 条消息) 【读论文】Transformer的蒸馏DeiT: Training data-efficient image transformers & distillation through attention - 知乎

8、DeiT翻译【Training data-efficient image transformers & distillation through attention】

纯正的中文版论文

链接:DeiT翻译【Training data-efficient image transformers & distillation through attention】-CSDN博客

9、DeiT

一篇特别简短介绍DeiT的文章,但是干货很多

链接:(73 封私信 / 81 条消息) DeiT - 知乎

10、ViT和DeiT的原理与使用

链接:(73 封私信 / 81 条消息) ViT和DeiT的原理与使用 - 知乎

11、DeiT:使用Attention蒸馏Transformer

链接:(73 封私信 / 81 条消息) DeiT:使用Attention蒸馏Transformer - 知乎

12、基于Pytorch实现的ViT模型源码

链接:GitHub - lucidrains/vit-pytorch: Implementation of Vision Transformer, a simple way to achieve SOTA in vision classification with only a single transformer encoder, in Pytorch

13、基于Pytorch实现的DeiT模型源码

链接:GitHub - facebookresearch/deit: Official DeiT repository