2025.5.19-2025.5.25学习周报

目录

- 1 GCN

- 2 平流-扩散方程

1 GCN

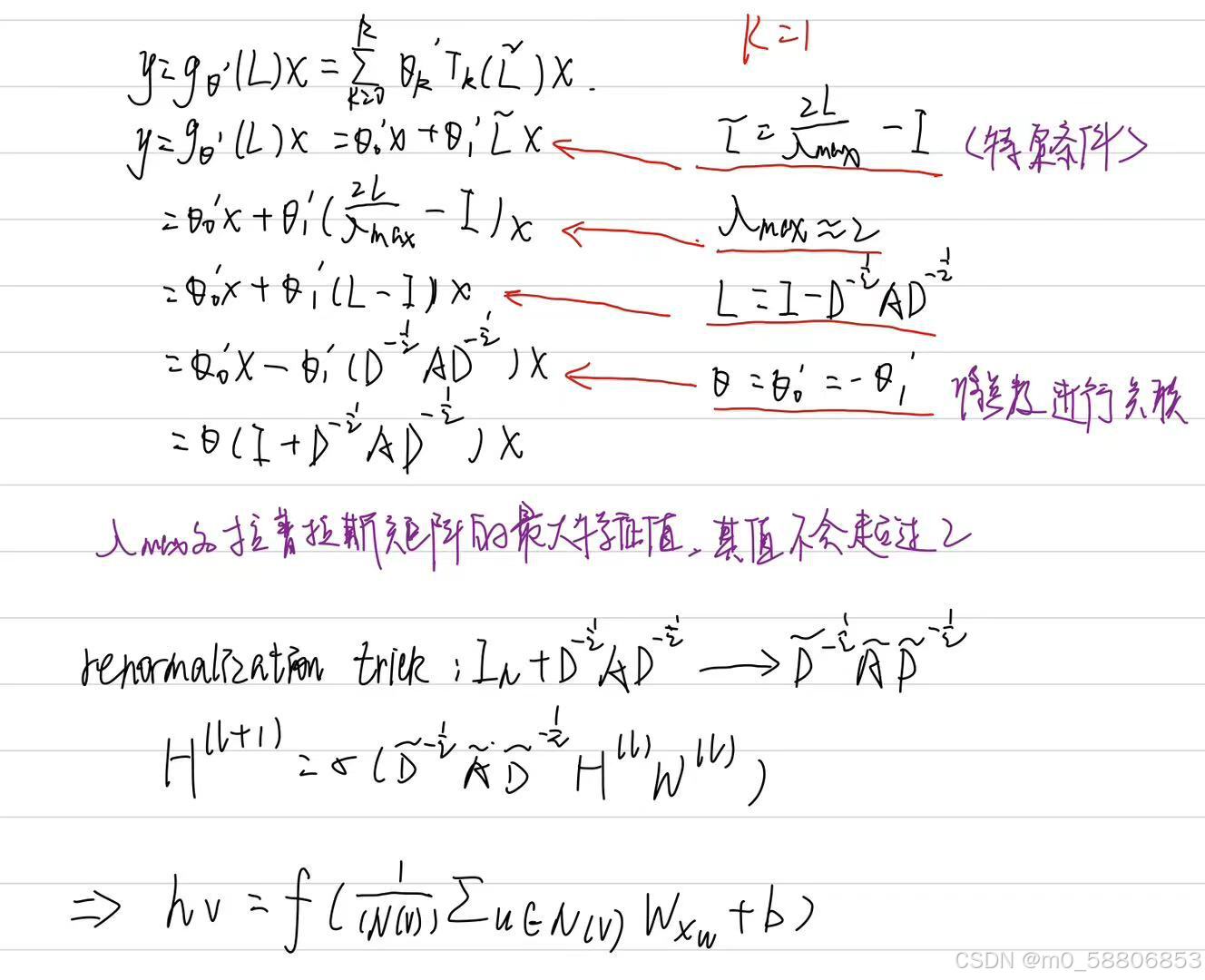

GCN实际上跟CNN的作用一样,就是一个特征提取器,只不过它的对象是图数据。GCN精妙地设计了一种从图数据中提取特征的方法,从而让我们可以使用这些特征去对图数据进行边预测(,还可以顺便得到图的嵌入表示(graph embedding)。初期研究者为了从数学上严谨的推导GCN公式是有效的,所以会涉及到诸如傅里叶变换,拉普拉斯。GCN的卷积核更小,参数量也更少,计算复杂度也随之变小了,它等价于最简的一阶切比雪夫卷积。

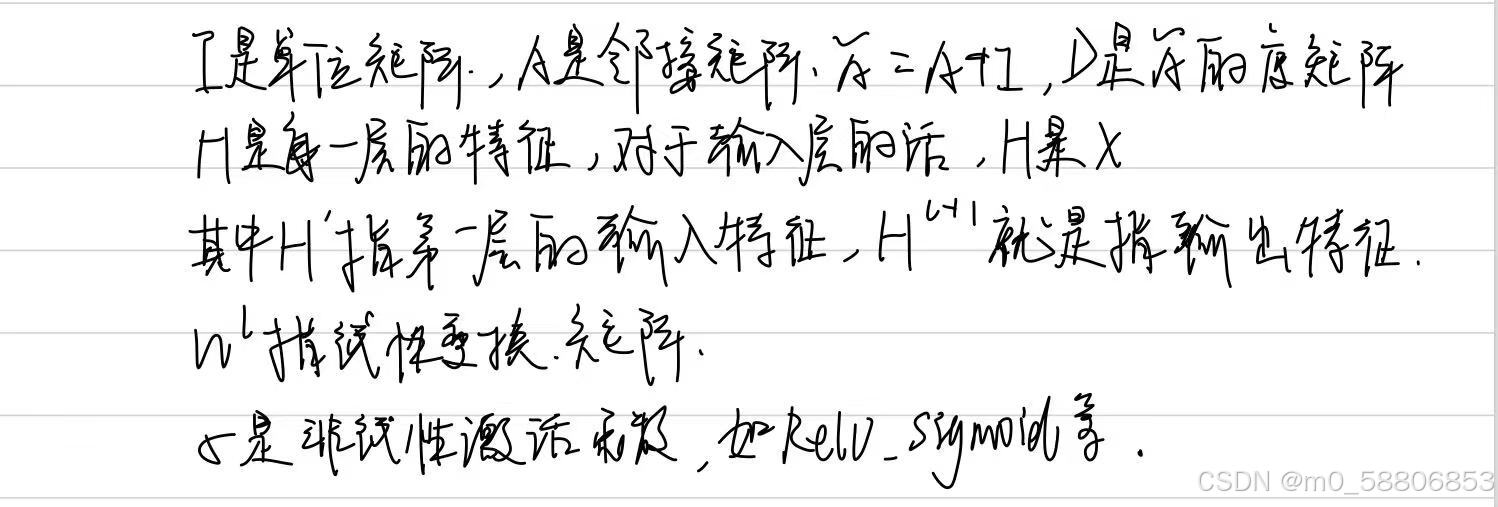

假设有一个图数据,一共有N个节点(node),每个节点都有自己的特征,我们设这些节点的特征组成一个N×D维的矩阵X,然后各个节点之间的关系也会形成一个N×N维的矩阵A,也称为邻接矩阵(adjacency matrix)。X和A便是我们模型的输入。

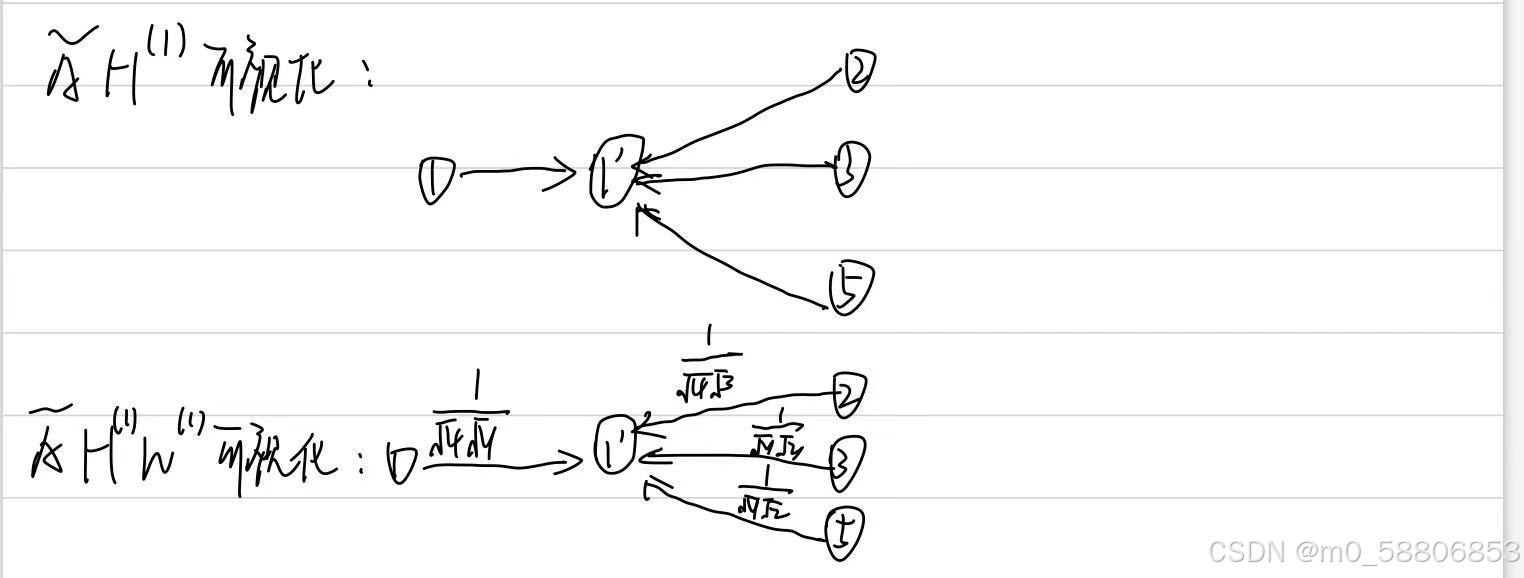

下图就是GCN网络层的基础公式,这个式子的意思就是,先把node feature(x)mm经过一个transform,把所有的邻居节点以及它自己本身加起来取平均值,再加一个b经过一个activation之后就会得到最后的hv。

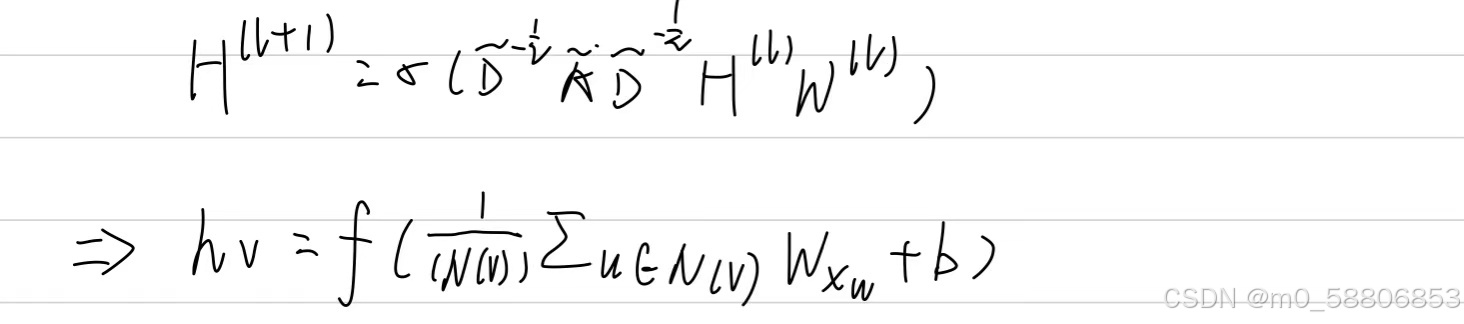

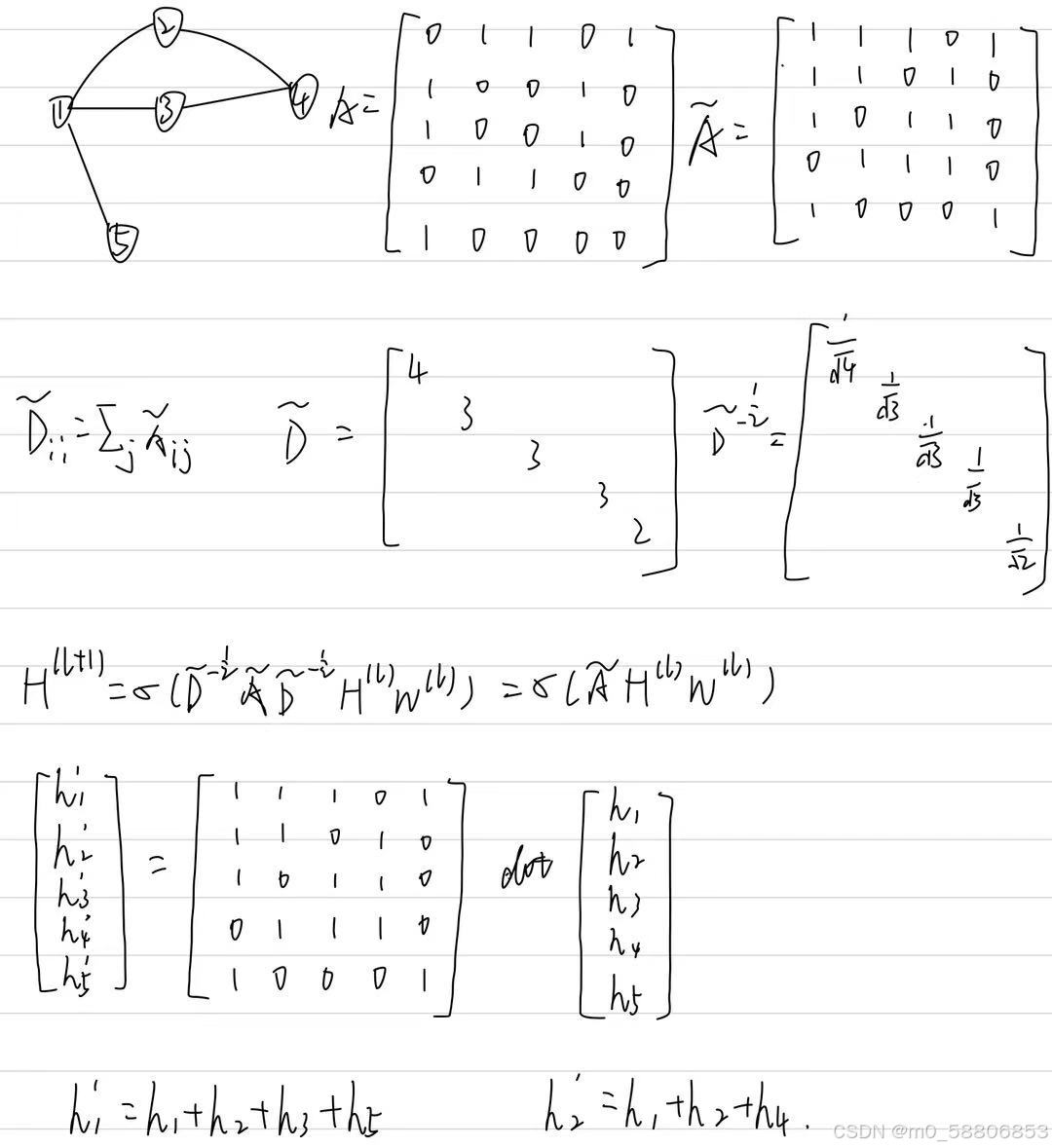

通过一个例子对公式原理进行分析

下一层某一节点的向量表示就是当前层节点向量表示的和,这其实是一个消息传递的过程,经这样消息传递的操作后,下一层的节点就聚集了它一阶邻居与自身的信息。这就很有效的保留了图结构给我们承载的信息。因此AHI的含义即聚合周围节点的信息,来更新自己。

而简单的聚合却不太合理,因为不同的节点重要性不一样,如果一个节点的「度」非常大,即与他相邻的节点非常多,那么它传递的消息,权重就应该小一点。对于度矩阵D,其数值就是代表一个节点的邻居节点数量,所以乘以度矩阵的逆也就是稀释掉度很大的节点的重要度。

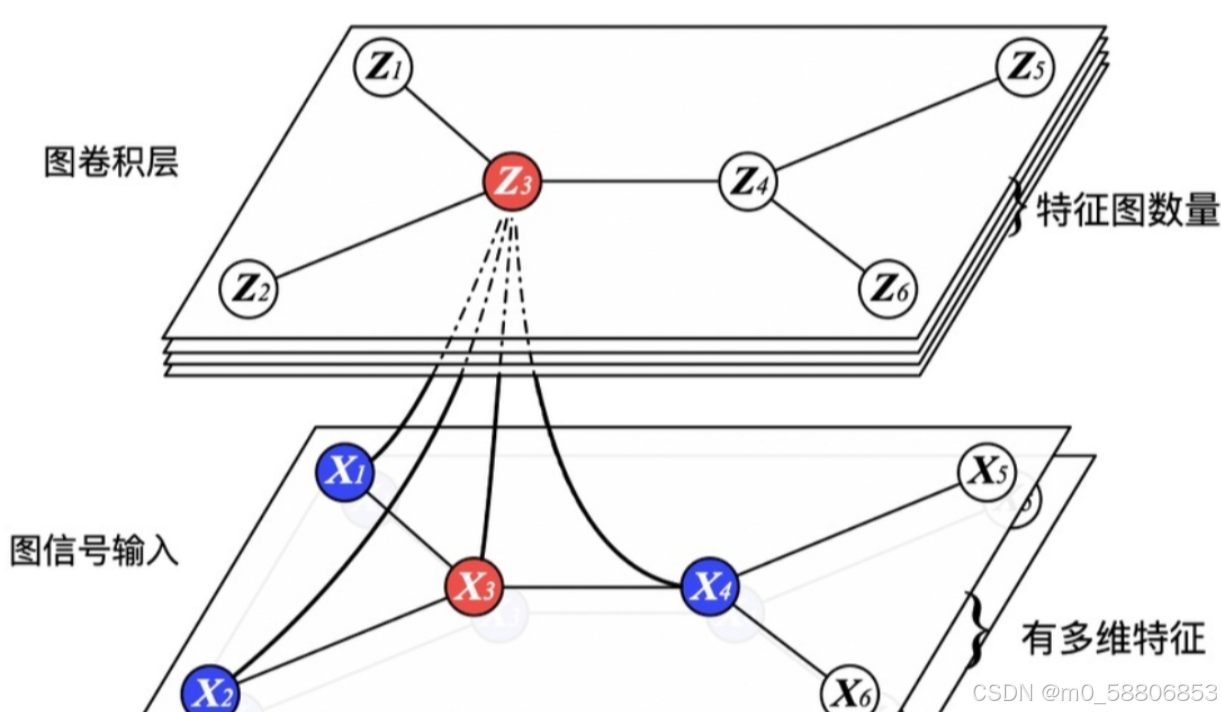

GCN也是一个神经网络层,这里的权重是所有节点共享的,类比于CNN中的参数共享;另外可以将节点的邻居节点看成感受野,随着网络层数的增加,感受野越来越大,即节点的特征融合了更多节点的信息。直观的图卷积示意图如下:

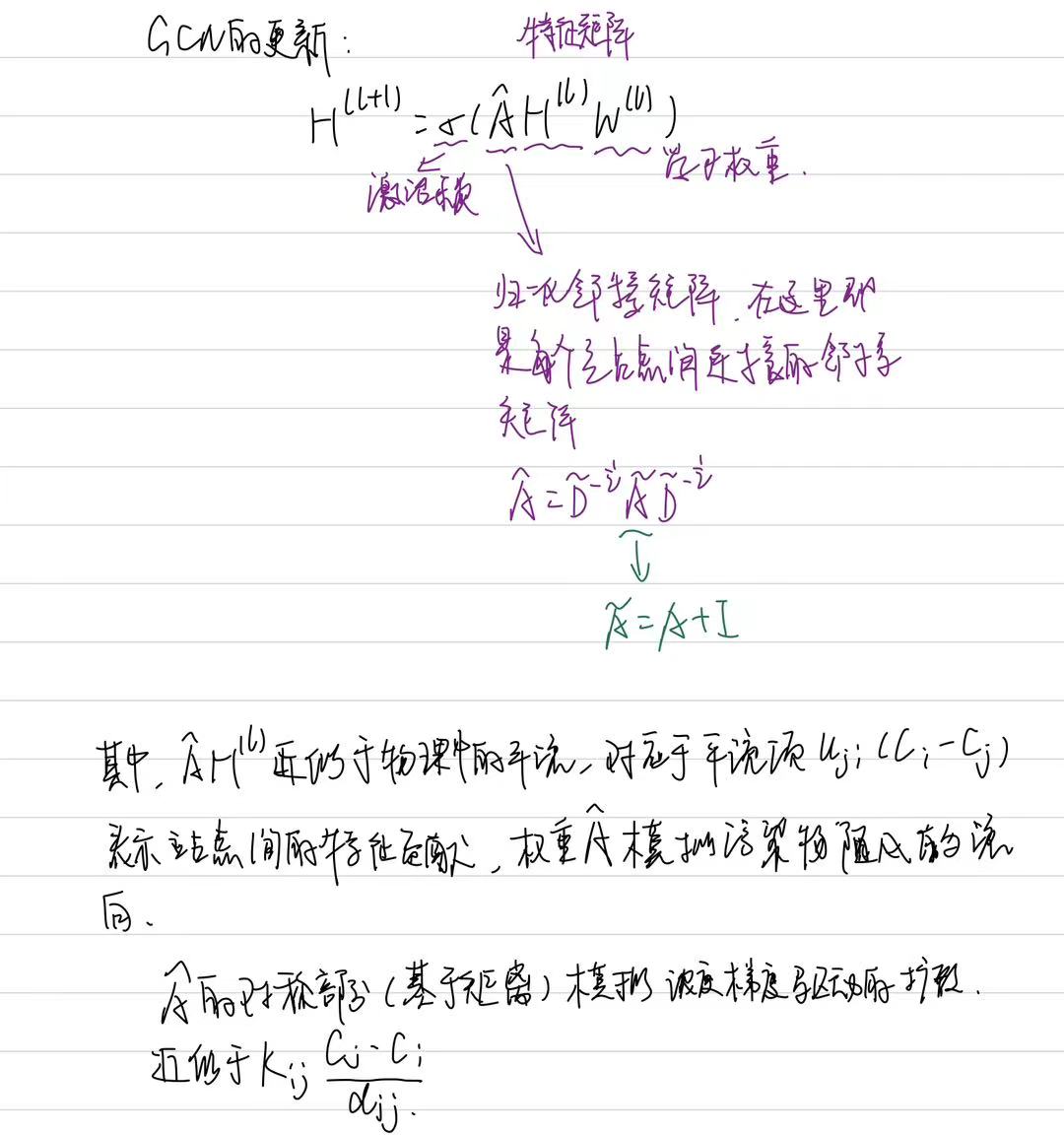

每一层GCN的输入都是邻接矩阵A和node的特征H,再乘一个参数矩阵W,然后激活一下,这就相当于一个简单的神经网络层。

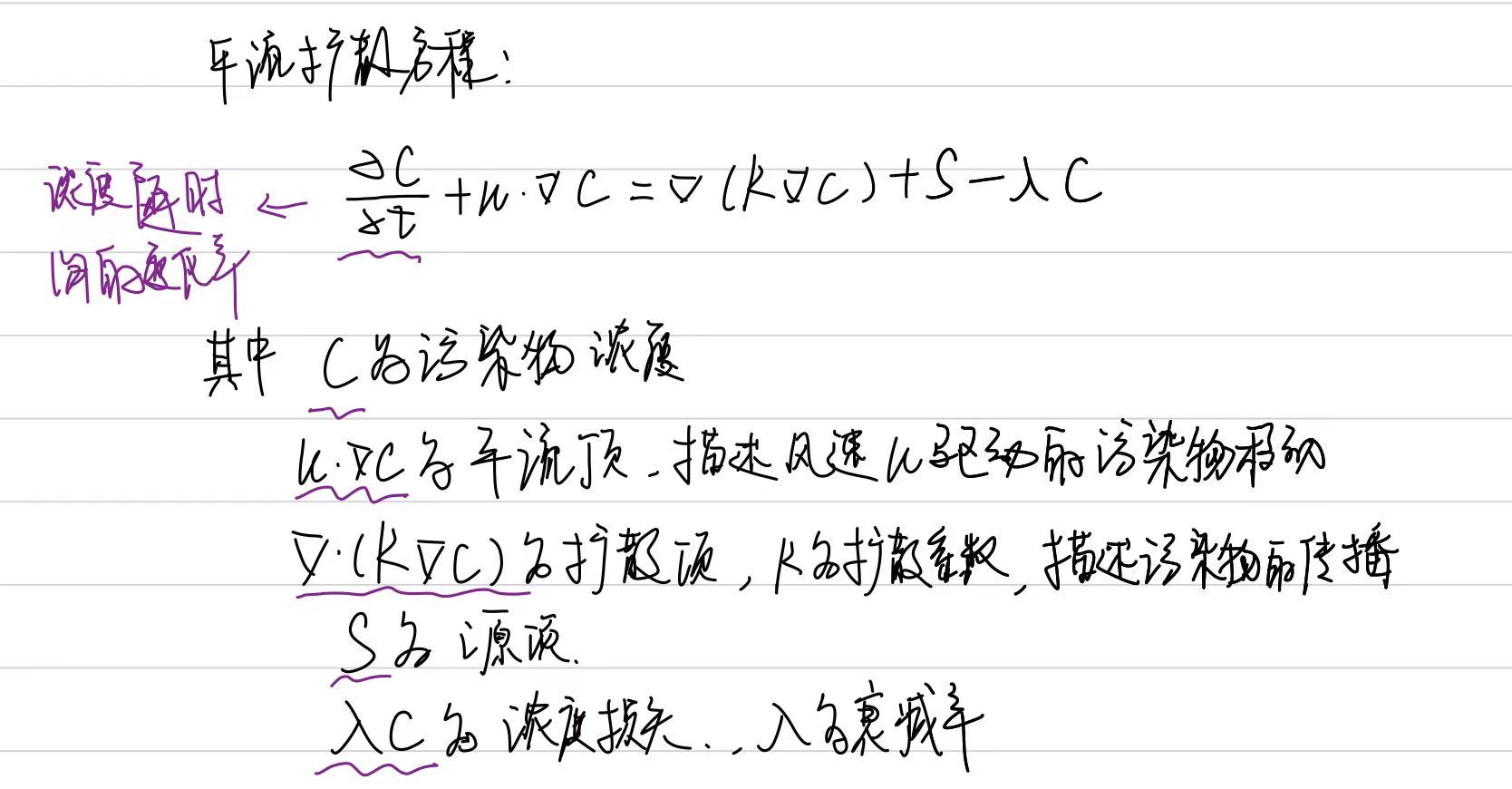

2 平流-扩散方程

污染扩散的物理过程通常由平流-扩散方程(Advection-Diffusion Equation)描述:

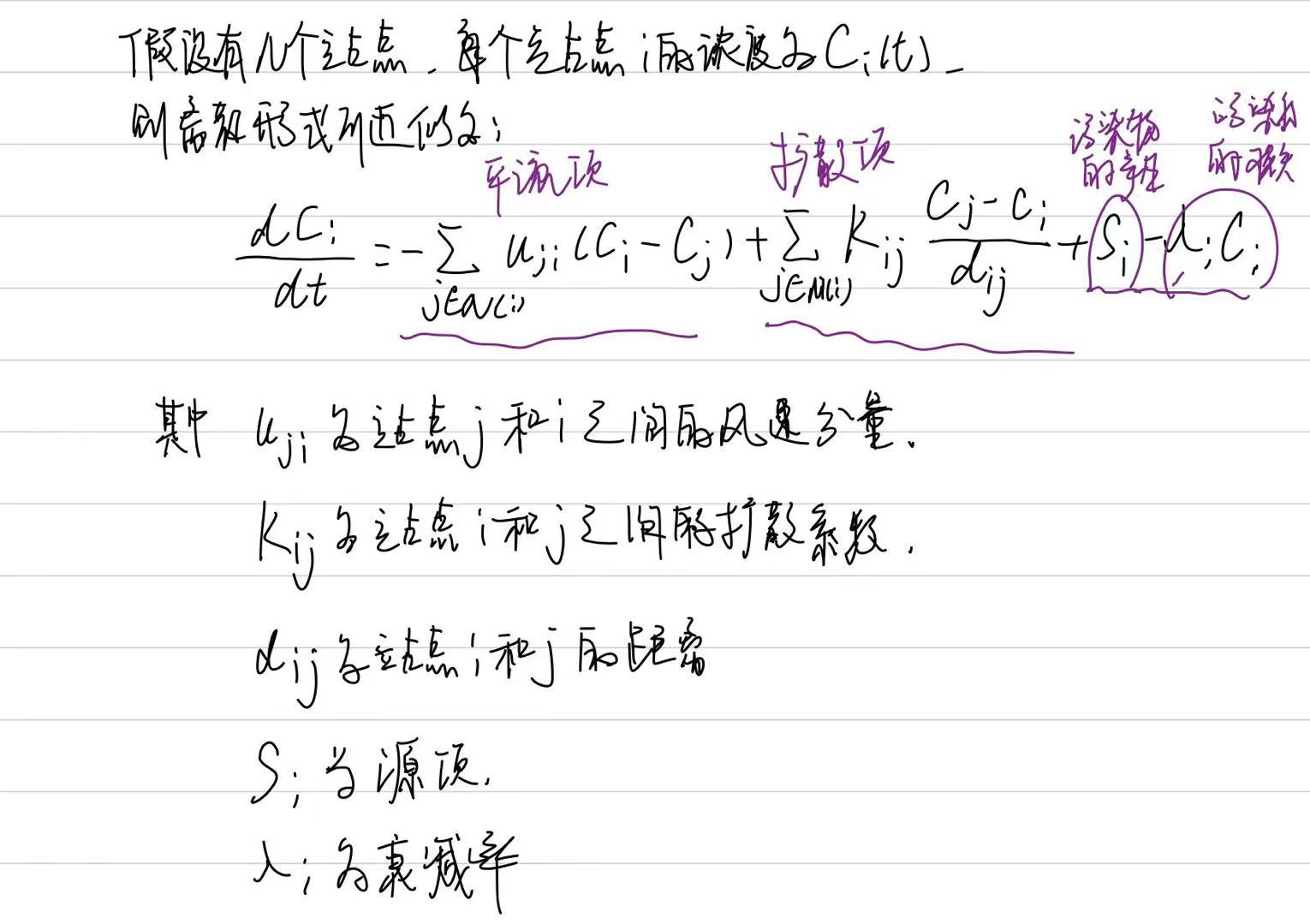

在实际应用中,空气质量监测站点是离散的,连续的平流-扩散方程需要离散化处理:

GCN通过图结构和卷积操作近似上述平流-扩散过程,首先进行图结构的建模,每个监测站点表示一个节点,使用邻接矩阵定义定义站点间的关系,其中邻接矩阵的权重可以基于包括风速和风向在内的平流以及距离的倒数进行分配,权重的更新过程如下:

在污染扩散预测中,GCN能有效捕捉监测站点间的空间依赖关系,模拟污染物随风、距离等因素的传播过程。相比传统方法,GCN通过图结构建模非规则站点分布,聚合邻居信息,结合气象和污染物数据,提高预测精度,特别适合动态、复杂的扩散场景。