记录一次win11本地部署deepseek的过程

20250518 win11 docker安装部署 ollama安装 ragflow部署 deepseek部署

文章目录

- 1 部署Ollama

- 下载安装ollama

- 配置环境变量

- 通过ollama下载模型deepseek-r1:7b

- 2 部署docker

- 2.1 官网下载amd版本安装

- 2.2 配置wsl

- 2.3 Docker配置:位置+代理+镜像源

- 3 部署RAGFlow

- 更换ragflow环境文件配置 运行

- 浏览器登录localhost:80,进入RAGFlow页面自己注册

- 4 部署deepseek (即添加Ollama模型)

- 模型设置

- 增加并解析知识库

- 新增数据集

- 新增助理

1 部署Ollama

下载安装ollama

官网https://ollama.com/

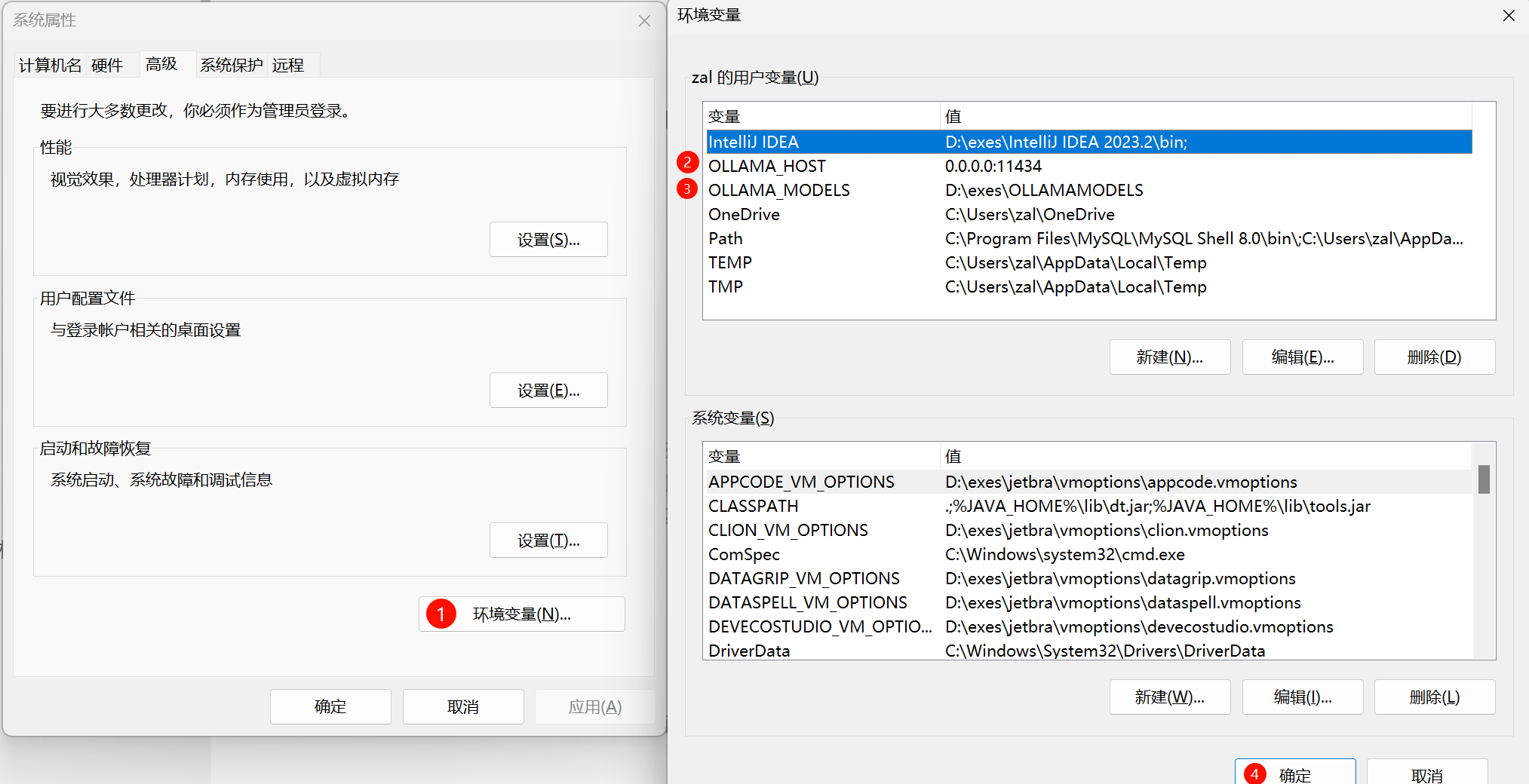

配置环境变量

win电脑打开【设置】【系统】【高级系统设置】 后面那个是ollama自定义的模型存放位置自己选就行,配置好仓库自定义位置后必须重启电脑

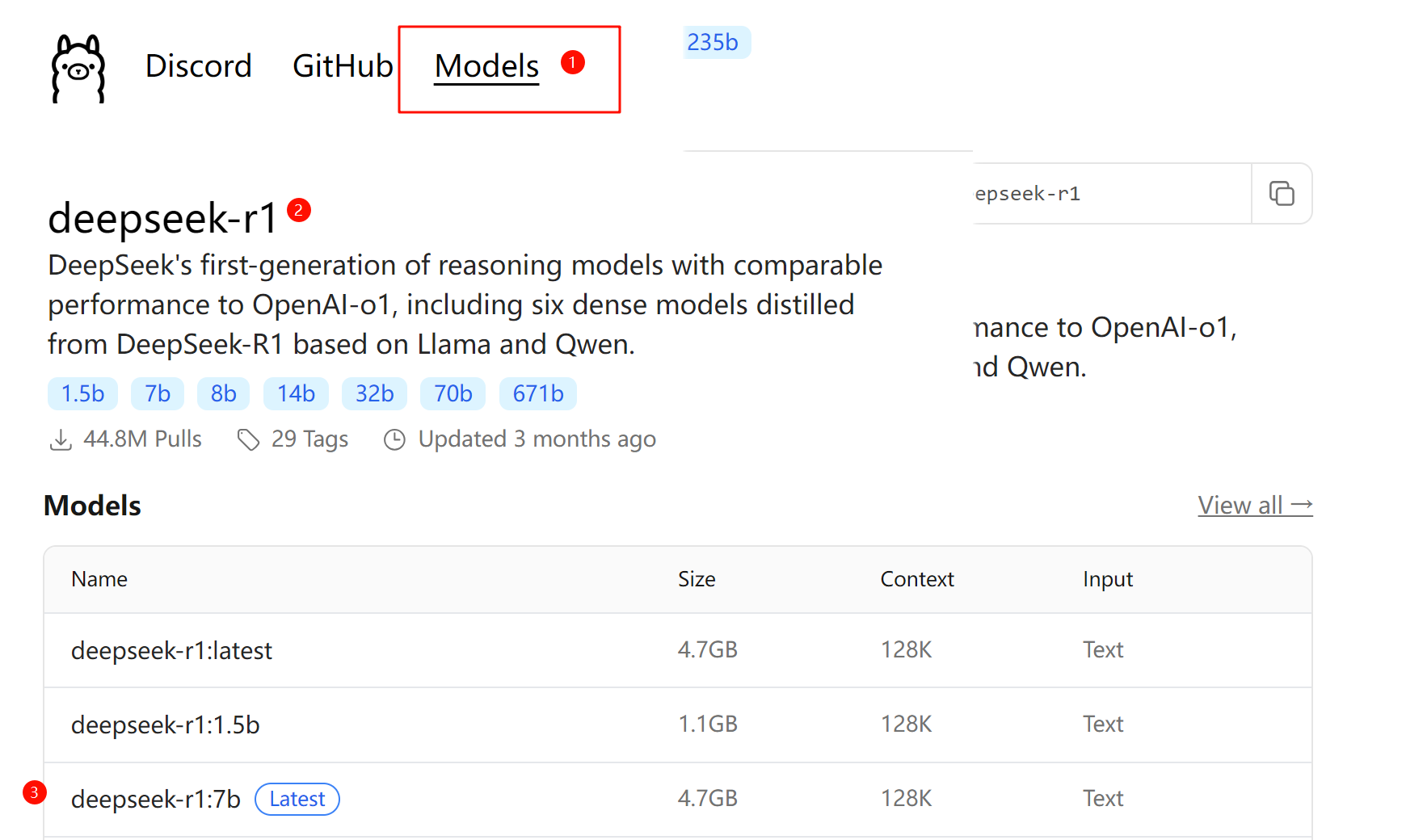

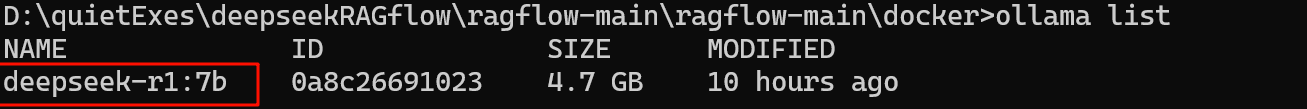

通过ollama下载模型deepseek-r1:7b

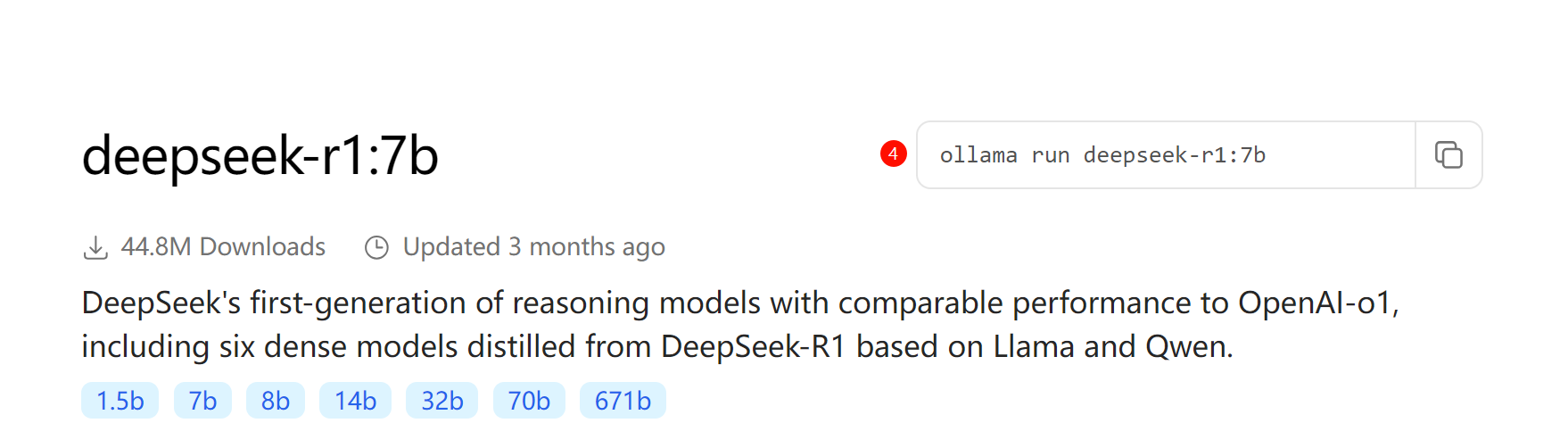

4个页面跳转 我拼图了一下方便看

最后打开电脑cmd输入复制来的命令行ollama run deepseek-r1:7b 随便发个信息 有回复就可以了 去下一步

2 部署docker

2.1 官网下载amd版本安装

2.2 配置wsl

-

打开【控制面板】-【程序】- 【启用或关闭Windows功能】-勾选【适用于Linux的Windows子系统】【虚拟机平台】

勾这两个选项的原因:支持运行Linux发行版和以支持WSL2和Hyper-V

Hyper-V:勾选(Docker正常使用)取消勾选(Vmware正常使用) -

管理员身份打开power shell,输入命令

wsl --install

wsl --set-default-version 2

我的电脑在部署虚拟机时已经安装过所以第一个命令返回已安装。卡在第二个命令,以下是解决方法,没有报错就可以跳过

PS C:\Windows\system32> wsl --install

适用于 Linux 的 Windows 子系统已安装。以下是可安装的有效分发的列表。

请使用“wsl --install -d <分发>”安装。

PS C:\Windows\system32> wsl --set-default-version 2

请启用虚拟机平台 Windows 功能并确保在 BIOS 中启用虚拟化。

有关信息,请访问 https://aka.ms/enablevirtualization

检查 BIOS/UEFI 中的虚拟化(VT-x/AMD-V)是否已启用

重启电脑,在启动时进入 BIOS/UEFI(通常按 F2、F10、Del 或 Esc)。

找到 虚拟化(Virtualization) 相关选项(可能在 Advanced、CPU Configuration 或 Security 菜单下)

Intel CPU:查找 Intel VT-x(或 Intel Virtualization Technology)。

AMD CPU:查找 SVM Mode(或 AMD-V)。

启用 该选项,保存并退出(通常是 F10)。

在 Windows 中启用 “虚拟机平台” 功能

以管理员身份打开 PowerShell(右键 → 以管理员身份运行):

powershell

dism.exe /online /enable-feature /featurename:VirtualMachinePlatform /all /norestart

dism.exe /online /enable-feature /featurename:Microsoft-Windows-Subsystem-Linux /all /norestart

重启电脑

设置 WSL 2 为默认版本

重新运行:

powershell

wsl --set-default-version 2

PS C:\Windows\system32> wsl --set-default-version 2

有关与 WSL 2 的主要区别的信息,请访问 https://aka.ms/wsl2

操作成功完成。

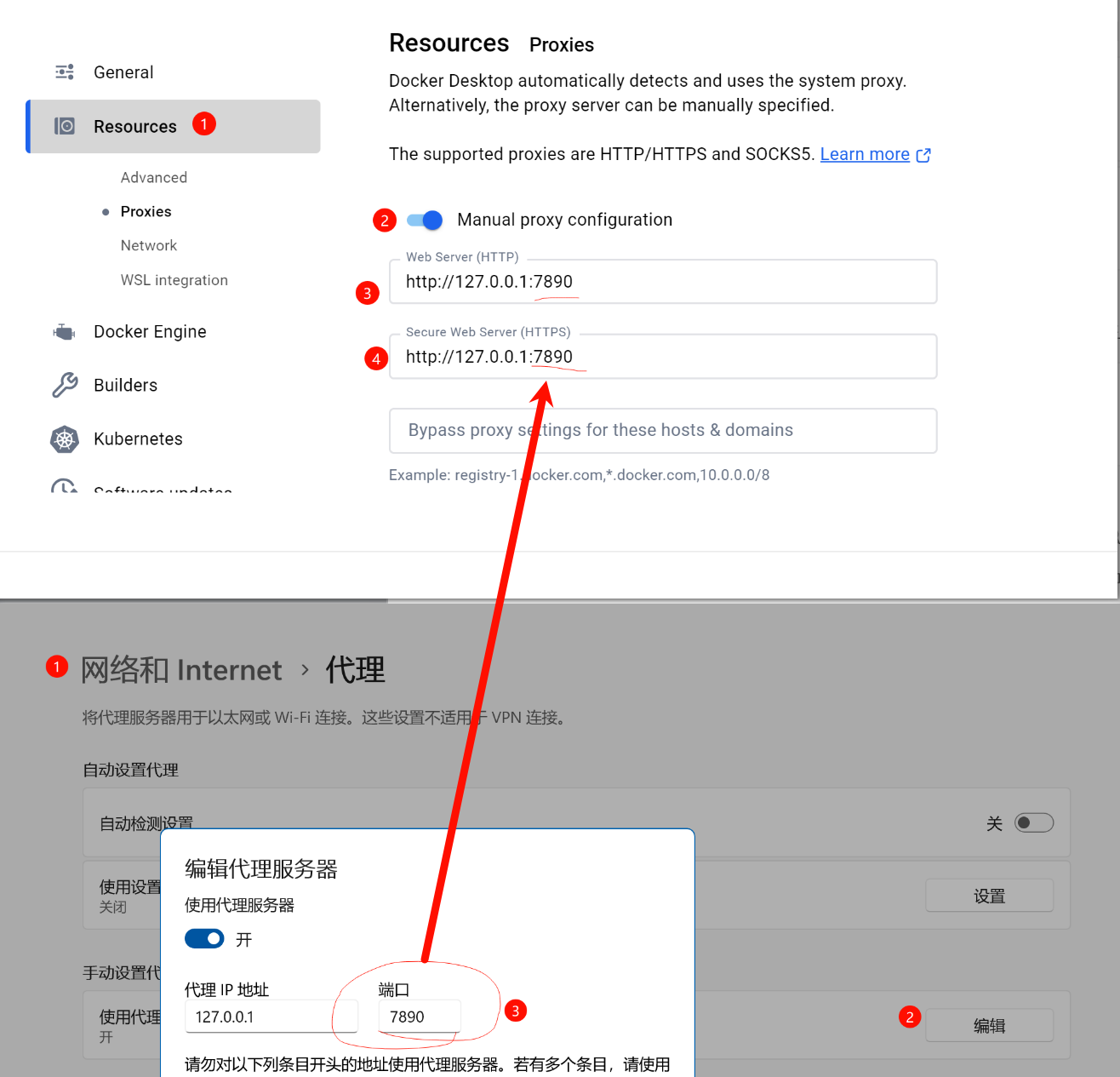

2.3 Docker配置:位置+代理+镜像源

- 命令行验证docker

C:\Users\zal>docker --version

Docker version 28.0.4, build b8034c0

- 修改存镜像的位置不要放c盘

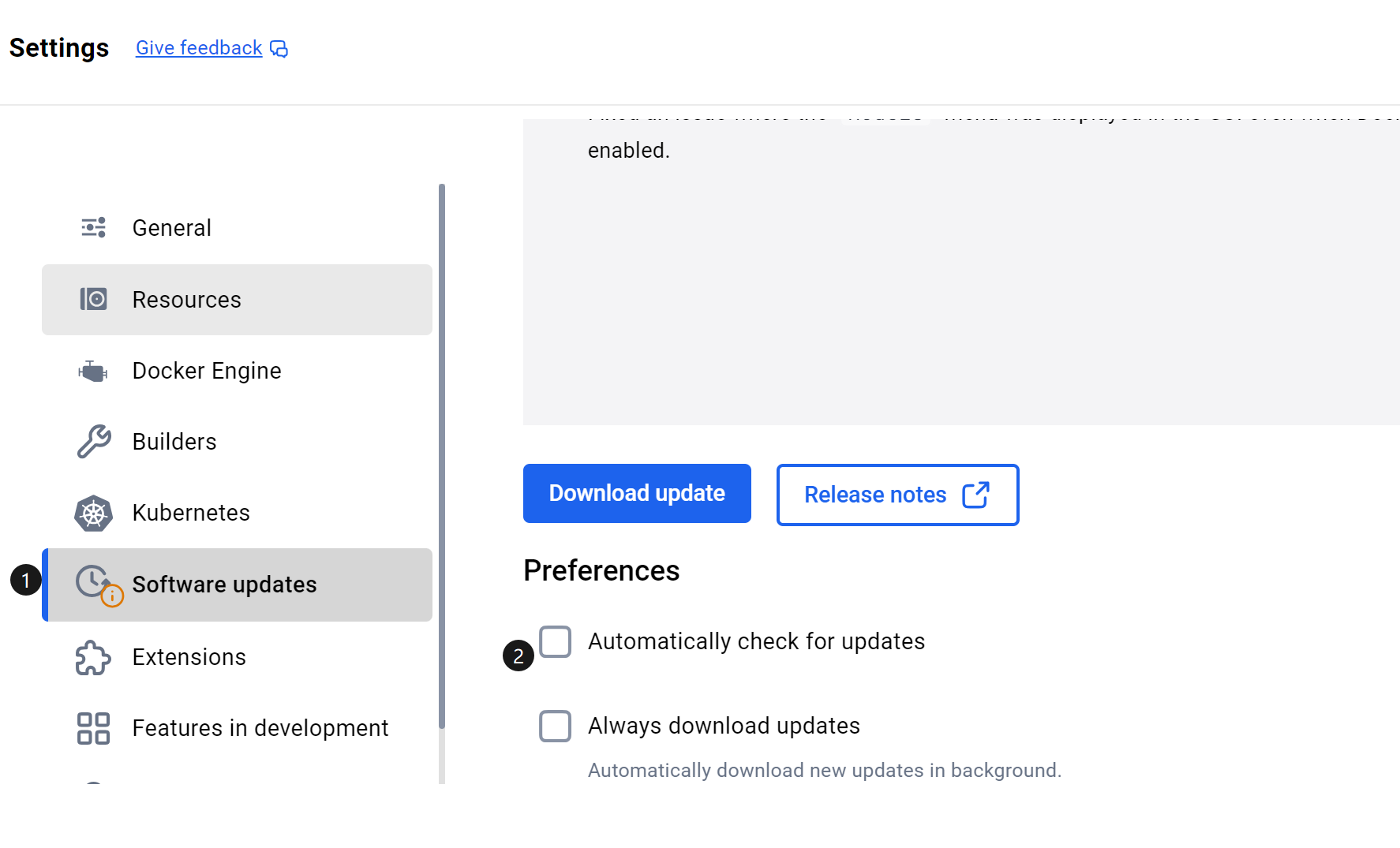

在这里插入图片描述 - 关下自动更新

- 应用设置

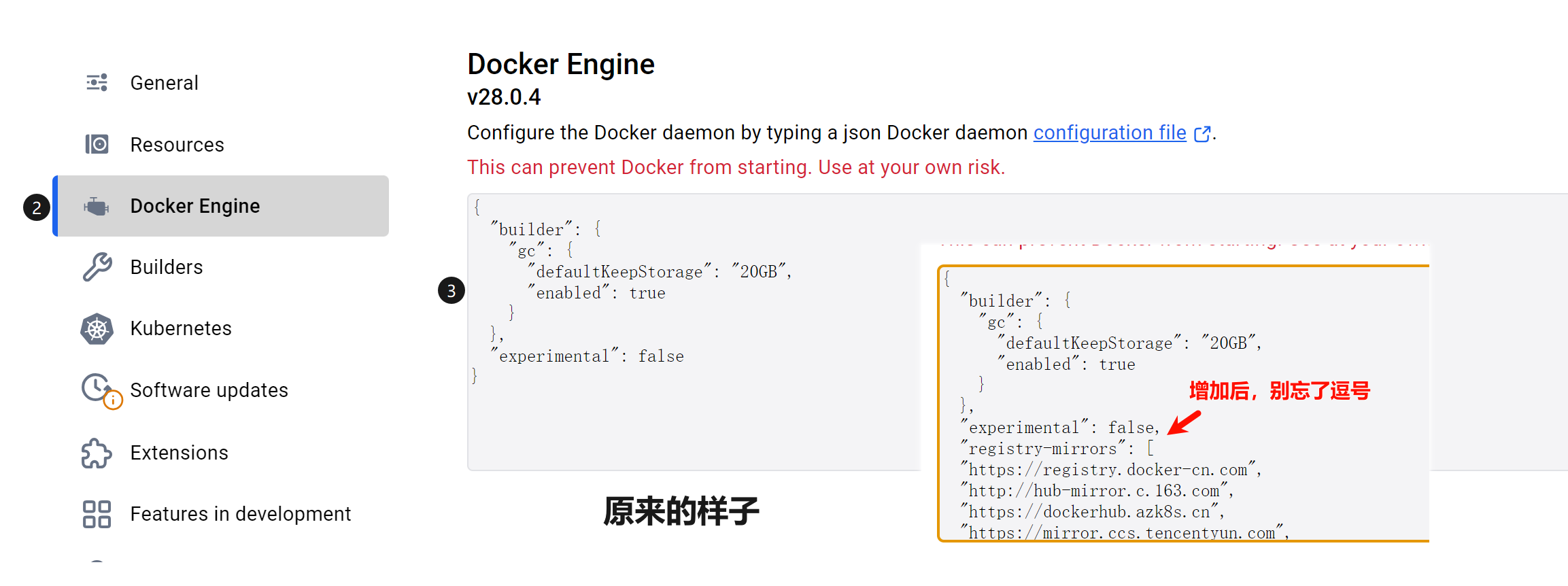

- 重新打开设置,增加镜像源

"registry-mirrors": ["https://registry.docker-cn.com","http://hub-mirror.c.163.com","https://dockerhub.azk8s.cn","https://mirror.ccs.tencentyun.com","https://registry.cn-hangzhou.aliyuncs.com","https://docker.mirrors.ustc.edu.cn","https://docker.m.daocloud.io", "https://noohub.ru", "https://huecker.io","https://dockerhub.timeweb.cloud" ]

以后如果有失效的,去github的维护网站找到可用的给它们放进去就可以

https://github.com/DaoCloud/public-image-mirro

镜像实在不行开魔法

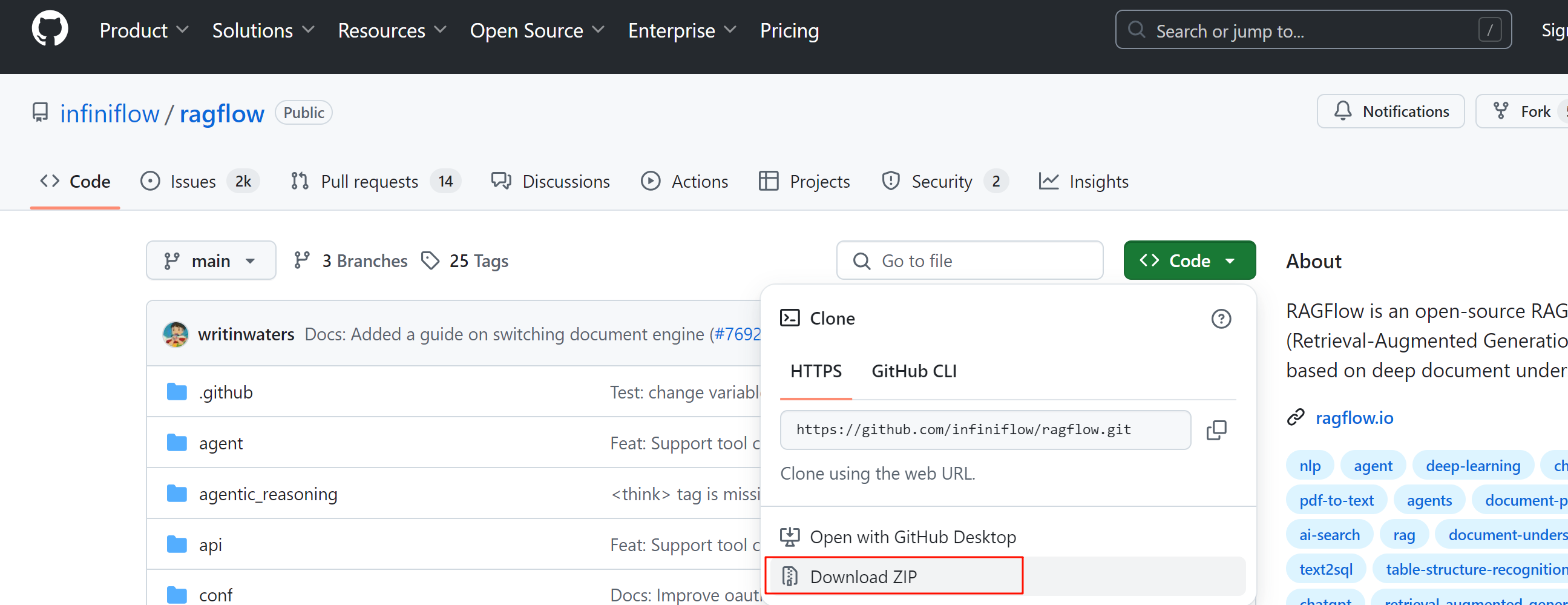

3 部署RAGFlow

进官网github文档 https://github.com/infiniflow/ragflow/blob/main/README_zh.md

下载并解压到本地

更换ragflow环境文件配置 运行

打开目录,在文件资源管理器上方D:\quietExes\deepseekRAGflow\ragflow-main\ragflow-main\docker目录里输入cmd 执行命令

$ docker compose -f docker-compose.yml up -d

拉取之后(long long time…直接出门玩!)

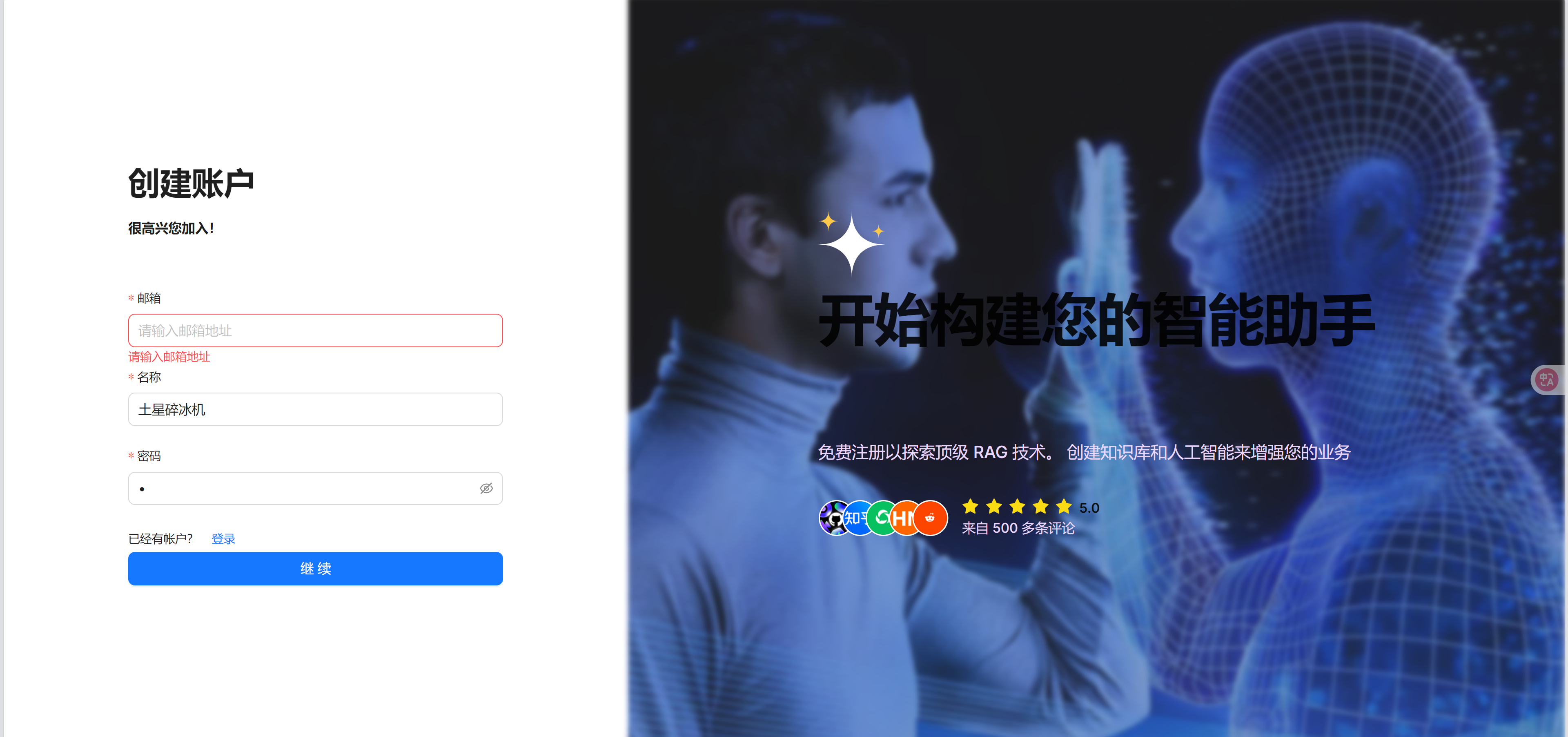

浏览器登录localhost:80,进入RAGFlow页面自己注册

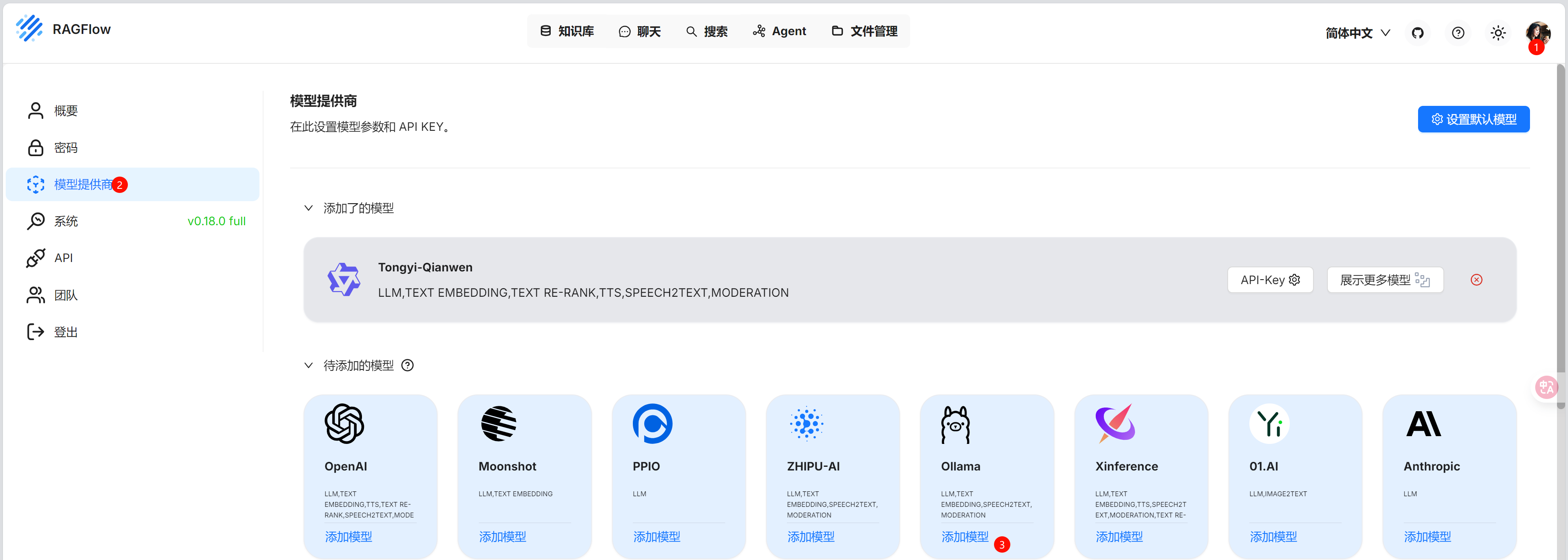

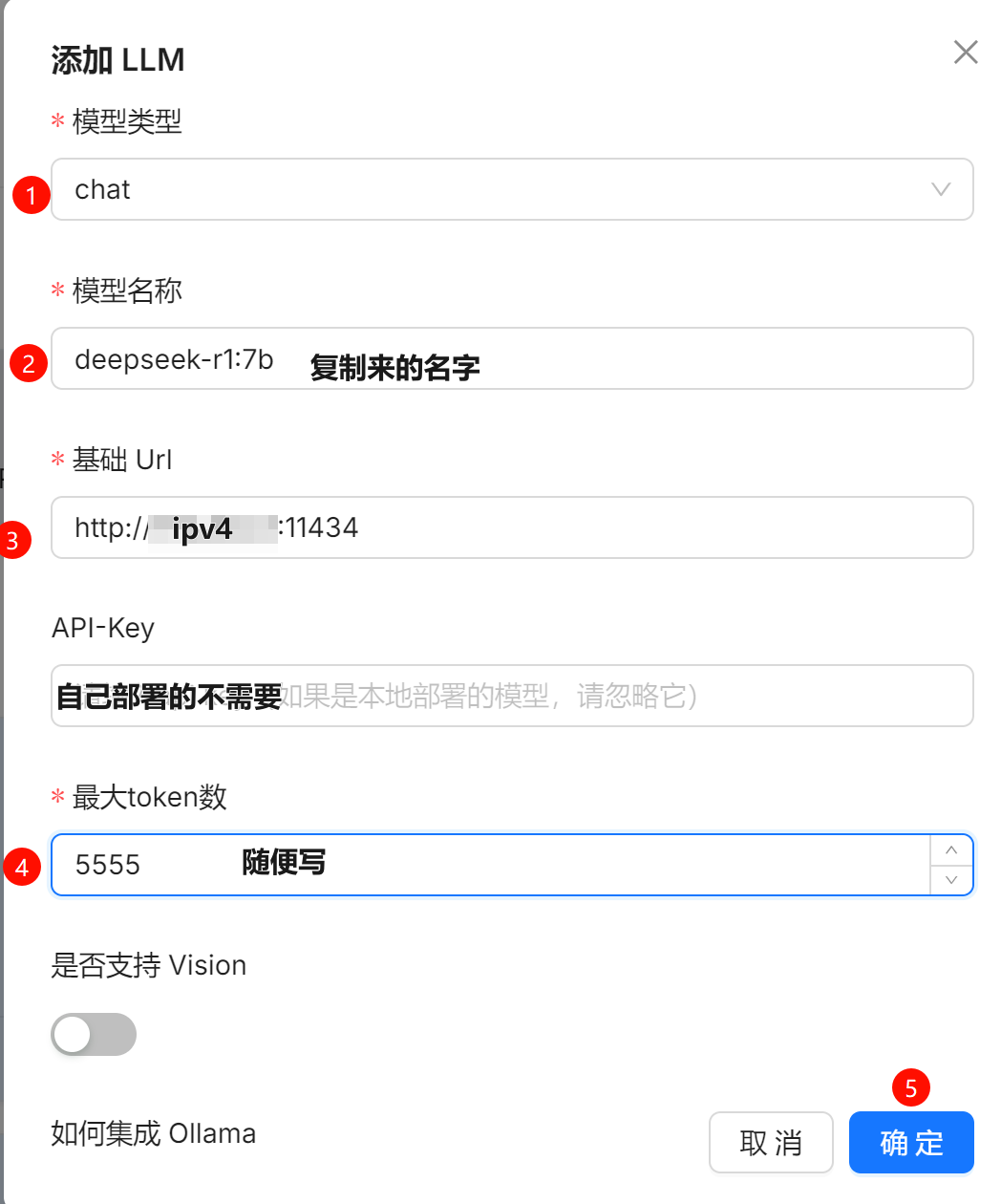

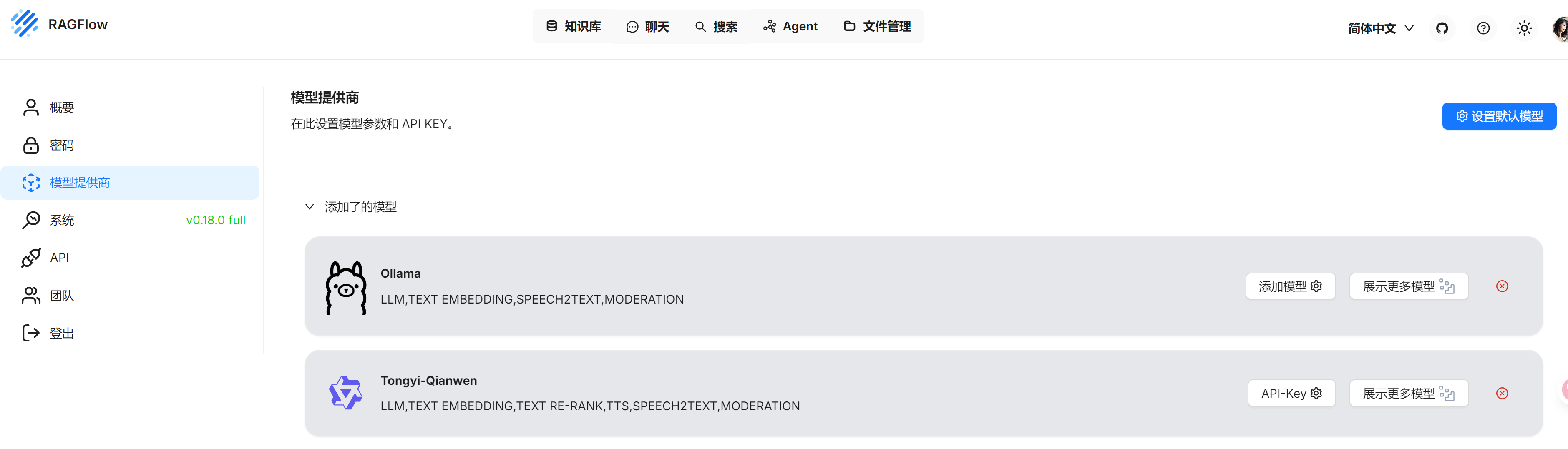

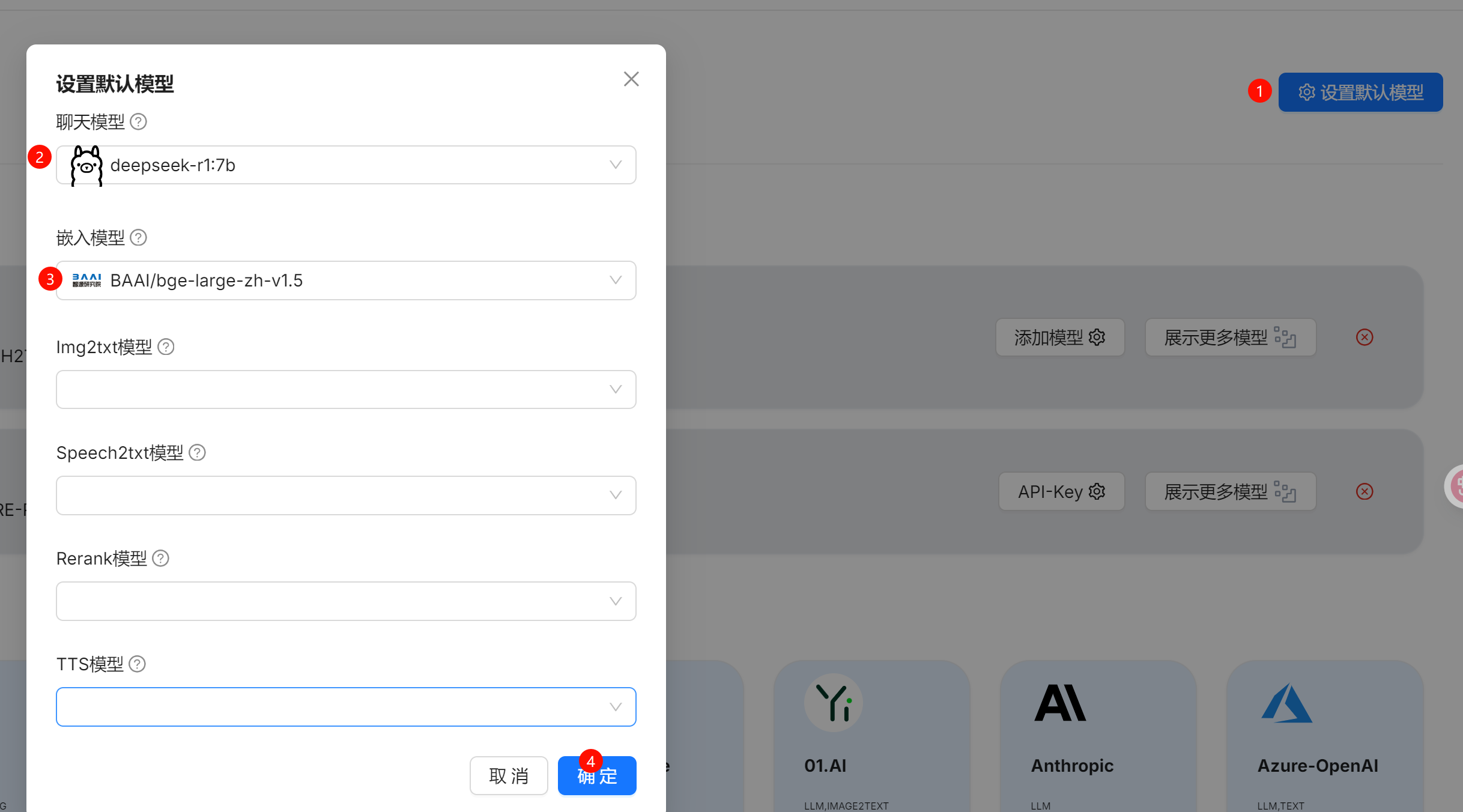

4 部署deepseek (即添加Ollama模型)

打开命令行输入ollama list复制名字到【模型名称】

命令行输入ipconfig复制ipv4地址到【基础URL】

此时本地部署deepseek已经成功,RAGFlow也可以访问到它

模型设置

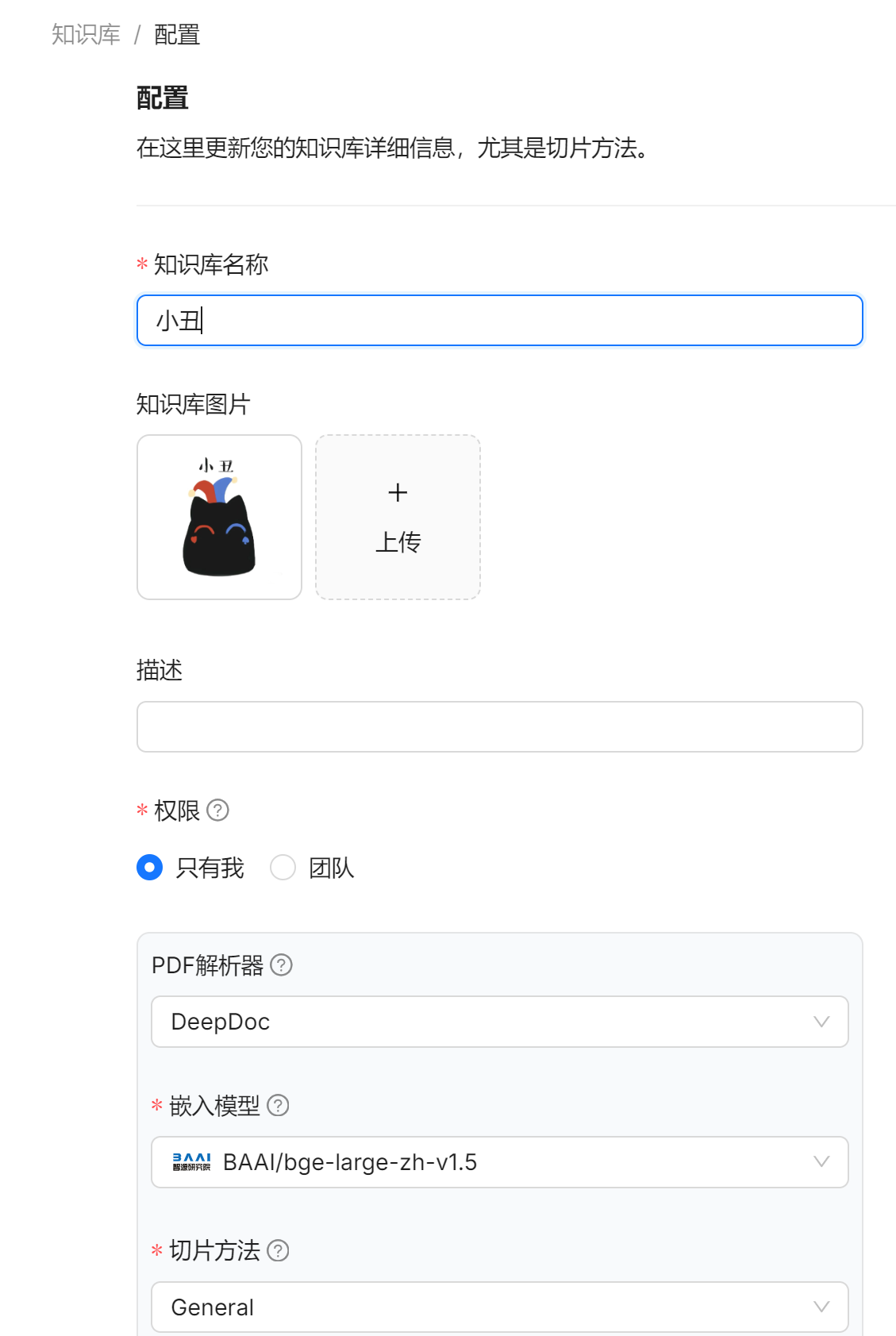

增加并解析知识库

回到首页点知识库创建 写个名字和图片其他不用改点确定

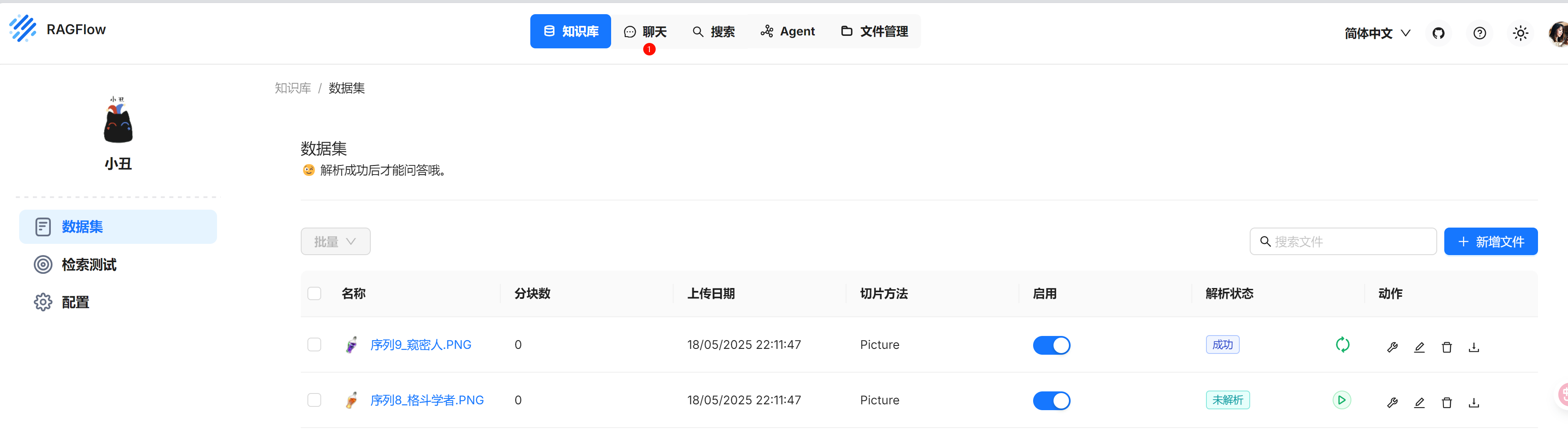

新增数据集

点数据集勾选解析

点按钮开始解析 会将文件中段落提取出来进行embdding映射到高维向量

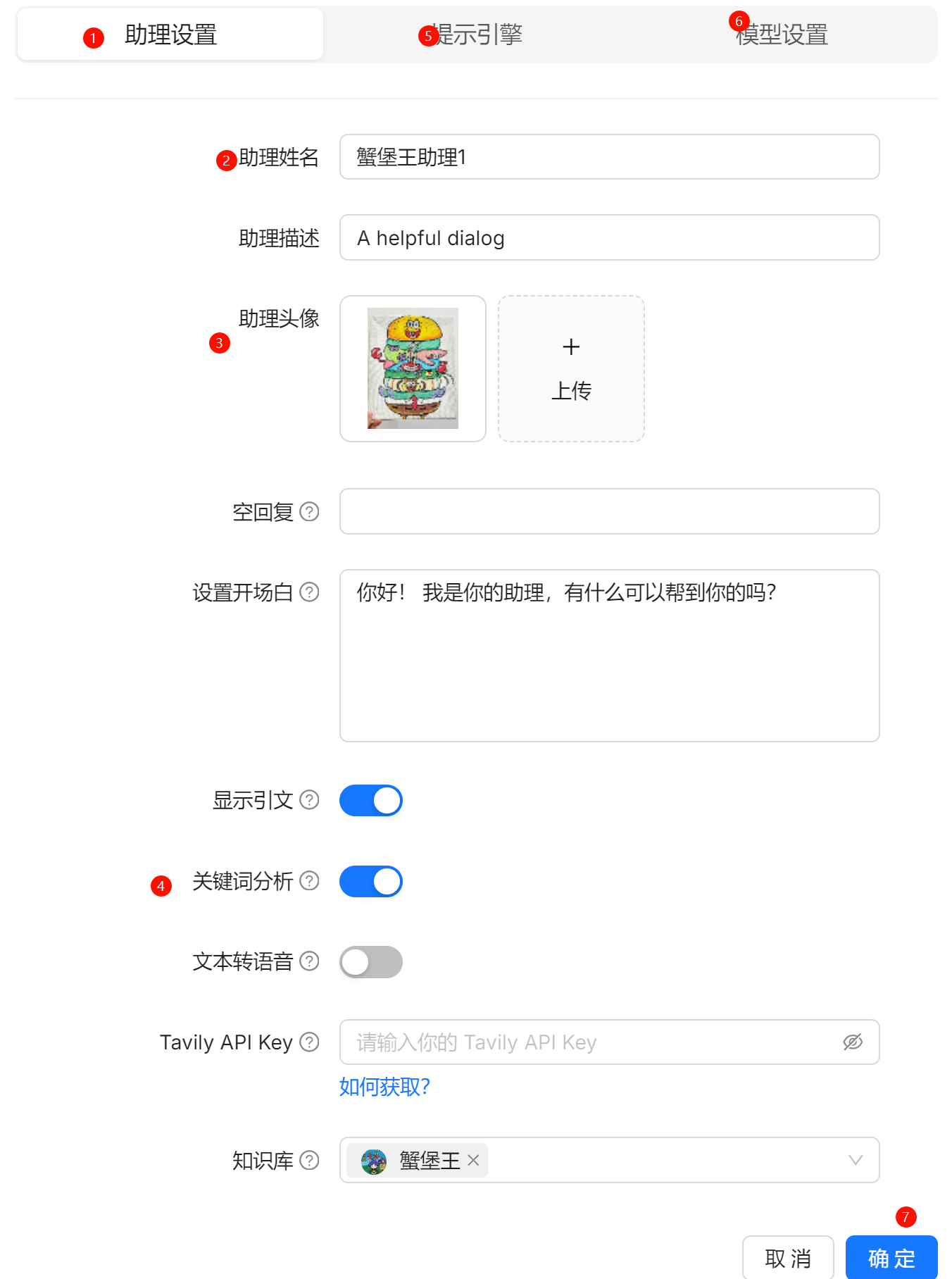

新增助理

解析成功后进入聊天 新增助理 这里就要自己摸索了

提问

OK.