YOLO目标检测算法

文章目录

- 前言

- 一、目标检测算法简介

- 1、传统目标检测算法

- (1)R-CNN算法简介

- (2)Fast R-CNN算法简介

- (3)Faster R-CNN算法简介

- 2、目标检测中的算法设计范式

- (1)one-stage

- (2)two-stage

- (3)one-stage和two-stage核心区别对比

- 3、目标检测算法的选择与应用

- (1)根据需求选择合适的算法

- (2)目标检测的应用领域

- 总结

前言

YOLO(You Only Look Once)是一种基于深度学习的目标检测算法,由Joseph Redmon等人于2016年提出。它的核心思想是将目标检测问题转化为一个回归问题,通过一个神经网络直接预测目标的类别和位置。YOLO算法将输入图像分成SxS个网格,每个网格负责预测该网格内是否存在目标以及目标的类别和位置信息。此外,YOLO算法还采用了多尺度特征融合的技术,使得算法能够在不同尺度下对目标进行检测。

一、目标检测算法简介

1、传统目标检测算法

(1)R-CNN算法简介

R-CNN(Region-based Convolutional Neural Network)是一种经典的传统目标检测算法,其核心思想是通过两阶段流程实现目标检测:

第一,候选区域生成。使用传统方法(如Selective Search)从图像中提取约2000个可能包含物体的候选区域(Region Proposal),这些区域作为后续处理的候选框。

第二,特征提取与分类。对每个候选区域进行归一化后,输入卷积神经网络(CNN)提取特征,再利用分类器(如SVM)判断候选框内物体的类别,并通过回归算法修正边界框的位置。

核心创新在于将深度学习引入目标检测,用CNN自动学习特征替代传统手工设计特征(如HOG、SIFT),显著提升了检测精度。但因其需对每个候选区域单独处理,计算冗余大,效率较低,为后续算法(如Fast R-CNN、Faster R-CNN)的优化奠定了基础。

(2)Fast R-CNN算法简介

Fast R-CNN 是R-CNN的改进版本,核心思想是通过特征共享和端到端训练解决原始R-CNN的计算效率问题。其核心创新如下:

第一,整图特征提取。直接对整张图像进行一次卷积神经网络(CNN)特征提取,避免对每个候选区域重复计算,大幅减少冗余。

第二,ROI Pooling(感兴趣区域池化)。将不同尺寸的候选区域(Region Proposal)映射到CNN输出的特征图上,并通过池化操作统一为固定尺寸的特征,支持批量处理。

第三,多任务联合训练。将分类(Softmax)和边界框回归(Bounding Box Regression)合并到同一网络中,通过端到端训练同步优化,简化流程并提升精度。

核心优势:相比R-CNN,Fast R-CNN速度提升约10倍(训练快9倍,检测快213倍),同时检测精度更高,为后续Faster R-CNN的提出奠定了基础。

(3)Faster R-CNN算法简介

Faster R-CNN 是两阶段目标检测算法的里程碑,其核心思想是通过区域提议网络(RPN) 实现候选区域生成与目标检测的端到端统一,彻底解决传统候选区域方法的效率瓶颈。关键创新如下:

第一,区域提议网络(RPN)。在卷积特征图上滑动窗口,利用锚点(Anchors)(预设多尺度/宽高比的参考框)预测候选区域。每个锚点同时输出物体概率和边界框偏移量,动态生成高质量候选框,替代传统Selective Search方法,速度提升10倍以上。

第二,共享卷积特征。RPN与检测网络(Fast R-CNN)共享同一骨干网络(如VGG、ResNet)提取的特征,避免重复计算,显著降低计算成本。

第三,端到端联合训练。将RPN(候选框生成)与检测网络(分类+回归)整合为单一模型,通过多任务损失函数同步优化,提升精度与效率。

核心优势:

候选区域生成与检测全流程实现深度学习化,检测速度达5-17 FPS(接近实时),且精度保持领先(如PASCAL VOC mAP约78.8%)。

奠定现代两阶段检测框架基础,后续扩展至Mask R-CNN等复杂任务。

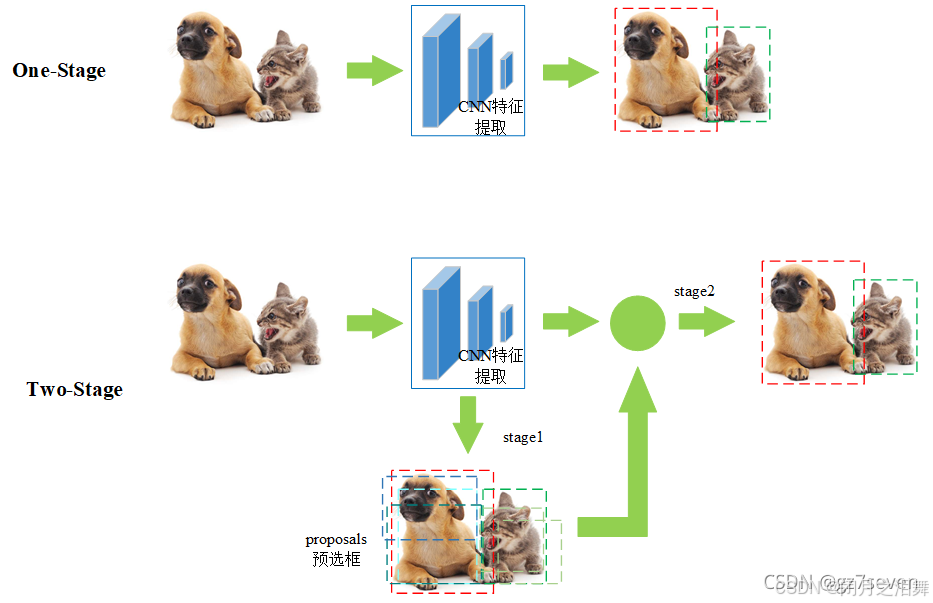

2、目标检测中的算法设计范式

(1)one-stage

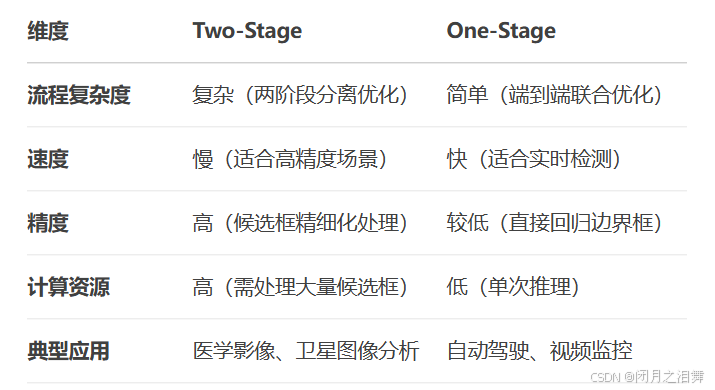

将目标检测视为端到端回归问题,直接通过单次网络推理输出物体的类别和位置,无需显式生成候选区域。代表算法:YOLO系列、SSD、RetinaNet。

优缺点:

速度快:单次推理即可完成检测(如YOLOv8可达160+ FPS)。

精度相对较低:直接回归边界框,易漏检小目标或密集物体。

YOLO算法具有更快的检测速度和更高的准确率。这得益于其端到端训练方式和单阶段检测的特性,使其可以同时处理分类和定位任务,避免了传统方法中的多阶段处理过程。因此,YOLO算法广泛应用于实时目标检测和自动驾驶等领域。

(2)two-stage

两阶段目标检测器是一种先生成候选框,然后对候选框进行分类和回归的检测方法。这种方法主要包括两个阶段:

第一阶段:生成候选框。这通常通过一个类似于Selective Search或EdgeBoxes等区域提名算法来实现,该算法从输入图像中生成多个候选框。每个候选框都会经过一个CNN模型进行特征提取,然后通过分类器进行过滤,保留与目标物体更相似的候选框。

第二阶段:在保留的候选框上进行精细的分类和回归。这个阶段通常使用另一个CNN模型或类似SVM的分类器来进行分类和回归。对于每个候选框,可能需要预测物体的类别、位置和大小等。

代表性的两阶段目标检测器包括R-CNN系列,以及其改进版本Fast R-CNN、Faster R-CNN和Mask R-CNN等。

优缺点:

高精度:候选框经过筛选和细化,对小目标和密集物体检测效果更好。

速度较慢:两阶段流程计算成本较高(如Faster R-CNN约5-7 FPS)。

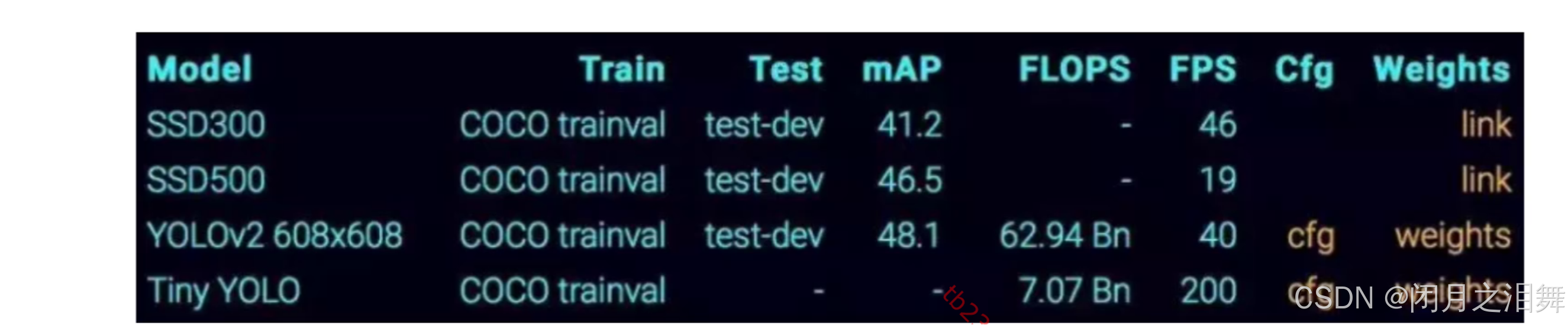

FLOPs表示模型进行一次前向传播(即处理一张图像)所需要的浮点运算次数。它是一个衡量算法效率的关键指标,与模型的计算量和推断速度密切相关。

FPS:每秒可以处理的图像数量

(3)one-stage和two-stage核心区别对比

3、目标检测算法的选择与应用

(1)根据需求选择合适的算法

实时性需求(如自动驾驶):选择轻量级单阶段算法(YOLO系列、MobileNet-SSD)。

高精度需求(如医疗影像):采用两阶段算法(Faster R-CNN、Cascade R-CNN)或结合注意力机制。

复杂场景(密集小目标):引入多尺度预测(FPN)或Transformer结构(如DETR)。

(2)目标检测的应用领域

-

自动驾驶与智能交通

车辆与行人检测:实时检测道路上的车辆、行人、交通标志(如YOLO、Faster R-CNN),辅助自动驾驶系统避障和路径规划。

交通监控:统计车流量、识别违规行为(如闯红灯、逆行),优化交通管理。

特斯拉Autopilot使用目标检测识别周围环境。 -

安防与视频监控

入侵检测:识别监控画面中的异常人员或物体(如YOLOv8),触发报警。人脸与行为分析:结合目标跟踪技术,监测特定人员或可疑动作(如打架、跌 倒)。机场、银行等场所的智能安防系统。

-

工业与制造业

缺陷检测:检测产品表面瑕疵(如裂纹、划痕),替代人工质检(常用高精度模型如Faster R-CNN)。机器人抓取:定位生产线上的零件位置,引导机械臂精准操作。电子元件制造中的自动化质检流水线。

总结

目标检测算法正推动各行业向智能化升级,其应用从日常生活(手机、零售)到高精领域(医疗、工业)无处不在。随着轻量化模型(如YOLOv8-Nano)和多模态融合(视觉+激光雷达)的发展,未来将在更多场景中实现更低成本、更高鲁棒性的落地应用。