谷歌 Gemma 大模型安装步骤

1.下载OllamaSetup安装包

下载地址:https://ollama.com/download

这里已Windows系统为例:

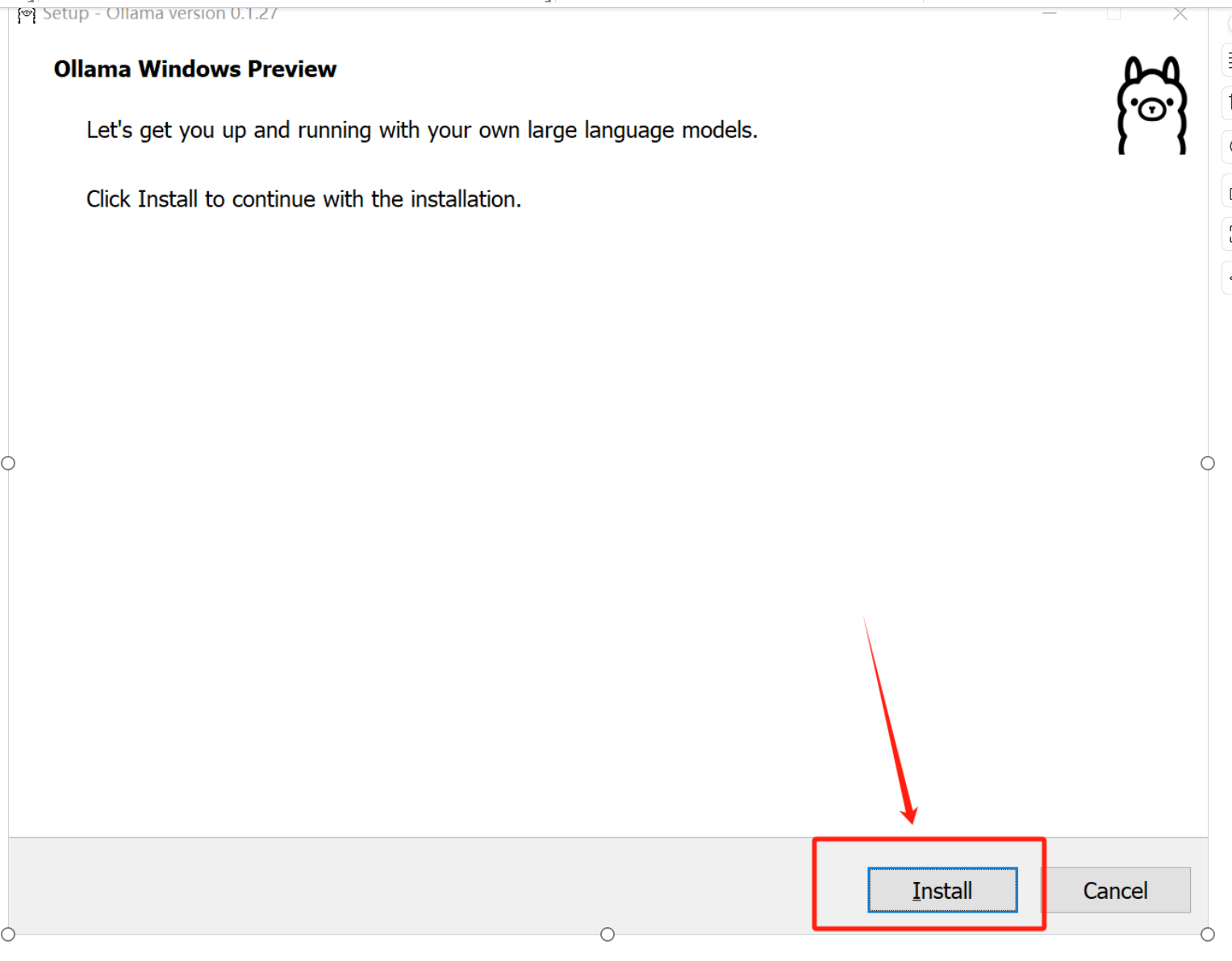

2.安装OllamaSetup客户端

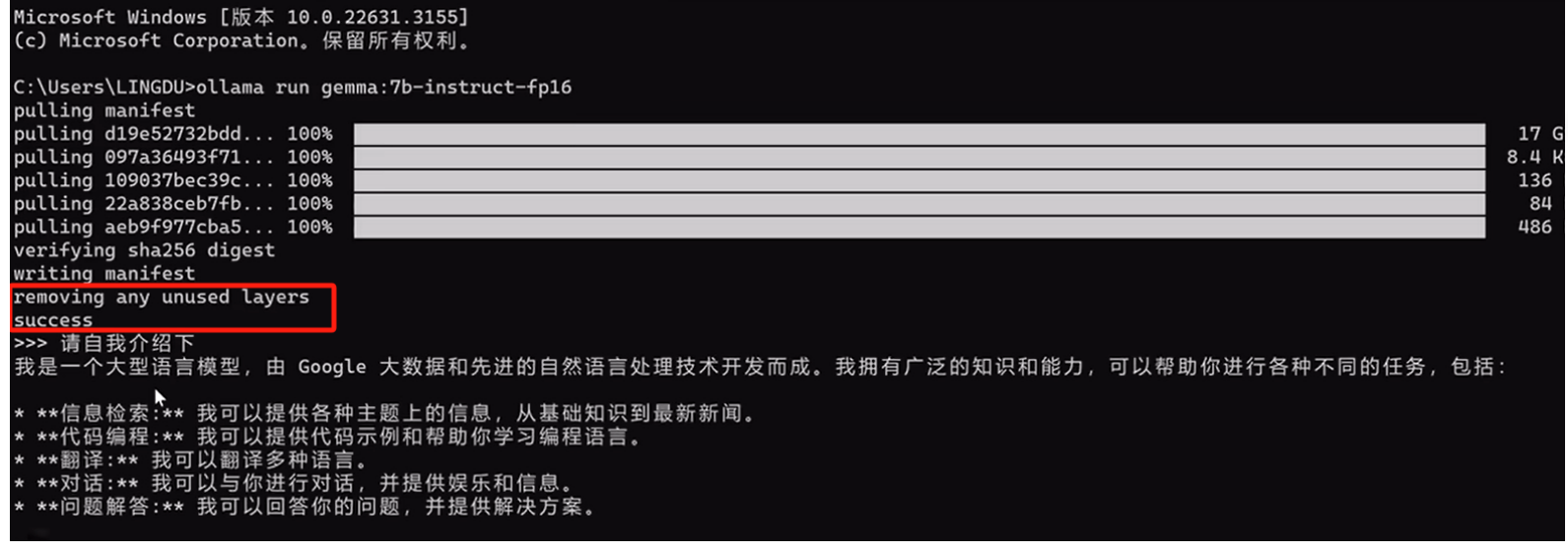

3.部署大模型

在系统搜索栏里面,搜索cmd并打开

根据电脑实际配置情况选择对应的模型进行安装

【1】. 普通7B版 安装指令:(适合8G显存)

执行命令:ollama run gemma:7b

如果你是第一次部署,它会自动下载!

【2】. 7B的全量版本:(需要16G左右的显存)

执行命令:ollama run gemma:7b-instruct-fp16

【3】. 2B轻量版:(适合CPU会低配电脑安装)

执行命令:ollama run gemma:2b

这里下载模型需要时间(请耐心等待)

等看到有以下提示后代表模型已经安装成功。

如果你需要下载谷歌 Gemma 开源大模型的文件,那么可以前往官网下载!

官网地址:http://ai.google.dev/gemma

4.加载 Gemma 模型 2B

from transformers import AutoTokenizer, AutoModelForCausalLM

import torchmodel_id = "google/gemma-2b-it" # 或 "google/gemma-7b-it"tokenizer = AutoTokenizer.from_pretrained(model_id)

model = AutoModelForCausalLM.from_pretrained(model_id, device_map="auto")# 推理

prompt = "你好,请介绍一下你自己。"

inputs = tokenizer(prompt, return_tensors="pt").to(model.device)

outputs = model.generate(**inputs, max_new_tokens=100)

print(tokenizer.decode(outputs[0], skip_special_tokens=True))5.测试和常见问题

无法加载模型?

请确保使用的是最新的 transformers

模型第一次加载需要联网从 Hugging Face 下载

可手动提前下载模型:

huggingface-cli download google/gemma-2b-it想要部署网页聊天界面?

推荐结合 Gradio:

pip install gradio实例代码

import gradio as grdef chat(prompt):inputs = tokenizer(prompt, return_tensors="pt").to(model.device)outputs = model.generate(**inputs, max_new_tokens=100)return tokenizer.decode(outputs[0], skip_special_tokens=True)gr.Interface(fn=chat, inputs="text", outputs="text").launch()