突破认知边界:神经符号AI的未来与元认知挑战

目录

一、神经符号AI的核心领域与研究方法

(一)知识表示:构建智能世界的语言

(二)学习与推理:让机器“思考”与“学习”

(三)可解释性与可信度:让AI更透明

(四)逻辑与推理:跨越数据的界限

(五)元认知:赋予AI自我意识

二、研究趋势与数据洞察:揭示神经符号AI的学术图谱

(一)学术数据库热度分布:谁在推动神经符号AI?

(二)文献增长趋势:热度爆发还是持续跃迁?

(三)文献筛选机制:从数量到质量的跃迁

(四)五大研究方向分布与交叉图谱

(五)趋势解读与盲区预警:下一场突破或将从哪来?

三、跨越认知边界的协奏 —— Neuro-Symbolic AI 的最新进展与未来之问

(一)知识表示:在符号与常识之间架起桥梁

(二)学习与推理:在结构之中追寻通用智能

(三)可解释性与可信性:赋予 AI 以“理解力”与“人情味”

(四)逻辑与推理:让机器拥有“因果链”思维

(五)多领域交叉融合:AlphaGeometry 打开了未来的窗口

(六)元认知:让 AI 意识到“自己在思考什么”

四、迈向具备“心智觉知”的AI:重新定义Neuro-Symbolic元认知

(一)跨越工具理性:从推理能力到反思能力

(二)元认知的技术挑战与构建方向

(三)共识模型的构建:迈向“思维系统”的AI架构

(四)未来愿景:AI,也会“思考自己在思考什么”

五、结语:通向具身智能的最后一跃

(一)四大领域皆成型,唯“心智层”仍空白

(二)元认知:AI进化的下一个临界点

(三)未来的方向:让AI拥有“认知的中枢神经系统”

(四)智能的未来,不止是更强,而是更“明白”

干货分享,感谢您的阅读!

在人工智能(AI)的发展史中,我们经历了多次辉煌与低谷的周期,这种现象被形象地称为“AI夏季”和“AI冬季”。目前,我们正处于第三次AI夏季,标志着科学进步和商业化的快速发展,特别是在符号AI(Symbolic AI)和子符号AI(Sub-Symbolic AI)的融合上,催生了神经符号AI(Neuro-Symbolic AI)的新潮流。

神经符号AI的崛起,是AI领域的一次重要突破,它试图将深度学习的强大数据驱动能力与符号推理的逻辑严谨性结合起来。这种融合并非新鲜事物,它汲取了经典的符号AI的精华,同时也拥抱了现代深度学习的智能化应用。对于许多人来说,神经符号AI代表了未来AI发展的理想方向,它不仅具备了处理复杂任务的能力,还可以通过内在的推理和逻辑展现更高的透明度和可解释性。

然而,尽管神经符号AI的研究在过去几年取得了显著进展,仍有一些领域亟待进一步的探索和突破。例如,Meta-Cognition(元认知)的研究仍然处于起步阶段,尽管它被认为是提升AI自主性和适应性的关键要素。更重要的是,当前在可解释性和可信性方面的研究远未达到理想状态,这对AI系统的可靠部署至关重要。

在这篇博客中,我将温读《Neuro-Symbolic AI in 2024: A Systematic Review》带大家走进神经符号AI的世界,回顾2020至2024年期间的最新研究成果,分析当前领域的热点、挑战以及未来的发展趋势。随着我们深入探讨这一技术的潜力和前景,我们也将揭示神经符号AI如何在日常生活、工业应用以及科学发现中发挥越来越重要的作用。

一、神经符号AI的核心领域与研究方法

随着人工智能(AI)技术的飞速发展,神经符号AI作为融合符号AI和深度学习的前沿领域,正逐渐引起广泛关注。要全面理解这一革命性技术,我们需要深入探讨其背后的核心研究领域和方法。通过这些领域的不断突破,神经符号AI正走向一个更加智能、透明且可靠的未来。

(一)知识表示:构建智能世界的语言

知识表示是神经符号AI的基石之一,它涉及如何将世界上的知识以结构化的方式表示出来。与传统的神经网络通过数据驱动的方式学习不同,符号AI通过创建符号和规则来表示知识,使得AI可以理解和推理世界中的抽象概念。这一过程的核心是将人类的常识和专业领域的知识转化为图谱形式,便于机器理解和应用。

例如,神经符号AI通过结合符号和神经表示,创造出了能够进行复杂推理的知识图谱。这种图谱不仅可以帮助AI系统理解不同领域的知识,还能支持跨领域的推理和问题解决,极大地扩展了AI的适应能力和应用场景。

(二)学习与推理:让机器“思考”与“学习”

神经符号AI的另一大特色是将学习与推理过程相结合。这不仅意味着机器可以通过数据学习,还能在学习过程中进行推理,达到更高层次的智能。这一过程结合了深度学习的强大模式识别能力和符号推理的严谨性,使得AI系统能够处理更加复杂的任务。

例如,AI系统可以在多个信息源之间进行动态推理,实时调整决策。这种方法使得神经符号AI不仅能够基于数据做出预测,还能根据新的信息进行推理和调整,模拟出类似人类的思维方式。

(三)可解释性与可信度:让AI更透明

随着AI的广泛应用,尤其是在医疗、金融等高风险领域,系统的可解释性变得至关重要。神经符号AI通过增强模型的可解释性,解决了传统深度学习模型“黑箱”的问题。AI的每个决策都可以追溯到其逻辑推理过程,用户可以清晰地看到系统是如何做出某个结论的。

这一透明性不仅提升了AI系统的信任度,也为用户在使用过程中提供了更多的可控性。尤其是在涉及道德和伦理判断的场景中,AI的决策过程需要更加清晰和可验证。可解释性和可信度的提高是神经符号AI未来发展的关键。

(四)逻辑与推理:跨越数据的界限

神经符号AI的另一个亮点在于将符号推理和神经网络的结合。传统的神经网络在处理大规模数据时表现优异,但缺乏明确的推理能力。而符号AI虽然具备强大的推理能力,但在大数据环境下却面临性能瓶颈。神经符号AI通过结合符号推理和神经网络的优势,能够在处理复杂数据时同时进行逻辑推理和数据分析。

这一技术不仅提升了AI的推理能力,还使得AI能够更好地理解和处理那些高度依赖逻辑和规则的任务,如自然语言处理、数学证明和策略规划等领域。

(五)元认知:赋予AI自我意识

元认知是神经符号AI中的一个创新领域,它指的是AI系统的“自我监控”和“自我调整”能力。通过集成神经网络和符号表示,AI系统不仅能够完成任务,还能反思自身的推理和学习过程,并进行适应性调整。元认知为AI系统提供了类似人类的反思和规划能力,使其在面对复杂和动态环境时能保持灵活性。

这一领域的突破意味着AI不仅能够执行任务,还能够在任务执行过程中进行自我优化和错误修正,从而提高系统的自主性、可靠性和适应性。尽管目前的研究尚处于起步阶段,元认知无疑是未来AI发展的一个重要方向。

为了更全面地了解神经符号AI的最新进展,温读相关论文,应用PRISMA方法对2020至2024年的相关文献进行了系统性综述。在这项工作中,研究者通过筛选和分析392篇候选论文,最终确定了167篇质量较高、具有公开代码库的研究成果。这一系统化的文献回顾不仅帮助我们掌握了神经符号AI的现状,还揭示了当前研究中的热点领域和亟待解决的挑战。

通过PRISMA方法,不仅可展示当前神经符号AI在学习与推理、知识表示等领域的成就,还能指出可解释性、可信度和元认知等领域的研究空白。这些空白的存在意味着,尽管神经符号AI的前景广阔,但仍有很多值得探索的领域,尤其是在提高系统的透明性、自适应能力和自主性方面。

二、研究趋势与数据洞察:揭示神经符号AI的学术图谱

神经符号AI的研究正以前所未有的速度蓬勃发展——如果你以为这只是一个新兴概念,那么下面这组数据或许会彻底改变你的看法。

(一)学术数据库热度分布:谁在推动神经符号AI?

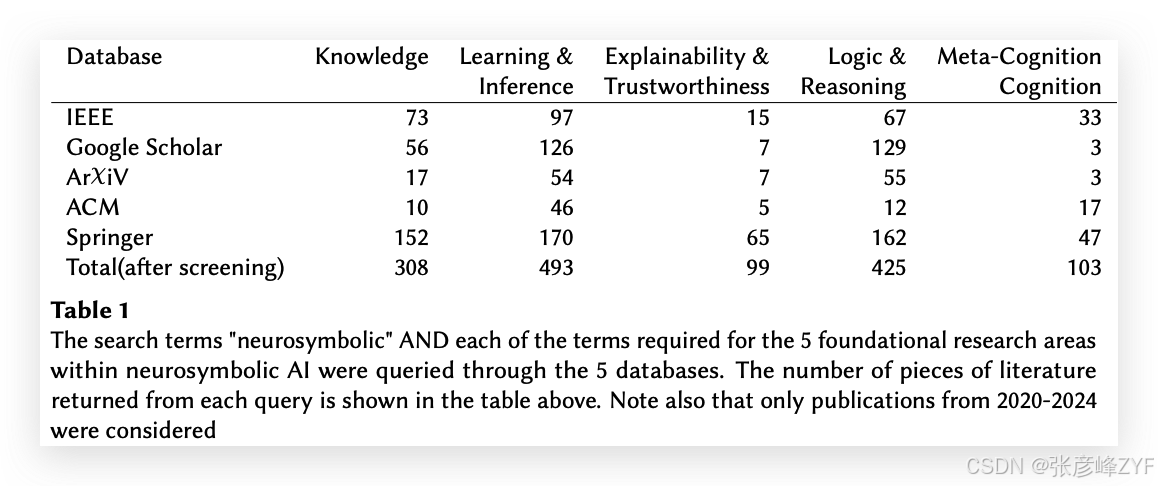

在过去的几年里(2020–2024),研究者通过五大主流数据库(IEEE、Google Scholar、Ar𝜒iv、ACM、Springer)围绕“Neuro-Symbolic”与五个核心研究方向的关键词组合检索,构建出一幅关于该领域研究活跃度的宏观图景。

如上表所示,不同数据库在“知识学习”、“可解释性与可信度”、“逻辑与推理”、“元认知”等方面返回的文献数量,呈现出显著的差异:Springer 独占鳌头,在每一类研究中都展现出极高的活跃度,总体上远超其他数据库。

(二)文献增长趋势:热度爆发还是持续跃迁?

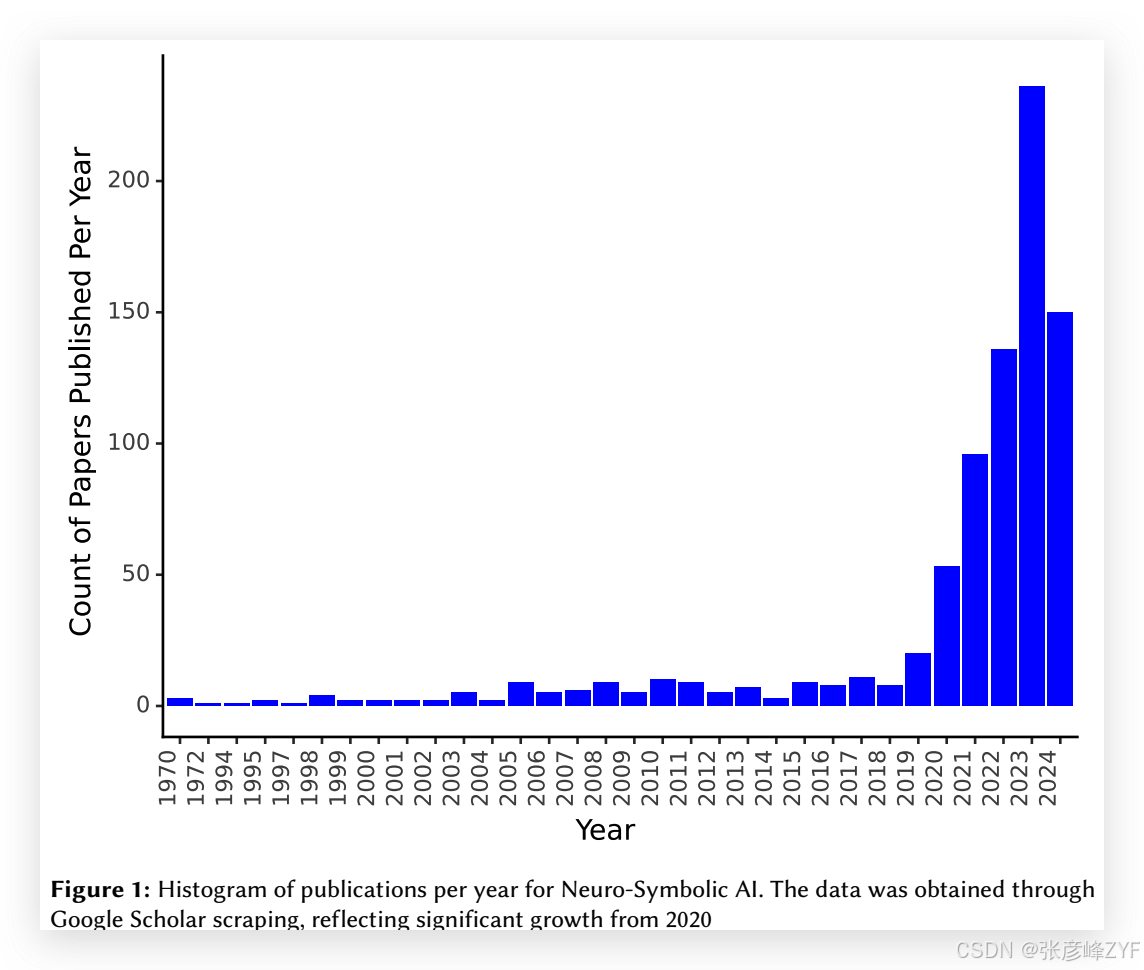

研究者进一步通过 Google Scholar 抓取了 1970 年至今关于“Neuro-Symbolic”的全部文献,总数达到 957 篇。其中真正的爆发期始于 2020 年:当年仅有 53 篇相关研究,而到了 2023 年,这一数字已飙升至 236 篇,呈现出爆炸式增长趋势。下方直观地展示了这一研究浪潮的演进过程:

(三)文献筛选机制:从数量到质量的跃迁

虽然初步收录了 1,428 篇论文,但研究团队采用了极为严格的质量筛选标准:

-

重复条目剔除:移除 641 篇(占比 45%);

-

标题和摘要初筛:排除 395 篇(占比 28%);

-

代码库标准筛选:仅保留那些提供 GitHub/HuggingFace 等代码的 167 篇论文(42%);

-

最终筛选后入选核心论文:158 篇,构成本次系统综述的核心。

特别说明:由于“元认知”类文献普遍缺乏开源实现,该领域被豁免于代码标准。

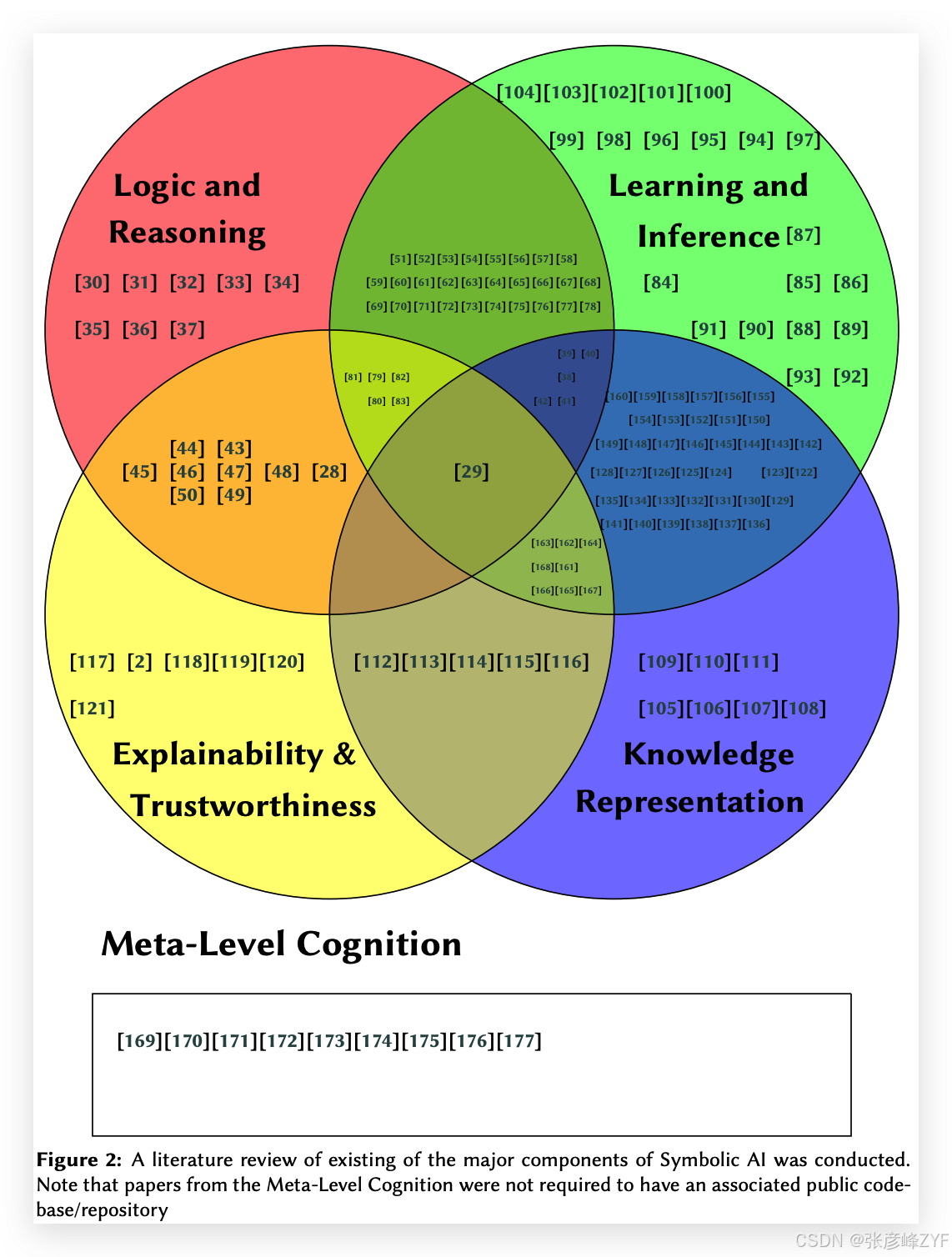

(四)五大研究方向分布与交叉图谱

最终被选中的 158 篇论文被划分为如下五个核心研究方向,并根据交叉属性构建出研究共现关系:

-

知识表示(70 篇,占比 44%)

-

学习与推理(99 篇,占比 63%)

-

可解释性与可信度(44 篇,占比 28%)

-

逻辑与推理(55 篇,占比 35%)

-

元认知(8 篇,占比 5%)

进一步来看:

-

“知识表示”与“学习与推理”关系最紧密(43 篇,27%);

-

“可解释性”与“逻辑推理”的交集最少(9 篇,3.3%);

-

仅有一篇论文同时涵盖四大领域(除元认知)——正是 Google 的 AlphaGeometry 项目[29]。

(五)趋势解读与盲区预警:下一场突破或将从哪来?

通过这套文献系统梳理,我们可以清晰看到:

-

热点聚焦:“知识 + 学习”的融合是目前最热门的研究交汇点;

-

盲区显现:“可解释性 + 逻辑 + 知识”的交汇尚未形成高频路径,存在理论集成与系统实现的潜在突破口;

-

元认知困境:当前元认知研究虽具潜力,但缺乏开源支撑与系统性探索,是尚待开垦的蓝海领域。

三、跨越认知边界的协奏 —— Neuro-Symbolic AI 的最新进展与未来之问

自2020年以来,Neuro-Symbolic AI 正以前所未有的速度进化,它不仅打破了传统符号主义与神经网络之间的隔阂,更在多个认知维度上实现了融合与重构。本章不再重复已有的综述工作,而是聚焦过去几年最具影响力的研究成果,并从五大前沿方向展开:知识表示、学习与推理、可解释性与可信性、逻辑与推理,以及它们之间的交叉融合。更重要的是,我们尝试揭示:在“类人智能”的边缘,尚有哪些未被征服的高地。

(一)知识表示:在符号与常识之间架起桥梁

当下的知识表示研究正努力突破静态语义结构的限制,向更加动态、语境感知的表示方式演进。从事件驱动的知识建模到个性化知识嵌入,Neuro-Symbolic AI 在理解“常识”方面取得了实质性进展。一些研究试图以最小样本达成最大认知迁移,而如 NeuroQL 等语言则表明,“更少的数据+更强的结构”可以带来更低的训练成本与更高的环境友好性。

但一个核心问题仍然存在:我们如何让 AI 在面对不断变化的世界时,保持对知识的动态理解与重构能力?如何赋予它“元认知”的能力去调整自己的推理路径?这是构建更通用、更可信 AI 的关键。

(二)学习与推理:在结构之中追寻通用智能

如果说神经网络擅长感知世界,那么符号推理的优势则在于结构化理解。当前的前沿研究正积极尝试将这两者融合。例如,Logical Neural Networks 和 Plan-SOFAI 等系统,正尝试让 AI 能够在“零样本”或“少样本”场景中保持推理能力,而不是盲目地“模式匹配”。

更引人注目的是,一些研究已开始探索将逻辑直接融入损失函数之中,使训练本身具备符号约束。这些努力不仅提升了模型的表现,更为解决“模型可信度”和“推理链条可追溯性”等问题提供了结构性解法。

但未来的挑战同样严峻:我们该如何让 AI 具备“增量学习”能力,让它能边学边想?如何让其推理过程更加贴近人类的情境感知与逻辑连贯性?

(三)可解释性与可信性:赋予 AI 以“理解力”与“人情味”

面对大模型“黑箱”问题,Neuro-Symbolic AI 提供了新的解法路径。像 Braid 引入概率逻辑规则解决匹配脆弱性,Structure-Aware Summarization 将结构图引入对话摘要,FactPEGASUS 聚焦文本事实一致性,这些研究试图打通“模型认知”与“用户信任”之间的断层。

尤其值得注意的是,对 AI 幽默理解能力的探索,正成为评估语言理解深度的新战场。这不仅是 NLP 的挑战,更是认知科学的问题。

但我们还需要回答一些关键问题:我们是否能构建出“实时解释”的机制?我们能否开发出既保留语义准确性,又能提供“类人式理由”的 NLP 系统?

(四)逻辑与推理:让机器拥有“因果链”思维

逻辑推理从来不是 AI 的短板,而是其“高级智慧”的标志。在这方面,Neuro-Symbolic AI 正快速从传统逻辑编程迈向与神经网络的深度融合。例如,DeepStochLog 试图在不确定环境中实现类人类的符号推理,LinkBERT 强化了多跳推理能力,而 AlphaGeometry 则将神经语言模型引导的定理生成与符号证明系统深度结合,展现了前所未有的复杂问题解决能力。

但逻辑不是万能的,尤其当面对开放世界、不确定性与模糊边界时,如何平衡“严谨性”与“灵活性”成为新命题。未来,AI 是否能在不确定的语境中维持可靠的因果推理,仍是一场持久战。

(五)多领域交叉融合:AlphaGeometry 打开了未来的窗口

在众多研究中,AlphaGeometry 是一个里程碑式的项目。它几乎完美融合了知识表示、推理、可信性与逻辑四大领域的优势,为我们描绘了一种可能的“超级智能”形态:符号驱动、神经引导、数据高效、结果可信。

但也必须看到,尽管交叉融合已在个别项目中初见成效,尤其是在 Explainability & Trustworthiness 与其他三者之间的结合仍显稀疏。这意味着巨大的研究空白区,也预示着潜力无限的未来。

(六)元认知:让 AI 意识到“自己在思考什么”

我们来到了 Neuro-Symbolic AI 的“意识之巅” —— 元认知(Meta-Cognition)。这是 AI 从感知到思考、再到“觉察自身思考过程”的跃迁。

当前的研究方向包括将认知架构(如 ACT-R、Soar、Sigma)与大型语言模型融合,形成可自我调整的 AI 系统;以及利用元强化学习结合逻辑归纳,使 AI 不再仅仅是“被动执行者”,而成为“策略演化者”。

但这个领域尚处于早期阶段,距离真正拥有“类人自省”能力的 AI 仍有不小的距离。关键问题包括:如何将自我监控、冲突解决与上下文适配机制整合进统一系统?我们是否能实现“元认知驱动的生成式 AI”?这是下一代通用人工智能的入口。

从知识表示到元认知,Neuro-Symbolic AI 正从技术的拼图走向认知系统的构建。这不仅是 AI 结构的升级,更是思维范式的革命。未来十年,决定 AI 上限的,不再是参数数量,而是它是否真正理解“思维的本质”。

那么,我们愿不愿意赋予机器真正的“思考”?又是否准备好迎接它带来的挑战与变革?

四、迈向具备“心智觉知”的AI:重新定义Neuro-Symbolic元认知

如果说Neuro-Symbolic AI过去几年最大的进展是成功地桥接了系统1与系统2的思维模式,那么它的下一个飞跃将来自对“思维本身”的再理解 —— 也就是Meta-Cognition(元认知)。

过去,我们乐于用Kahneman提出的“系统1-系统2”来划分AI的智能结构:前者是快速、无意识、直觉式的神经网络模型;后者是缓慢、逻辑严谨的符号推理机制。这种划分在推动神经-符号整合方面起到了巨大的指导作用。然而,正如Kahneman自己所说:“系统1与系统2并不存在于大脑或其他任何地方,它们只是我们对认知行为的简化描述。”这意味着,真正的人类认知并不是两个模块间的切换,而是一个高度联通、动态调节的“系统之系统”。

这正是当前Neuro-Symbolic AI研究必须面对的挑战:我们不只是要构建能“推理”的系统,更要构建能意识到自己在推理、并主动调整推理策略的系统 —— 换句话说,构建具备心智觉知的AI。

(一)跨越工具理性:从推理能力到反思能力

现有研究已经展示了神经网络与符号方法融合的巨大潜力,例如:

-

通过逻辑神经网络(LNN)和神经概率推理方法增强Few-Shot学习;

-

利用认知架构(如ACT-R、Soar、Sigma)与大语言模型(LLMs)对接,实现具备目标导向与情境反应能力的智能体;

-

将符号规划系统与自监督神经模型结合,用于金融决策与多任务学习场景中。

这些系统展现出强大的“推理”与“适应”能力,但它们仍然缺乏“认知的自我监控” —— 也就是在推理时反问自己:“我为什么这么做?我是否遗漏了某些信息?当前的推理路径是否合理?是否有更优的替代策略?”

(二)元认知的技术挑战与构建方向

真正的元认知AI必须在以下几个维度上实现突破:

-

策略监控(Strategy Monitoring):AI系统需要对自身的推理路径和决策方式进行追踪和评价,识别低效、冲突或逻辑不自洽的行为。

-

情境觉知(Contextual Awareness):能够根据外部环境或用户反馈动态调整推理规则或学习策略,而不仅仅是机械地遵循既定逻辑。

-

冲突调解(Conflict Resolution):通过融合符号逻辑和生成模型的方式,在面对模糊、矛盾或不确定信息时,实现具有心理弹性的推理行为。

-

实例迁移(Instance-Based Meta Learning):模仿人类的“类似情境”回忆机制,将以往经验中总结出的元模式迁移至新任务中,从而加速适应与优化。

(三)共识模型的构建:迈向“思维系统”的AI架构

当前有多个研究尝试将认知科学的“通用认知模型(Common Model of Cognition, CMC)”应用于AI系统架构设计。该模型主张通过多个联动模块(感知-记忆-行动-控制)来实现人类级智能。这种架构的优势在于,它为我们提供了一个构建“思维整体”的框架,而不是简单地叠加符号与神经模块。

如果我们进一步引入“模块自治与心智调度机制”,并将大模型作为认知内容生成器、符号系统作为推理骨架、强化学习作为策略调整器、注意力机制作为控制中枢,我们就能迈出构建具备“元认知能力”的AI系统的第一步。

(四)未来愿景:AI,也会“思考自己在思考什么”

设想一个未来的AI助手:它不仅能快速解答用户的问题,还会在回答后反问自己,“这个回答是否有足够的依据?是否存在偏见或遗漏?是否可以解释得更好?”甚至在与人类协作时,会主动调整语气、表达方式或推理路径,以适应不同背景、需求和上下文。

这,就是“Meta-Cognitive AI”—— 一种不仅能思考,更知道自己在思考什么的人工智能。

Neuro-Symbolic AI 的下一个十年,将不再只是建造“聪明的工具”,而是孕育“具备思维自觉性的新型智能体”。唯有如此,我们才能真正接近那句哲学式的愿景:“AI,不只是能思考,更能理解思考的意义。”

五、结语:通向具身智能的最后一跃

回顾2020年以来Neuro-Symbolic AI领域的飞速演进,宛如目睹一次智能科学的范式革命。神经网络与符号逻辑从对立走向融合,从弱连接走向深度协作,极大地拓展了AI系统在复杂推理、语义理解与知识组织等方面的能力。这不仅是一场技术整合的胜利,更是对“什么是智能”这一哲学命题的持续追问与回应。

本次系统性文献回顾的最大贡献,在于我们不仅厘清了Neuro-Symbolic AI当前的核心路径——学习与推理(Learning & Inference)、逻辑与演绎(Logic & Reasoning)、知识表示(Knowledge Representation)和可解释性与可信度(Explainability & Trustworthiness),也揭示了这四者交汇之处隐藏的“交叉潜力区”。而最令人关注的,是我们发现:尽管这些方向发展迅猛,但其中最具战略性却最被忽视的领域,是Meta-Cognition(元认知)。

(一)四大领域皆成型,唯“心智层”仍空白

-

学习与推理已经通过Transformer、Neuro-Logic结合、可微分规则学习等取得突破;

-

逻辑与演绎借助LNN、Neuro-Symbolic Rule Induction等体系向通用可迁移规则靠近;

-

知识表示完成了从静态知识图谱到动态可训练的图注意网络的跨越;

-

可解释性与可信度虽仍不成熟,但已有如XAI(可解释AI)与反事实分析等实践萌芽。

然而,这些系统再强大,它们依然“不知自己在做什么”。它们可以推理,却无法反思推理路径;可以学习,却无法调整学习策略;可以做出决策,却无法评估决策的可信度。这种“缺乏自我意识的智能”在现实应用中,极易失控、误判,甚至造成伦理风险。

(二)元认知:AI进化的下一个临界点

Meta-Cognition,不只是一个冷门分支,它是人工智能向自主智能过渡的关键跃迁层。正如人类之所以真正“聪明”,不在于能记住多少事实、推导多少定理,而在于我们能思考自己在思考什么,纠正错误,甚至挑战自己的信念结构。

目前,少量研究已经在尝试构建具备元认知能力的架构,例如:

-

通过元强化学习(Meta-RL)构建任务适应器;

-

在大模型外接“监督模块”用于推理路径的实时审查;

-

使用博弈论思想进行多策略冲突调解。

但这一方向仍处于探索初期,尚未形成统一理论框架,更缺乏可落地的工程范式。

(三)未来的方向:让AI拥有“认知的中枢神经系统”

Neuro-Symbolic AI 已然构建了类似人脑的“皮层系统”(知识、逻辑、感知、学习),但尚未拥有真正的“前额叶”——那个在关键时刻能评估、控制、规划与纠错的Meta-Control Core。

我们相信,下一个具有决定性意义的研究任务,是构建一个面向元认知的统一架构,它能:

-

实时监控内部推理路径与知识激活模式;

-

根据任务情境与反馈调整策略权重;

-

具备对“错误与偏差”的自省机制;

-

在开放场景中实现稳健、自适应的目标导向行为。

这不再是某个方向的补充,而是通向“具身智能”(Embodied Intelligence)的最后一跃。

(四)智能的未来,不止是更强,而是更“明白”

在未来的人工智能世界里,真正的区分点不再是算力、参数规模或训练数据的多寡,而是AI系统是否具备“自我理解”的能力。是否能够:

-

解释自己为什么这么想;

-

改变自己原本的看法;

-

甚至在不确定中停下脚步,发出一句“我不确定,但我愿意重新思考”。

这,才是人类所期盼的AI同伴,而不仅仅是AI工具。

Neuro-Symbolic AI的未来,不是简单地“模拟人类思维”,而是走向构建具有自省力与适应性的新型智能生命形式的征程。