ECCV2022 | LGV | LGV:利用大几何邻域提升对抗样本的可迁移性

LGV: Boosting Adversarial Example Transferability from Large Geometric Vicinity

- 摘要-Abstract

- 引言-Introduction

- 实验设置-Experimental Settings

- LGV: 源于大几何邻域的迁移性-LGV: Transferability from Large Geometric Vicinity

- 研究LGV特性:损失几何的重要性-Investigating LGV Properties: On the Importance of the Loss Geometry

- 损失平坦性:代理-目标错位假设-Loss Flatness: the Surrogate-Target Misalignment Hypothesis

- LGV 权重子空间几何的重要性-On the Importance of LGV Weight Subspace Geometry

- 结论和未来工作-Conclusion And Future Work

论文链接

本文 “LGV: Boosting Adversarial Example Transferability from Large Geometric Vicinity” 提出了一种名为 LGV(Large Geometric Vicinity)的新技术,用于提升黑盒对抗攻击的可转移性,从代理模型损失几何的角度揭示了对抗样本可转移性的重要因素,为理解和改进对抗攻击可转移性开辟了新方向。

摘要-Abstract

We propose transferability from Large Geometric Vicinity (LGV), a new technique to increase the transferability of black-box adversarial attacks. LGV starts from a pretrained surrogate model and collects multiple weight sets from a few additional training epochs with a constant and high learning rate. LGV exploits two geometric properties that we relate to transferability. First, models that belong to a wider weight optimum are better surrogates. Second, we identify a subspace able to generate an effective surrogate ensemble among this wider optimum. Through extensive experiments, we show that LGV alone outperforms all (combinations of) four established test-time transformations by 1.8 to 59.9 percentage points. Our findings shed new light on the importance of the geometry of the weight space to explain the transferability of adversarial examples.

我们提出了来自大几何邻域(LGV)的可转移性,这是一种提高黑盒对抗攻击可转移性的新技术。LGV 从预训练的代理模型开始,并在几个额外的训练周期中以恒定的高学习率收集多个权重集。LGV 利用了与可迁移性相关的两个几何特性。首先,属于更宽权重最优解的模型是更好的代理模型。其次,我们确定了一个子空间,能够在这个更宽的最优解中生成有效的代理集成。 通过大量实验,我们表明仅 LGV 就比所有(组合)四种已建立的测试时变换高出 1.8 到 59.9 个百分点。我们的发现为权重空间的几何形状在解释对抗样本可转移性方面的重要性提供了新的见解。

引言-Introduction

这部分主要介绍了研究背景、问题现状以及研究内容与贡献,具体如下:

- 研究背景:深度神经网络(DNNs)在计算机视觉任务中表现出色,但易受对抗样本影响。在实际应用的黑箱设置中,攻击者难以获取目标模型的全部信息,通常在代理模型上执行对抗攻击,生成对抗样本并期望其能转移到目标模型。

- 问题现状:实现对抗样本的稳定转移颇具挑战,当前提升转移能力的方法多依赖优化过程中的多样性构建,但代理模型属性与转移能力之间的关系仍不明确。现有研究虽对DNN几何在自然泛化方面有深入探讨,但在利用几何提升对抗样本转移能力上成果较少,缺乏可行的见解来推动新方法的设计。

- 研究内容与贡献:提出LGV技术提升黑箱对抗攻击的转移能力。该技术从预训练的代理模型出发,通过高学习率的额外训练轮次收集多个权重样本。实验表明,LGV在转移率上较于其他技术高出3.1到59.9个百分点。研究还揭示了LGV采样权重的两个属性与转移能力提升相关,并强调了代理损失几何对解释对抗样本转移能力的重要性 ,为相关研究提供了新的思路。

实验设置-Experimental Settings

该部分主要介绍了评估基于转移的黑盒攻击时所采用的实验设置,涵盖模型选择、样本制作、对比方法、超参数选择、评估指标及相关代码模型获取途径等方面,具体如下:

- 模型选择:代理模型采用训练好的ResNet - 50模型;目标模型选用来自PyTorch的8个不同架构的训练模型,其中包含ResNet - 50,以此覆盖同架构和跨架构的实验场景。

- 样本制作:从2000张ImageNet测试图像的随机子集中生成对抗样本,这些图像能被所有8个目标模型正确分类。

- 对比方法:将LGV与四种测试时变换技术及其组合进行对比,所有对比方法均基于I - FGSM(迭代快速梯度符号法)。由于转移攻击的威胁模型不允许攻击者访问目标模型的预言机,因此未考虑基于查询的黑盒攻击。

- 超参数选择:通过在独立的已正确分类训练示例子集上进行交叉验证,来选择攻击的超参数。

- 评估指标:报告在 L ∞ L_{\infty} L∞ 范数有界扰动下的攻击成功率,即无目标对抗样本的误分类率的平均值和标准差。每个实验运行3次,每次运行使用独立的示例集、不同的代理模型和不同的随机种子。

LGV: 源于大几何邻域的迁移性-LGV: Transferability from Large Geometric Vicinity

该部分主要介绍了LGV技术,包括技术的初步探索、算法步骤,以及与当前最先进技术的对比情况,具体如下:

- 初步探索:通过实验发现,在权重空间添加随机方向能提升转移能力,而在特征空间梯度上添加随机方向则无此效果。基于此,开发出LGV技术,其通过从训练好的DNN附近构建代理模型,证实了代理模型权重空间对提升转移能力的重要性。

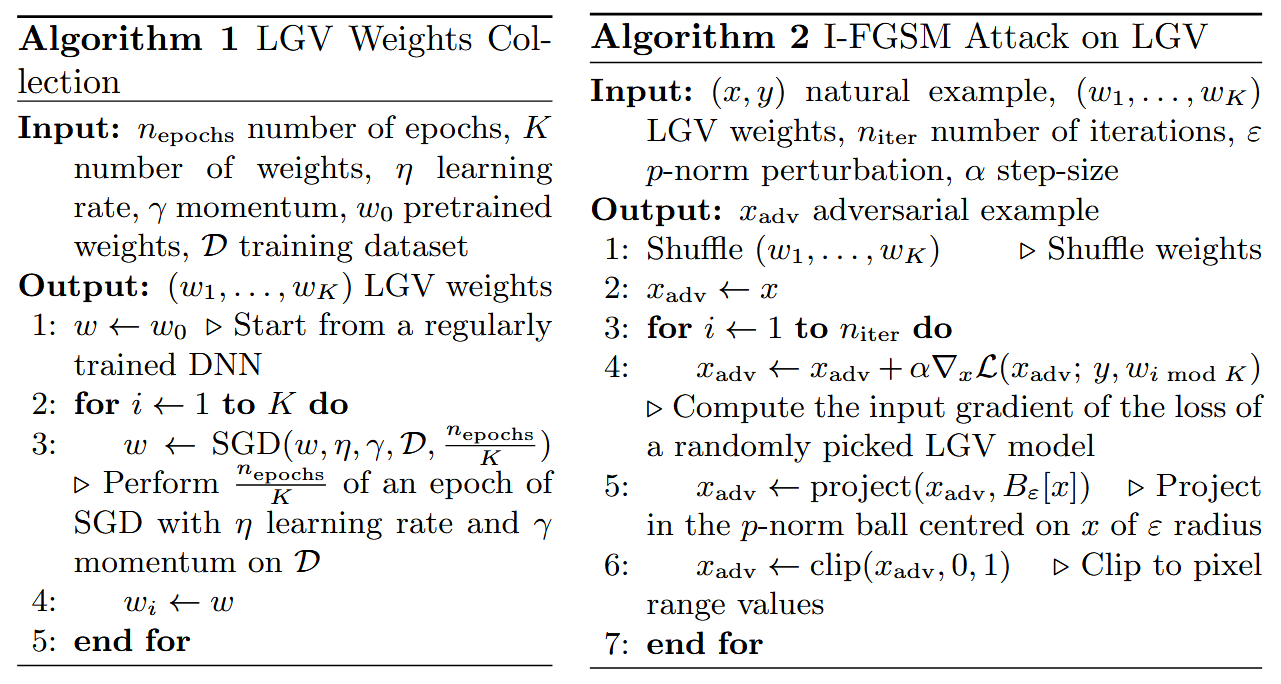

- 算法步骤

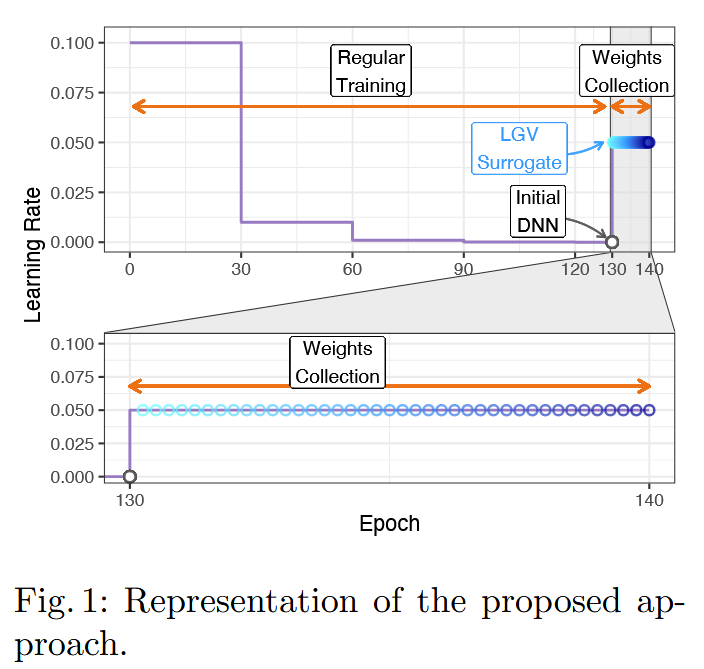

- 权重收集:从预训练模型出发,以高恒定学习率进行额外训练轮次,沿随机梯度下降(SGD)轨迹按固定间隔(每轮4次)收集权重。如在实验中的ResNet-50代理模型上,使用初始训练时一半的学习率运行SGD,使模型能逃离初始局部最小值的吸引域。

- 迭代攻击:对收集到的模型进行迭代攻击。每次迭代时,随机无放回地选择一个收集到的模型,计算其梯度。若迭代次数大于收集到的模型数量,则循环使用这些模型。该步骤相比攻击单个模型,计算开销可忽略不计。

图1:所提方法的示意图。

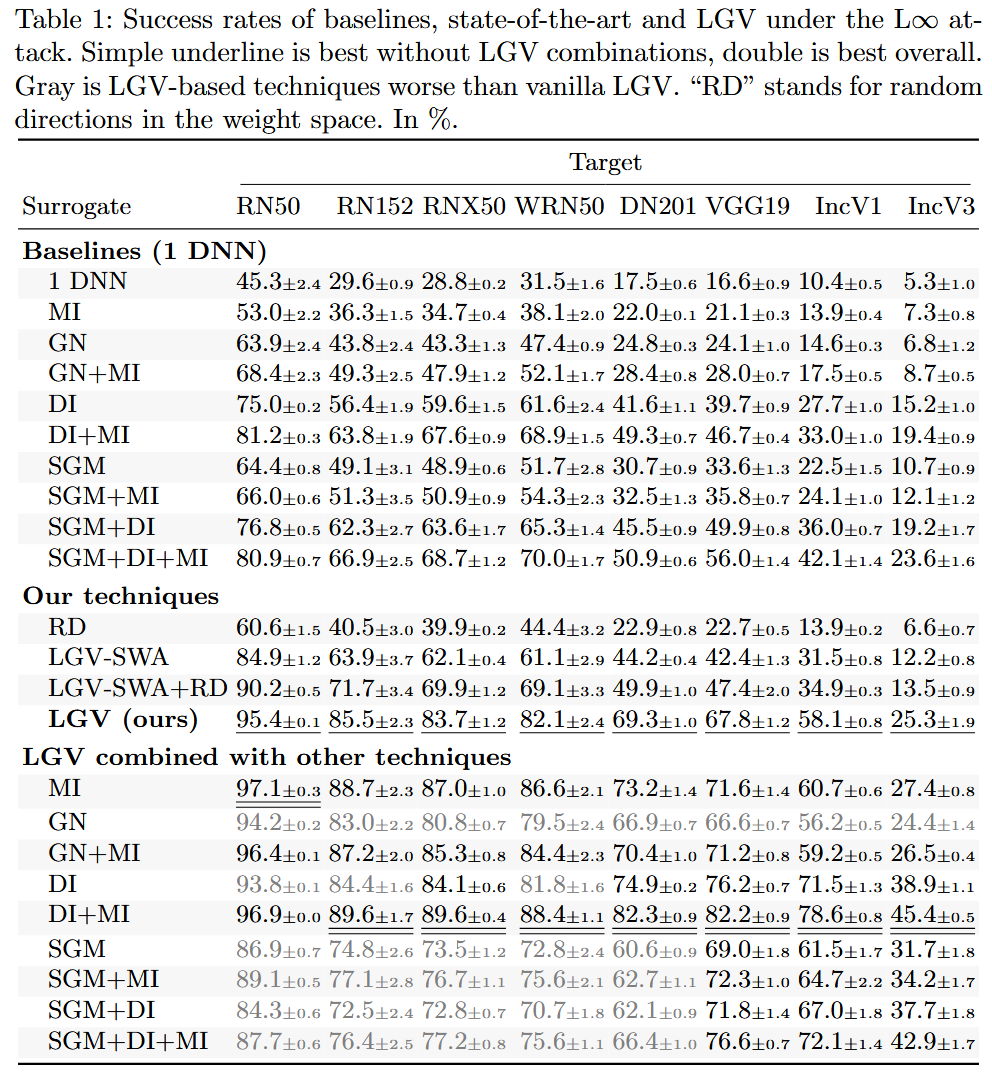

- 与当前最先进技术的对比:与MI(为攻击梯度添加动量)、Ghost Networks(GN,利用dropout或跳过连接侵蚀生成多样代理模型)、DI(对输入应用变换增加多样性)、Skip Gradient Method(SGM,更注重跳过连接的梯度)等技术对比,LGV单独使用时,攻击成功率比其他技术(及其组合)有显著提升,平均提高35.6个百分点。部分技术与LGV结合可进一步提升效果,但GN和SGM与LGV结合时存在兼容性问题。

表1:在 L ∞ L_{\infty} L∞ 攻击下,基线模型、最先进技术和LGV的成功率。单下划线表示在不与LGV组合的情况下最佳,双下划线表示总体最佳。灰色表示基于LGV的技术比普通LGV效果更差。“RD”代表权重空间中的随机方向。以百分比表示。

研究LGV特性:损失几何的重要性-Investigating LGV Properties: On the Importance of the Loss Geometry

损失平坦性:代理-目标错位假设-Loss Flatness: the Surrogate-Target Misalignment Hypothesis

该部分围绕“损失平坦度:代理 - 目标失配假设”展开,旨在解释LGV作为良好代理模型的原因,通过理论分析和实验验证,揭示了LGV在权重空间和特征空间的平坦特性及其对提高对抗样本转移性的作用,具体内容如下:

-

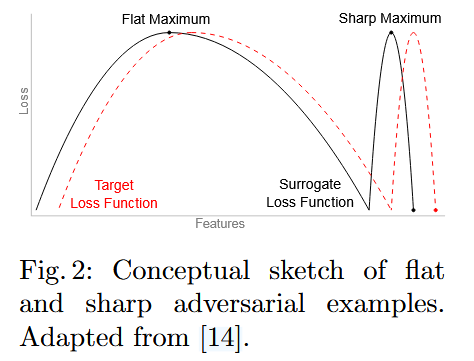

理论基础:在机器学习中,尖锐最小值和平坦最小值是重要概念。尖锐最小值指目标函数在邻域内变化大,平坦最小值则变化小。已有研究表明,权重空间中解的宽度与(自然)泛化相关,当训练损失和测试损失在权重空间发生偏移时,宽最优解有助于减小两者差异。类似地,作者推测代理模型和目标模型在特征空间也存在失配,在此假设下,代理损失更宽最大值处的对抗样本比尖锐处的转移效果更好。但并非所有类型的损失平坦度都能增加转移性,因为完全消失的梯度会使基于梯度的攻击失效。

图2:平坦和尖锐对抗样本的概念示意图。改编自[14]。 -

实验验证

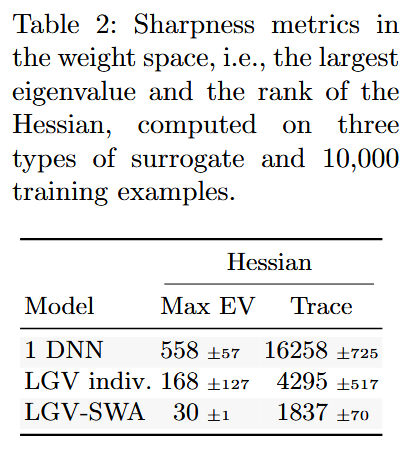

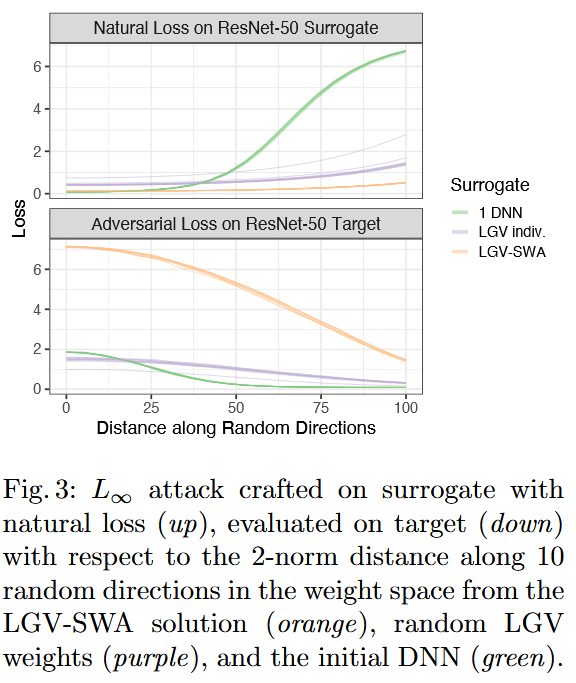

- 权重空间的平坦性:为验证LGV权重处于更平坦区域,从两方面进行实验。一是计算Hessian-based尖锐度指标,包括Hessian矩阵的最大特征值和迹,结果表明初始DNN比LGV和LGV-SWA权重更尖锐;二是在单位球上采样随机方向向量,研究不同模型沿该方向的损失变化。发现LGV-SWA的自然损失在权重空间更宽,添加随机向量后其损失增加幅度远小于初始模型,且平坦度增加伴随着转移性提升。

表2:权重空间中的尖锐度指标,即Hessian矩阵的最大特征值和秩,这些指标是在三种类型的代理模型和10000个训练样本上计算得到的。

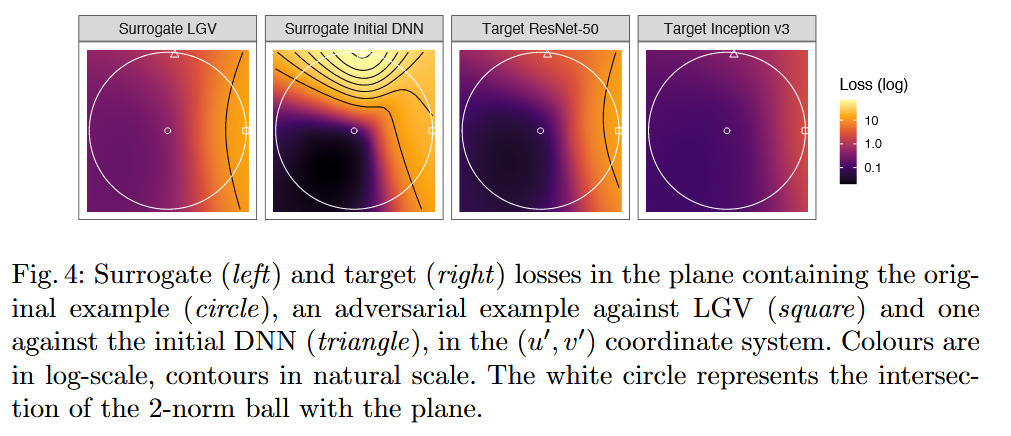

图3:基于具有自然损失的代理模型构建的 L 2 L_2 L2 攻击(上图),在目标模型上进行评估(下图),评估依据是在权重空间中,沿着从LGV-SWA解(橙色)、随机LGV权重(紫色)和初始DNN(绿色)出发的10个随机方向的2-范数距离。 - 特征空间的平坦性:研究LGV在权重空间的平坦性对特征空间对抗样本的影响。构建包含原始样本、LGV对抗样本和初始DNN对抗样本的平面,并建立正交基。以2-范数攻击为例,其将对抗扰动限制在以原始样本为中心的

L

2

L_2

L2 球内,该球与平面的交集为圆盘。通过比较LGV和初始DNN在该平面坐标系中的损失,发现LGV的损失表面更平滑,其对抗样本位于更宽区域,而初始DNN损失的最大值更尖锐,易导致对抗样本过拟合。同时,LGV损失与ResNet-50目标模型的损失对齐更好,在其他目标模型和不同代理模型的对抗样本平面上也有类似现象,进一步支持了代理 - 目标失配假设。

图4:在包含原始样本(圆形)、针对LGV的对抗样本(方形)和针对初始DNN的对抗样本(三角形)的平面中,代理模型(左)和目标模型(右)在( ( u ′ , v ′ ) (u', v') (u′,v′))坐标系中的损失情况。颜色采用对数刻度,等高线采用自然刻度。白色圆圈表示2-范数球与该平面的交集。

- 权重空间的平坦性:为验证LGV权重处于更平坦区域,从两方面进行实验。一是计算Hessian-based尖锐度指标,包括Hessian矩阵的最大特征值和迹,结果表明初始DNN比LGV和LGV-SWA权重更尖锐;二是在单位球上采样随机方向向量,研究不同模型沿该方向的损失变化。发现LGV-SWA的自然损失在权重空间更宽,添加随机向量后其损失增加幅度远小于初始模型,且平坦度增加伴随着转移性提升。

-

结论:LGV权重所在的损失区域比初始DNN权重更平坦,权重空间的平坦性与特征空间的平坦性相关,LGV对抗样本相比基于初始DNN生成的尖锐对抗样本更宽。这些结论支持了代理 - 目标失配假设,即当代理和目标损失存在偏移时,宽最优解比尖锐最优解更具鲁棒性,更有利于对抗样本的转移。

LGV 权重子空间几何的重要性-On the Importance of LGV Weight Subspace Geometry

该部分主要研究LGV权重子空间几何对提升对抗样本可转移性的重要作用,通过构建不同代理模型进行实验,从子空间对可转移性的作用、投影矩阵分解以及子空间的通用性三个方面展开分析,具体内容如下:

- 子空间对可转移性的作用:构建新代理模型“LGV - SWA + RD”,在LGV - SWA周围全权重空间采样随机方向。实验结果显示,虽然在全权重空间随机偏差能提升LGV - SWA的可转移性,但LGV代理模型性能更优,表明LGV形成的子空间具有与可转移性相关的特定几何属性,使其整体性能优于随机方向构建的模型。通过评估从该子空间采样构建的代理模型的可转移性,进一步证明子空间与可转移性紧密相连。

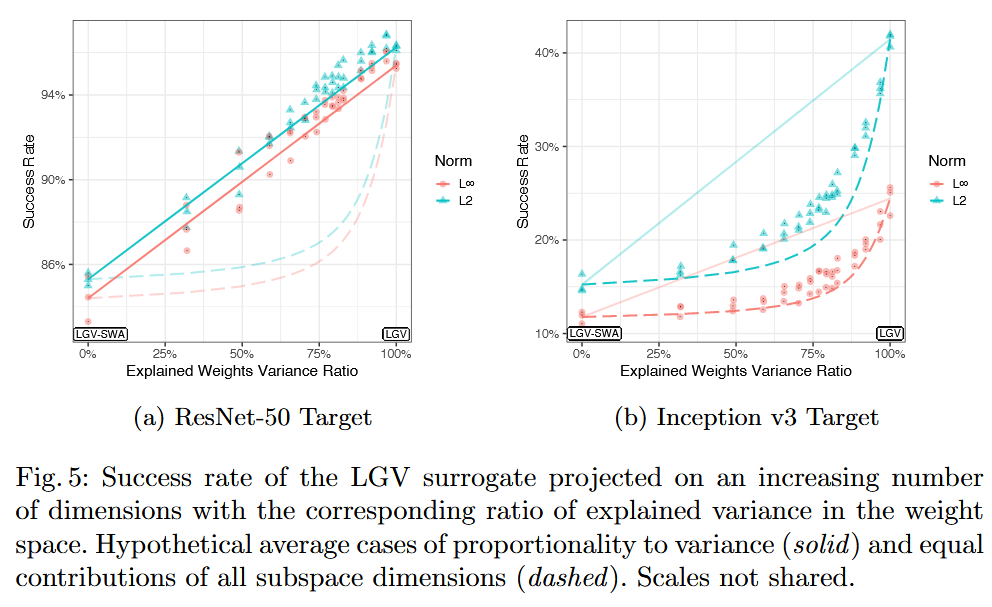

- 投影矩阵分解分析:利用主成分分析(PCA)对LGV权重偏差矩阵进行分解,将其分解为正交方向,得到新的正交基。通过控制投影到主成分的数量,构建不同维度的LGV代理模型。研究发现,在同架构(如ResNet - 50目标)和部分跨架构情况下,权重子空间方向的重要性(以解释权重方差的比例衡量)与可转移性呈正相关,即沿方差更高的方向采样对提升可转移性更有帮助。在某些跨架构案例中,虽未呈现严格线性关系,但相关性仍为正,各方向对可转移性的贡献接近相等。

图5:投影到越来越多维度上的LGV代理模型的成功率,以及权重空间中相应的解释方差比。假设的与方差成比例的平均情况(实线)和所有子空间维度贡献相等的情况(虚线)。坐标轴刻度未共享。 - 子空间的通用性:将LGV应用于另一个独立训练的DNN,构建“LGV - SWA + (LGV’ - LGV - SWA’)”代理模型。实验表明,将LGV子空间转移到另一个平坦解上,比在该解上随机采样方向得到的代理模型性能更好,说明子空间几何具有与可转移性相关的通用属性。然而,与原始LGV代理模型相比,转移后的代理模型成功率有所下降,表明子空间在原始解上应用时最优。此外,将LGV偏差应用于常规训练的DNN时,通过适当缩放(如缩放因子为0.5),可使可转移性相比随机方向平均提升10.0个百分点,进一步证明LGV子空间对不同性质的解都有益处。

- 结论:LGV权重偏差形成的子空间对提升可转移性至关重要,其几何结构与可转移性紧密且通用相关。该子空间使LGV能利用损失平坦区域的优势,克服代理模型和目标模型损失函数之间的潜在失配,提高对抗样本从代理模型转移到目标模型的成功率。

结论和未来工作-Conclusion And Future Work

这部分总结了LGV技术的研究成果,并对未来研究方向提出了展望:

- 研究结论:研究发现,在攻击迭代时从权重空间采样随机方向可提升对抗样本的可转移性,而从特征空间采样则无效。基于此提出的LGV技术,通过从预训练的常规DNN出发,以高恒定学习率沿SGD轨迹收集权重构建代理模型,在实验中表现优异,单独使用时击败了四种现有技术的所有组合。深入分析LGV可知,其成功得益于两方面:一是权重空间的平坦度,能产生更鲁棒的对抗样本,抵抗代理 - 目标失配;二是LGV权重所张成的密集子空间,其几何结构与可转移性紧密相连。

- 未来展望:基于已有研究中关于自然泛化的见解,未来研究可从权重空间体积的角度出发,研究其如何导致相似的预测函数,进而探索对对抗样本可转移性的影响,为该领域的进一步发展提供新的研究方向。