RTDETR融合[CVPR2025]BHViT中的token_mixer模块

RT-DETR使用教程: RT-DETR使用教程

RT-DETR改进汇总贴:RT-DETR更新汇总贴

《BHViT: Binarized Hybrid Vision Transformer》

一、 模块介绍

论文链接:https://arxiv.org/pdf/2503.02394

代码链接:https://github.com/IMRL/BHViT/tree/main

论文速览:

模型二值化在实现卷积神经网络 (CNN) 的实时和节能计算方面取得了重大进展,为视觉转换器 (ViTs) 在边缘设备上面临的部署挑战提供了潜在的解决方案。然而,由于 CNN 和 Transformer 架构之间的结构差异,简单地将二进制 CNN 策略应用于 ViT 模型将导致性能显着下降。为了应对这一挑战,我们提出了 BHViT,这是一种二值化友好的混合 ViT 架构及其完整的二值化模型,并以三个重要观察结果为指导。最初,BHViT 利用从粗略到精细的局部信息交互和分层特征聚合技术来解决因过多标记而产生的冗余计算。然后,提出了一种基于移位作的新型模块,在不显著增加计算开销的情况下提高二进制多层感知器 (MLP) 模块的性能。此外,提出了一种基于量化分解的创新注意力矩阵二值化方法,以评估标记在二值化注意力矩阵中的重要性。最后,我们提出了一种正则化损失来解决由于二进制层中的权重振荡与 Adam 优化器之间的不兼容而导致的优化不充分。

总结:本文更新其中token_mixer(MSGDC)模块的融合方法。

⭐⭐本文二创模块仅更新于付费群中,往期免费教程可看下方链接⭐⭐

RT-DETR更新汇总贴(含免费教程)文章浏览阅读264次。RT-DETR使用教程:缝合教程: RT-DETR中的yaml文件详解:labelimg使用教程:_rt-deterhttps://xy2668825911.blog.csdn.net/article/details/143696113

二、二创融合模块

2.1 相关二创模块及所需参数

该模块可如图加入到HGBlock、RepNCSPELAN4、RepC3与自研等模块中,代码见群文件,所需参数如下。

HGBlock-变式模块 所需参数:(c1, cm, c2, k, n, lightconv, shortcut, act)

RepNCSPELAN4-变式模块 所需参数:(c1, c2, c3, c4, n)

RepC3-变式模块 所需参数:(c1, c2, n, e)

CCRI及变式模块 所需参数:(c1, c2, k, n, lightconv, shortcut, scale, e, act)

RepC4及变式模块 所需参数:(c1, c2, n, e)

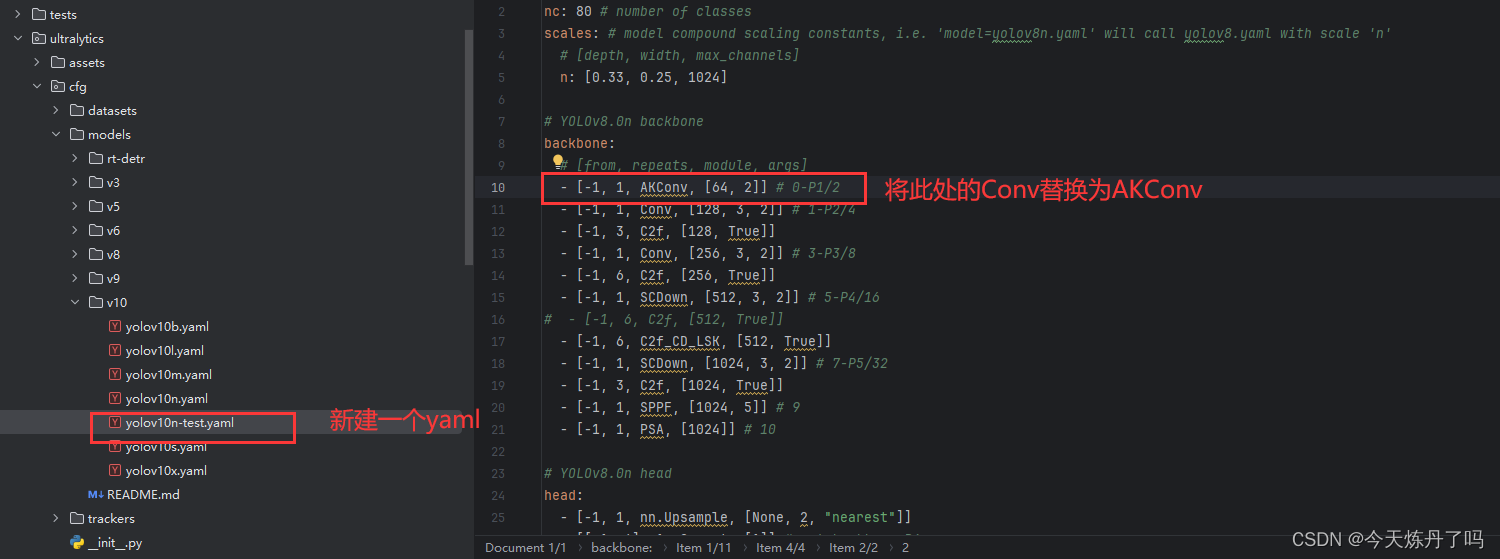

2.2 更改yaml文件 (以自研模型加入为例)

yam文件解读:YOLO系列 “.yaml“文件解读_yolo yaml文件-CSDN博客

打开更改ultralytics/cfg/models/rt-detr路径下的rtdetr-l.yaml文件,替换原有模块。

# Ultralytics YOLO 🚀, AGPL-3.0 license

# RT-DETR-l object detection model with P3-P5 outputs. For details see https://docs.ultralytics.com/models/rtdetr

# ⭐⭐Powered by https://blog.csdn.net/StopAndGoyyy, 技术指导QQ:2668825911⭐⭐# Parameters

nc: 80 # number of classes

scales: # model compound scaling constants, i.e. 'model=yolov8n-cls.yaml' will call yolov8-cls.yaml with scale 'n'# [depth, width, max_channels]l: [1.00, 1.00, 512]

# n: [ 0.33, 0.25, 1024 ]

# s: [ 0.33, 0.50, 1024 ]

# m: [ 0.67, 0.75, 768 ]

# l: [ 1.00, 1.00, 512 ]

# x: [ 1.00, 1.25, 512 ]

# ⭐⭐Powered by https://blog.csdn.net/StopAndGoyyy, 技术指导QQ:2668825911⭐⭐backbone:# [from, repeats, module, args]- [-1, 1, Conv, [64, 3, 2]] # 0-P1/2- [-1, 1, Conv, [128, 3, 2]] # 1-P2/4- [-1, 1, token_mixer, []]- [-1, 1, Conv, [256, 3, 2]] # 3-P3/8- [-1, 4, CCRI, [256, 3, True, True]]- [-1, 1, Conv, [512, 3, 2]] # 5-P4/16- [-1, 4, CCRI, [512, 3, True, True]]- [-1, 1, Conv, [1024, 3, 2]] # 7-P5/32- [-1, 2, CCRI, [1024, 3, True, False]]head:- [-1, 1, Conv, [256, 1, 1, None, 1, 1, False]] # 9 input_proj.2- [-1, 1, AIFI, [1024, 8]]- [-1, 1, Conv, [256, 1, 1]] # 11, Y5, lateral_convs.0- [-1, 1, nn.Upsample, [None, 2, "nearest"]]- [6, 1, Conv, [256, 1, 1, None, 1, 1, False]] # 13 input_proj.1- [[-2, -1], 1, Concat, [1]]- [-1, 2, RepC4, [256]] # 15, fpn_blocks.0- [-1, 1, Conv, [256, 1, 1]] # 16, Y4, lateral_convs.1- [-1, 1, nn.Upsample, [None, 2, "nearest"]]- [4, 1, Conv, [256, 1, 1, None, 1, 1, False]] # 18 input_proj.0- [[-2, -1], 1, Concat, [1]] # cat backbone P4- [-1, 2, RepC4, [256]] # X3 (20), fpn_blocks.1- [-1, 1, Conv, [256, 3, 2]] # 22, downsample_convs.0- [[-1, 16], 1, Concat, [1]] # cat Y4- [-1, 2, RepC4, [256]] # F4 (23), pan_blocks.0- [-1, 1, Conv, [256, 3, 2]] # 24, downsample_convs.1- [[-1, 11], 1, Concat, [1]] # cat Y5- [-1, 2, RepC4, [256]] # F5 (26), pan_blocks.1- [[20, 23, 26], 1, RTDETRDecoder, [nc]] # Detect(P3, P4, P5)

# ⭐⭐Powered by https://blog.csdn.net/StopAndGoyyy, 技术指导QQ:2668825911⭐⭐

2.2 修改train.py文件

创建Train_RT脚本用于训练。

from ultralytics.models import RTDETR

import os

os.environ['KMP_DUPLICATE_LIB_OK'] = 'True'if __name__ == '__main__':model = RTDETR(model='ultralytics/cfg/models/rt-detr/rtdetr-l.yaml')# model.load('yolov8n.pt')model.train(data='./data.yaml', epochs=2, batch=1, device='0', imgsz=640, workers=2, cache=False,amp=True, mosaic=False, project='runs/train', name='exp')

在train.py脚本中填入修改好的yaml路径,运行即可训。