AI大白话(四):自然语言处理——AI是如何理解和生成人类语言的?

🌟引言:

专栏:《AI大白话》

AI大白话(一):5分钟了解AI到底是什么?

AI大白话(二):机器学习——AI是怎么“学习“的?

AI大白话(三):深度学习——AI的‘大脑‘是如何构建的?

大家好!欢迎回到"AI大白话"系列。前面我们聊了AI的基本概念、机器学习的原理和深度学习的"大脑"构建。今天,我们来聊聊一个更贴近我们日常生活的话题:自然语言处理(NLP)——也就是AI如何理解和生成人类语言。

名人说:苔花如米小,也学牡丹开。——袁枚《苔》

创作者:Code_流苏(CSDN)(一个喜欢古诗词和编程的Coder😊)目录

- 一、什么是自然语言处理?

- 二、为什么自然语言处理这么难?

- 三、自然语言处理的基本流程

- 1. 文本预处理:洗脸刷牙

- 2. 文本表示:把文字变成数字

- 3. 文本理解:理解句子的含义

- 4. 文本生成:让AI说人话

- 四、NLP的核心技术演进:从规则到深度学习

- 1. 规则时代:靠人工定规则

- 2. 统计时代:数据说话

- 3. 深度学习时代:模型更强大

- 1️⃣循环神经网络(RNN)和长短期记忆网络(LSTM)

- 2️⃣Transformer:注意力集中

- 3️⃣预训练语言模型:站在巨人肩膀上

- 五、NLP在生活中的应用:无处不在的语言AI

- 1. 智能助手:你的24小时秘书

- 2. 搜索引擎:不只是关键词匹配

- 3. 机器翻译:跨越语言的鸿沟

- 4. 聊天机器人:永不疲倦的客服

- 5. 内容推荐:懂你的阅读偏好

- 6. 智能写作:AI助手帮你写

- 六、自然语言处理的未来发展:更懂人、更像人

- 1. 多模态理解:不只听"说",还看"表情"

- 2. 常识推理:不只是字面意思

- 3. 情感和意图理解:读懂言外之意

- 4. 个性化交流:适应不同人的表达习惯

- 5. 低资源语言支持:关注"小众"语言

- 七、小结:AI理解语言,长路漫漫

很高兴你打开了这篇博客,更多好用的软件工具,请关注我、订阅专栏《AI大白话》,内容持续更新中…

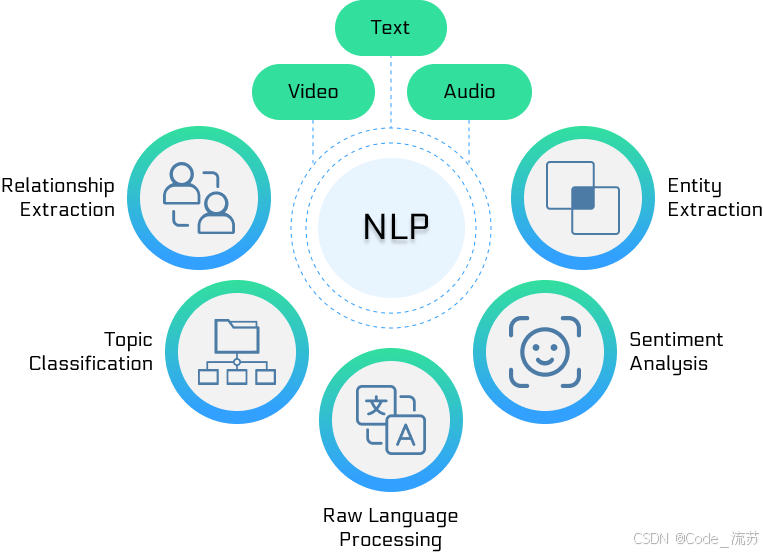

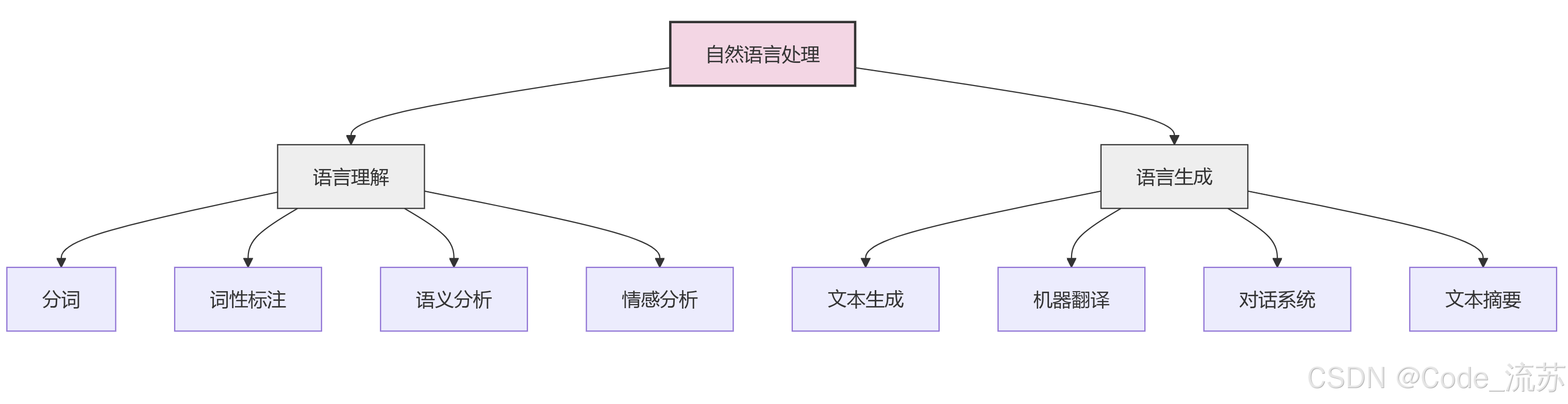

一、什么是自然语言处理?

自然语言处理,简称 NLP,是让计算机能够理解、处理和生成人类语言的技术。

想象一下,你每天都在做的事情:和朋友聊天、阅读新闻、写微信消息、问百度一个问题…这些对我们来说再简单不过的事情,对计算机来说却是巨大的挑战!

为什么呢?

因为人类语言是复杂、多变且充满歧义的。

当我们说 “这家店的苹果真好吃” 时,我们知道是指水果;

当说 “我想买个新苹果手机” 时,我们又知道是指品牌。

而这种看似不起眼的区分,对人类来说很容易,实际上让计算机来理解很困难。

二、为什么自然语言处理这么难?

把人类语言教给计算机,或许比教一个3岁小孩说话还要困难。

主要有这几个原因:

-

语言的歧义性:同一个词或句子可能有多种含义。例如 “方便面” 中的 “方便”,“你懂我意思” 中的 “意思”。

-

语言的复杂性:语法规则复杂,还有大量的特例和习惯用法。

-

上下文依赖:理解一句话常常需要前后文甚至更广泛的知识背景。比如"他很冷",是指天气冷还是性格冷漠?

-

文化和隐含意义:语言中包含大量的文化背景和隐含意义。当我们说"这个人很火",并不是说他被烧着了!

-

语言的变化:语言在不断变化,新词语、新表达方式不断出现。“打call”、"yyds"这些网络用语几年前根本不存在。

三、自然语言处理的基本流程

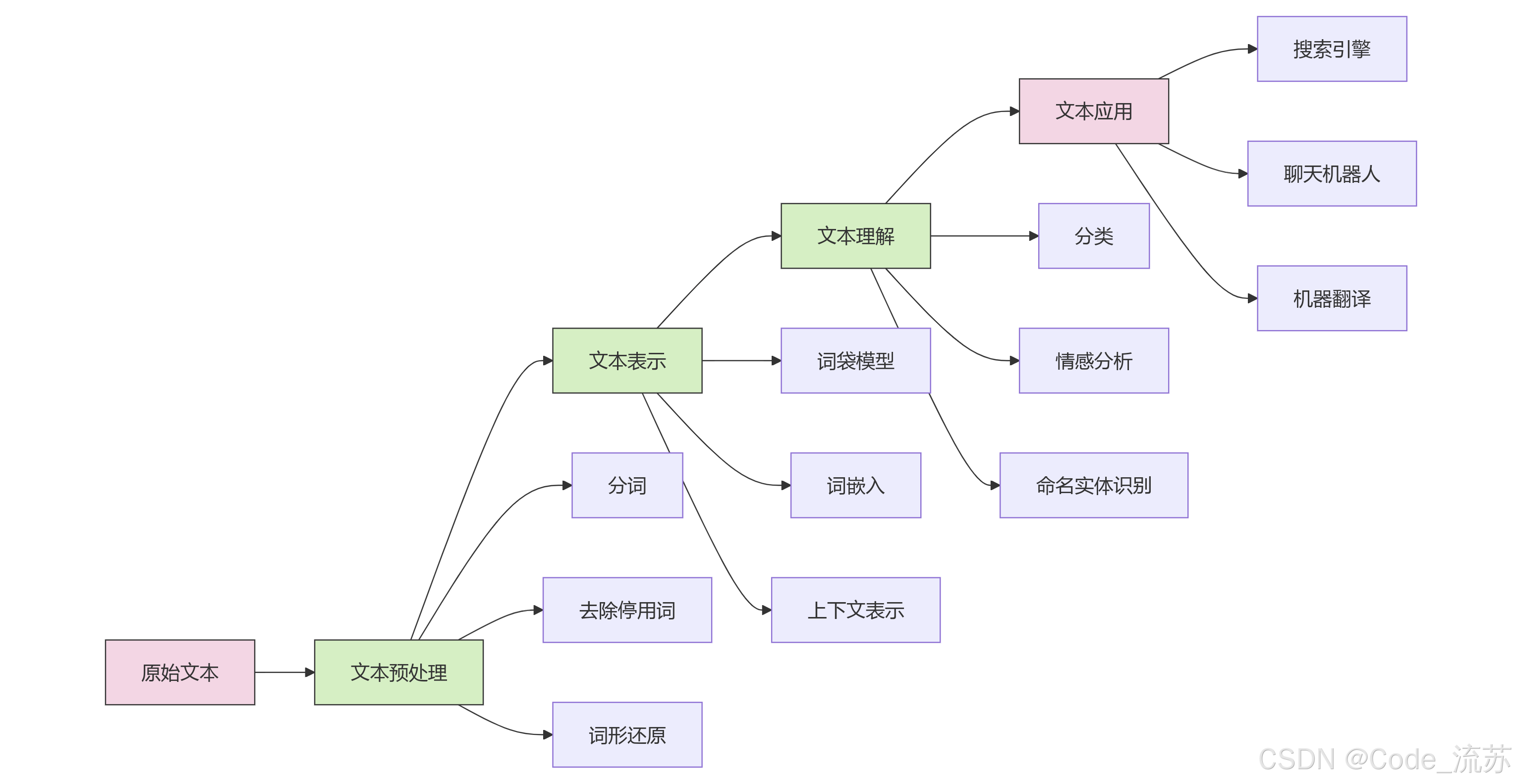

那么,AI是如何一步步学会理解和生成人类语言的呢?

让我们用一个简单的比喻:如果把AI处理语言比作学生做阅读理解题,那么它需要经历以下几个阶段:

1. 文本预处理:洗脸刷牙

就像我们起床后要洗脸刷牙一样,AI在处理文本前,也需要进行"清洁"工作:

-

分词:把一段文本切分成一个个词语。中文分词比英文更难,因为英文单词之间有空格,而中文没有。

例如:“我爱自然语言处理” → “我”、“爱”、“自然”、“语言”、“处理” -

去除停用词:去掉没有实质意义的词,如"的"、“了”、"是"等。

-

词形还原:将不同形式的词还原为基本形式,如"跑步"、“跑”、"跑着"都还原为同一个词。

-

词性标注:标记每个词的词性,如名词、动词、形容词等。

2. 文本表示:把文字变成数字

计算机不认识文字,只认识数字。

所以我们需要把文字转换成数字或向量:

-

独热编码(One-hot):用一个很长的向量表示一个词,向量中只有一个位置是1,其他位置都是0。简单但效率低。

-

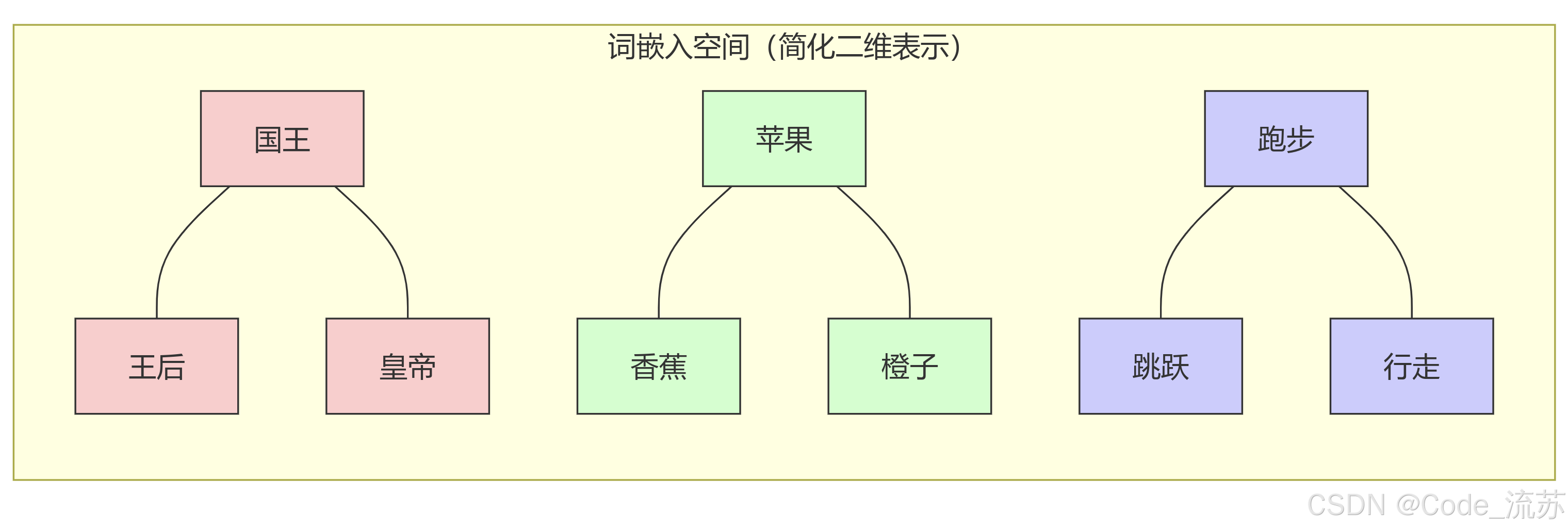

词嵌入(Word Embedding):用一个密集的向量(比如300个数字)表示一个词,相似的词在向量空间中距离更近。

例如,"国王"和"王后"的向量会比"国王"和"苹果"的向量更接近。

我们可以把词嵌入 想象成 给每个词分配一个坐标位置,相似含义的词会被安排在相近的位置。

3. 文本理解:理解句子的含义

有了文本表示后,AI就开始尝试理解文本的含义:

- 句法分析:分析句子的结构,找出主语、谓语、宾语等成分。

- 语义分析:理解词语和句子的含义。

- 命名实体识别:识别文本中的人名、地名、组织名等实体。

- 关系抽取:找出实体之间的关系,如"马云创立了阿里巴巴"中,马云和阿里巴巴之间是"创立"关系。

4. 文本生成:让AI说人话

理解是输入,生成是输出。

让 AI 能够生成人类语言的文本:

- 语言模型:根据前面的词预测下一个最可能出现的词。

- 机器翻译:将一种语言翻译成另一种语言。

- 文本摘要:自动提取或生成文本的摘要。

- 对话系统:能与人类进行对话的系统,如聊天机器人。

四、NLP的核心技术演进:从规则到深度学习

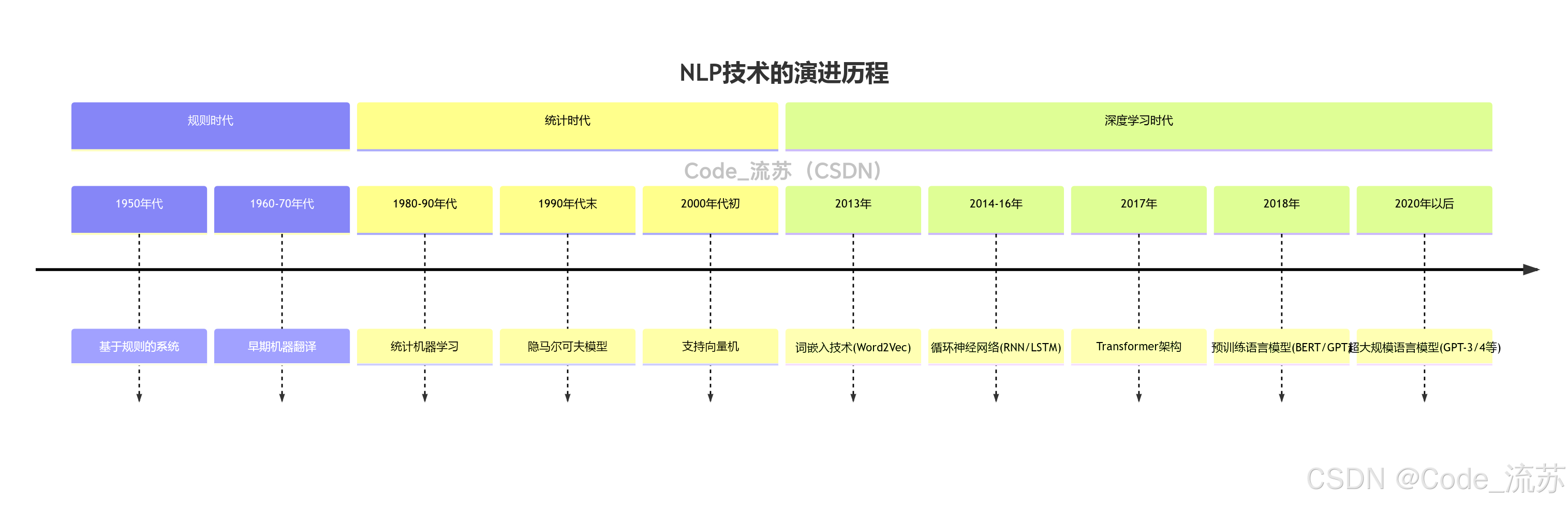

自然语言处理技术经历了几次重大变革

就像从自行车到汽车再到飞机的进化:

1. 规则时代:靠人工定规则

早期的 NLP系统 主要依靠人工编写的规则。

就像教小孩子说话:“见到人要说你好👋”、"问你问题要回答"这样的规则。

这种方法的问题是:人类语言的规则太多太复杂,无法全部编写出来,而且规则之间可能相互矛盾🙅♀️。

2. 统计时代:数据说话

后来,研究者转向统计方法,利用大量文本数据来学习语言的规律。比如通过统计发现"苹果"后面最常出现的词是"手机"、"公司"或"好吃"等。

这就像通过观察大量案例来总结规律,而不是事先制定规则✅

3. 深度学习时代:模型更强大

最近十年,深度学习技术让NLP取得了突破性进展。

让我们来看几个重要的技术:

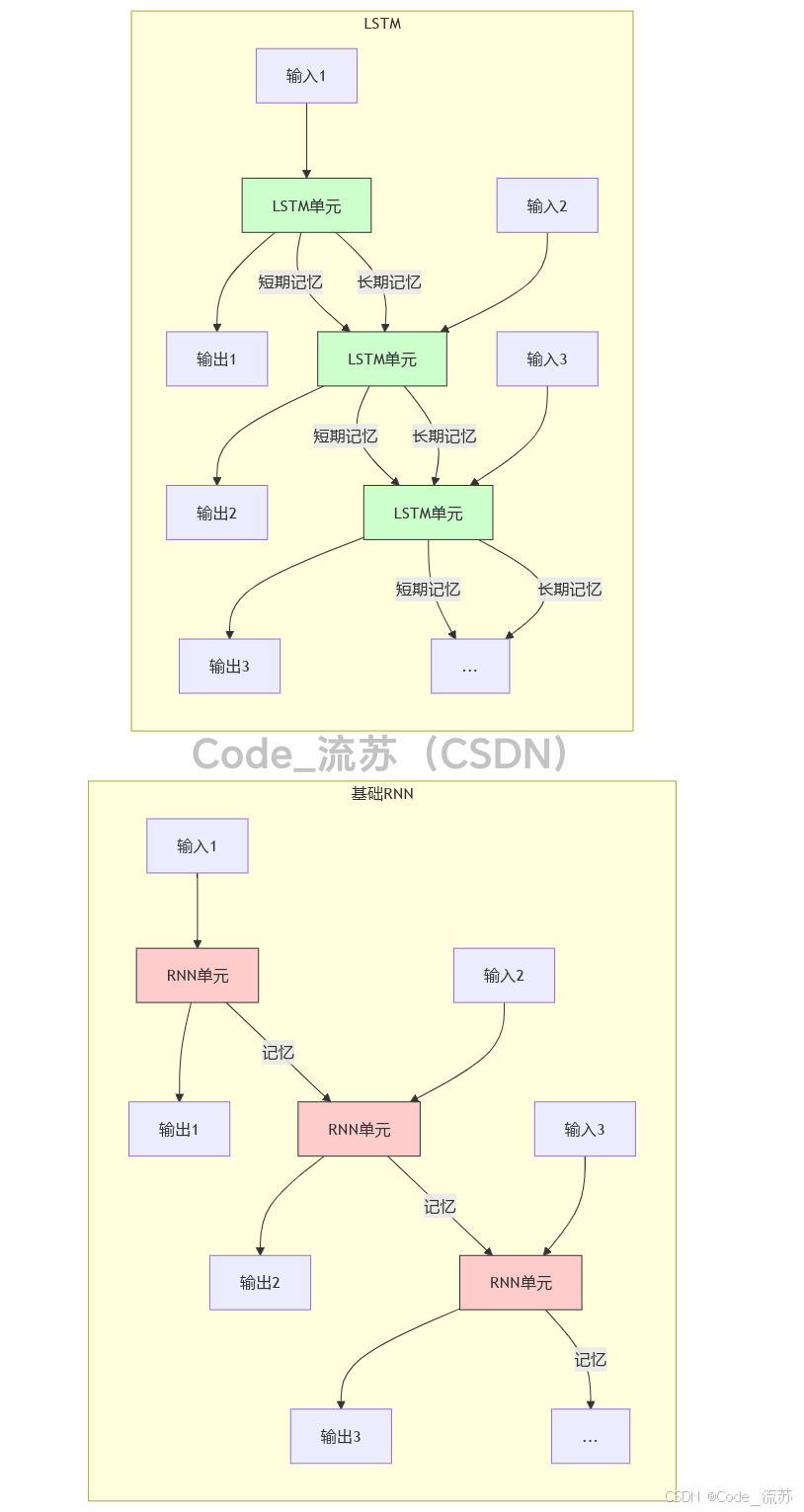

1️⃣循环神经网络(RNN)和长短期记忆网络(LSTM)

这类网络能够"记住"之前看到的内容,适合处理序列数据(如文本)。就像我们阅读一本书,会记住前面的内容来理解后面的情节。

但是,这类网络在处理长文本时,容易"忘记"较早的信息。

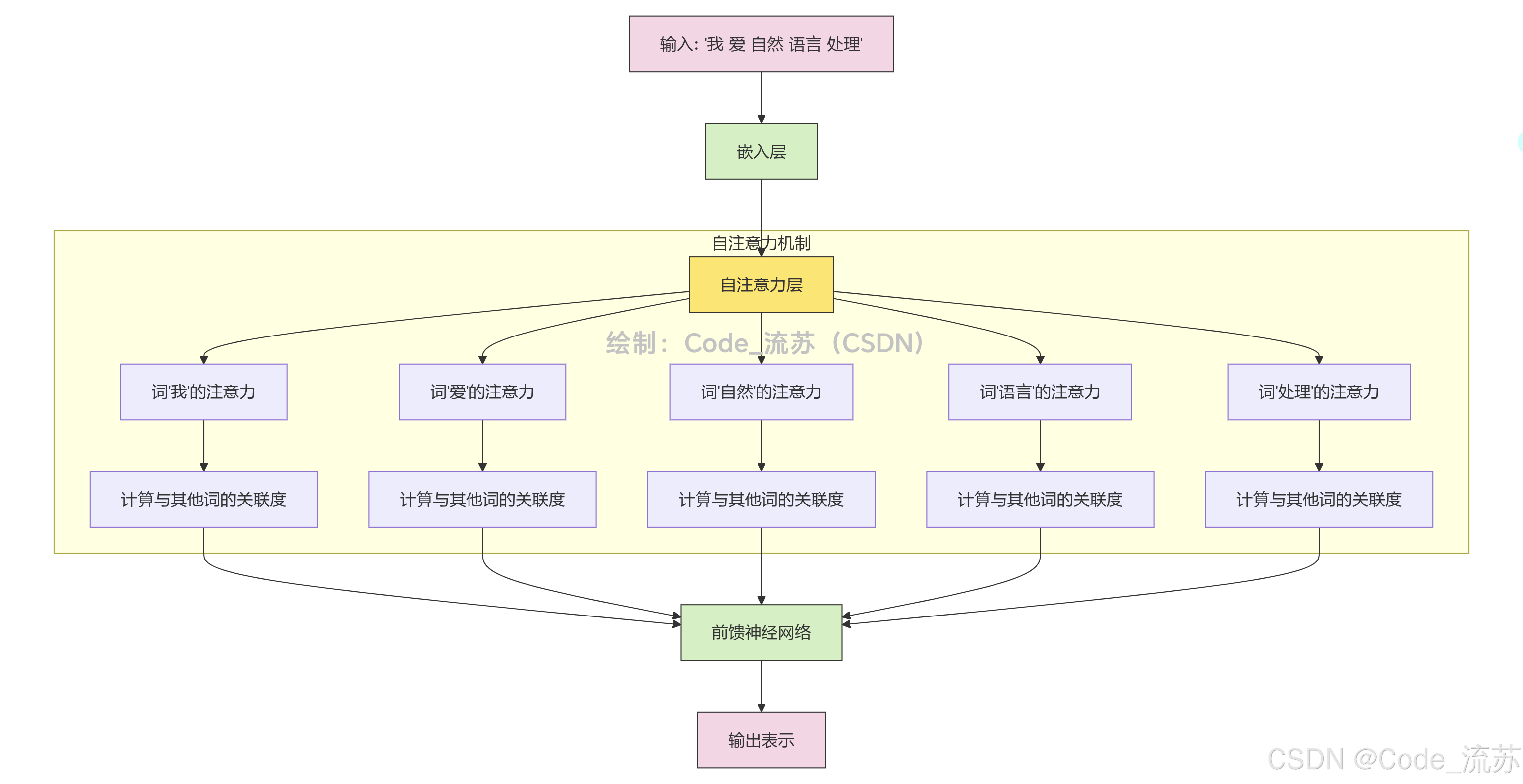

2️⃣Transformer:注意力集中

2017年,Google提出了 Transformer 架构,它的核心是"自注意力机制"(Self-Attention)。这个机制让模型能够同时关注句子中的所有词,而不仅仅是前面的词。

就像我们能够在阅读一篇文章时,根据需要快速回看前面的内容或跳到后面,而不必严格按顺序阅读。

3️⃣预训练语言模型:站在巨人肩膀上

最近几年,预训练语言模型(如BERT、GPT系列)成为NLP的主流。

这些模型首先在海量文本上预训练,学习语言的一般知识,然后再针对特定任务微调。

这就像人类先学习基础知识,再学习专业技能一样。这种方法极大提高了NLP的效果。

预训练语言模型的两大代表:

- BERT:擅长理解句子含义,特别适合阅读理解、问答等任务。

- GPT系列:擅长生成连贯的文本,适合写作、对话等任务。

五、NLP在生活中的应用:无处不在的语言AI

NLP技术已经渗透到我们生活的方方面面,下面用具体例子来说明:

1. 智能助手:你的24小时秘书

小爱同学、Siri、小度等智能助手可以理解你的语音指令,帮你设闹钟、播放音乐、查询天气等。

它们背后用到了语音识别(将语音转为文本)和 自然语言理解(理解文本含义)技术。

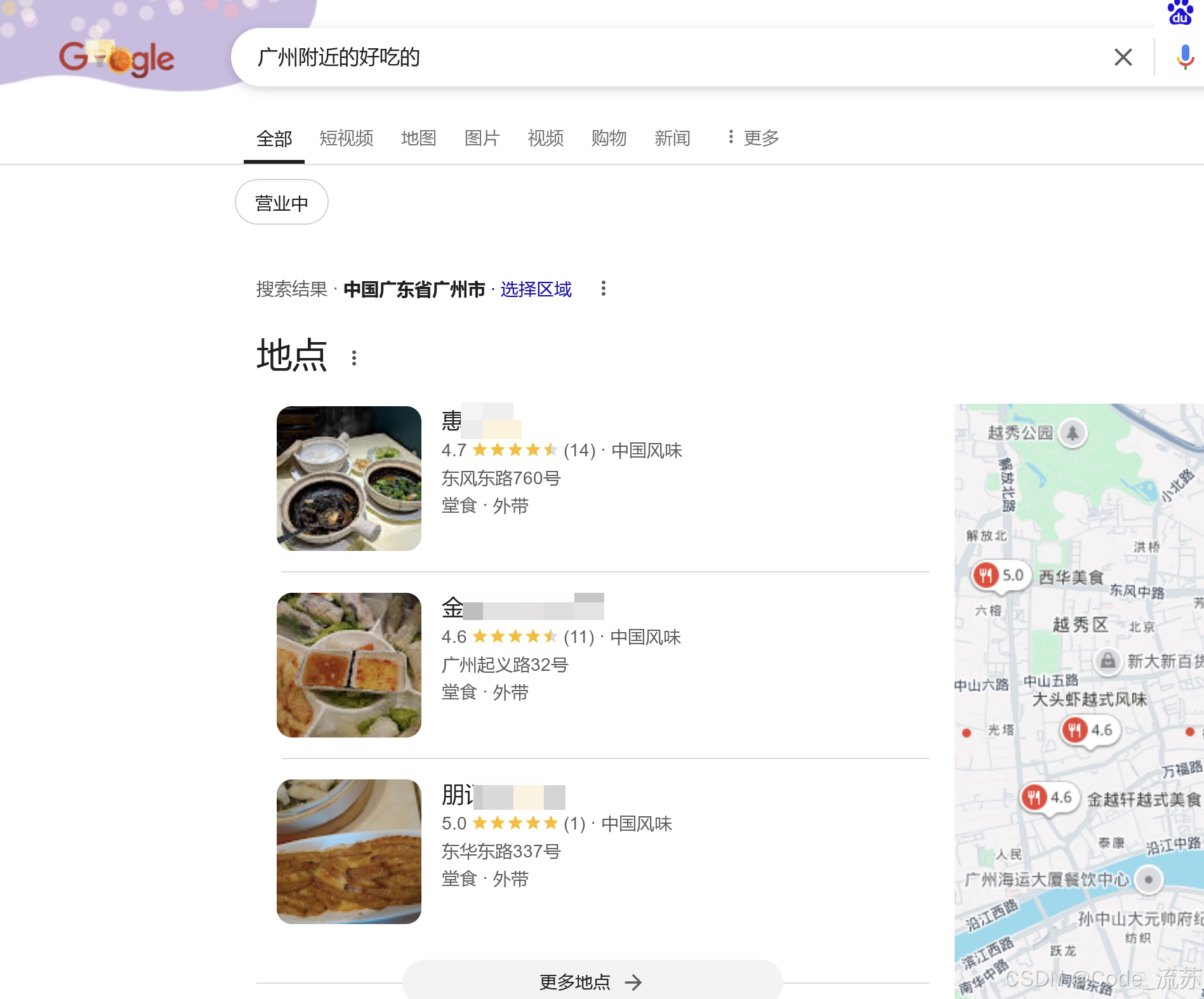

2. 搜索引擎:不只是关键词匹配

现代搜索引擎不只是简单地匹配关键词,还能理解你的搜索意图。

例如,当你搜索 “苹果营养价值” 时,搜索引擎知道你想了解水果,而不是手机或公司;

当你搜索 “附近的好吃的” 时,它能理解你想找餐厅。

3. 机器翻译:跨越语言的鸿沟

谷歌翻译、百度翻译等服务能够在不同语言之间进行翻译。

现代翻译系统已经从早期的"词对词"翻译,进化到能够理解上下文的神经网络翻译。

4. 聊天机器人:永不疲倦的客服

很多网站和APP都有 聊天机器人客服 ,它们能够回答常见问题,处理简单请求,甚至进行情感交流。

5. 内容推荐:懂你的阅读偏好

今日头条、微信公众号、抖音等平台能够根据你的阅读习惯和兴趣,推荐你可能感兴趣的内容。

这背后用到了 文本分类、用户画像 等技术。

6. 智能写作:AI助手帮你写

各种AI写作助手可以帮助你撰写邮件、文章、广告文案等。它们能根据你的简单提示,生成流畅的文本。

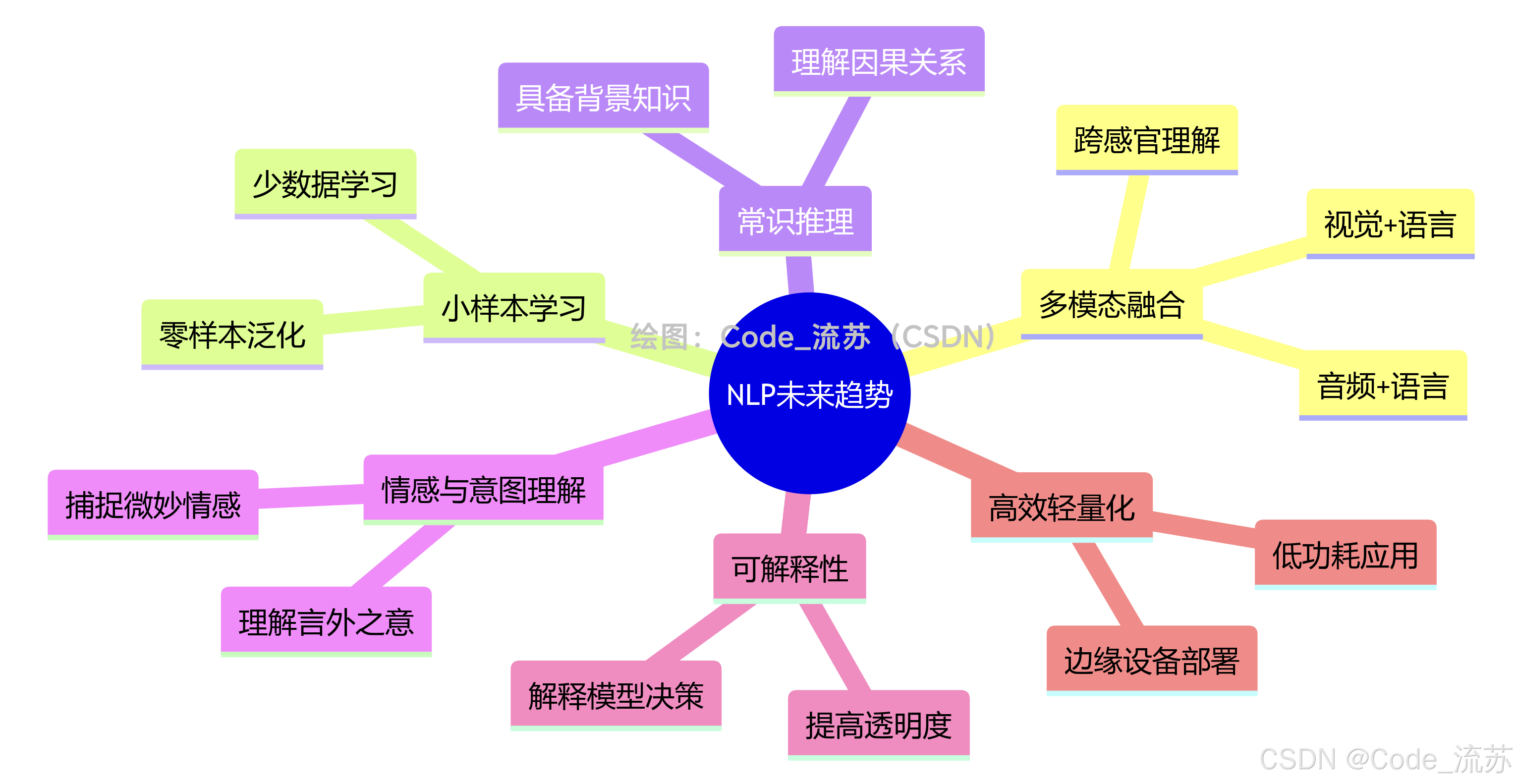

六、自然语言处理的未来发展:更懂人、更像人

NLP技术正在快速发展,未来可能的趋势包括:

1. 多模态理解:不只听"说",还看"表情"

未来的AI不仅能理解文本,还能结合图像、视频、音频等多种模态的信息,实现更全面的理解。就像人类沟通不仅靠语言,还靠表情、动作等。

2. 常识推理:不只是字面意思

未来的NLP模型将具备更多常识知识和推理能力。比如理解"他站在椅子上换灯泡"这句话时,知道人需要站高一点才能够到灯泡,椅子可以提供高度等常识。

3. 情感和意图理解:读懂言外之意

未来的AI将更善于理解人类的情感和意图,包括讽刺、幽默、隐喻等复杂表达。比如理解"今天天气真好啊"在下雨天可能是反话。

4. 个性化交流:适应不同人的表达习惯

不同人有不同的表达习惯和用词偏好。未来的AI将能够适应不同用户的语言风格,提供更个性化的服务。

5. 低资源语言支持:关注"小众"语言

目前NLP技术在英语、中文等主流语言上发展较好,但对于使用人数较少的语言支持有限。未来将更加关注这些"小众"语言。

七、小结:AI理解语言,长路漫漫

尽管NLP技术已经取得了令人瞩目的进步,但与人类语言能力相比,仍有很长的路要走。语言是人类智能的核心,也是AI通向通用智能的重要一步。

当下的NLP系统已经能够在特定任务上表现出色,但在真正理解语言的深层含义、掌握常识知识、进行创造性思维等方面,与人类相比还有很大差距。

未来,随着技术的不断进步,我们期待AI能够更好地理解人类语言,成为我们更得力的助手和伙伴。

希望这篇文章能帮助你了解自然语言处理的基本原理和应用。如果你有任何问题或建议,欢迎在评论区留言交流!

创作者:Code_流苏(CSDN)(一个喜欢古诗词和编程的Coder😊)