第二十一周 学习周报

摘要

cfd中学习了向量的基本运算、点积和叉积等,梯度场的基本性质和运算和散度场的基本性质和运算。深度学习,本周学习了生成式对抗网络(GAN)的基本原理与工作机制。生成对抗网络的核心在于生成器与判别器的对抗优化:生成器将简单分布的噪声转化为复杂数据,判别器则评估样本真伪。二者通过迭代训练相互促进,最终生成高质量数据。

Abstract

In CFD, I studied fundamental vector operations (dot product and cross product), basic properties and operations of gradient fields, and divergence fields. In deep learning, this week I focused on the fundamental principles and working mechanism of Generative Adversarial Networks (GANs). The core concept lies in the adversarial optimization between the generator and the discriminator: the generator transforms noise from a simple distribution into complex data, while the discriminator evaluates the authenticity of samples. Through iterative training, the two components mutually enhance each other, ultimately producing high-quality data.

一、深度学习

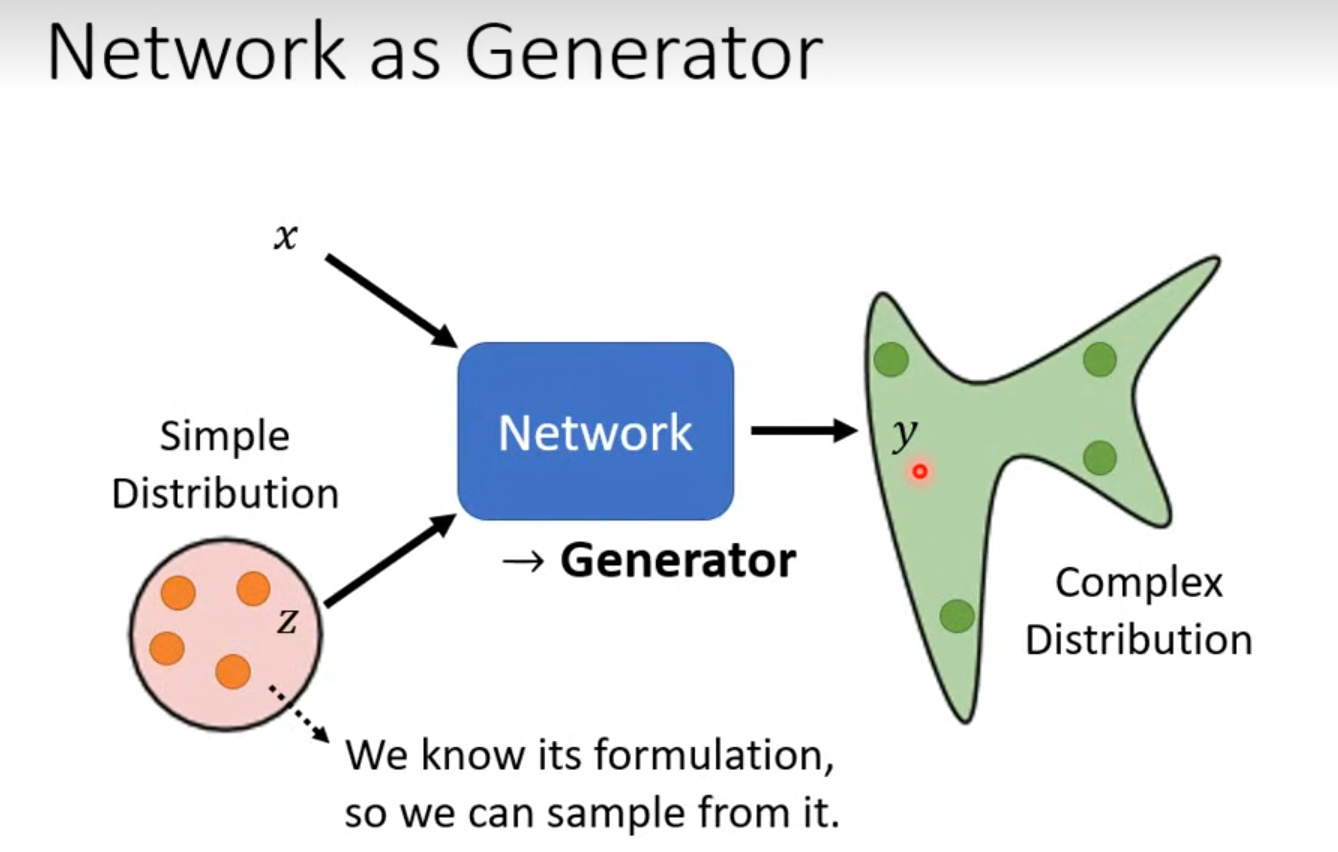

阐释了生成式网络的核心工作机制。网络作为生成器(Generator)将来自简单分布(Simple Distribution)的采样点z(已知数学形式,可轻松采样)与可能的外部输入x共同输入网络,通过非线性变换映射到复杂分布(Complex Distribution)的输出y。其核心逻辑是:利用可解析描述的简单分布(如高斯分布)作为输入源,通过神经网络学习从简单分布到目标复杂分布(如图像、文本分布)的变换函数,从而实现对复杂数据分布的生成与采样。

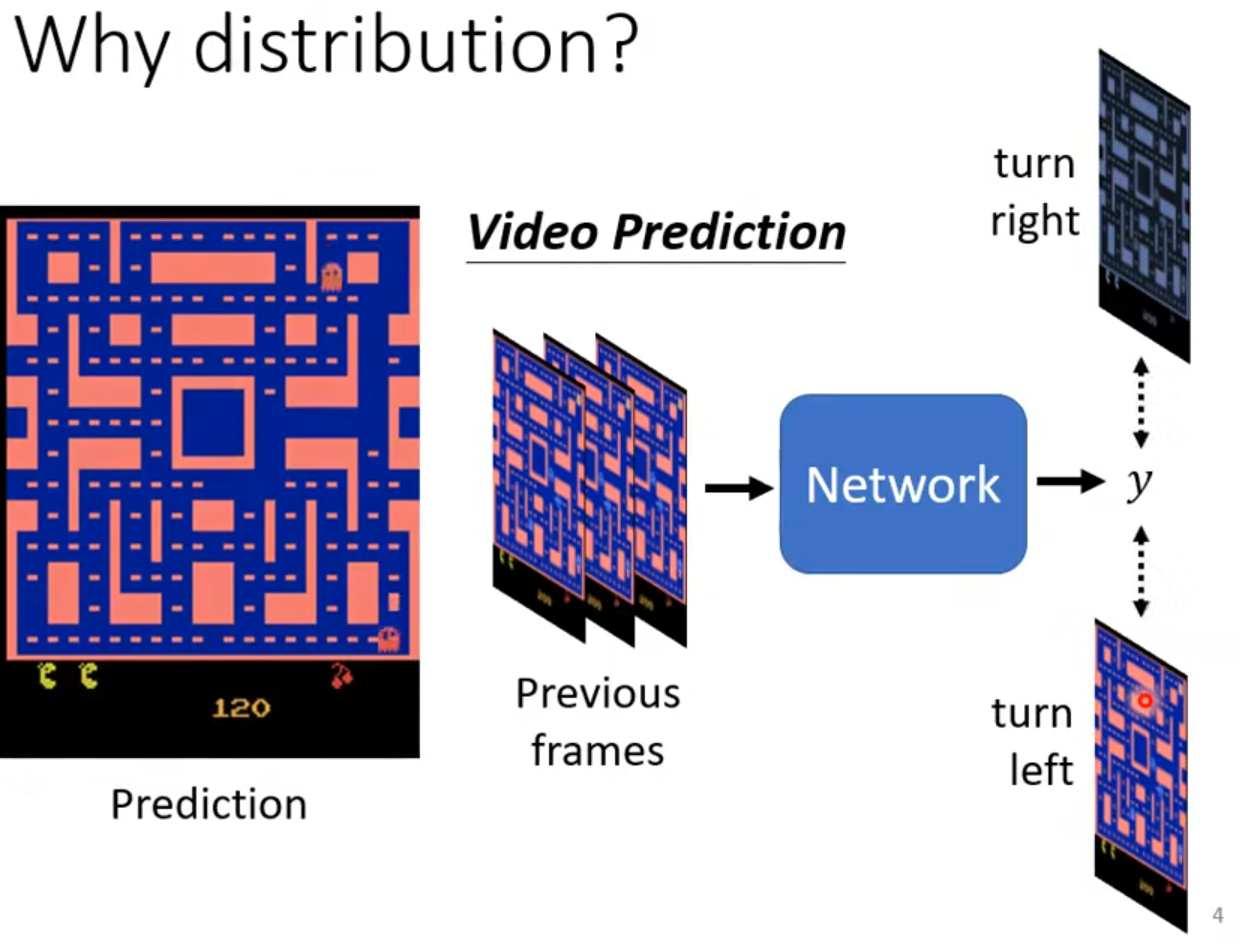

阐释了生成式网络的核心工作机制。网络作为生成器(Generator)将来自简单分布(Simple Distribution)的采样点z(已知数学形式,可轻松采样)与可能的外部输入x共同输入网络,通过非线性变换映射到复杂分布(Complex Distribution)的输出y。其核心逻辑是:利用可解析描述的简单分布(如高斯分布)作为输入源,通过神经网络学习从简单分布到目标复杂分布(如图像、文本分布)的变换函数,从而实现对复杂数据分布的生成与采样。 揭示了生成式模型中概率分布的核心价值。标题“Why distribution?”引导思考确定性预测的局限:在吃豆人游戏帧预测任务中,若仅输出单一结果(如“右转”),无法涵盖其他合理可能性(如“左转”)。网络接收历史帧序列后,通过条件变量y(如控制指令)生成多分支预测结果,表明单一输入可能对应多个合理输出。这种设计突破传统确定性模型的局限,通过输出分布刻画现实世界的不确定性(如智能体决策的多种可能路径)。图中并排展示的两种预测结果,直观体现分布建模的本质——用概率描述所有可能性的集合,而非强迫模型做非此即彼的硬决策。

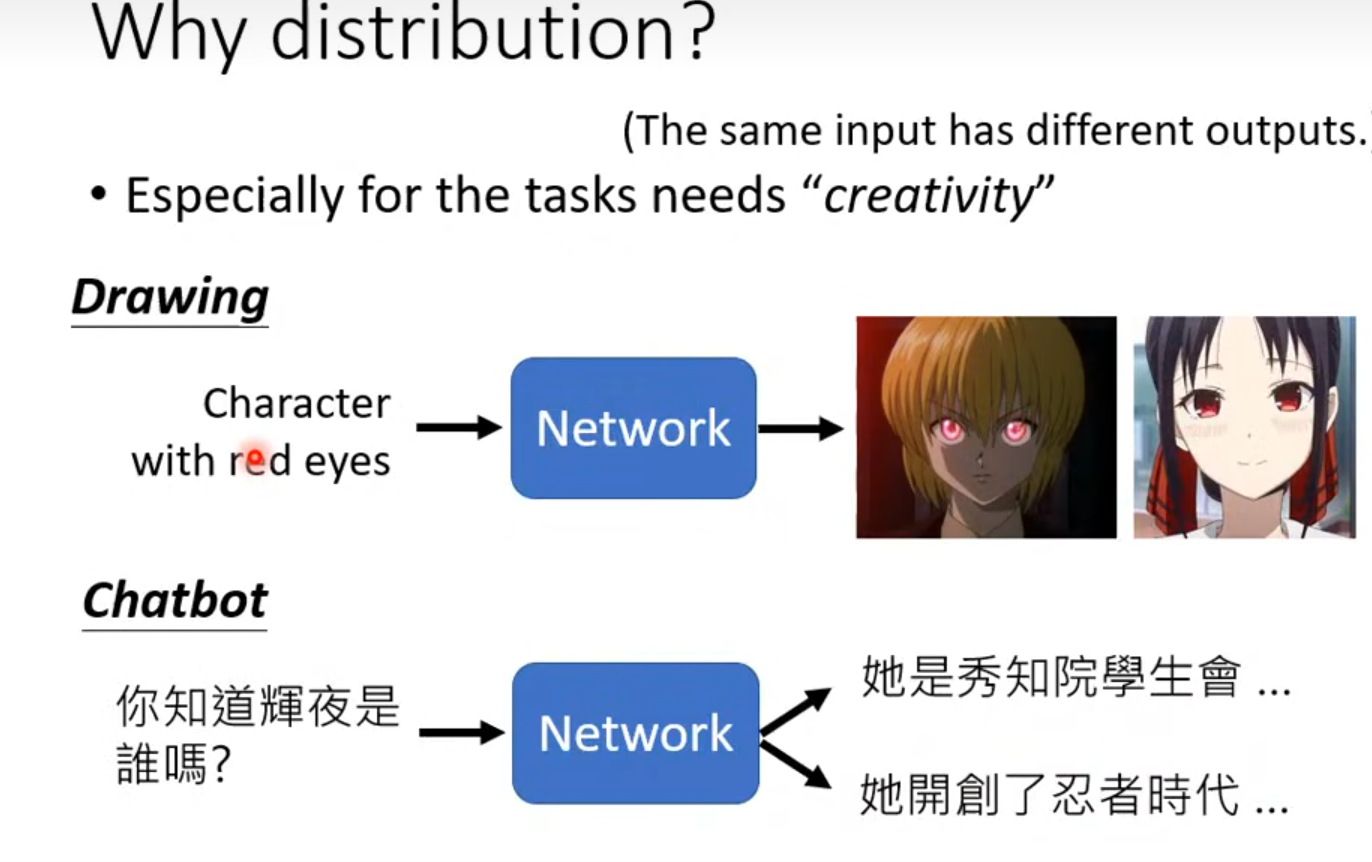

揭示了生成式模型中概率分布的核心价值。标题“Why distribution?”引导思考确定性预测的局限:在吃豆人游戏帧预测任务中,若仅输出单一结果(如“右转”),无法涵盖其他合理可能性(如“左转”)。网络接收历史帧序列后,通过条件变量y(如控制指令)生成多分支预测结果,表明单一输入可能对应多个合理输出。这种设计突破传统确定性模型的局限,通过输出分布刻画现实世界的不确定性(如智能体决策的多种可能路径)。图中并排展示的两种预测结果,直观体现分布建模的本质——用概率描述所有可能性的集合,而非强迫模型做非此即彼的硬决策。 阐释了生成式人工智能输出多样性的必要性。标题"为何需要分布输出?"点明核心思想:当处理需要创造力的任务时,同一输入应能产生不同的合理输出。绘画案例显示,输入"红眼角色"指令后,网络可生成金发暗黑风格与黑发华丽风格两种迥异的角色设计;对话案例则表明,对于"你知道辉夜是谁吗"的提问,网络既可回答"秀知院学生会"的现代背景,也可给出"开创忍者时代"的历史设定。这种分布输出机制突破传统模型的单一答案局限,通过输出概率分布来模拟人类创造性思维的多解特性,使AI在艺术创作、开放对话等场景中具备更自然的应变能力。

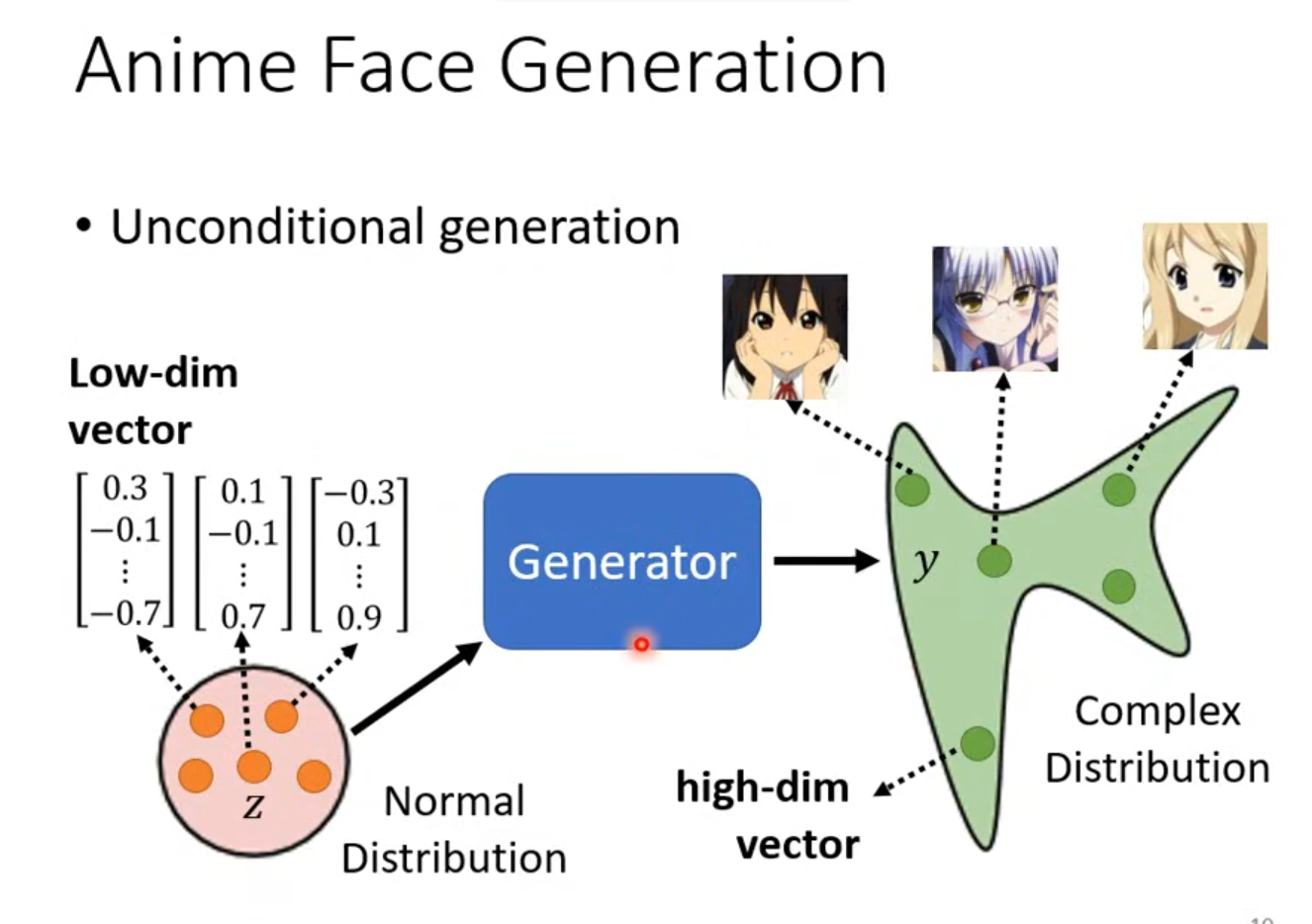

阐释了生成式人工智能输出多样性的必要性。标题"为何需要分布输出?"点明核心思想:当处理需要创造力的任务时,同一输入应能产生不同的合理输出。绘画案例显示,输入"红眼角色"指令后,网络可生成金发暗黑风格与黑发华丽风格两种迥异的角色设计;对话案例则表明,对于"你知道辉夜是谁吗"的提问,网络既可回答"秀知院学生会"的现代背景,也可给出"开创忍者时代"的历史设定。这种分布输出机制突破传统模型的单一答案局限,通过输出概率分布来模拟人类创造性思维的多解特性,使AI在艺术创作、开放对话等场景中具备更自然的应变能力。 整个过程就像变魔术:左边是一个简单的正态分布(粉色区域),里面有很多低维向量(像一堆数字配方),这些向量本身看不出任何图像信息。中间的蓝色生成器就像一个神奇的转换器,它的任务就是把这些看似随机的数字配方,加工转换成右边复杂的高维向量。最终,这些高维向量就变成了一张张具体的动漫人脸(复杂分布),而且每次用不同的数字配方,就能生成不同风格的人物头像。简单说,就是生成器学会了把乱码一样的随机数字,“翻译”成有意义的、多样化的人脸图像。

整个过程就像变魔术:左边是一个简单的正态分布(粉色区域),里面有很多低维向量(像一堆数字配方),这些向量本身看不出任何图像信息。中间的蓝色生成器就像一个神奇的转换器,它的任务就是把这些看似随机的数字配方,加工转换成右边复杂的高维向量。最终,这些高维向量就变成了一张张具体的动漫人脸(复杂分布),而且每次用不同的数字配方,就能生成不同风格的人物头像。简单说,就是生成器学会了把乱码一样的随机数字,“翻译”成有意义的、多样化的人脸图像。

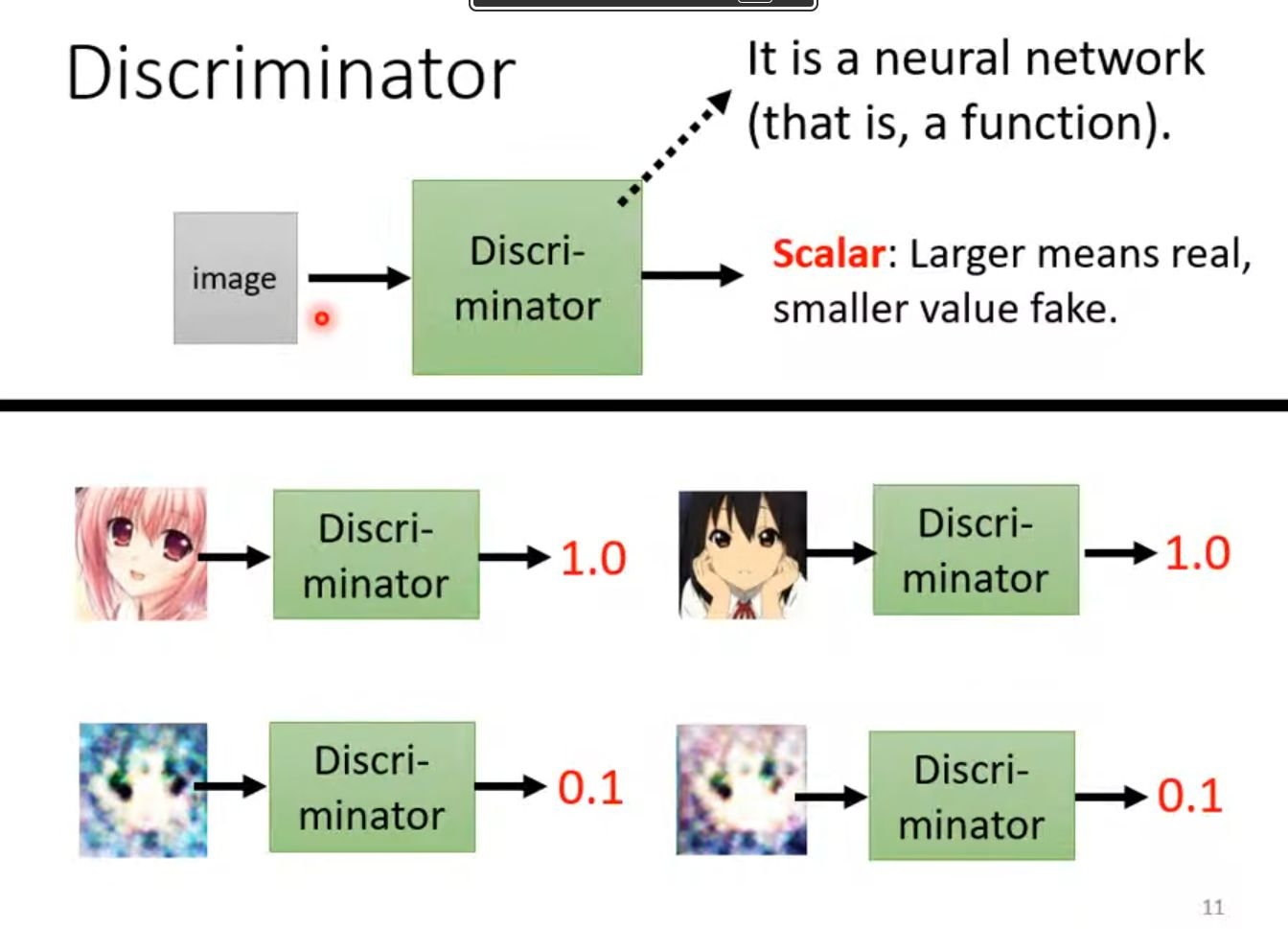

这张图清晰地解释了生成对抗网络(GAN)中判别器(Discriminator)的工作原理。判别器本质上是一个神经网络,它的核心功能是充当“鉴定师”:对输入的一张图像进行真伪判断,并输出一个标量值(一个数字)。这个输出值的大小代表其判断结果——值越大,表示判别器认为图像越“真实”;值越小,则表示它认为图像越“虚假”或“伪造”。当输入一张清晰、逼真的动漫头像时,判别器输出了很高的值 1.0,表明它确信这是张真图。当输入一张模糊、质量很差的动漫头像时,判别器则输出了很低的值 0.1,表明它认为这张图很可能是伪造的或质量不佳。简而言之,判别器就是一个通过学习来区分真实数据与生成数据好坏的二分类器。

展示了生成对抗网络(GAN)的核心思想与迭代训练过程。其基本框架包含两个相互对抗的神经网络:生成器负责从随机噪声中生成图像,而判别器则负责判断输入的图像是来自真实数据集还是生成器制造的“假货”。图中的关键线索在于三个版本的迭代变化——从v1到v3,生成器输出的图像从模糊的色块逐步演进为清晰的动漫人脸,表明通过对抗学习,生成器的伪造能力不断增强;与此同时,判别器也在持续进化,以提升鉴别真伪的难度。这种“道高一尺,魔高一丈”的动态博弈过程,正是“对抗”一词的由来,也是GAN能够生成高质量数据的根本动力。最终目标是训练出一个强大的生成器,使其输出结果与真实图像难以区分。

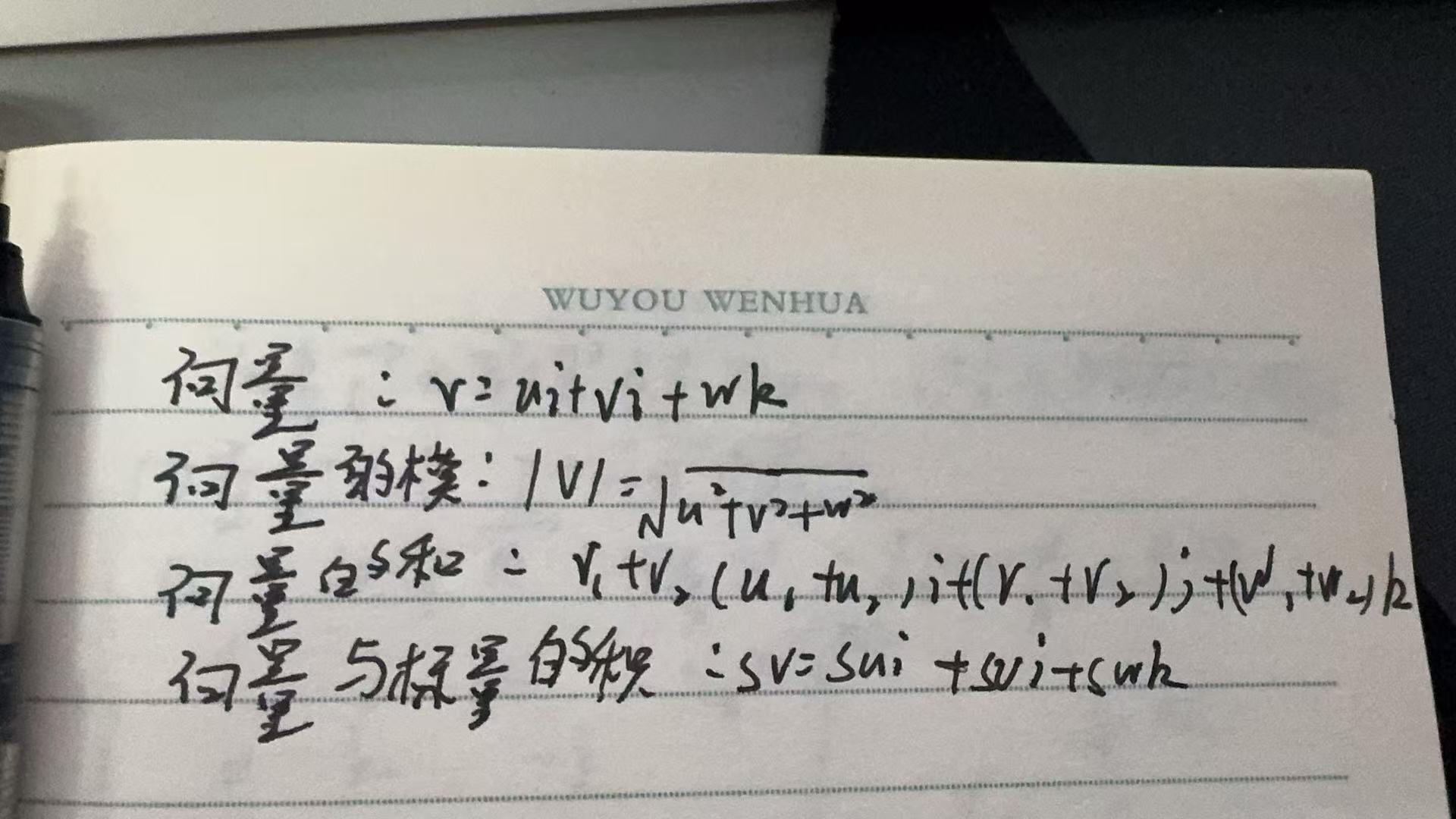

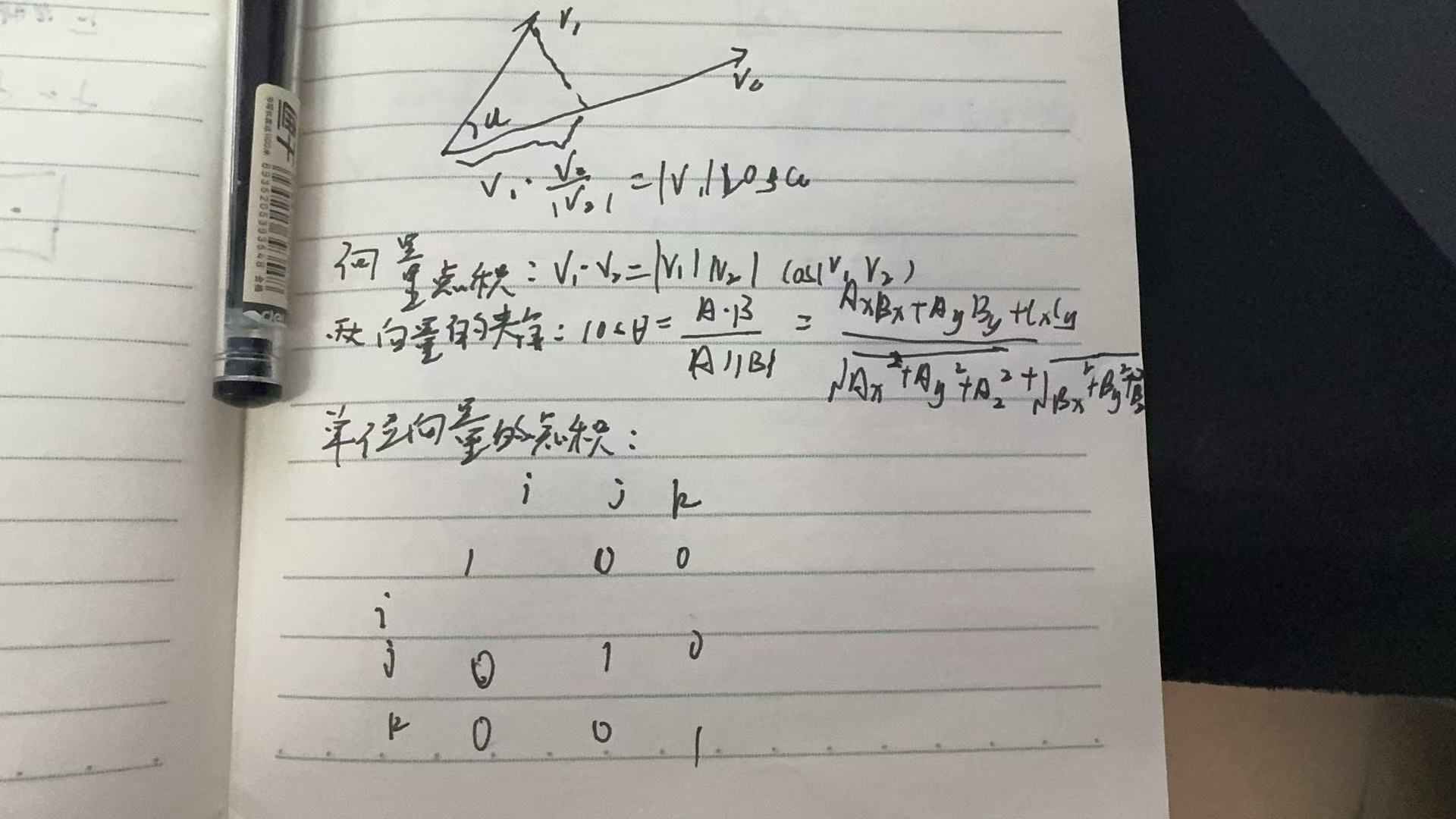

二、CFD

标量:仅有大小,没有方向的物理量

向量:既有大小,也有方向的物理量

张量:一个可用来表示在一些向量、标量和其他张量之间的线性关系的多线性函数。张量可以认为是标量和向量概念的延伸,标量为零阶张量,向量为1阶张量,也存在更高阶的张量

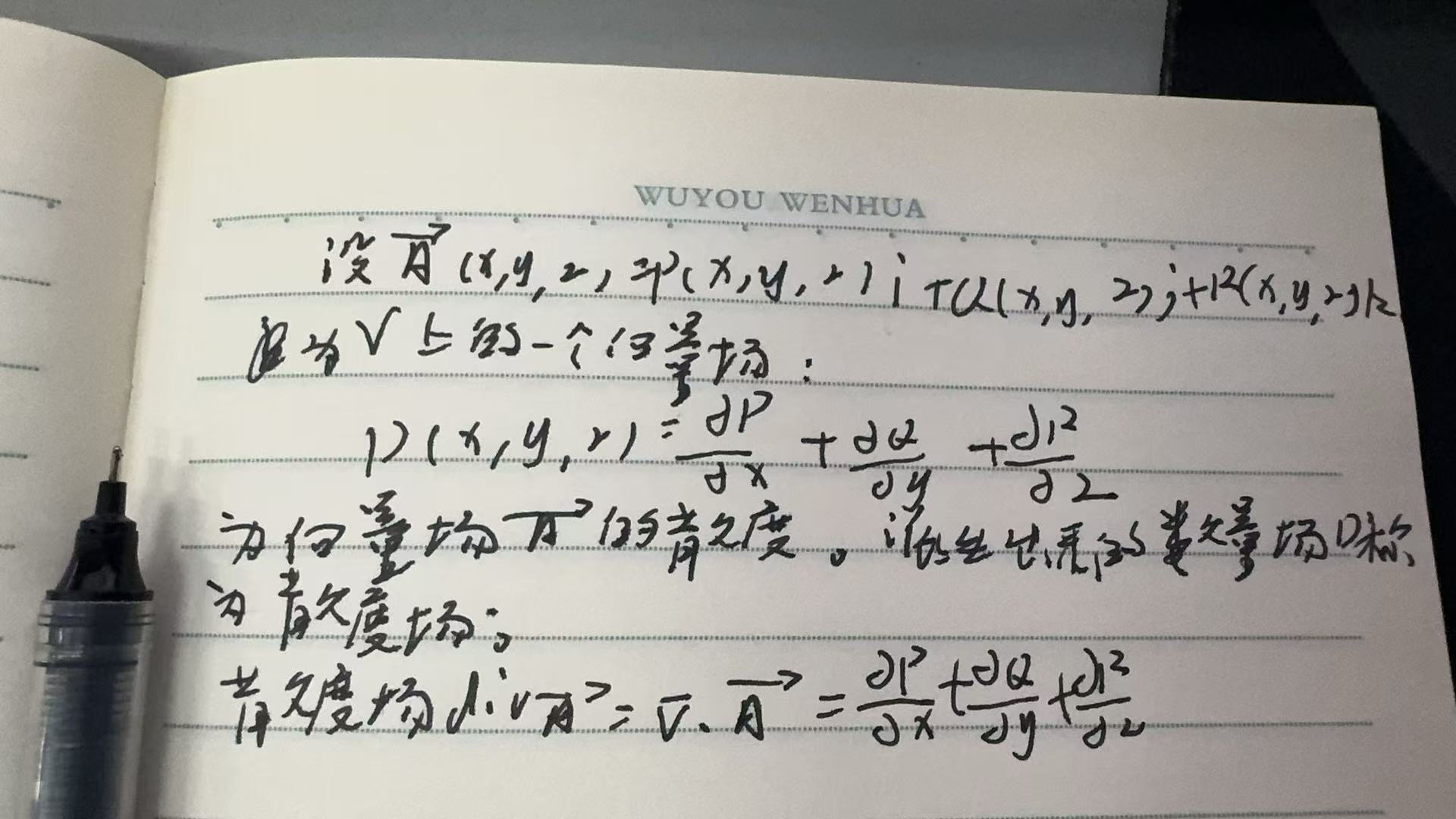

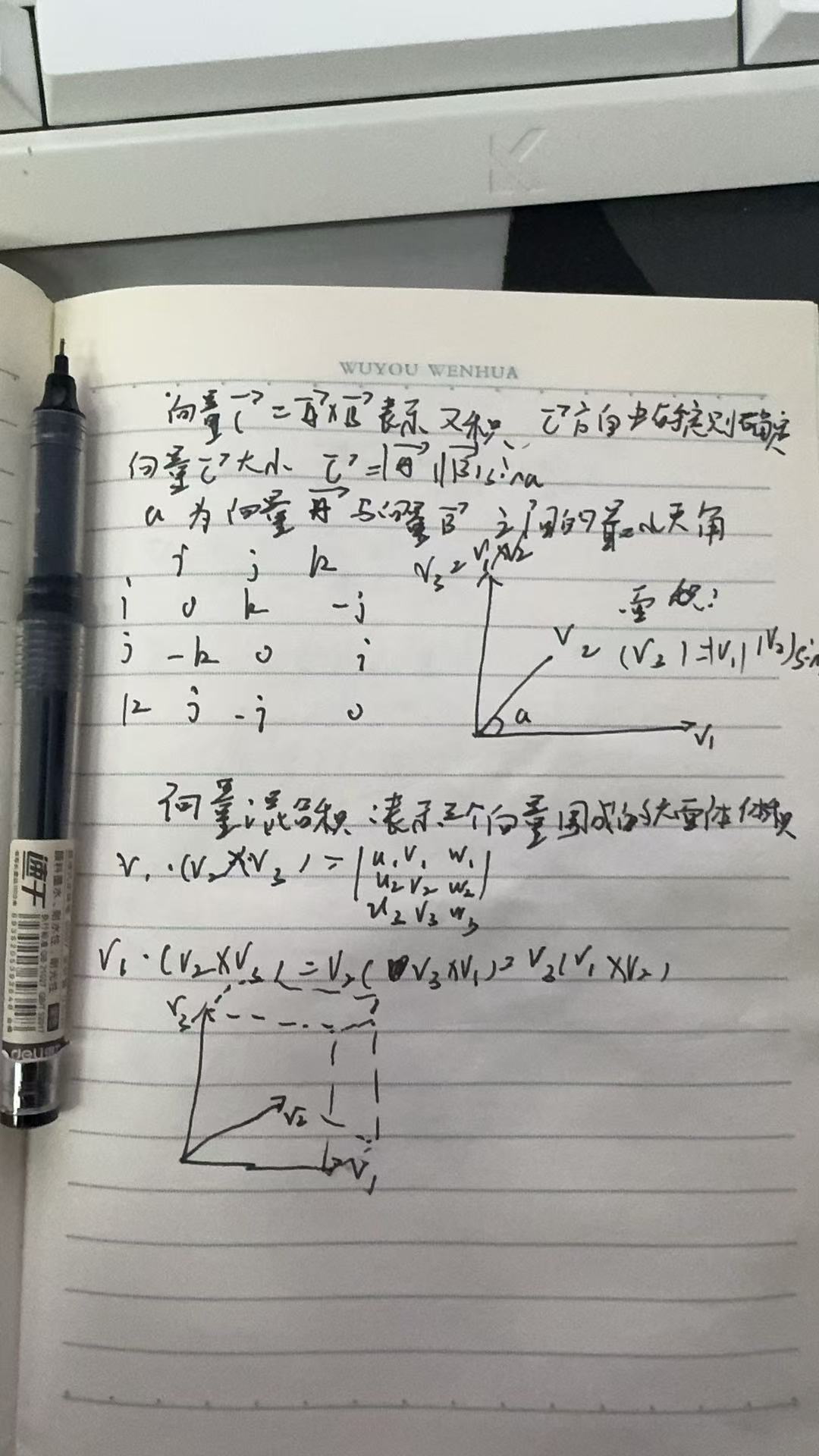

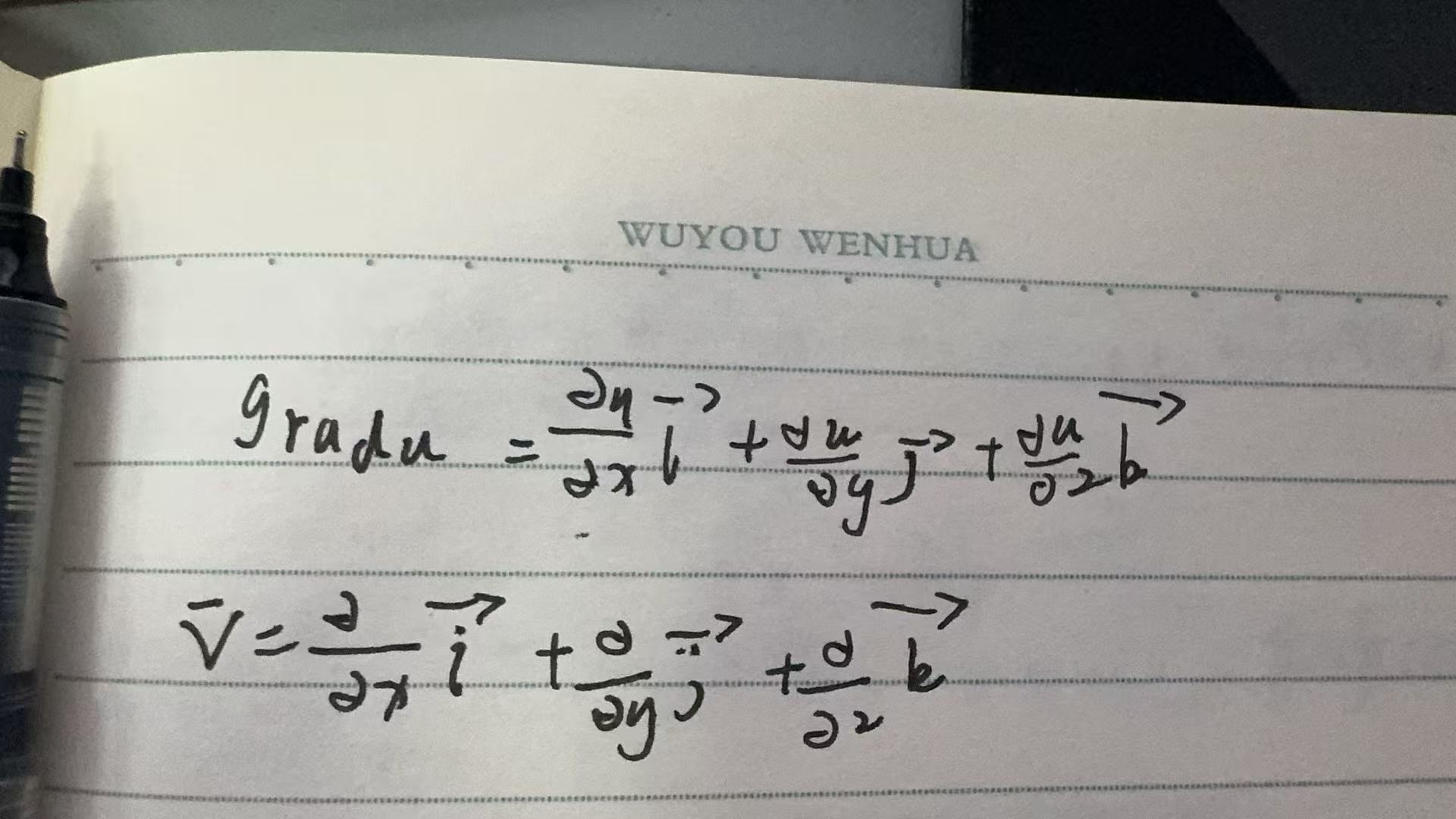

梯度:由数量函数u(x,y,z)所定义的向量函数:(第一个式子)

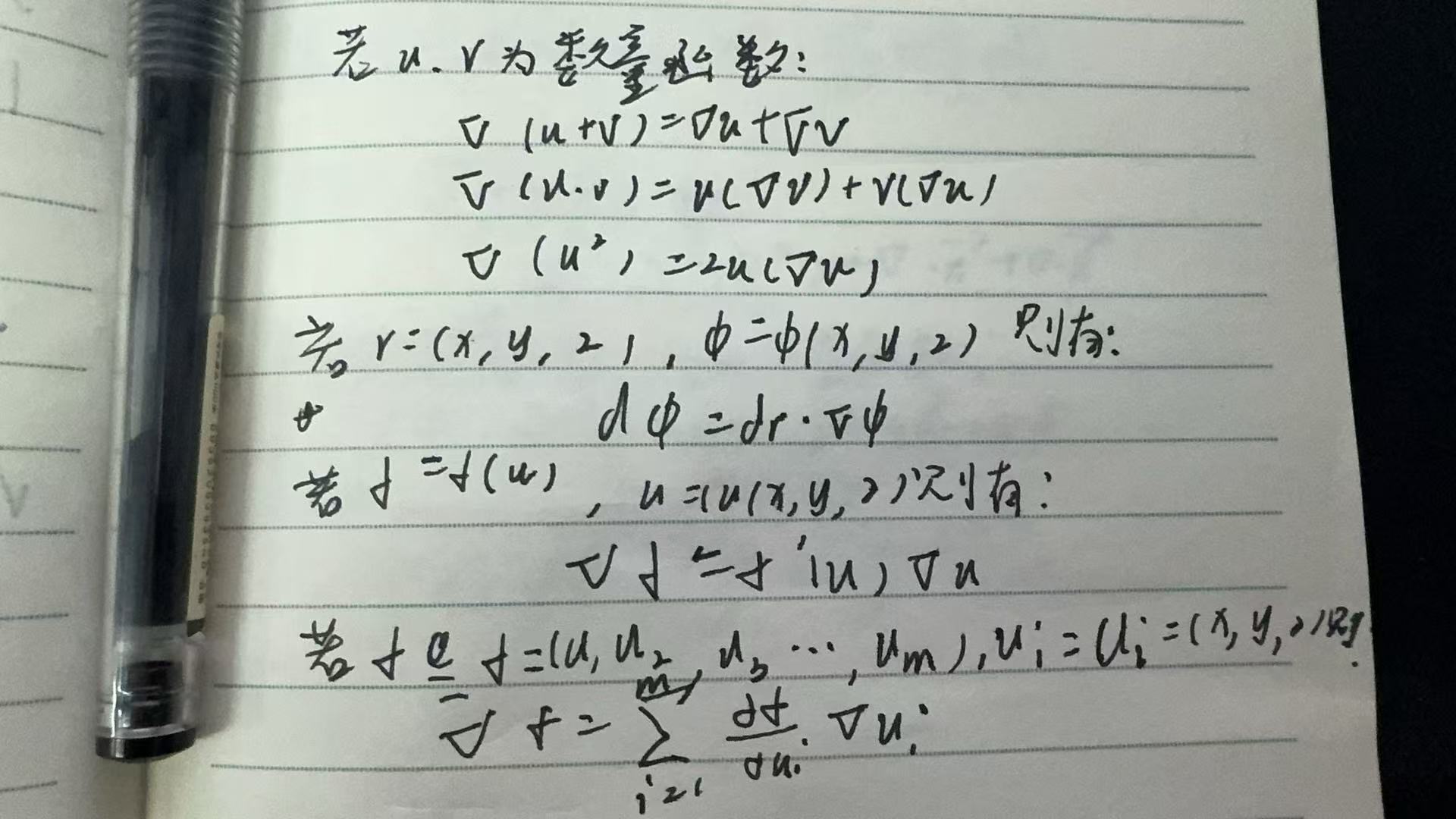

梯度:由数量函数u(x,y,z)所定义的向量函数:(第一个式子) grad u是由数量场u衍生出来的一个向量场,称为梯度场梯度指向标量场增长最快的方向,梯度的长度是这个最大的变化率对标量进行梯度计算,得到的结果是向量。引入算术符号为第二个式子。V通常称为哈密顿(Hammilton)算子,读作“nabla”

grad u是由数量场u衍生出来的一个向量场,称为梯度场梯度指向标量场增长最快的方向,梯度的长度是这个最大的变化率对标量进行梯度计算,得到的结果是向量。引入算术符号为第二个式子。V通常称为哈密顿(Hammilton)算子,读作“nabla”

梯度基本性质:

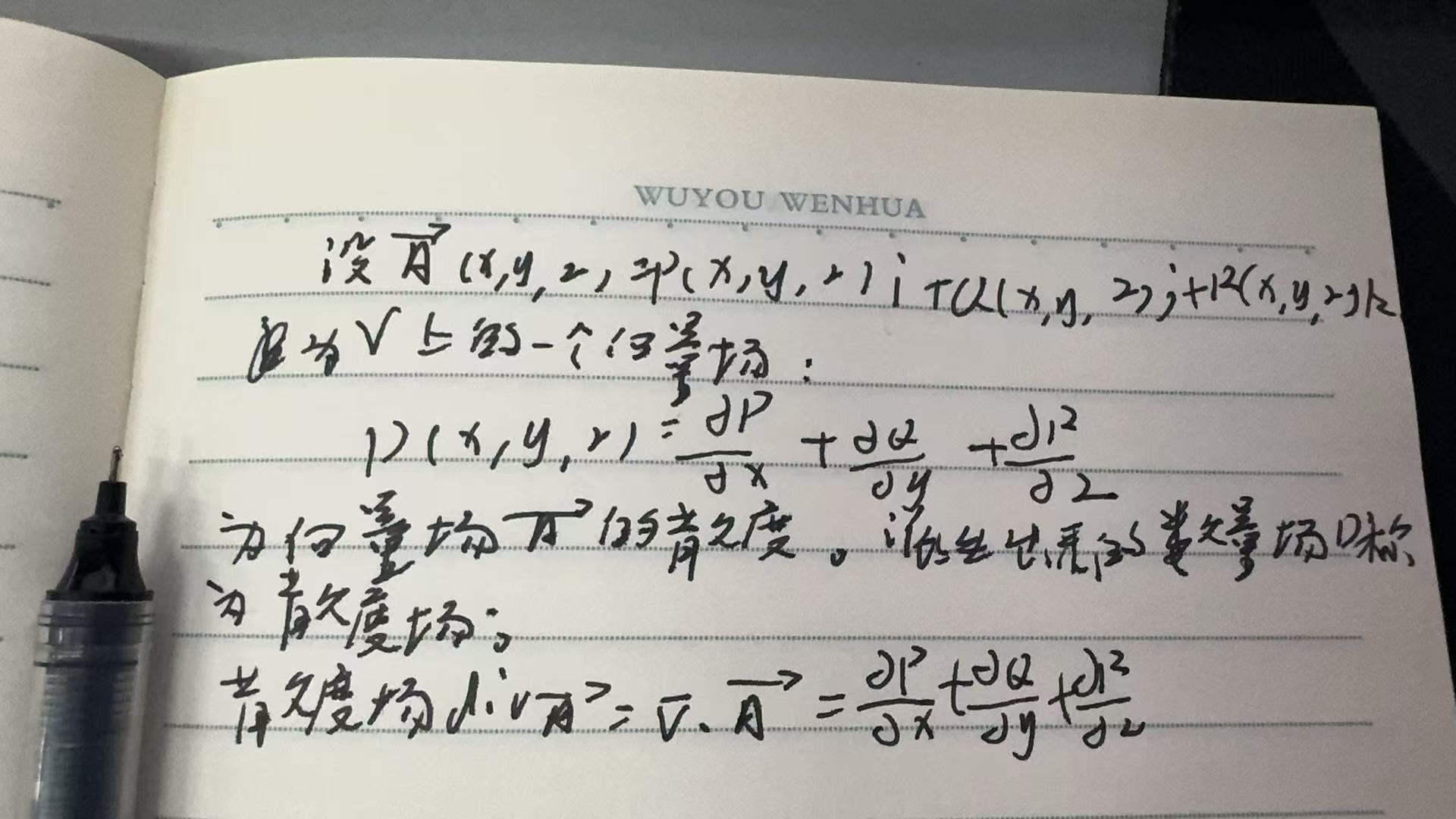

考虑任何一个点(或者说这个点的周围极小的一块区域),在这个点上,向量场的散度如果是正的,代表这些向量场是往外散出的(源);如果是负的,代表这些向量场是往内集中的(汇)对向量进行散度运算,得到的结果是标量。

散度场基本运算: